GLM-4.5 - Smart Spectrum Open Source SOTA Model for Reasoning, Code and Intelligentsia (Modèle SOTA pour le raisonnement, le code et l'intelligence)

Qu'est-ce que GLM-4.5 ?

GLM-4.5 est un modèle SOTA open source de Smart Spectrum, conçu pour des applications de corps intelligents, incorporant des capacités de raisonnement, de génération de code et de corps intelligents. Le modèle est basé sur l'architecture Mixed Expert (MoE) et se compose de deux versions, GLM-4.5 avec 355 milliards de paramètres et GLM-4.5-Air avec 106 milliards de paramètres et 32 milliards et 12 milliards de paramètres d'activation, respectivement. Le modèle est performant en matière de raisonnement, de génération de code et d'autres tâches. Il prend en charge les entrées et sorties multimodales et propose un "mode de réflexion" et un "mode de non-réflexion" pour s'adapter aux tâches complexes et aux besoins de réponse immédiate. Le modèle a une grande efficacité au niveau des paramètres, un faible coût d'appel à l'API, une vitesse de génération rapide, et convient au développement complet, à l'assistance à la programmation, à la création de contenu et à d'autres scénarios, ce qui en fait le meilleur modèle open-source à l'heure actuelle.

Principales fonctions de GLM-4.5

- capacité de raisonnementGLM-4.5 est capable de traiter des tâches de raisonnement complexes, telles que le raisonnement logique, la résolution de problèmes mathématiques, etc. La capacité de raisonnement est excellente dans un certain nombre de points de référence, et se situe au niveau le plus élevé des modèles à source ouverte.

- génération de codesLe modèle génère des extraits de code de haute qualité et prend en charge plusieurs langages de programmation, aidant les développeurs à générer rapidement des cadres de code, à corriger les erreurs de code, à optimiser la structure du code, etc. et à être compétents dans les tâches de développement complet.

- Applications du corps intelligentLes outils d'aide à la décision : support pour l'invocation d'outils, la navigation sur le web et d'autres fonctions, support pour l'accès à des cadres d'intelligence du code tels que Claude Code et Roo Code pour les tâches du corps intelligent pour les applications complexes du corps intelligent.

- Génération de contenuIl convient à la création de contenu, à la rédaction et à d'autres scénarios, offrant aux utilisateurs un support de génération de texte riche.

Adresse du site officiel de GLM-4.5

- Dépôt GitHub: : https://github.com/zai-org/GLM-4.5

- Entrepôt HuggingFace: https://huggingface.co/collections/zai-org/glm-45-687c621d34bda8c9e4bf503b

- Entrepôt ModelScope: : https://modelscope.cn/collections/GLM-45-b8693e2a08984f

- Démonstration de l'expérience en ligne: :

- Visage étreint: https://huggingface.co/spaces/zai-org/GLM-4.5-Space

- Champ d'application du modèle: : https://modelscope.cn/studios/ZhipuAI/GLM-4.5-Demo

Comment utiliser GLM-4.5

- Expérience de la plate-forme en ligne: :

- Plate-forme Wisdom Spectrum Clear Speech: Accèsun discours intellectuellement stimulantpour découvrir directement et gratuitement toutes les fonctionnalités de GLM-4.5, y compris la génération de dialogues, la génération de codes et les tâches d'inférence.

- Plate-forme Z.ai: à travers Z.ai Plate-forme permettant d'expérimenter les fonctionnalités de GLM-4.5 pour une mise à l'essai rapide.

- Appels de l'APISmart Spectrum AI fournit une interface API, à laquelle les utilisateurs peuvent accéder par l'intermédiaire de la page d'accueil. BigModel.co.uk La plateforme fait des appels d'API. L'API prend en charge une variété de fonctions, y compris la génération de texte, la génération de code et les tâches d'inférence.

- Déploiement par le biais d'un code source ouvert: :

- Dépôts GitHubPour plus d'informations, consultez le dépôt GitHub pour GLM-4.5 afin d'obtenir le code du modèle et les ressources connexes à déployer et à utiliser par vos propres moyens.

- Entrepôt HuggingFacePour plus d'informations, consultez le dépôt HuggingFace pour GLM-4.5 afin de déployer et de tester avec les outils et l'environnement fournis par HuggingFace.

- Entrepôt ModelScopeLe logiciel ModelScope : Accès au référentiel ModelScope dans GLM-4.5 pour le déploiement de modèles et le développement d'applications en utilisant les fonctionnalités de la plateforme ModelScope.

- Espace d'expérience HuggingFacePour plus d'informations, veuillez consulter l'espace d'expérience GLM-4.5 de HuggingFace pour un essai rapide des fonctionnalités du modèle.

- ModelScope Experience SpaceLes utilisateurs de GLM-4.5 sont invités à visiter l'espace d'expérience de ModelScope pour une expérience et des tests en ligne.

Indicateurs techniques du GLM-4.5

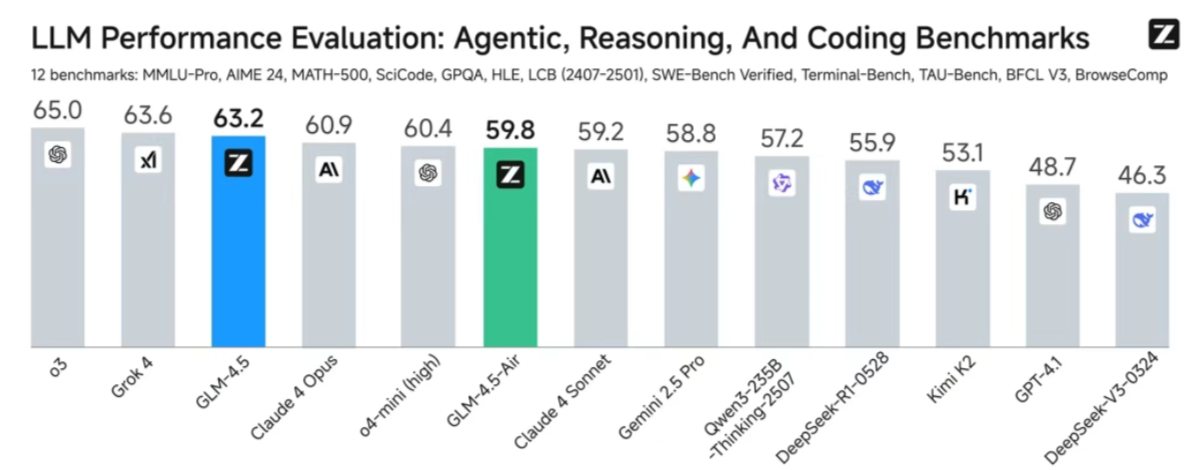

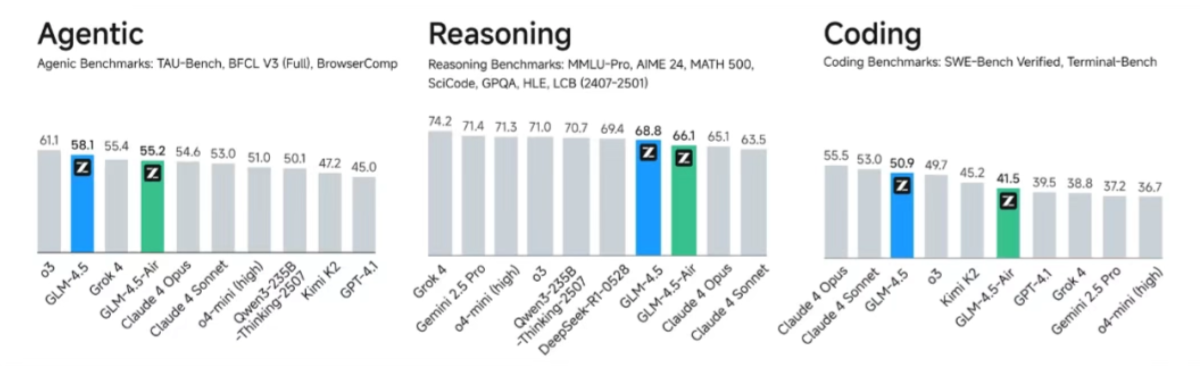

- Performance globale SOTAParmi 12 critères d'évaluation représentatifs, GLM-4.5 a obtenu la troisième place pour les modèles globaux, la première place pour les modèles nationaux et la première place pour les modèles open source. Les benchmarks d'évaluation incluent MMLU Pro, AIME 24, MATH 500, SciCode, GPQA, HLE, LiveCodeBench, SWE-Bench Verified, Terminal-Bench, TAU-Bench, BFCL v3, et BrowseComp, ce qui prouve pleinement que GLM-4.5 peut être utilisé pour l'inférence multiple, la génération de code et l'application de corps intelligents. L'excellente performance de GLM-4.5 dans de multiples scénarios tels que l'inférence, la génération de code et les applications de corps intelligents.

- Efficacité accrue des paramètresLe GLM-4.5 n'a que la moitié du nombre de paramètres de DeepSeek-R1 et le tiers du nombre de paramètres de Kimi-K2, et obtient de bien meilleurs résultats dans de nombreux tests de référence standard. Dans la liste SWE-bench Verified, qui mesure la capacité du code du modèle, la série GLM-4.5 se situe à la frontière de Pareto du rapport performance/paramètre, ce qui indique que la série GLM-4.5 obtient les meilleures performances à la même échelle.

- Faible coût, grande vitesseLa série GLM-4.5 permet de réaliser des percées en matière de coûts et d'efficacité tout en optimisant les performances : le prix de l'appel API est aussi bas que 0,8 $/million de jetons pour l'entrée et 2 $/million de jetons pour la sortie, ce qui est bien inférieur à la tarification des modèles courants. La version haute vitesse peut générer jusqu'à 100 jetons/seconde, ce qui permet un déploiement à faible latence et à forte concurrence, en tenant compte de la rentabilité et de l'expérience interactive.

Principaux avantages de GLM-4.5

- Intégration de compétences multiplesLe GLM-4.5 est le premier modèle qui fusionne nativement les capacités de raisonnement, de génération de code et de corps intelligent pour répondre simultanément aux divers besoins de raisonnement complexe, de développement de code et de tâches de corps intelligent.

- Excellentes performances en matière d'inférenceLe GLM-4.5 est en tête du modèle open-source dans plusieurs benchmarks de raisonnement et est capable de gérer des tâches de raisonnement complexes, telles que le raisonnement logique, la résolution de problèmes mathématiques et d'autres capacités de raisonnement puissantes.

- Modèle de raisonnement hybride efficaceLe modèle propose deux modes de raisonnement, le "mode réflexion" et le "mode non-réflexion". Le mode réflexion est adapté aux tâches complexes qui nécessitent des analyses approfondies, tandis que le mode non-réflexion permet de répondre rapidement aux besoins immédiats, en conciliant efficacité et performance.

- Efficacité élevée des paramètresGLM-4.5 : GLM-4.5 a un petit nombre de paramètres, mais il est plus performant dans de nombreux tests de référence standard. Par exemple, GLM-4.5 est en tête du rapport performance/paramètre dans les tests de capacité de génération de code.

- Faible coût et grande vitesseLes appels API de GLM-4.5 sont très abordables, avec des coûts d'entrée aussi bas que 0,8 $/million de jetons et des coûts de sortie de 2 $/million de jetons, et des vitesses de génération allant jusqu'à 100 jetons/seconde, ce qui permet des déploiements à faible latence et à haute teneur en monnaie.

- soutien multimodalLe GLM-4.5 prend en charge l'entrée et la sortie multimodales et peut traiter plusieurs types de données tels que le texte et les images, ce qui le rend plus à l'aise pour traiter les tâches complexes du corps intelligent, par exemple, il fonctionne bien dans les scénarios d'interaction multimodale tels que la navigation sur le web et l'invocation d'outils.

Personnes auxquelles GLM-4.5 est destiné

- Développeurs et programmeursLes fonctions de génération de code et d'aide à la programmation permettent de générer rapidement des cadres de code, de corriger les bogues, d'optimiser les structures et d'améliorer l'efficacité du développement.

- créateur de contenuLes services d'aide à la création : générez rapidement des premières ébauches d'articles, de nouvelles, de textes créatifs et autres, en fournissant une inspiration créative et en aidant à surmonter les goulets d'étranglement en matière de création.

- Chercheurs universitairesL'objectif de ce projet est de créer un outil de recherche permettant d'explorer les questions de pointe dans le domaine du traitement du langage naturel et de l'intelligence artificielle, afin de comparer et d'améliorer les modèles.

- utilisateur professionnelLes services à la clientèle : utilisés pour créer un service à la clientèle intelligent, générer des rapports d'analyse de données et développer des outils d'automatisation afin d'améliorer l'efficacité des opérations commerciales.

- Éducateurs et étudiantsLes enseignants produisent du matériel pédagogique et les étudiants utilisent leurs fonctions d'aide à l'apprentissage, telles que la production de notes et l'explication de concepts.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...