Gemini API lance un nouveau modèle d'intégration de texte : pics de performance, prise en charge des entrées 8K

Image par Google Gémeaux 2.0 Génération Flash

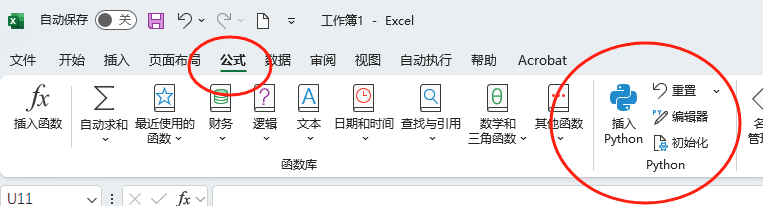

Récemment, Google a été API Gemini Un nouveau modèle expérimental d'incorporation de texte a été introduit dans l'étude. gemini-embedding-exp-03-07[1]Le modèle est formé sur la base du modèle Gemini. Le modèle est formé sur la base du modèle Gemini, héritant de la compréhension profonde du langage et des contextes subtils de Gemini, et est applicable à un large éventail de scénarios. Il est intéressant de noter que ce nouveau modèle surpasse le modèle Google text-embedding-004 et s'est hissé en tête du classement du Multilingual Text Embedding Benchmark (MTEB), tout en offrant des données d'entrée plus longues. jeton De nouvelles fonctionnalités telles que la longueur.

commentaires

Étant donné qu'il existe déjà sur le marché des modèles d'intégration à code source ouvert, tels que multilingual-e5-large-instruct, bien qu'ils soient légèrement inférieurs au nouveau modèle de Gemini en termes de performances, le modèle à code source ouvert peut encore être compétitif dans certains scénarios, tels que le traitement de petits blocs de texte et les applications sensibles aux coûts. Par conséquent, l'acceptation future du nouveau modèle de Gemini par le marché dépendra en fin de compte de la mesure dans laquelle sa stratégie de prix et ses restrictions d'utilisation répondent aux besoins des développeurs, en plus de ses performances supérieures.

Modèle complet d'intégration de texte de premier plan

Google affirme que le nouveau modèle a été spécialement formé pour offrir une polyvalence exceptionnelle, avec d'excellentes performances dans les domaines de la finance, de la science, du droit, de la recherche et bien d'autres encore, et qu'il peut être utilisé directement sans avoir besoin d'une mise au point poussée pour des tâches spécifiques.

Dans le classement des MTEB multilingues.gemini-embedding-exp-03-07 Le classement MTEB est une référence importante pour la comparaison des modèles, car il fournit une évaluation complète des performances des modèles d'intégration de texte sur une variété de tâches telles que la recherche et la classification.

Pourquoi choisir l'intégration de texte ?

Génération améliorée grâce à la mise en place d'une recherche intelligente (RAG) et les systèmes de recommandation, à la classification de textes, la capacité des modèles de langage à grande échelle (LLM) à comprendre le sens du texte est essentielle. Les techniques d'intégration permettent souvent de construire des systèmes plus efficaces, réduisant le coût et la latence tout en fournissant de meilleurs résultats que les systèmes de correspondance de mots clés.

Les techniques d'intégration permettent de saisir la sémantique et le contexte par le biais d'une représentation numérique des données. Les données dont la sémantique est similaire ont des vecteurs d'intégration plus proches. Les techniques d'intégration soutiennent une variété d'applications, notamment :

- Recherche efficace : Recherche de documents pertinents dans de grandes bases de données, comme la recherche de documents juridiques ou la recherche d'entreprise, en comparant la requête avec les vecteurs d'intégration des documents.

- Génération Augmentée de Récupération (RAG) : Améliorer la qualité et la pertinence du texte généré en récupérant et en intégrant des informations pertinentes dans le contexte du modèle.

- Regroupement et classification : Regrouper les textes similaires pour identifier les tendances et les thèmes dans les données.

- Classification : Classification automatique basée sur le contenu du texte, par exemple l'analyse des sentiments ou la détection du spam.

- Similitude des textes : Identifier le contenu dupliqué et réaliser des tâches telles que la déduplication de pages web ou la détection de plagiat.

Pour en savoir plus sur l'intégration et les cas d'utilisation courants de l'IA, vous pouvez vous référer à la rubrique Documentation de l'API Gemini.

Faites l'expérience de Gemini Text Embedding dès maintenant

Les développeurs peuvent désormais utiliser ce nouveau modèle expérimental d'intégration de texte via l'API Gemini. Il est similaire à l'API embed_content Compatibilité d'interface.

from google import genai

client = genai.Client(api_key="GEMINI_API_KEY")

result = client.models.embed_content(

model="gemini-embedding-exp-03-07",

contents="阿尔法折叠是如何工作的?",

)

print(result.embeddings)

Outre l'amélioration de la qualité dans tous les aspects de l'activité de lgemini-embedding-exp-03-07 Il présente également les caractéristiques suivantes :

- Limite d'entrée de jetons de 8K : Par rapport aux modèles précédents, Google a amélioré la longueur du contexte pour permettre l'intégration de plus grands morceaux de texte, de code ou d'autres données.

- 3072 sortie dimensionnelle : des vecteurs d'intégration à haute dimension avec près de 4 fois plus de tokens que le modèle d'intégration précédent.

- Apprentissage par représentation de Matryoshka (MRL) : La technologie MRL permet aux développeurs de tronquer le vecteur original à 3072 dimensions afin de réduire les coûts de stockage. En d'autres termes, la technologie MRL permet aux utilisateurs de sacrifier une partie de la précision en échange d'un gain d'espace de stockage.

- Prise en charge étendue des langues : Le nombre de langues prises en charge a doublé pour atteindre plus de 100.

- Modèle unifié : Ce modèle surpasse en qualité les modèles précédemment publiés par Google pour les tâches spécifiques, le multilinguisme, l'anglais simple et les codes spécifiques.

Bien qu'il s'agisse actuellement d'une phase expérimentale avec une capacité limitée, cette version offre aux développeurs l'opportunité d'explorer les premières possibilités d'utilisation de la technologie de l'information. gemini-embedding-exp-03-07 Possibilités de capacités. Comme tous les modèles expérimentaux, il est susceptible d'être modifié. Google indique qu'il travaille à l'élaboration d'une version stable et généralement disponible dans les mois à venir.

Google encourage les développeurs à rendre leurs produits plus accessibles par le biais de Formulaire de retour d'information intégré Fournir un retour d'information.

Certains utilisateurs ont noté que le modèle est gratuit pendant la prévisualisation, mais qu'il y a des règles strictes à respecter.limite de vitesse-5 demandes par minute, 100 demandes par jour. Les développeurs peuvent facilement déclencher ces limites lorsqu'ils testent des modèles. Certains utilisateurs ont exprimé l'espoir que Google relève bientôt ces limites.

Dans la discussion sur Reddit, de nombreux utilisateurs ont exprimé leur enthousiasme à l'égard de la sortie du nouveau modèle, le décrivant comme "une affaire plus importante que les gens ne le pensent". L'un d'entre eux a déclaré : "Les vecteurs d'intégration fp32 à 3 000 dimensions sont énormes. Je parie que l'on peut construire un décodeur très raisonnable avec une telle quantité de données ...... Si ce modèle était bon marché, je l'utiliserais probablement plus souvent qu'un modèle linguistique complet à grande échelle. En général, l'extraction de caractéristiques sémantiques est ce que vous voulez vraiment".

Un autre utilisateur a noté que ce modèle "n'a pas beaucoup de concurrence" dans le domaine multilingue, ajoutant qu'il est probablement mieux adapté aux grands blocs de texte en raison de la limitation du débit et de la dimensionnalité de l'intégration.

[1] : sur Vertex AI, le même modèle est passé par la fonctiontext-embedding-large-exp-03-07 est fournie. La dénomination sera cohérente au moment de la publication officielle.© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...