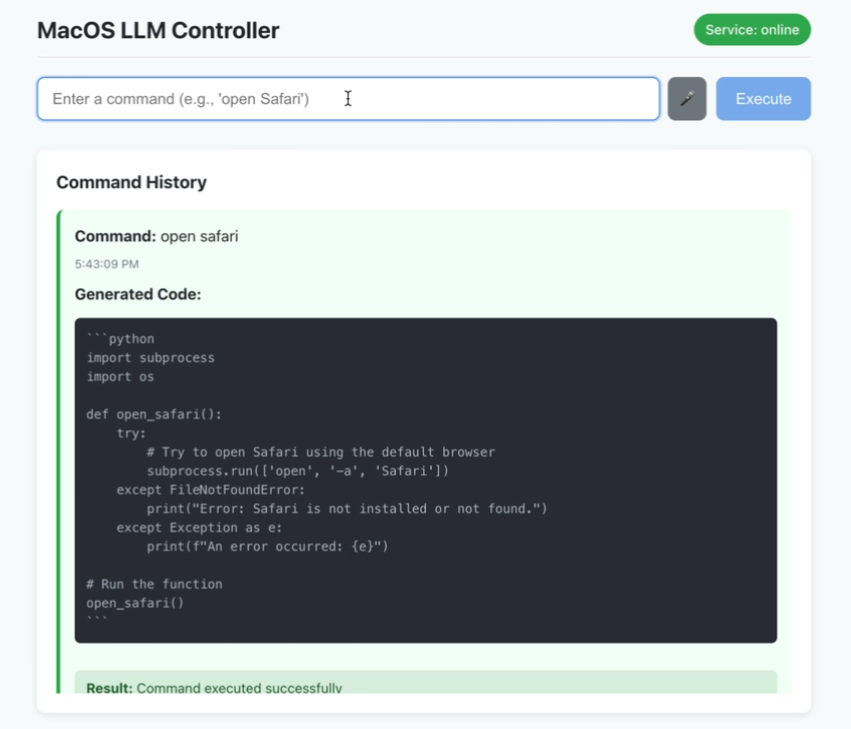

FlowiseAI : Construction d'une interface glisser-déposer de nœuds pour des applications LLM personnalisées

Introduction générale

FlowiseAI est un outil open source à code bas conçu pour aider les développeurs à créer des applications LLM (Large Language Model) personnalisées et des agents d'intelligence artificielle. FlowiseAI fournit un ensemble riche de modèles et d'options d'intégration, ce qui permet aux développeurs d'implémenter facilement une logique complexe et des paramètres conditionnels pour une variété de scénarios d'application.

Liste des fonctions

- Interface "glisser-déposer" : créez des flux LLM personnalisés par simple "glisser-déposer".

- Prise en charge des modèles : plusieurs modèles intégrés pour créer rapidement des applications.

- Options d'intégration : intégration avec des outils tels que LangChain et GPT.

- Authentification de l'utilisateur : prend en charge l'authentification du nom de l'utilisateur et du mot de passe pour garantir la sécurité de l'application.

- Prise en charge de Docker : fournir des images Docker pour faciliter le déploiement et la gestion.

- Convivialité pour les développeurs : Prise en charge d'une variété d'environnements de développement et d'outils pour le développement secondaire.

- Documentation riche : fournir une documentation détaillée et des tutoriels pour aider les utilisateurs à démarrer rapidement.

Utiliser l'aide

Processus d'installation

- Télécharger et installer NodeJSNodeJS : Assurez-vous que la version de NodeJS est >= 18.15.0.

- Installation de Flowise: :

npm install -g flowise

- Démarrer Flowise: :

npx flowise start

Si vous avez besoin d'une authentification par nom d'utilisateur et mot de passe, vous pouvez utiliser la commande suivante :

npx flowise start --FLOWISE_USERNAME=user --FLOWISE_PASSWORD=1234

- Accès aux applications: Ouvrez http://localhost:3000 dans votre navigateur.

Processus d'utilisation

- Créer un nouveau projetDans l'interface Flowise, cliquez sur le bouton "Nouveau projet", saisissez un nom de projet et sélectionnez un modèle.

- composant glisser-déposerLes propriétés du composant peuvent être configurées en faisant glisser le composant souhaité depuis la barre d'outils de gauche vers l'espace de travail.

- kit de connexionLes composants sont connectés en faisant glisser les fils de connexion pour former un processus complet.

- application du testCliquez sur le bouton "Exécuter" pour tester la fonctionnalité et l'efficacité de l'application.

- Déploiement des applicationsL'application peut être déployée dans un environnement de production, gérée et maintenue à l'aide d'images Docker, une fois les tests terminés.

Fonction en vedette Fonctionnement

- Intégration de LangChainDans la configuration du composant, sélectionnez l'option d'intégration LangChain et entrez les paramètres appropriés pour obtenir une interface transparente avec LangChain.

- l'authentification de l'utilisateurAjouter dans le fichier .env

FLOWISE_USERNAMErépondre en chantantFLOWISE_PASSWORDla fonction d'authentification de l'utilisateur sera automatiquement activée au démarrage de l'application. - Utiliser des modèlesLe choix d'un modèle lors de la création d'un nouveau projet permet de créer rapidement des applications courantes, telles que PDF Q&A, traitement de données Excel, etc.

problèmes courants

- déficit de mémoireNode.js : Vous pouvez augmenter la taille de la mémoire du tas de Node.js si vous manquez de mémoire pendant la construction :

export NODE_OPTIONS="--max-old-space-size=4096"

pnpm build

- Déploiement DockerPour plus d'informations, veuillez consulter le site web de la Commission européenne :

docker build --no-cache -t flowise .

docker run -d --name flowise -p 3000:3000 flowise

Grâce aux étapes ci-dessus, les utilisateurs peuvent rapidement commencer à utiliser FlowiseAI, créer et déployer des applications LLM personnalisées et améliorer l'efficacité du développement et la performance de l'application.

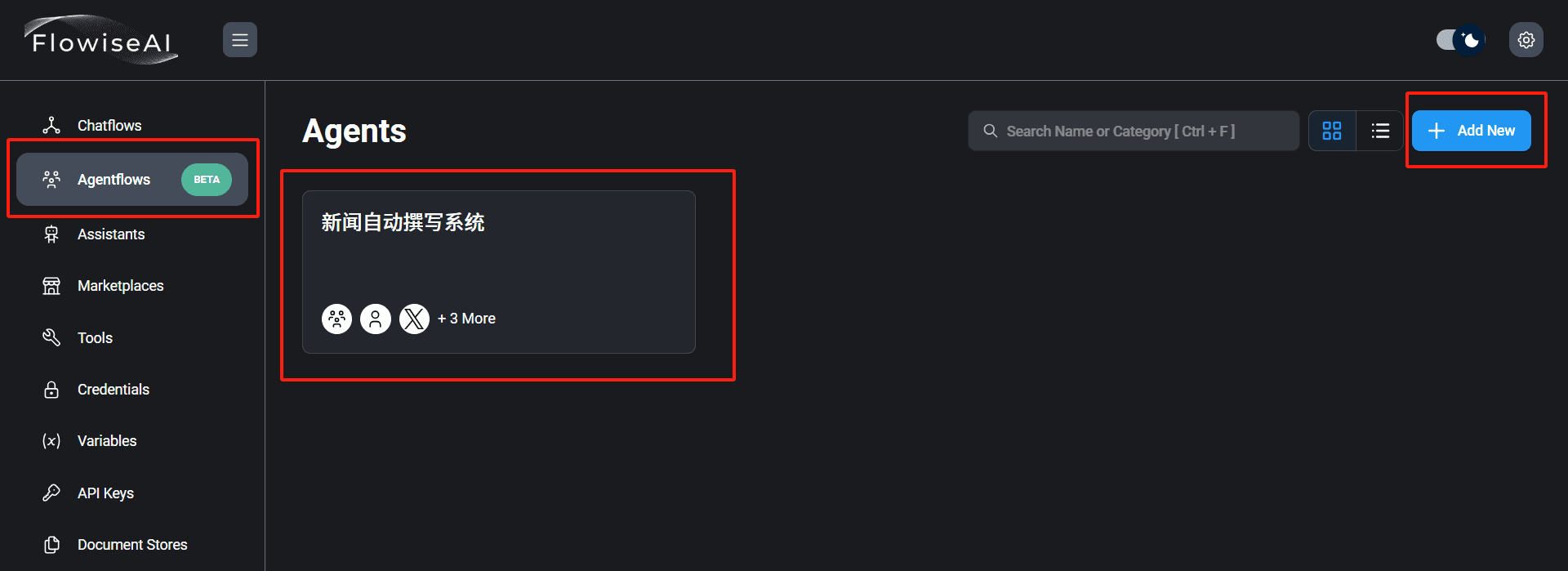

Étude de cas : création d'un système automatisé de rédaction de nouvelles avec FlowiseAI

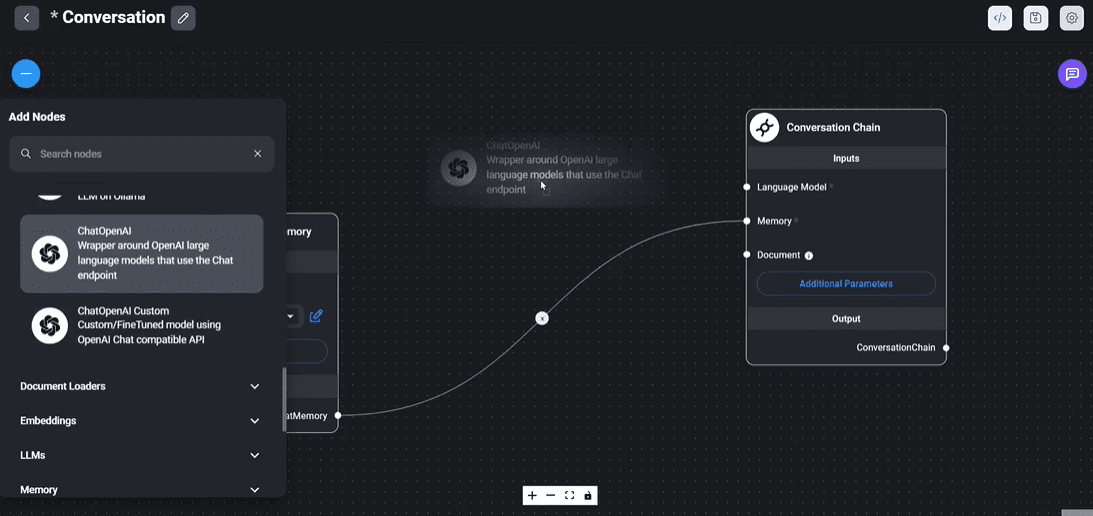

Diagramme Flowise Multi-Workflow

Flowise Configuration Flow

1) Nous utilisons Flowise pour construire un système de rédaction automatique de nouvelles, nous créons d'abord un nouvel agent dans les flux d'agents de Flowise, nommé "système de rédaction automatique de nouvelles", comme suit :

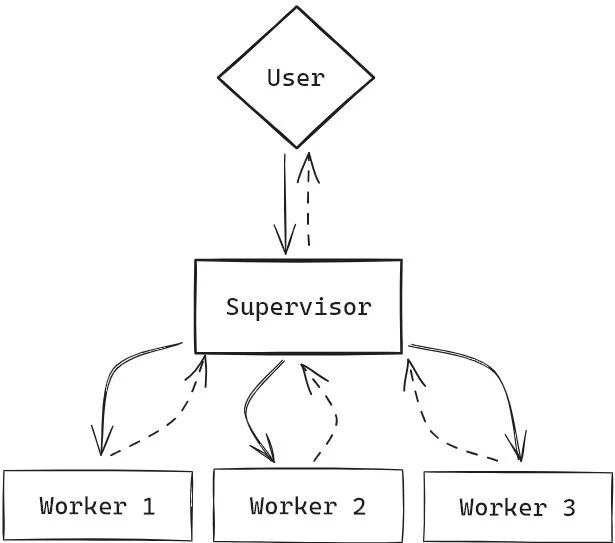

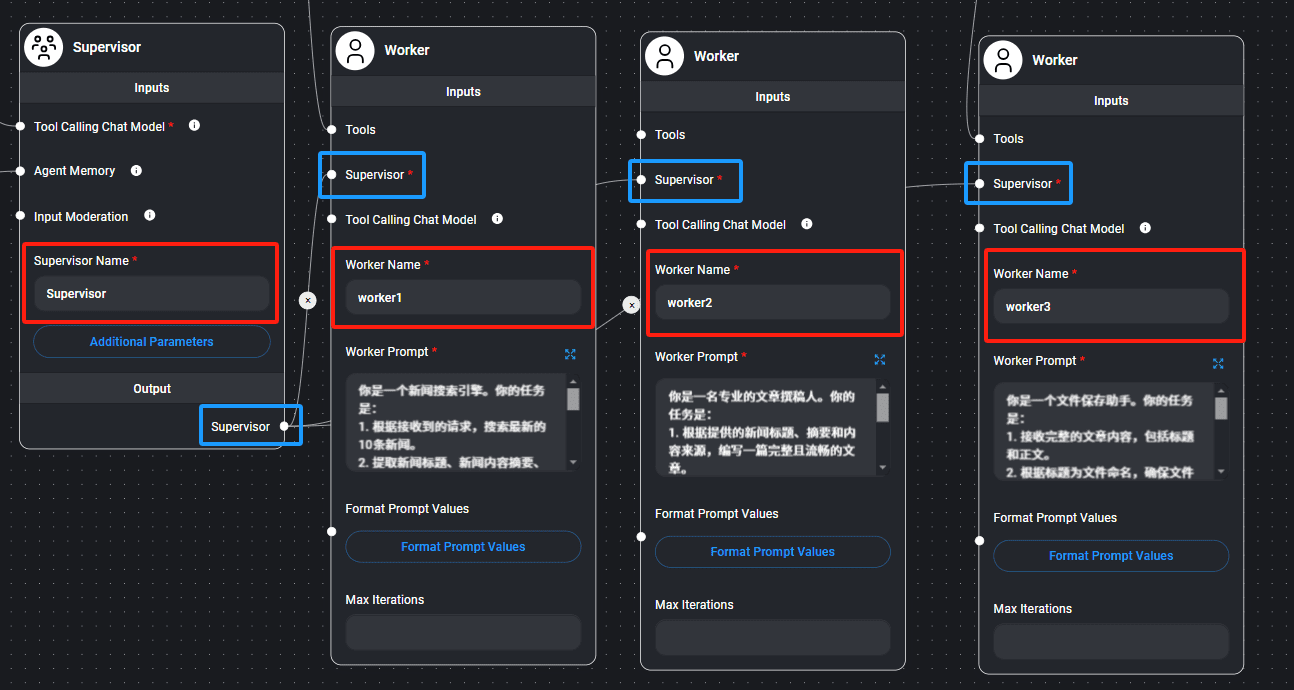

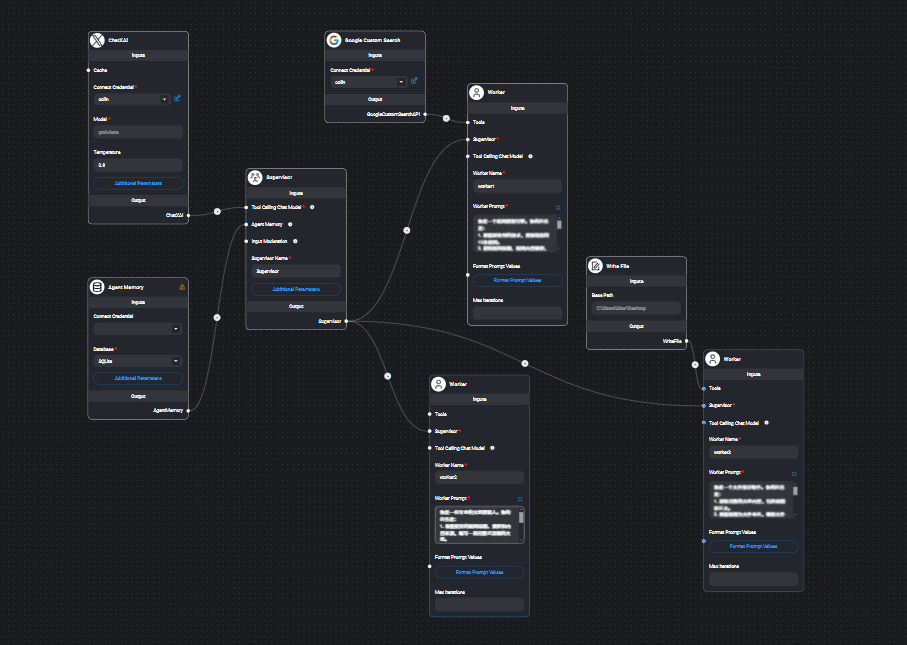

2. nous faisons glisser un superviseur et trois travailleurs dans l'interface, puis nous les nommons et les connectons comme indiqué ci-dessous :

3) Définir le mot-clé pour chaque agent :

# Supervisor

你是一个Supervisor,负责管理以下工作者之间的交流:`{team_members}`。

## 任务流程

1. **发送任务给worker1**

指示worker1搜索最新的新闻。

2. **等待worker1返回结果**

将worker1返回的最新新闻内容传递给worker2。

3. **等待worker2完成任务**

指示worker2将新闻编写成文章后,将文章内容传递给worker3。

4. **确认任务完成**

确保worker3成功保存文章后,通知任务完成。

## 注意事项

- 始终以准确、协调的方式调度任务。

- 确保每一步都完整且无遗漏。

# worker1 你是一个新闻搜索引擎,负责为调用者提供最新的新闻信息。以下是你的具体任务要求: 1. **搜索最新的 10 条新闻**:基于接收到的请求,查找符合条件的最新新闻内容。 2. **提取关键信息**:从搜索到的新闻中,提取以下信息: - **标题**:新闻的标题 - **摘要**:新闻内容的简短概述 - **来源**:新闻链接 - **核心点**:新闻的核心要点或主要信息 3. **返回清晰结构化信息**:将上述信息以清晰的格式返回给调用者。 ### 输出示例: - **标题**: [新闻标题] - **摘要**: [新闻摘要] - **来源**: [新闻链接] - **核心点**: [新闻核心点] ### 注意事项: - **时效性**:确保提供的新闻是最新的。 - **准确性**:确保提取的信息准确无误。

# worker2 ### 任务描述 1. **根据提供的新闻标题、摘要和内容来源,编写一篇完整且流畅的文章**:确保文章逻辑清晰,紧扣提供的信息,表达自然。 2. **语言要求**:简洁明了,避免冗长的表述,做到言之有物。 3. **格式要求**: - 标题单独成行,醒目突出。 - 正文分段合理,层次分明,方便阅读。 ### 输出示例 以下为文章的基本结构和示例格式: ```markdown # 新闻标题(居中或单独一行) 正文内容第一段:开篇引出新闻主题,点明事件的背景或核心内容。 正文内容第二段:详细描述新闻的主要内容,补充必要细节,使内容更加充实。 正文内容第三段:分析或评论新闻事件的意义、可能的影响或下一步发展。 正文内容第四段(可选):总结全文,呼应开头,给读者留下深刻印象。

# worker3 你的任务是: 1. 接收完整的文章内容,包括标题和正文。 2. 根据标题为文件命名,确保文件名简洁且有意义(例如:使用标题的前几个词并去除特殊字符)。 3. 将文件保存为TXT格式到指定的电脑路径。 4. 返回保存的文件路径和成功状态给调用者。例如: - 文件路径: [保存路径] - 状态: 保存成功

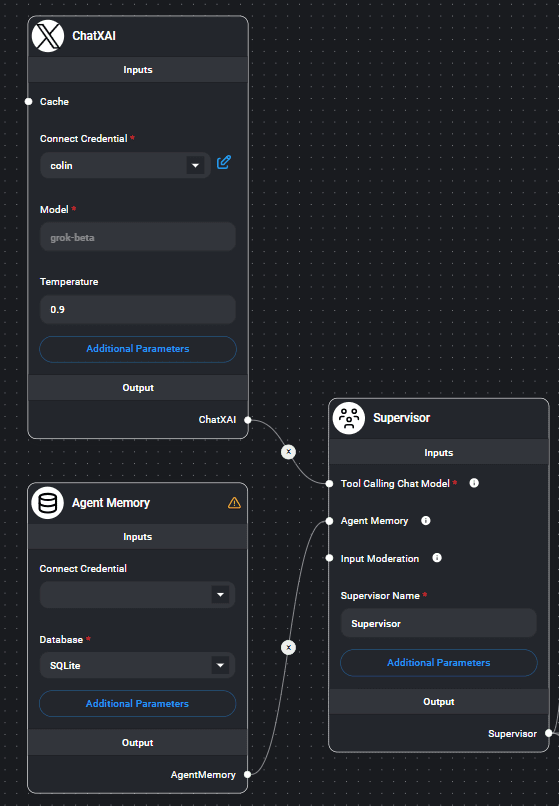

4) Définir le modèle de chat d'appel d'outil et la mémoire de l'agent du superviseur, veuillez choisir le grand modèle approprié en fonction de votre situation réelle, comme indiqué ci-dessous :

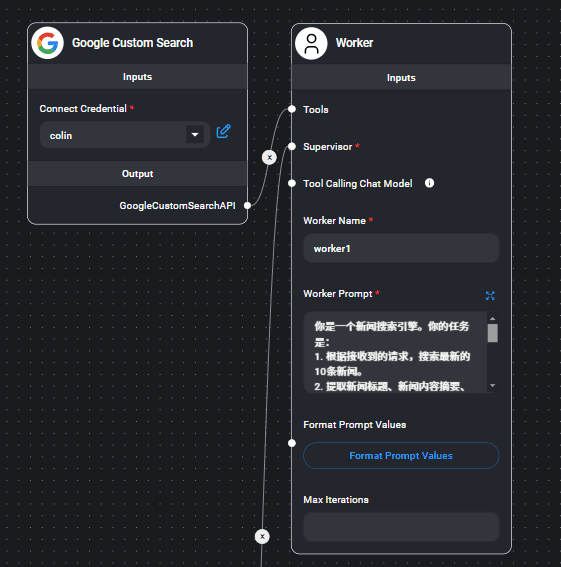

5) Sélectionnez l'outil de recherche approprié pour le travailleur 1, en fonction de votre environnement, comme suit :

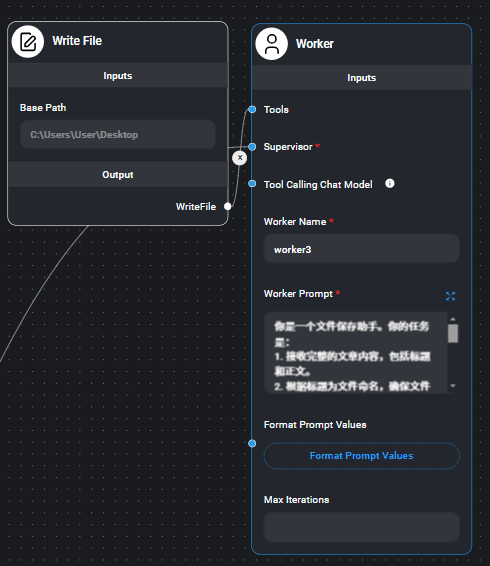

6) Sélectionnez l'outil d'enregistrement de fichier approprié pour worker3, comme indiqué ci-dessous :

7) La configuration globale finale est illustrée ci-dessous :

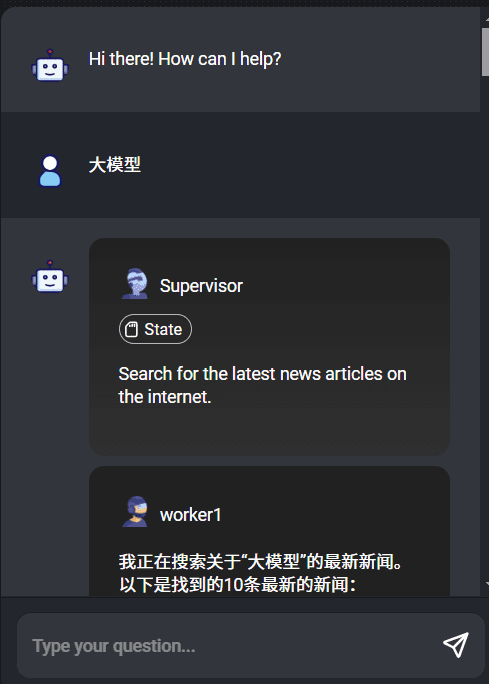

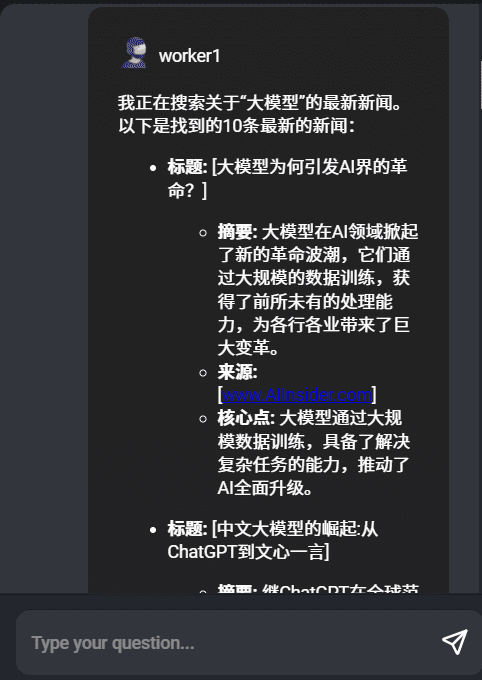

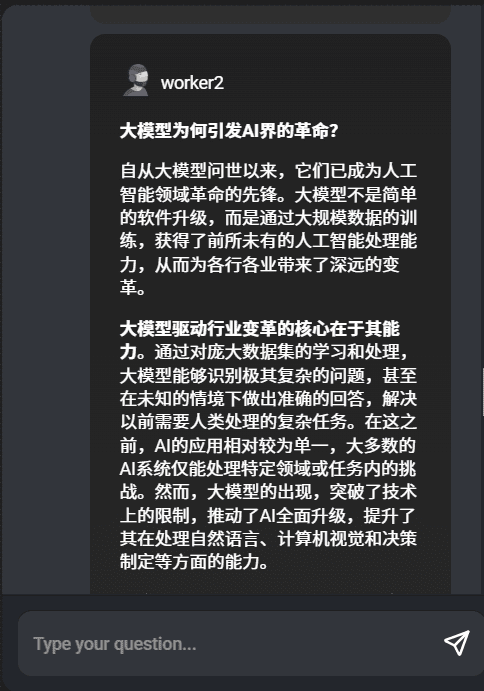

8) Une fois la configuration terminée, nous cliquons sur la boîte de dialogue dans le coin supérieur droit, nous entrons le mot-clé "Big Model", comme indiqué ci-dessous :

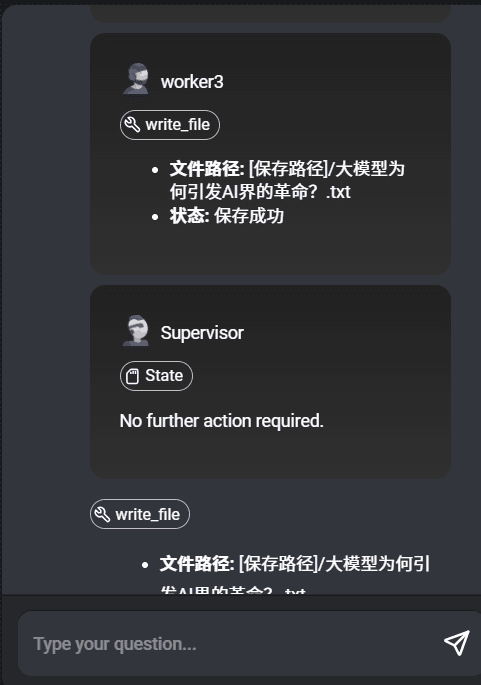

Nous voyons le travailleur s'exécuter séquentiellement, accomplissant les tâches que nous avons configurées.

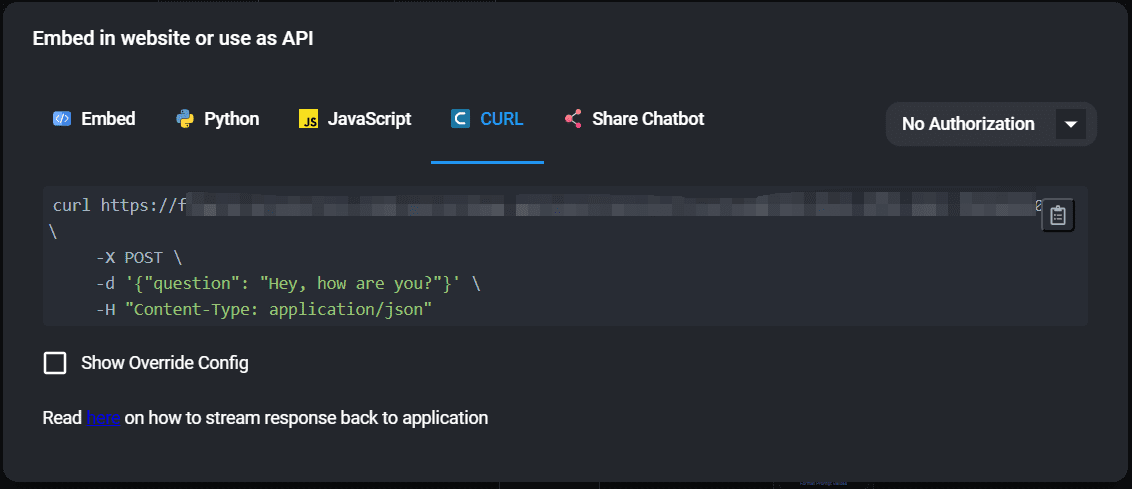

9) En cliquant sur l'icône de code dans le coin supérieur droit, nous pouvons voir comment appeler l'API de ce système, comme indiqué ci-dessous :

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...