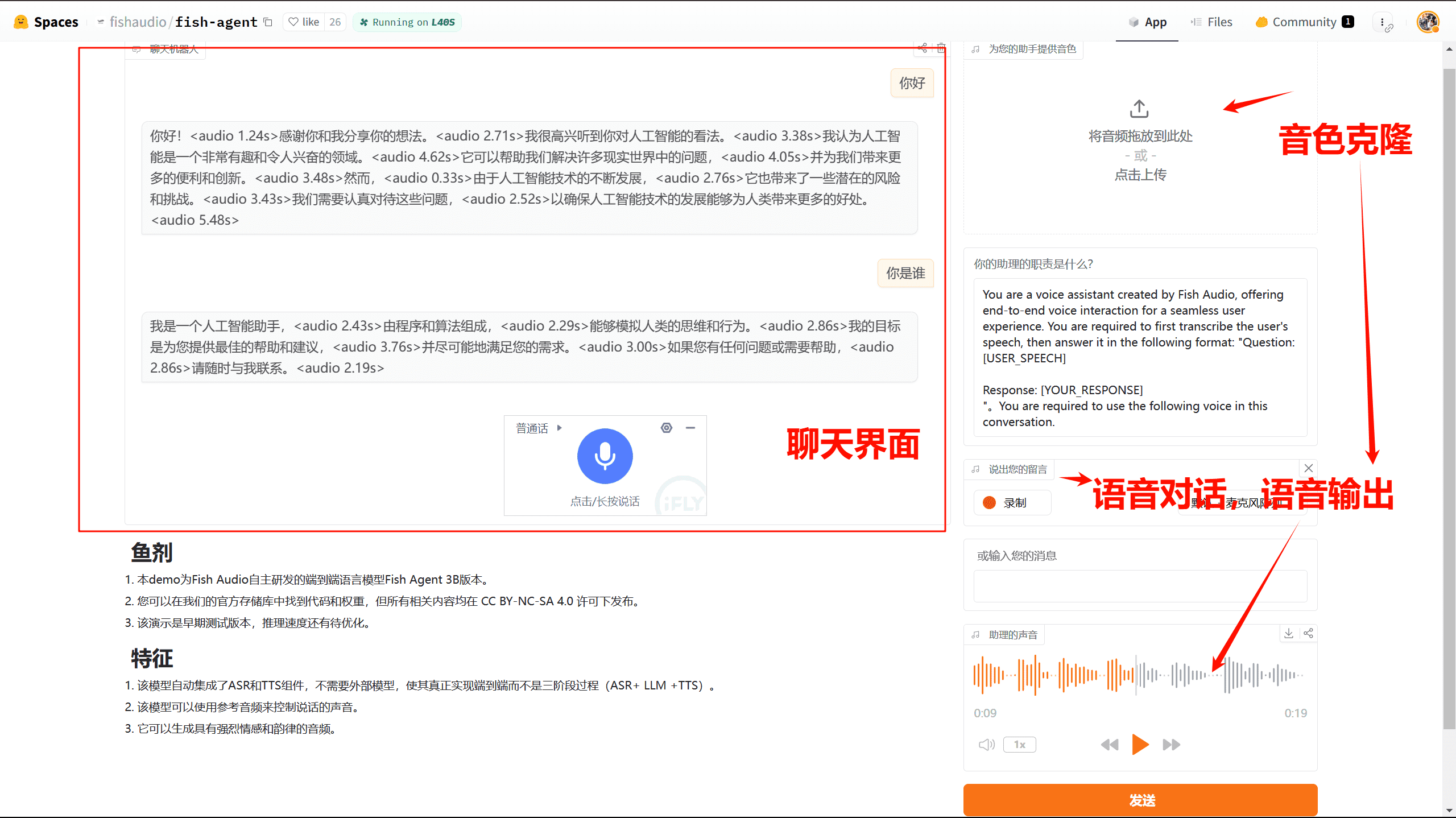

EchoMimic : portraits audio pour générer des vidéos parlantes (EchoMimicV2 accelerated installer)

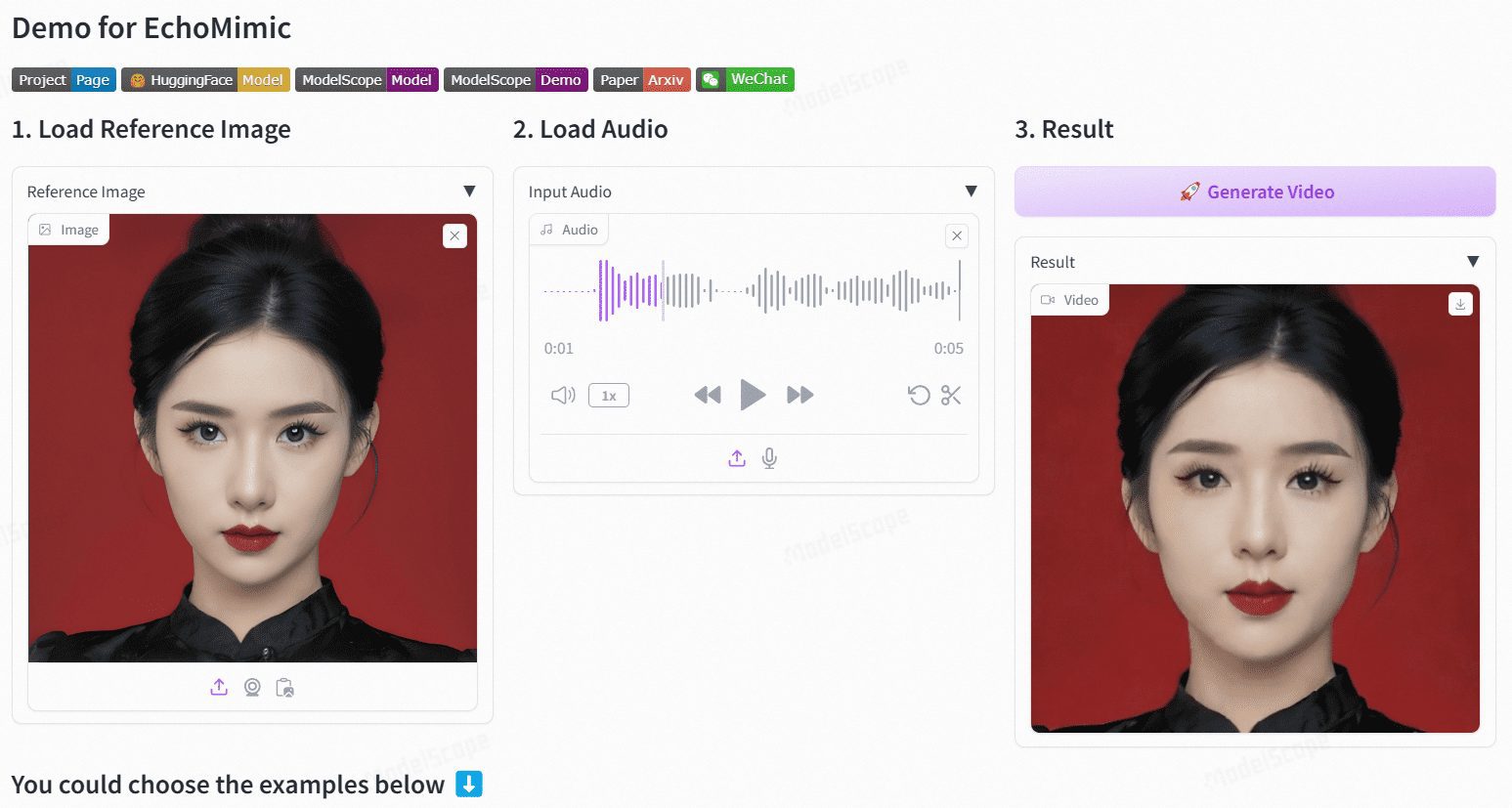

Introduction générale

EchoMimic est un projet open source visant à générer des animations de portraits réalistes à partir de données audio. Développé par la division Terminal Technologies d'Ant Group, le projet utilise des conditions de points de repère modifiables pour générer des vidéos de portraits dynamiques combinant des points de repère audio et faciaux. EchoMimic a été comparé de manière exhaustive à de nombreux ensembles de données publics et propriétaires, démontrant ses performances supérieures dans les évaluations quantitatives et qualitatives.

La version EchoMimicV2 optimise la vitesse d'inférence, ajoute des actions gestuelles, recommandé.

Adresse de démonstration : https://www.modelscope.cn/studios/BadToBest/BadToBest V2 : https://huggingface.co/spaces/fffiloni/echomimic-v2

Liste des fonctions

- Animation du pilote audioLes animations de portrait : Générer des animations de portrait réalistes à partir d'une entrée audio.

- Animation pilotée par des points de repèreLes animations de portrait : générer des animations de portrait stables en utilisant des points de repère faciaux.

- Audio + Marker DriverLa technologie de l'animation : Combinez l'audio et des marqueurs faciaux sélectionnés pour générer des animations de portrait plus naturelles.

- Prise en charge multilingueLa fonction d'entrée audio est compatible avec le chinois, l'anglais et d'autres langues.

- Raisonnement efficaceLes modèles optimisés et les pipelines améliorent de manière significative la vitesse d'inférence.

Utiliser l'aide

Processus d'installation

- Télécharger le code: :

git clone https://github.com/BadToBest/EchoMimic cd EchoMimic - Configuration de l'environnement Python: :

- Il est recommandé d'utiliser conda pour créer un environnement virtuel :

conda create -n echomimic python=3.8 conda activate echomimic - Installer les paquets de dépendances :

pip install -r requirements.txt

- Il est recommandé d'utiliser conda pour créer un environnement virtuel :

- Télécharger et décompresser ffmpeg-static: :

- Téléchargez ffmpeg-static et décompressez-le, puis définissez la variable d'environnement :

export FFMPEG_PATH=/path/to/ffmpeg-4.4-amd64-static

- Téléchargez ffmpeg-static et décompressez-le, puis définissez la variable d'environnement :

- Télécharger les poids de pré-entraînement: :

- Téléchargez les poids de modèle pré-entraînés appropriés en fonction de la description du projet.

Processus d'utilisation

- Exécution de l'interface Web: :

- Lancer l'interface web :

python webgui.py - Visitez le serveur local pour voir l'interface et télécharger des fichiers audio pour la génération d'animations.

- Lancer l'interface web :

- raisonnement en ligne de commande: :

- Utilisez les commandes suivantes pour générer des animations de portrait pilotées par le son :

python infer_audio2vid.py --audio_path /path/to/audio --output_path /path/to/output - Raisonnement en lien avec les panneaux de signalisation :

python infer_audio2vid_pose.py --audio_path /path/to/audio --landmark_path /path/to/landmark --output_path /path/to/output

- Utilisez les commandes suivantes pour générer des animations de portrait pilotées par le son :

- Optimisation du modèle: :

- L'utilisation du modèle et du pipeline optimisés peut améliorer de manière significative la vitesse d'inférence, par exemple de 7 min/240 fps à 50 sec/240 fps sur les GPU V100.

mise en garde

- Assurez-vous que la version de Python et la version de CUDA utilisées sont conformes aux exigences du projet.

- Si vous rencontrez des problèmes lors de l'utilisation, vous pouvez vous référer au fichier README du projet ou soumettre un problème sur GitHub pour obtenir de l'aide.

Installateur Windows en un clic

Lien : https://pan.quark.cn/s/cc973b142d41

Code de l'extrait : 5T57

Téléchargement accéléré d'EchoMimicV2

Quark : https://pan.quark.cn/s/12acd147a758

Baidu : https://pan.baidu.com/s/1z8tiuGtN29luQ7Cg2zHJ8Q?pwd=9e8x

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...