DreamTalk : générez des vidéos parlantes expressives avec une seule image d'avatar !

Introduction générale à DreamTalk

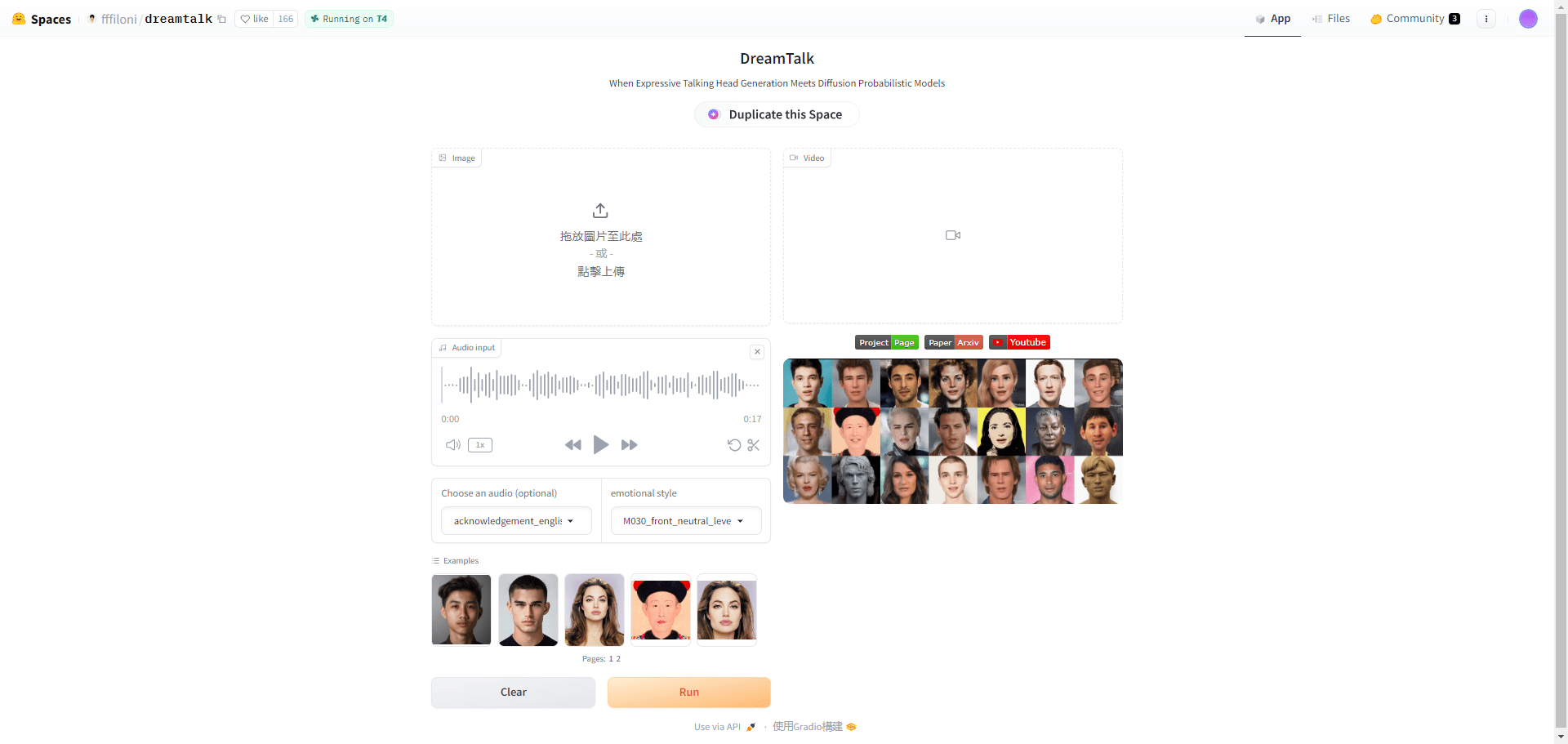

DreamTalk est un cadre de génération de têtes parlantes expressives basé sur un modèle de diffusion, développé conjointement par l'université de Tsinghua, le groupe Alibaba et l'université des sciences et technologies de Huazhong. Il se compose de trois éléments principaux : un réseau de réduction du bruit, un expert en lèvres sensible au style et un prédicteur de style. Il est capable de générer des têtes parlantes diverses et réalistes sur la base d'entrées audio. Il est capable de générer des têtes parlantes diverses et réalistes sur la base d'une entrée audio. Le cadre est capable de gérer des données audio multilingues et bruyantes, de fournir des mouvements faciaux de haute qualité et une synchronisation précise de la bouche.

Liste des caractéristiques de DreamTalk

Générer des vidéos de têtes parlantes réalistes basées sur l'audio

Prise en charge de plusieurs langues et de la saisie vocale

Prise en charge de la sortie de plusieurs styles et expressions

Prise en charge des avatars de personnages personnalisés et des références de style

Prise en charge de la démo en ligne et du téléchargement du code

Aide DreamTalk

Visitez la page d'accueil du projet pour plus d'informations et des vidéos de démonstration.

Visitez l'adresse de l'article pour lire les détails techniques et les résultats expérimentaux.

Visitez l'adresse GitHub pour télécharger le code et le modèle pré-entraîné.

Suivez le guide d'installation pour configurer l'environnement et les dépendances.

Exécutez inference_for_demo_video.py pour raisonner et générer la vidéo.

Ajuster les options d'entrée et de sortie en fonction de la description des paramètres

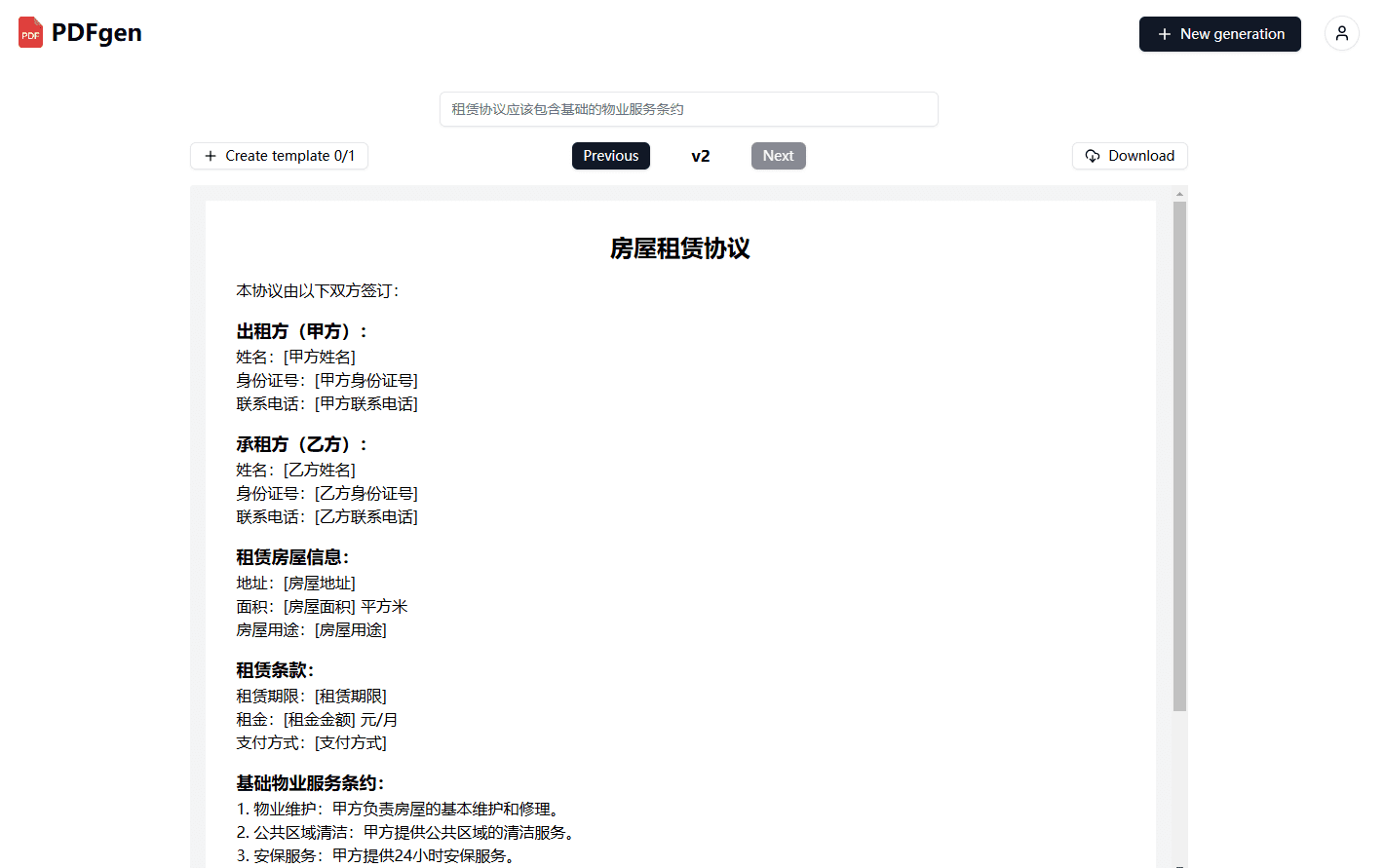

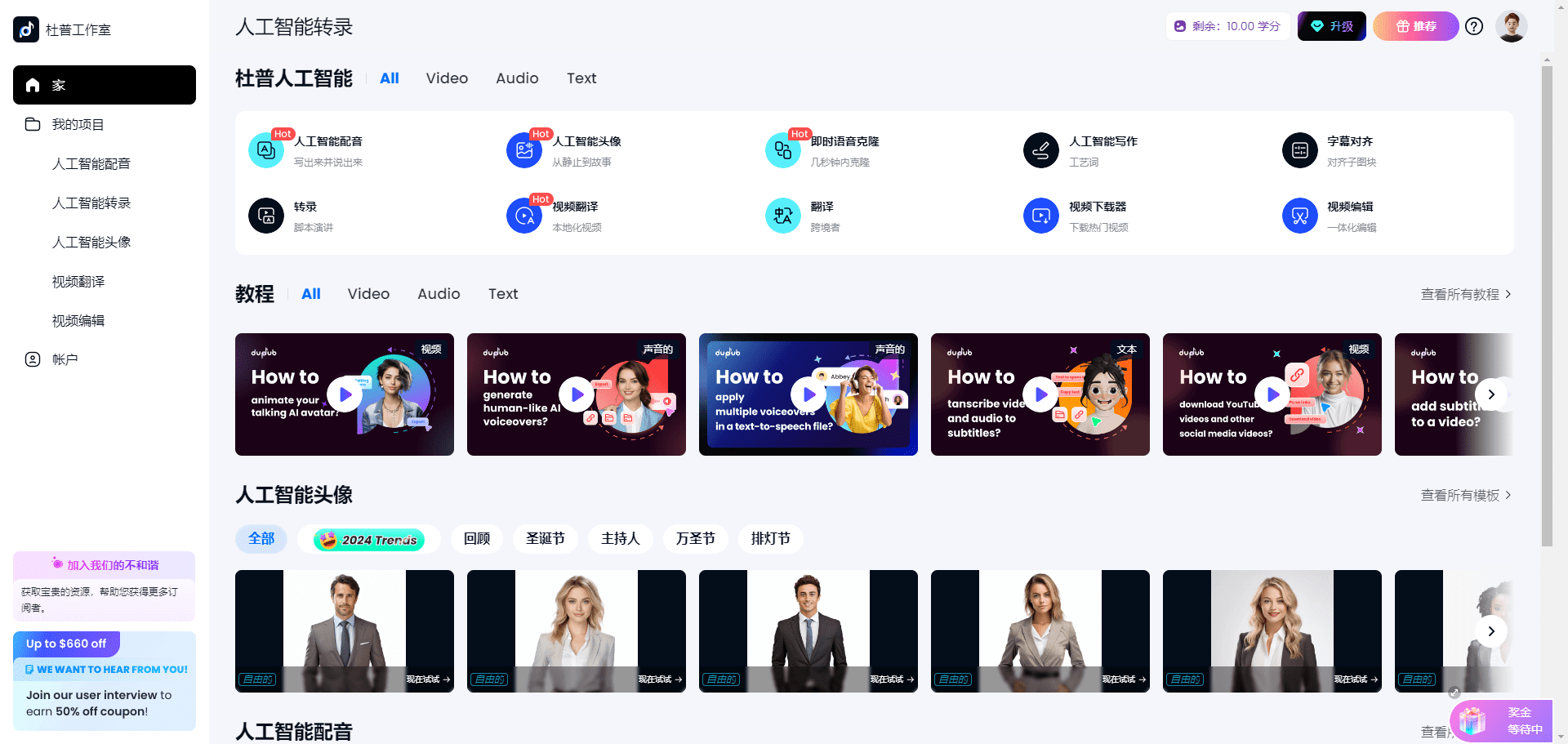

Adresse de l'expérience DreamTalk Online

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...