Dolphin : Reconnaissance des langues asiatiques et modélisation de la parole vers le texte pour les langues asiatiques

Introduction générale

Dolphin est un modèle open source développé par DataoceanAI en collaboration avec l'université de Tsinghua, qui se concentre sur la reconnaissance vocale et linguistique pour les langues asiatiques. Il prend en charge 40 langues d'Asie de l'Est, d'Asie du Sud, d'Asie du Sud-Est et du Moyen-Orient, ainsi que 22 dialectes chinois. Le modèle est entraîné sur plus de 210 000 heures de données audio, combinant des ensembles de données propriétaires et publiques. Dolphin peut convertir la parole en texte, ainsi que détecter les parties du discours (VAD), segmenter l'audio et reconnaître la langue (LID). Dolphin peut convertir la parole en texte, détecter les parties de la parole (VAD), segmenter l'audio et reconnaître la langue (LID).

Liste des fonctions

- Prise en charge de la synthèse vocale dans 40 langues asiatiques et 22 dialectes chinois.

- La détection de l'activité vocale (VAD) permet de repérer les segments de parole dans l'audio.

- Prise en charge de la division audio, découpage d'un long fichier audio en petits segments pour le traitement.

- Mettre en œuvre l'identification de la langue (LID) pour déterminer la langue ou le dialecte de l'audio.

- Code et modèles à source ouverte permettant à l'utilisateur de les modifier et de les personnaliser.

- Des modèles de base et des petits modèles sont disponibles pour répondre à différents besoins.

- Utiliser un système d'étiquetage à deux niveaux qui fait la distinction entre les langues et les régions (par ex.

<zh><CN>).

Utiliser l'aide

Le processus d'installation et d'utilisation de Dolphin est simple et convient aux utilisateurs ayant des compétences de base en programmation. Voici les étapes détaillées.

Processus d'installation

- Préparation de l'environnement

Nécessite Python 3.8 ou plus, et FFmpeg pour traiter l'audio.- Vérification de Python : Dans le terminal, tapez

python --version, confirmant la version. - Python n'est pas installé et peut être téléchargé à partir de python.org.

- Installer FFmpeg : Exécutez la commande correspondant à votre système :

- Ubuntu/Debian :

sudo apt update && sudo apt install ffmpeg - macOS :

brew install ffmpeg - Fenêtres :

choco install ffmpeg

Les outils de gestion des paquets non installés peuvent être téléchargés à partir du site web de FFmpeg.

- Ubuntu/Debian :

- Vérification de Python : Dans le terminal, tapez

- Installation de Dolphin

Il y a deux façons de procéder :- Installer avec pip

Saisissez-le dans le terminal :pip install -U dataoceanai-dolphinCeci installera la dernière version stable.

- Installation à partir du code source

Pour utiliser la dernière version de développement, téléchargez-la sur GitHub :- Entrepôt de clonage :

git clone https://github.com/DataoceanAI/Dolphin.git - Accéder au catalogue :

cd Dolphin - Installation :

pip install .

- Entrepôt de clonage :

- Installer avec pip

- Télécharger les modèles

Dolphin a 4 modèles, actuellement la base (140M paramètres) et le petit (372M paramètres) sont disponibles en téléchargement gratuit.- à travers (une brèche) Visage étreint Obtenir le fichier modèle.

- Enregistrer dans le chemin spécifié, par exemple

/data/models/dolphin/. - Le modèle de base est plus rapide et le petit modèle est plus précis.

Utilisation

Les opérations en ligne de commande et Python sont prises en charge.

opération en ligne de commande

- Parole au texte

Préparer le fichier audio (par ex.audio.wav), entrez :

dolphin audio.wav

Le système télécharge automatiquement le modèle par défaut et produit le texte. L'audio doit être au format WAV et peut être converti avec FFmpeg :

ffmpeg -i input.mp3 output.wav

- Spécification des modèles et des chemins

Utiliser le petit modèle :

dolphin audio.wav --model small --model_dir /data/models/dolphin/

- Spécifier la langue et la région

Reconnaissance du chinois mandarin avec des marqueurs à double couche :

dolphin audio.wav --model small --model_dir /data/models/dolphin/ --lang_sym "zh" --region_sym "CN"

lang_symest le code de la langue, par exemple "zh" (chinois).region_symest l'indicatif régional, par exemple "CN" (Chine continentale).

Pour une liste complète des langues, voir langues.md.

- Remplir l'audio court

Disponible lorsque la durée de l'audio est inférieure à 30 secondes--padding_speech trueGarniture :

dolphin audio.wav --model small --model_dir /data/models/dolphin/ --lang_sym "zh" --region_sym "CN" --padding_speech true

Manipulation du code Python

- Chargement de l'audio et des modèles

Fonctionne en Python :

import dolphin

waveform = dolphin.load_audio("audio.wav") # 加载音频

model = dolphin.load_model("small", "/data/models/dolphin/", "cuda") # 加载模型

"cuda"avec GPU, sans GPU passage à"cpu".

- Reconnaissance des cadres

Traite l'audio et l'émet :result = model(waveform) # 转文本 print(result.text) # 显示结果 - Spécifier la langue et la région

Ajouter des paramètres :result = model(waveform, lang_sym="zh", region_sym="CN") print(result.text)

Fonction en vedette Fonctionnement

- Détection de l'activité vocale (VAD)

Détecte automatiquement les segments de discours et les étiquette avec le temps, par exemple :0.0-2.5s: 你好 3.0-4.5s: 今天天气很好 - Identification des langues (LID)

Déterminez la langue audio, par exemple :dolphin audio.wav --model small --model_dir /data/models/dolphin/sortie en tant que

<zh>(chinois) ou<ja>(japonais). - balisage bilingue

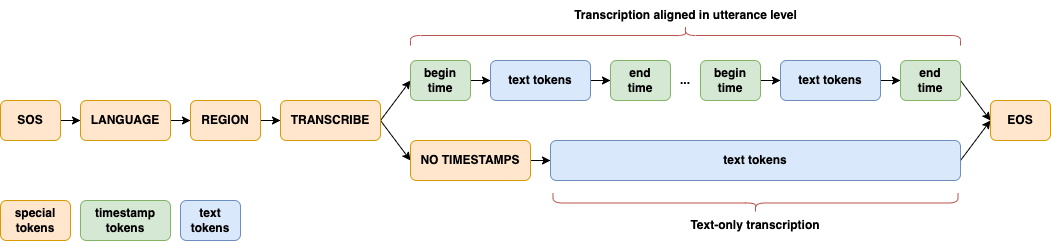

Distinguer les langues et les régions à l'aide d'un étiquetage à deux niveaux, par exemple<zh><CN>(en chinois mandarin),<zh><TW>(mandarin taïwanais) afin d'améliorer les capacités de traitement des langues asiatiques. - architecture du modèle

L'architecture CTC-Attention, avec E-Branchformer pour le codeur et Transformer pour le décodeur, est optimisée pour les langues asiatiques.

scénario d'application

- procédures

Convertit les enregistrements de conférences asiatiques multilingues en texte, adapté aux réunions internationales ou locales. - étude dialectale

Analyser les caractéristiques phonologiques de 22 dialectes chinois et générer des données de recherche. - Développement de dispositifs intelligents

Intégration dans les appareils intelligents pour la commande vocale dans les langues asiatiques.

QA

- Quelles sont les langues prises en charge ?

Prise en charge de 40 langues asiatiques et de 22 dialectes chinois, voir langues.md. - Besoin d'un GPU ?

Le CPU peut fonctionner, le GPU (support CUDA) est plus rapide. - Quelle est la différence entre le modèle de base et le petit modèle ?

Le modèle de base est petit (140M paramètres) avec un taux d'erreur de 33,31 TP3T ; le petit modèle est grand (372M paramètres) avec un taux d'erreur de 25,21 TP3T.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...