Déploiement d'un outil de chat personnalisé "petit" modèle pour les ordinateurs à faible coût

Pourquoi déployer un "mini" outil de chat privé ?

De nombreuses personnes ont utilisé ChatGPT, Wisdom Spectrum, Beanbag, Claude et d'autres excellents modèles linguistiques de grande taille, et ont besoin d'utiliser en profondeur, ils achèteront également des services tiers payants, après tout, ils sont très performants. Par exemple, mon scénario de travail principal est d'écrire des articles, alors je choisirai Claude.

Bien que j'aime utiliser Claude, est-ce que je l'utilise vraiment tous les jours à une fréquence élevée ? La réponse est bien sûr non !

Les seuils tels que les limites d'utilisation, les facteurs de prix, les problèmes de réseau, etc., réduisent naturellement la fréquence d'utilisation dans les situations inutiles. --Si un outil ne peut pas être "pris et utilisé" dans n'importe quel environnement, c'est qu'il y a quelque chose qui ne va pas.

Dans ce cas, l'utilisation d'un "petit" modèle peut être un meilleur choix, pourquoi ?

"Caractéristiques du modèle "Small

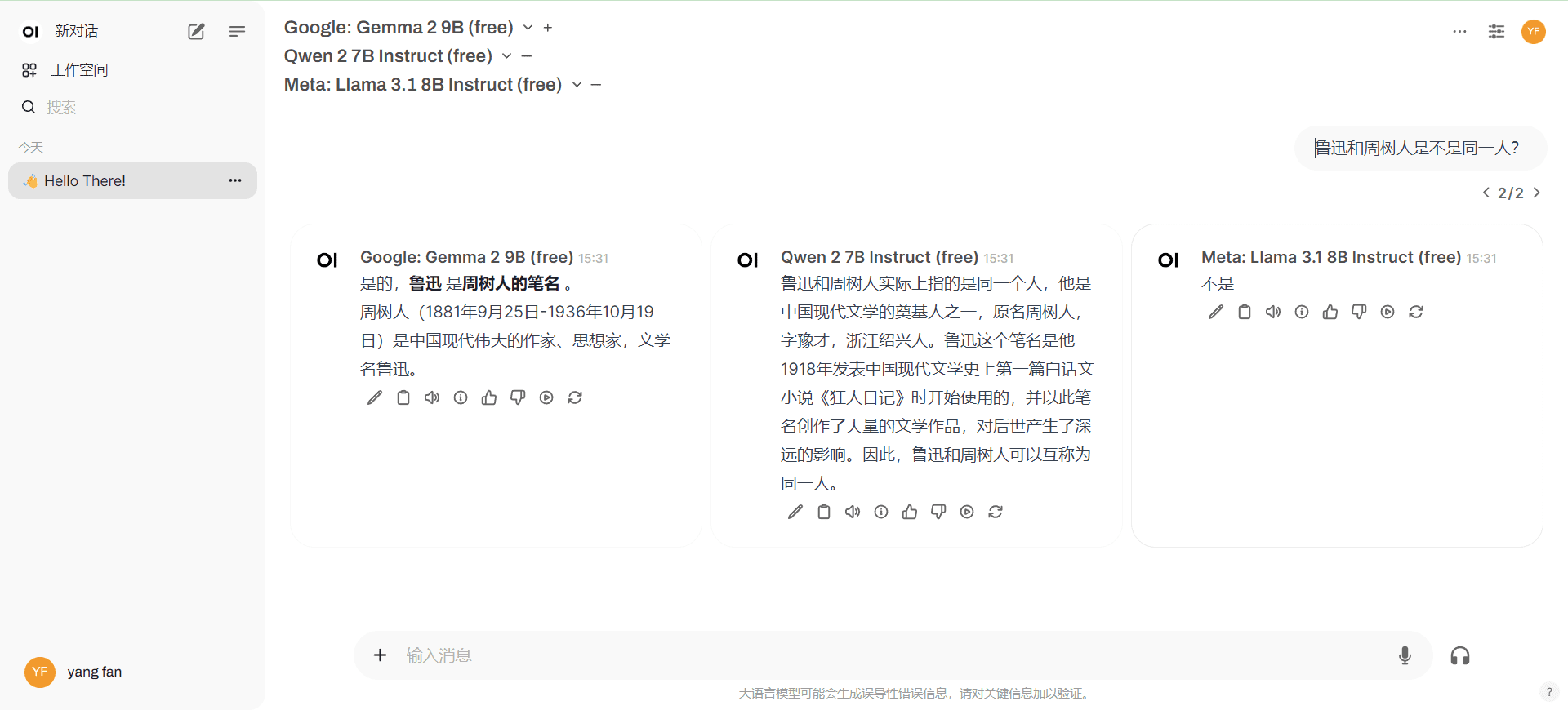

Gemma2, llama3.1:8b, qwen2:7b sont suffisamment petits pour une utilisation quotidienne, avec 32k de long d'entrée et de sortie contextuelles, la plupart des commandes sont suivies, l'expression chinoise, la réponse aux questions, tout est bon, et il n'y a pas de limite de 2000 mots pour les produits de type "Wenxin Yiyin". Les limites... C'est suffisant pour un usage quotidien, et nous envisagerons de nous spécialiser dans des tâches particulières. Les avantages des miniatures sont les suivants :

- Prise en charge de tailles de contexte pas plus petites (ou même plus grandes) que le modèle le plus grand

- Tâches quotidiennes de rédaction avec un résultat qui n'est pas de mauvaise qualité

- utilisation illimitée

- Plusieurs miniatures peuvent produire des réponses simultanément pour faciliter la comparaison.

- Une exécution plus rapide

Qu'est-ce que le déploiement privé ?

Une interface WEB de chat privé pour une personnalisation aisée et un accès libre aux "petits" modèles.

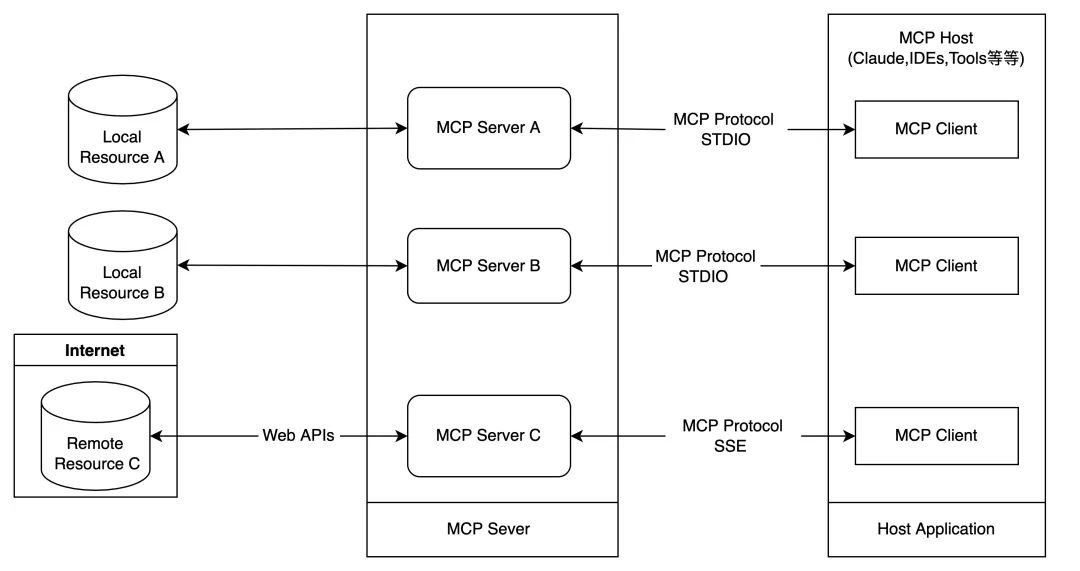

La solution la plus classique consiste à déployer localement Ollama+Open WebUI, le premier étant responsable de l'exécution des miniatures sur l'ordinateur local et le second hébergeant l'interface de discussion. Envisagez les extranets pour une utilisation à tout moment et en tout lieu de l'interface de discussion.cloudflarepeut-êtrecpolaireMettez l'adresse en correspondance avec un réseau externe (recherchez le tutoriel vous-même).

avantage

- Les données du chat sont locales et privées

- Souplesse d'adaptation des modèles locaux

inconvénients

- Difficile de fonctionner de manière persistante (il faut toujours éteindre l'ordinateur, n'est-ce pas ?) Difficile de publier sur un extranet

- Exigences élevées en matière de matériel informatique

question à traiter

Ce sont les lacunes que nous essayons de combler :

1. l'interface de chat IA déployée doit être publiée sur un extranet avec des URL d'accès stables pour être utilisée partout et à tout moment

2) Le seuil du matériel informatique est principalement l'utilisation d'Ollama pour exécuter le modèle localement, le passage à des fabricants bien connus de services API peut être, la protection de la vie privée est relativement bonne et gratuite. (L'ordinateur général local peut faire fonctionner de petits modèles, le réseau dispose d'une API gratuite).

Programme optimal

1. déploiement local/cloud de doceker ouvert WebUI + accès aux API du "petit" modèle

Usage local uniquement, le matériel informatique doit être capable de faire fonctionner doceker.

2. auto-déploiement/utilisation de NextChat tripartite + accès aux API du "petit" modèle

L'auto-déploiement de NextChat nécessite votre propre nom de domaine, et il y a un risque de compromettre vos clés en utilisant un NextChat tripartite.

Ce plan de déploiement est réservé aux personnes expérimentées, les blancs inexpérimentés ne sont pas recommandés, une bonne utilisation des produits matures ou des problèmes anormaux ne valent pas la peine d'être retardés.

Option de déploiement optimal 1

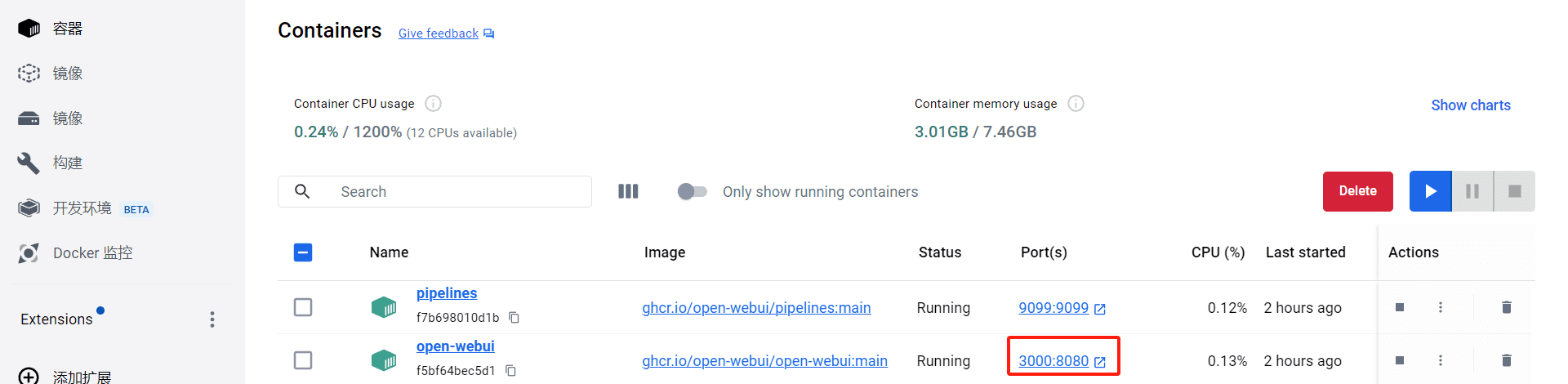

1. déploiement de doceker

Local : déploiement local de tutoriels doceker chercher soi-même

Cloud : ressources doceker gratuites dans le cloud, veuillez faire votre propre recherche, ici j'utilise Koyeb. (Intranet non directement accessible, requiert science et technologie)

2. déployer Open WebUI dans doceker

Local : DétailsLire le documentLes commandes d'installation suivantes sont recommandées (maintenez-les à jour)

docker run --rm --volume /var/run/docker.sock:/var/run/docker.sock containrrr/watchtower --run-once open-webui

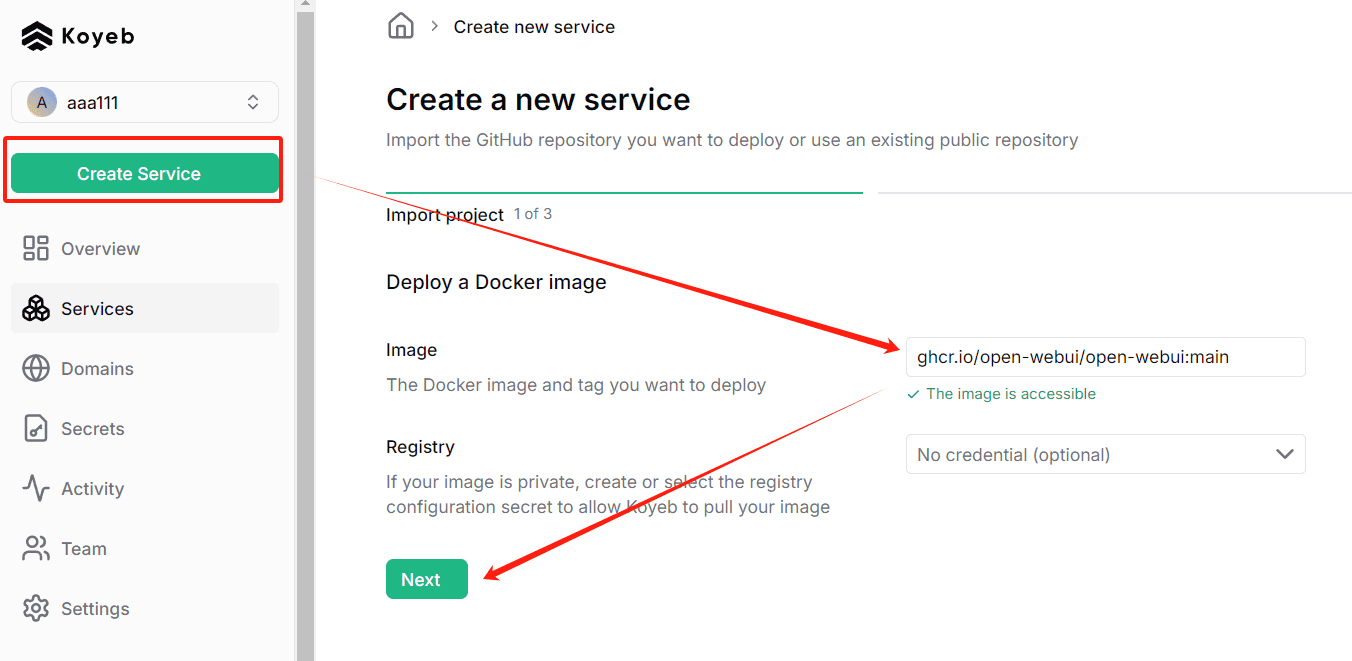

Nuage : EnregistrementKoyebEnsuite, cliquez sur Créer un service et entrez la commande suivante

ghcr.io/open-webui/open-webui:main

3. démarrer Open WebUI

Démarrage local, adresse d'accès par défaut : http://localhost:3000/

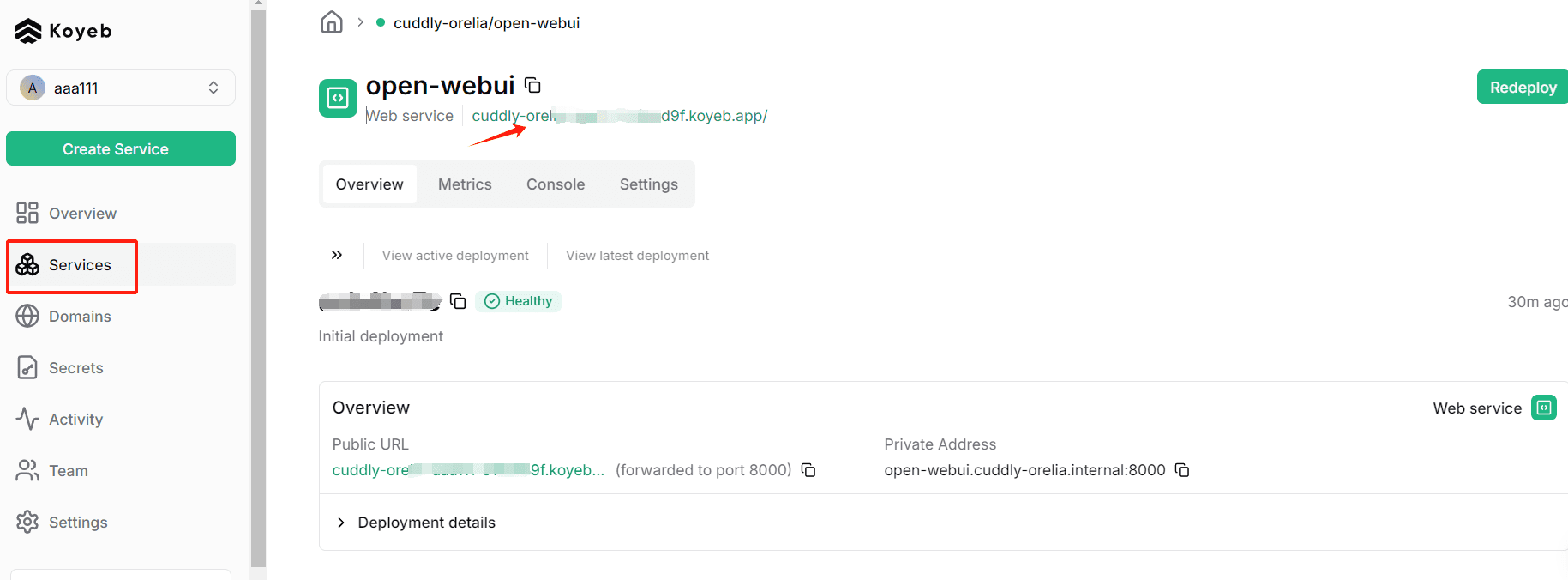

Le lancement en nuage, une fois le déploiement de Koyeb terminé, peut être cliqué ici (l'inconvénient est que ce nom de domaine n'est pas directement accessible par l'intranet, et que la liaison du nom de domaine nécessite l'ouverture d'un compte payant).

Après le démarrage, enregistrez un compte, par défaut, le premier compte enregistré est le compte administrateur. Si vous êtes déjà enregistré, seul l'écran de connexion s'affiche, la première visite vous permet de voir le portail "enregistrement".

4. demander un "petit" modèle d'API gratuit

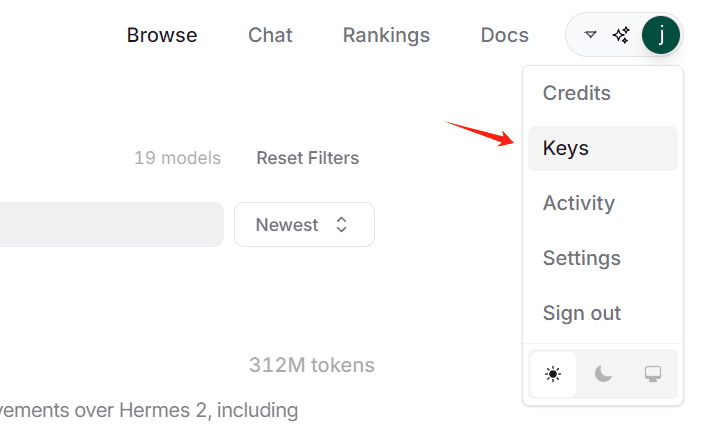

OpenRouter est recommandé et permet d'écrire des romans depuis un an en utilisant ses modèles gratuits. Voici une explication sur la façon d'obtenir les API de modèles d'OpenRouter

PS : Vendeurs de petits modèles d'API domestiques gratuits : Silicon Flow

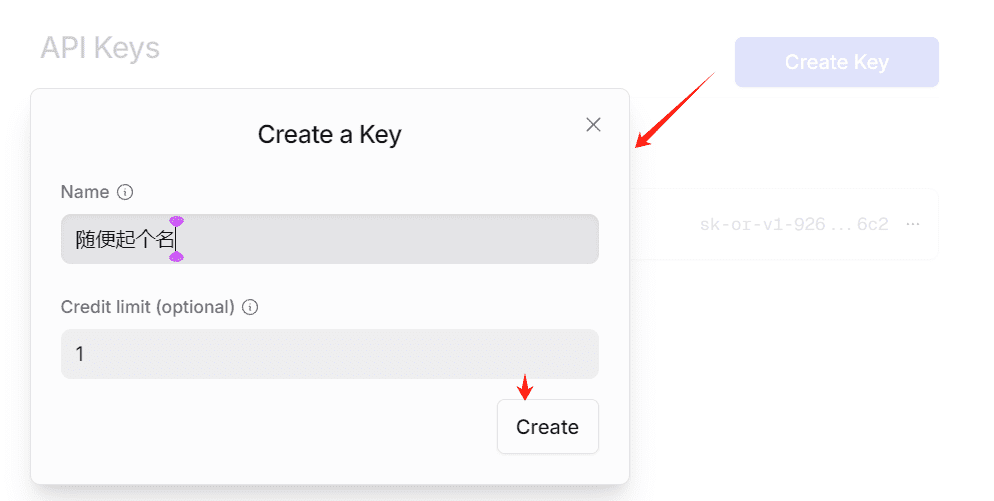

4.1 Création d'une clé

Vous obtiendrez une chaîne de caractères commençant par sk-, c'est la clé, veuillez la copier et la sauvegarder localement, vous ne pourrez pas la copier à nouveau après la fermeture de la page.

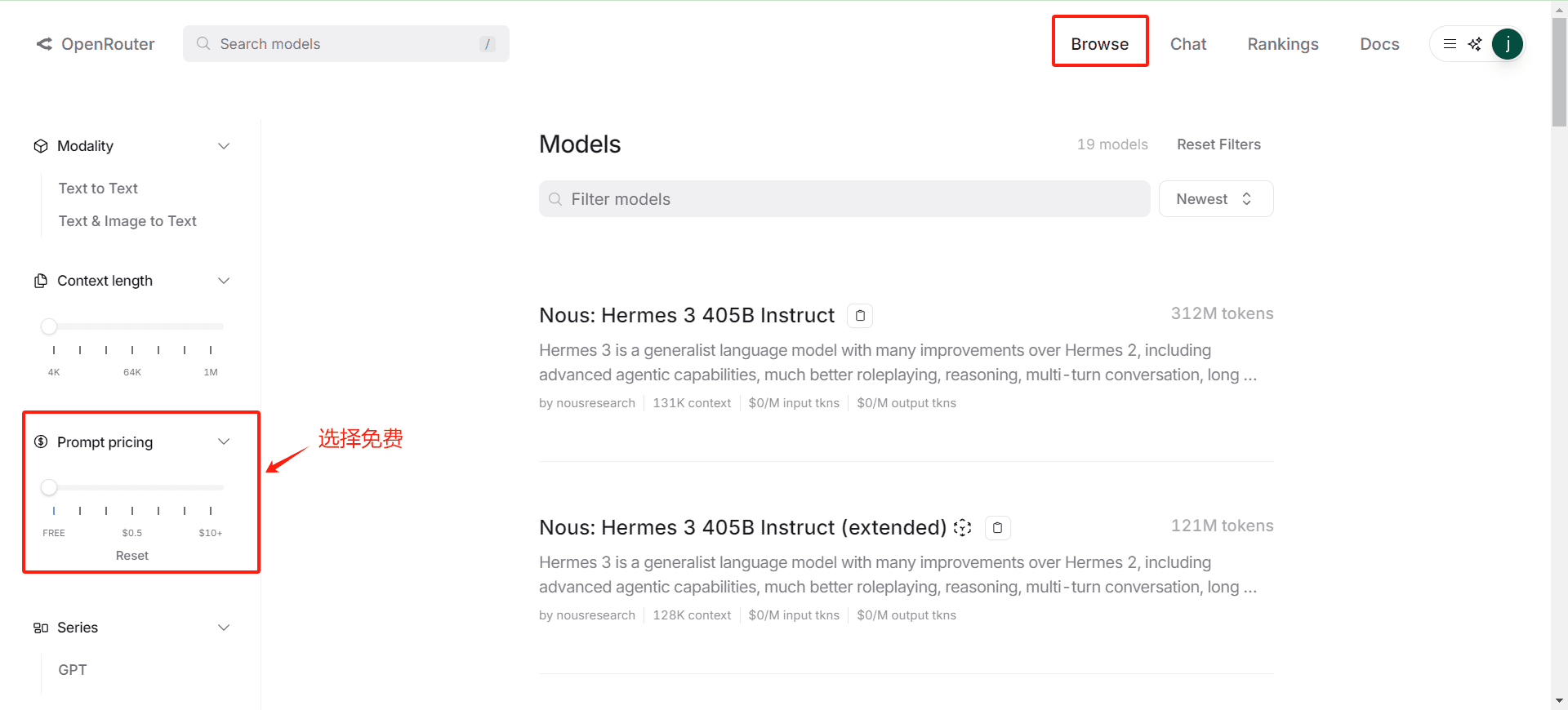

4.2 Confirmation de la liste des modèles libres

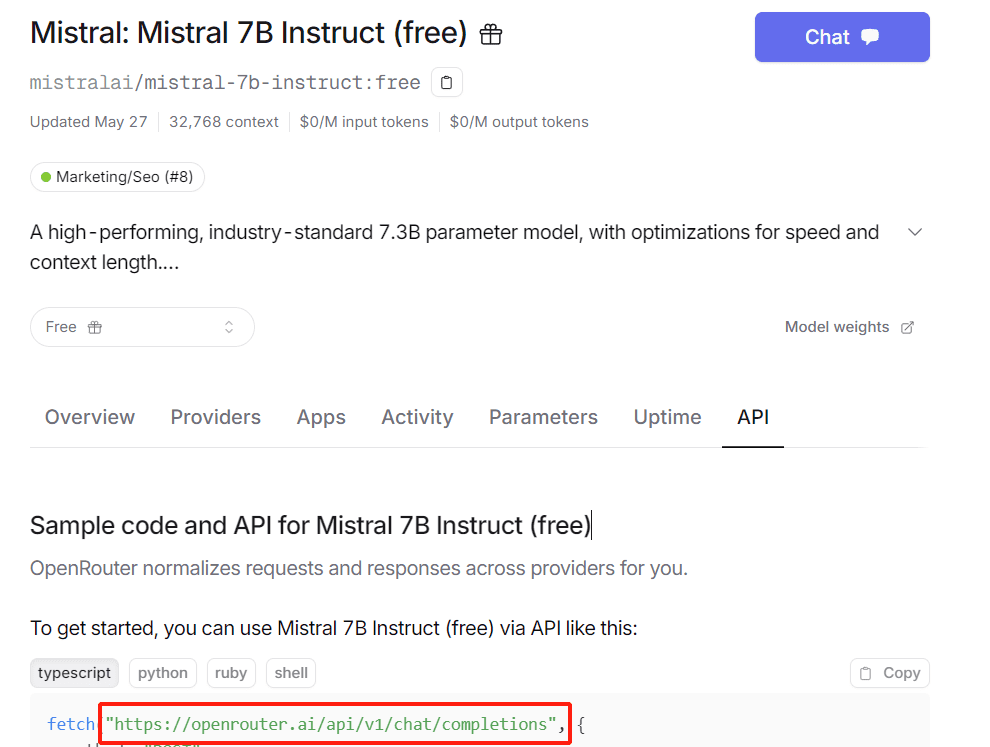

4.3 Obtention de l'URL de la requête API(math.) genre

Rendez-vous sur la page d'un modèle pour le voir, en général : https://openrouter.ai/api/v1/chat/completions

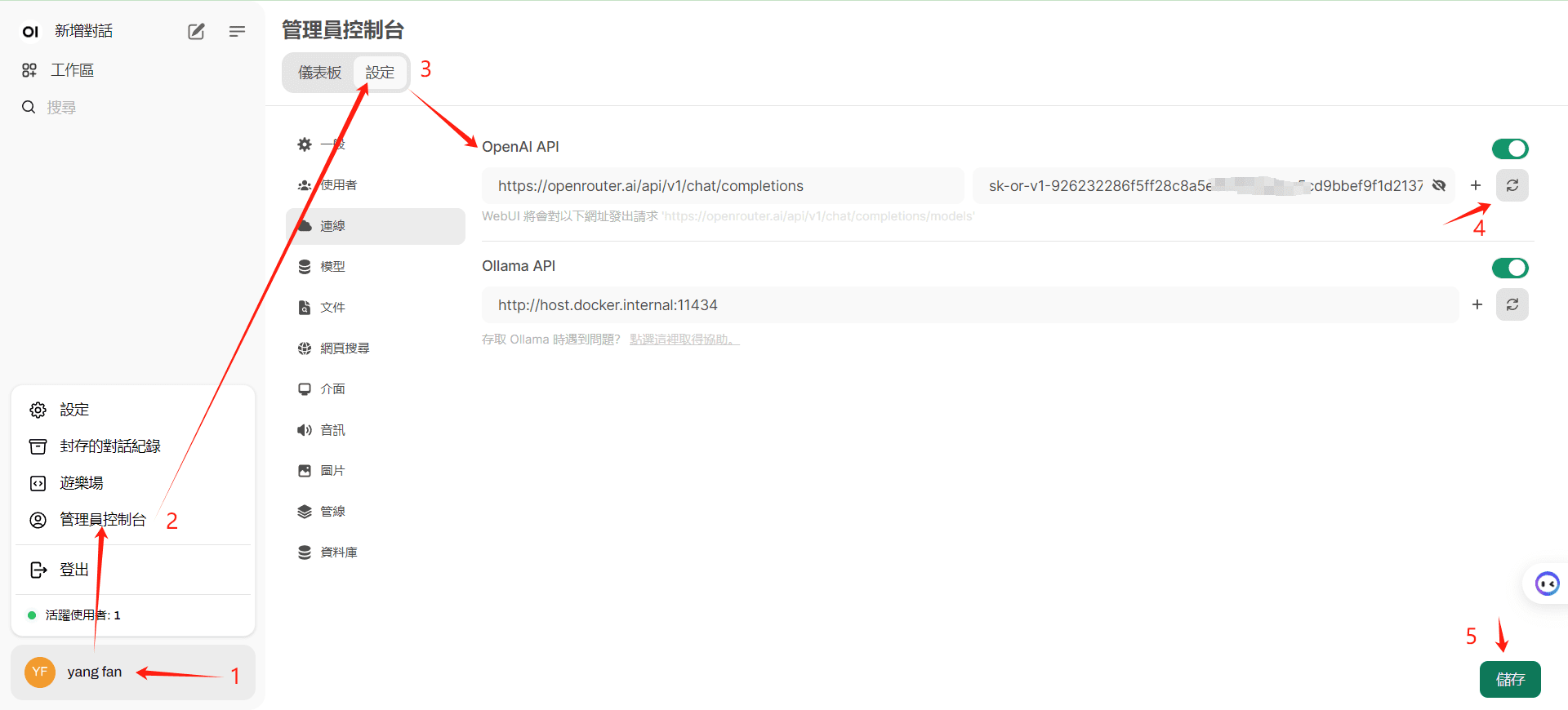

5. entrer dans le modèle de configuration de l'Open WebUI

Notez qu'en cliquant sur "4", vous confirmez que l'accès à l'interface s'est déroulé correctement avant de cliquer sur "Enregistrer".

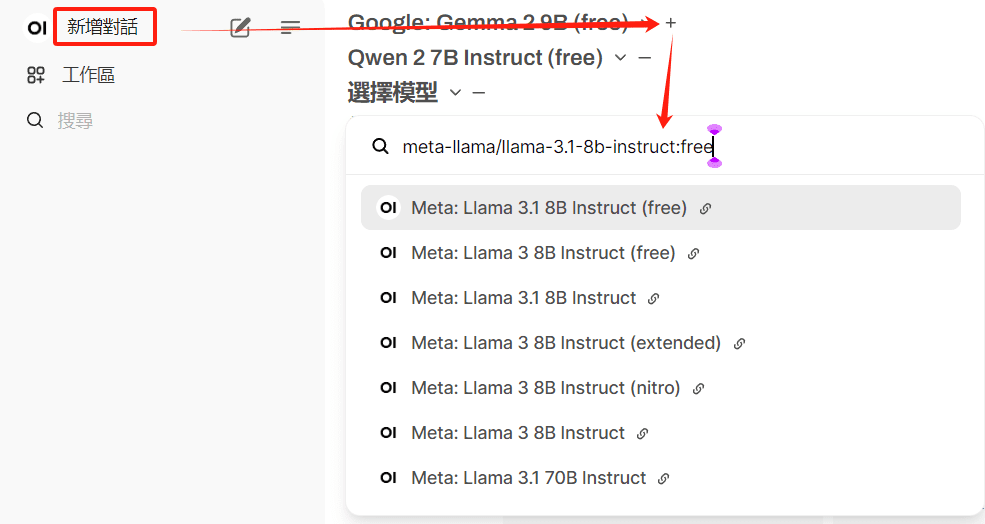

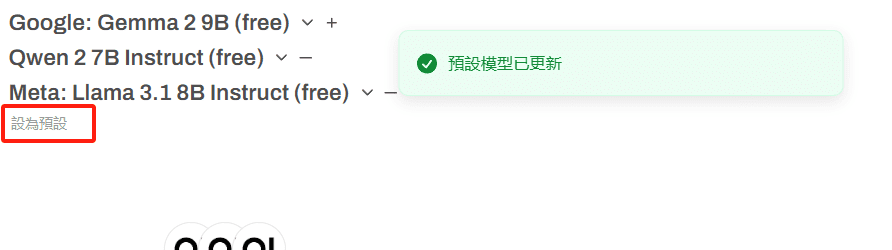

6. configurer le modèle par défaut

Plusieurs modèles gratuits peuvent être sélectionnés

L'utilisation de modèles payants entraînera la désactivation du compte.

Cliquez sur Presets pour enregistrer les modèles fréquemment utilisés

7) Tenter un premier dialogue

Option de déploiement optimal 2

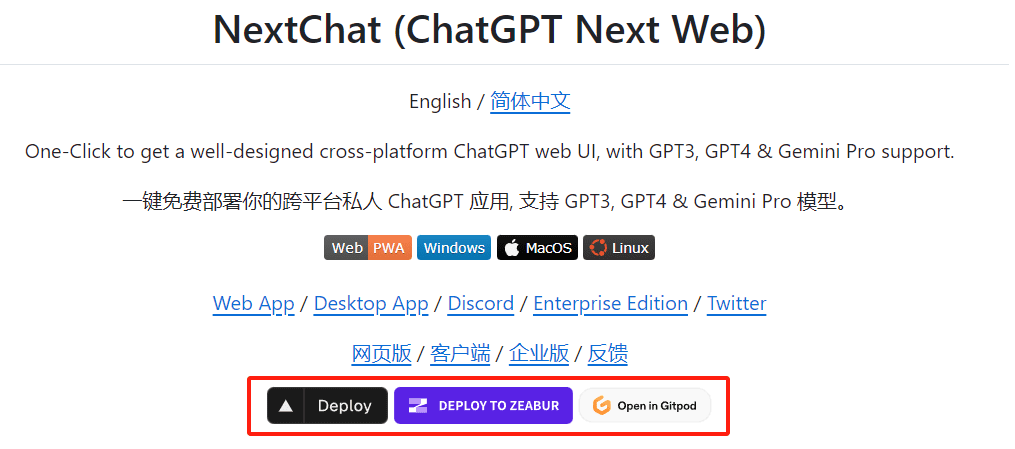

1. déploiement de NextChat dans le nuage

Déploiement gratuit en un clic, consultez l'aide par vous-même : https://github.com/ChatGPTNextWeb/ChatGPT-Next-Web

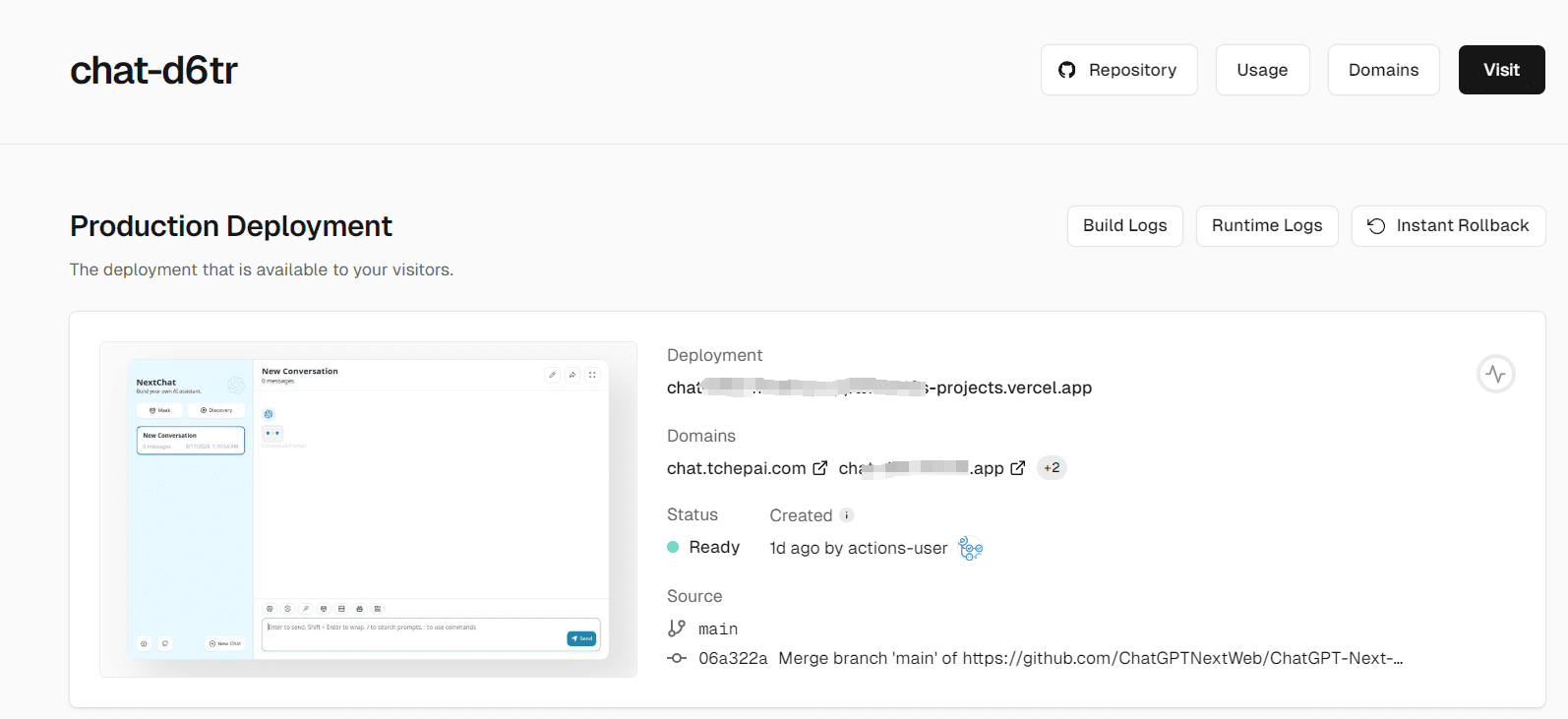

2. le premier déploiement Deploy (vercel) est utilisé ici.

Il suffit de suivre la procédure, et voici trois points à garder à l'esprit :

- Veillez à lire attentivement la documentation d'aide et à suivre le tutoriel pour configurer votre projet de manière à ce qu'il soit mis à jour automatiquement.

- Configurez la variable KEY et le mot de passe d'accès pendant le processus d'installation de vercel, il est recommandé de les configurer à l'avance.

- Lier son propre nom de domaine permet d'accéder directement aux réseaux nationaux.

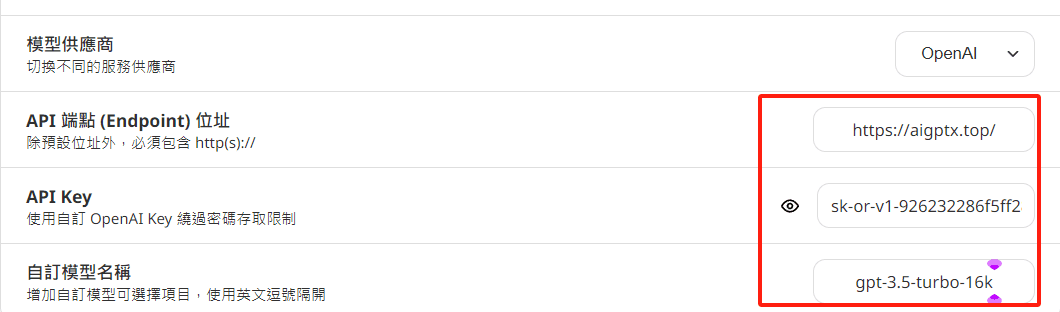

3. les variables de configuration

Ce n'est pas comme l'option 1 qui peut lire la liste de modèles automatiquement, vous devez définir votre propre liste de modèles, noter le changement d'adresse de l'interface.

BASE_URL ou OpenAI Endpoint : Définissez ceci à https://openrouter.ai/api

OPENAI_API_KEY ou Clé API OpenAI : Saisissez votre OpenRouter Clé API ici.

CUSTOM_MODELS ou Custom Models : Spécifiez le nom du modèle tel qu'il est listé dans OpenRouter.

4. écran d'achèvement du déploiement

5.Nom de domaine contraignant

Résoudre les problèmes d'accès dans le pays

4) Vous pouvez configurer la clé API d'un modèle séparément dans les paramètres.

Vous pouvez configurer unOhMyGPTUne petite quantité de crédits GPT4 gratuits par jour, une autre adresse pour un accès stable à l'API KEY (pour éviter les dissimulations abusives) :

Un autre projet de CLÉ d'API gratuite : https://github.com/chatanywhere/GPT_API_free

Adresse NextChat déployée (attention à ne pas saisir d'informations sensibles, la saisie de votre propre CLÉ API peut être utilisée) : https://chat.tchepai.com/

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...