Diffbot GraphRAG LLM : service de raisonnement LLM reposant sur des données externes de graphe de connaissances en temps réel

Introduction générale

Le serveur de raisonnement Diffbot LLM est un système innovant de modélisation linguistique à grande échelle avec des optimisations et des améliorations spéciales basées sur l'architecture du modèle LLama. La caractéristique la plus importante du projet est l'intégration deGraphique de connaissances en temps réel(Knowledge Graph) vs.Génération améliorée par la recherche(RAG) a été combinée pour créer le système unique GraphRAG. Ce système ne se contente pas d'extraire et de traiter des informations en ligne en temps réel, mais il permet également de citer des faits et d'extraire des connaissances avec précision. Le système fournit deux versions du modèle : un modèle à 8 paramètres basé sur Llama 3.1 (diffbot-small) et un modèle à 70 paramètres basé sur Llama 3.3 (diffbot-small-xl). Dans les benchmarks faisant autorité tels que MMLU-Pro, le système montre d'excellentes performances, en particulier dans le traitement des données en temps réel, surpassant les modèles classiques tels que GPT-4 et ChatGPT. Le projet est entièrement open source et prend en charge le déploiement local et les appels d'API dans le nuage, offrant ainsi aux développeurs une grande souplesse d'utilisation.

Expérience : https://diffy.chat/

Liste des fonctions

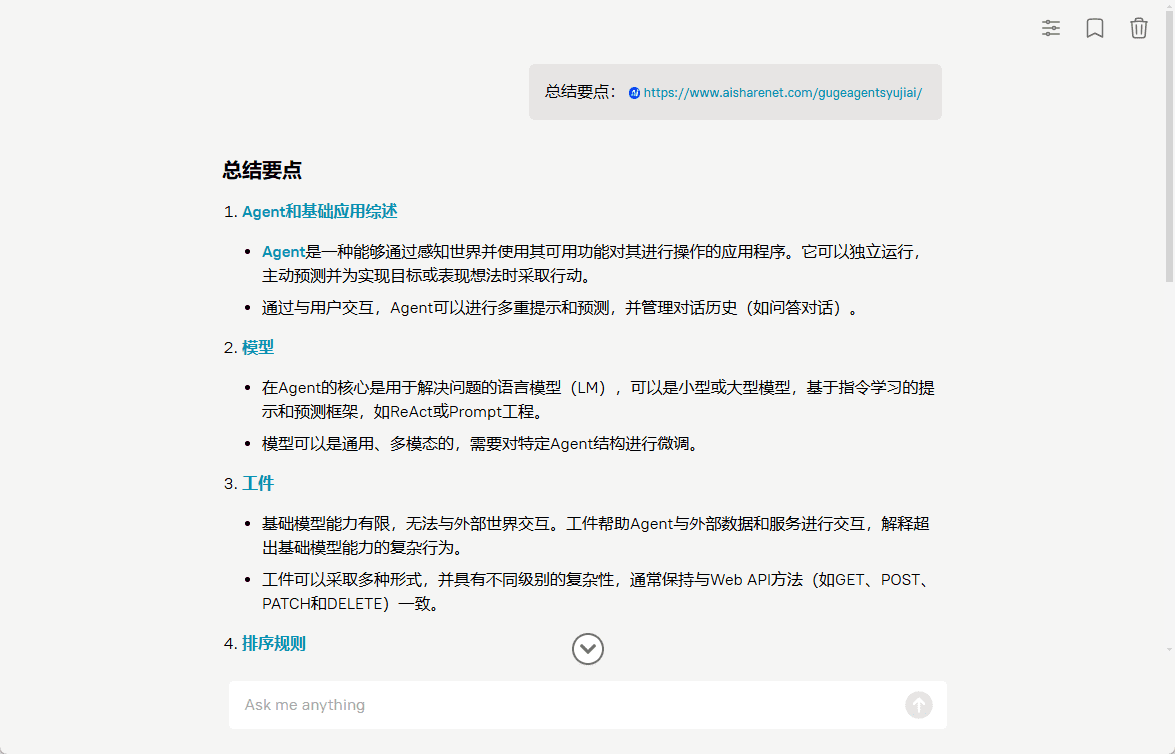

- Extraction et résumé du contenu de l'URL d'une page web en temps réel

- Recherche et citation de faits précis fondées sur les graphes de connaissances

- Prise en charge du langage d'interrogation des graphes de connaissances de Diffbot (DQL)

- Compréhension des images et compétences descriptives

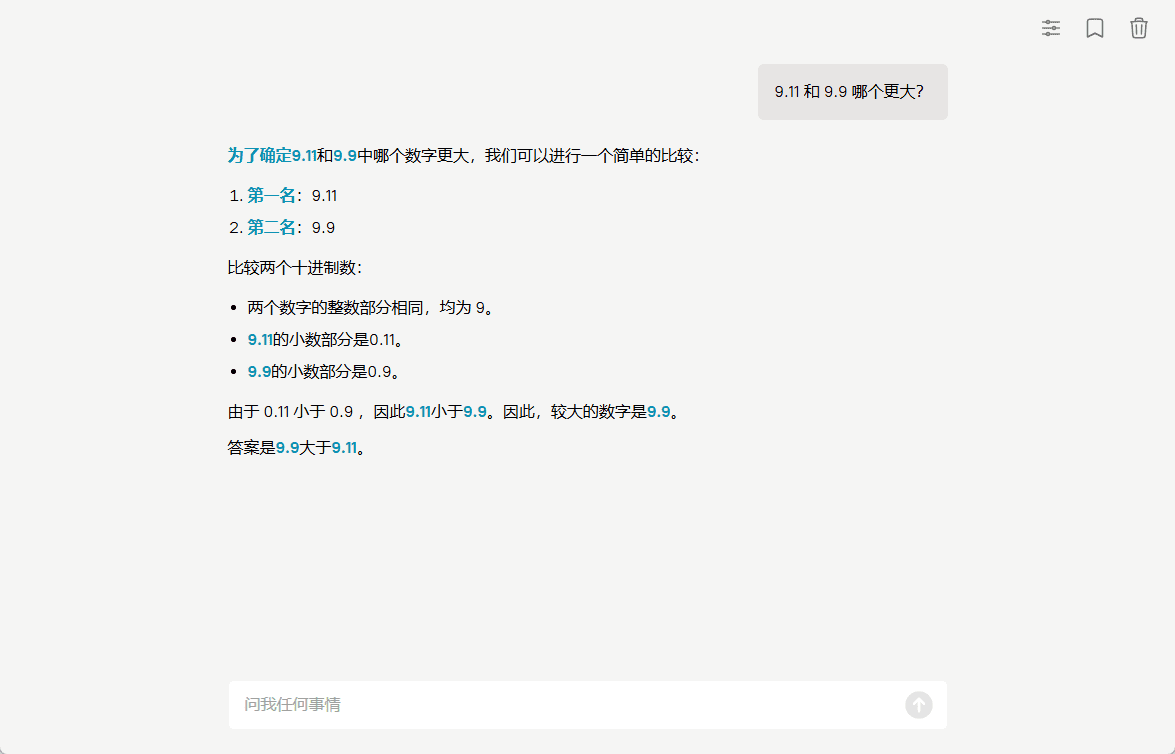

- Intégration des fonctions arithmétiques du code de l'interpréteur JavaScript

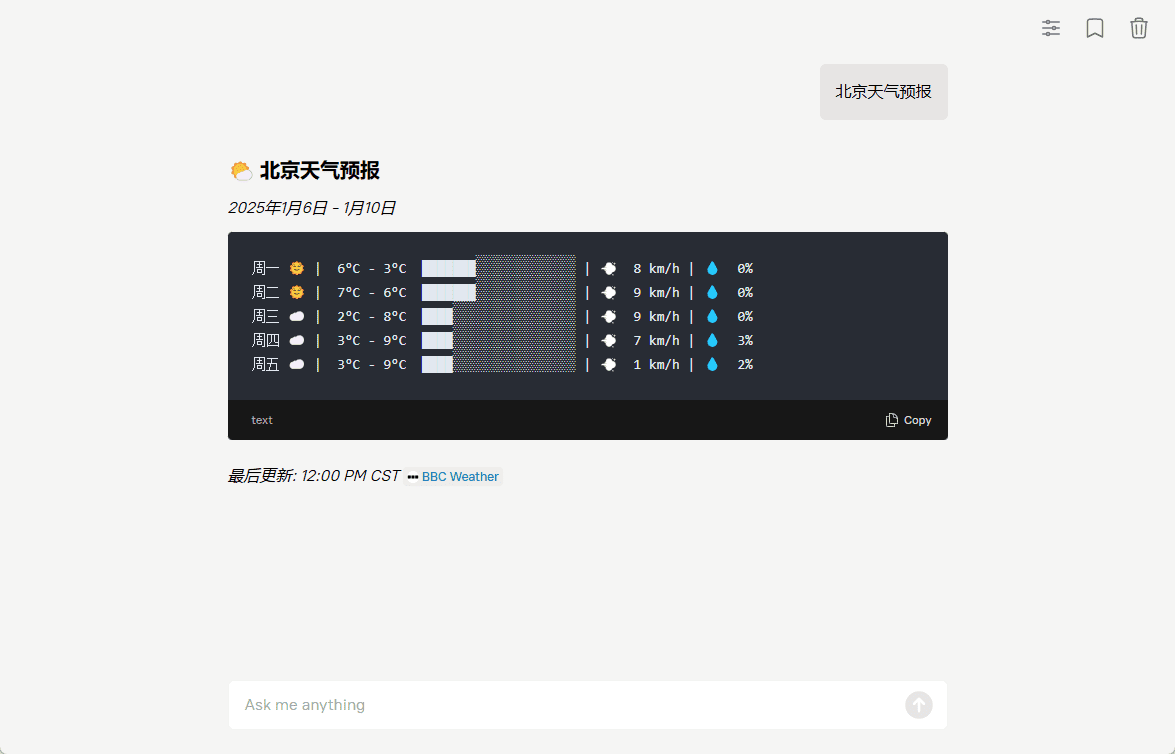

- Génération de prévisions météorologiques en ASCII Art

- Prise en charge du déploiement en conteneur Docker

- Fournir un service d'interface API REST

- Prise en charge des extensions d'outils personnalisés

- Prise en charge de plusieurs options de déploiement de la configuration matérielle

Utiliser l'aide

1. les options de déploiement

Le système propose deux façons de l'utiliser : le déploiement local et les appels d'API dans le nuage.

Processus de déploiement local :

- Configuration matérielle requise confirmée :

- Modèle diffbot-small : carte graphique Nvidia A100 40G minimum requise

- Modèle diffbot-small-xl : au moins 2 cartes graphiques Nvidia H100 80G requises (format FP8)

- Étapes du déploiement de Docker :

# 1. 拉取Docker镜像

docker pull docker.io/diffbot/diffbot-llm-inference:latest

# 2. 运行Docker容器(模型会自动从HuggingFace下载)

docker run --runtime nvidia --gpus all -p 8001:8001 --ipc=host \

-e VLLM_OPTIONS="--model diffbot/Llama-3.1-Diffbot-Small-2412 --served-model-name diffbot-small --enable-prefix-caching" \

docker.io/diffbot/diffbot-llm-inference:latest

Appels à l'API du nuage :

- Obtenir les identifiants d'accès :

- Visitez https://app.diffbot.com/get-started pour vous inscrire et obtenir votre jeton de développeur gratuit !

- Exemple de code Python :

from openai import OpenAI

client = OpenAI(

base_url = "https://llm.diffbot.com/rag/v1",

api_key = "你的diffbot_token"

)

# 创建对话请求

completion = client.chat.completions.create(

model="diffbot-xl-small",

temperature=0,

messages=[

{

"role": "user",

"content": "你的问题"

}

]

)

print(completion)

2. description de l'utilisation des fonctions essentielles

- Extraction du contenu des pages web :

- Le système peut traiter n'importe quelle URL en temps réel.

- Extraire automatiquement les informations clés et générer des résumés

- Maintien de l'intégrité de la citation de la source originale

- Requête de graphe de connaissances :

- Recherche de précision avec Diffbot Query Language (DQL)

- Prise en charge des requêtes complexes sur les relations entre les connaissances

- Accès à la base de connaissances avec mises à jour en temps réel

- Capacités de traitement d'images :

- Aide à la compréhension et à la description des images

- Peut être combiné avec du texte pour générer des analyses d'images pertinentes.

- Fonction d'interprétation du code :

- Interprète JavaScript intégré

- Prise en charge des calculs mathématiques en temps réel

- La logique d'un programme simple peut être traitée

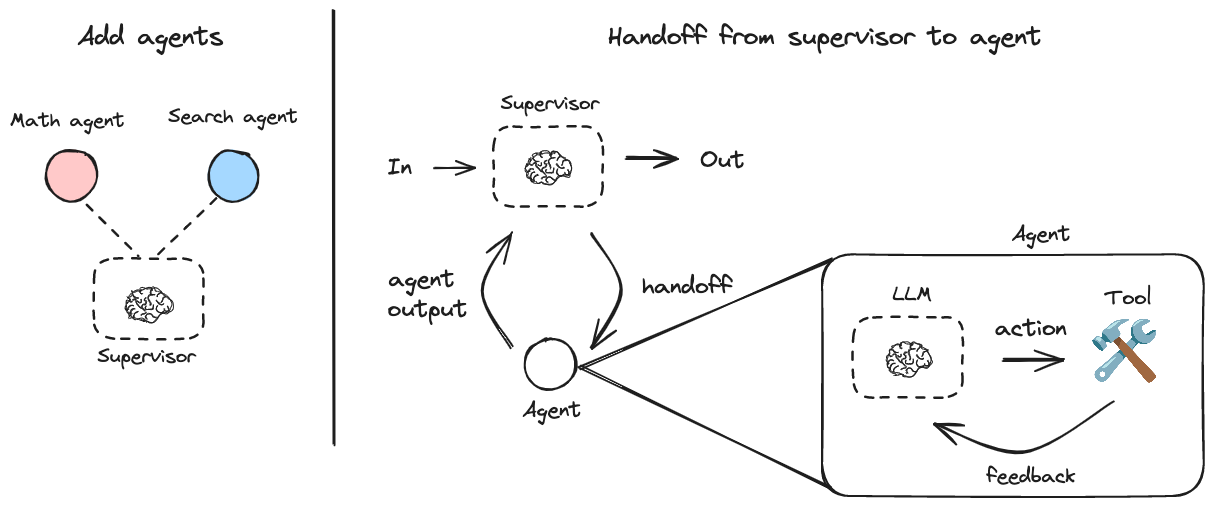

3. extensions d'outils personnalisés

Pour étendre la nouvelle fonctionnalité, reportez-vous au document add_tool_to_diffbot_llm_inference.md dans le projet et suivez les étapes pour ajouter un outil personnalisé.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...