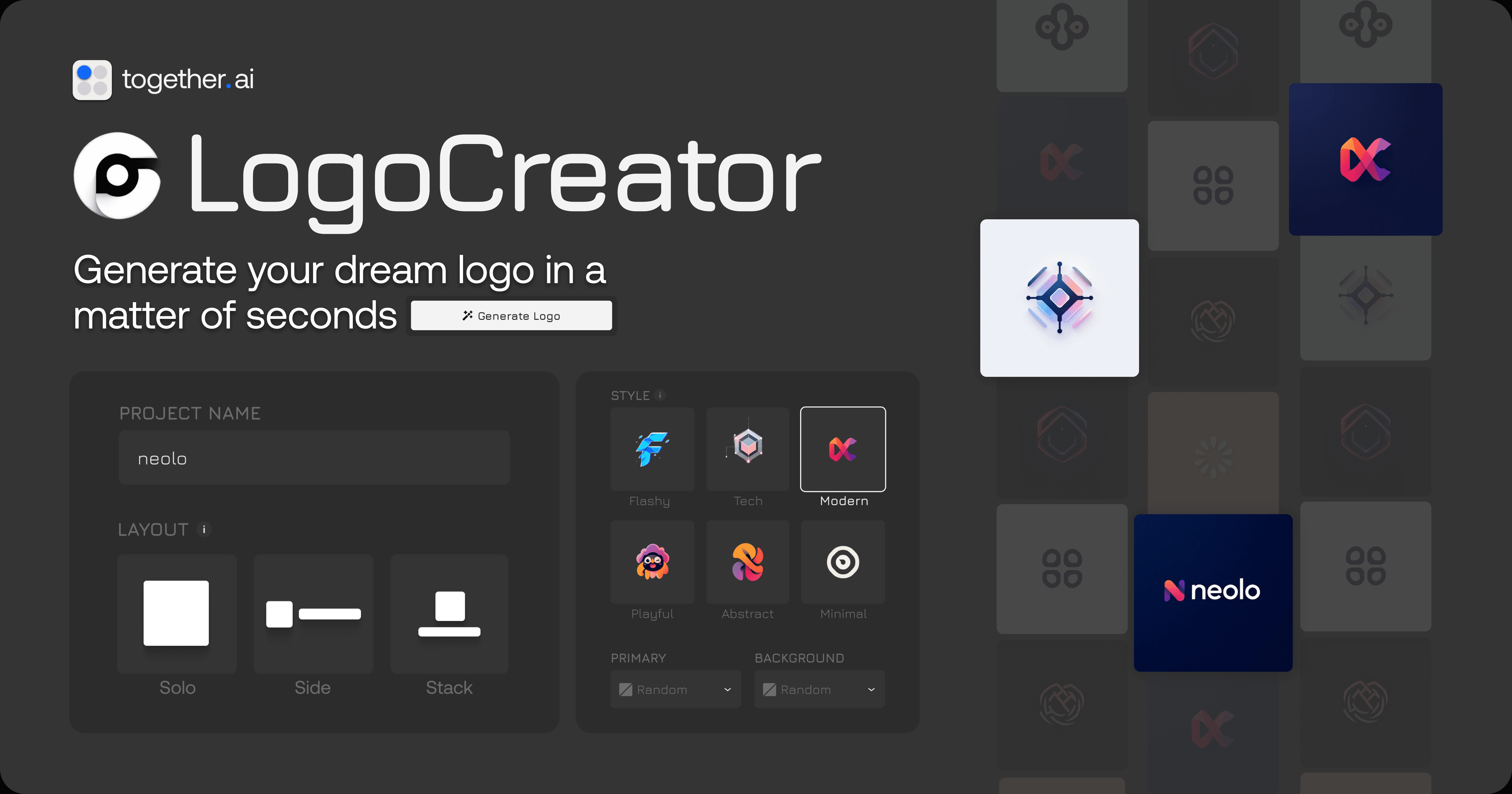

DeepSeek-R1 WebGPU : Exécutez DeepSeek R1 1.5B localement dans votre navigateur !

Introduction générale

Profondeur de l'eau-R1 WebGPU est un modèle d'inférence d'IA de pointe fourni par webml-community sur la plateforme Hugging Face Spaces, qui utilise la technologie WebGPU pour permettre aux utilisateurs d'exécuter des modèles d'IA complexes directement dans le navigateur. Le modèle est basé sur DeepSeek-R1 et est conçu pour des tâches d'inférence, fournissant des capacités de traitement d'IA efficaces et localisées. Les utilisateurs n'ont pas besoin d'installer de logiciel supplémentaire, mais seulement de la prise en charge du WebGPU dans leur navigateur pour bénéficier de fonctions d'IA avancées telles que le raisonnement mathématique, la génération de code et la réponse aux questions, ce qui en fait un outil idéal pour l'éducation, la recherche et les développeurs.

Le bien-être :Déploiement en ligne du modèle open-source DeepSeek-R1 avec une puissance GPU gratuite(API)

Liste des fonctions

- Exécution de modèles d'IA dans le navigateur: Aucun téléchargement n'est nécessaire, il suffit de disposer d'un navigateur moderne.

- Prise en charge de l'accélération WebGPULes GPU : Utiliser les GPU pour des calculs efficaces et des performances accrues.

- Raisonnement multitâche de l'IALes tâches mathématiques, la génération de codes et la compréhension de textes complexes font partie des tâches à accomplir.

- Interface de discussion interactiveLes utilisateurs peuvent interagir avec le modèle directement à partir de l'interface.

- Aucune inscription n'est requiseLes avantages de ce système sont les suivants : prêt à l'emploi et expérience simplifiée pour l'utilisateur.

Utiliser l'aide

Comment utiliser le WebGPU DeepSeek-R1

Vérification de la compatibilité et préparation :

Tout d'abord, assurez-vous que votre navigateur prend en charge le WebGPU. Actuellement, Google Chrome (version 88 et supérieure) est le navigateur le plus couramment utilisé qui prend en charge le WebGPU. Vous pouvez le confirmer en visitant la fonctionnalité expérimentale de Chrome (chrome://flags/) et en activant WebGPU.

Visitez le site web :

- Ouvrez votre navigateur et accédez àEspaces de câlins.

- Une fois la page chargée, vous êtes confronté à une interface utilisateur épurée contenant une zone de saisie et une zone de sortie.

Raisonner avec des modèles :

- Saisir une question ou une tâcheLe modèle peut être utilisé pour des problèmes de mathématiques, de génération de code de programmation ou de toute autre tâche nécessitant un raisonnement textuel. Il peut s'agir d'un problème mathématique, de la génération d'un code de programmation ou de toute autre tâche nécessitant un raisonnement textuel.

- Exemple d'entrée :

计算1000阶乘的最后一位数字peut-être编写一个Python函数来计算斐波那契数列.

- Exemple d'entrée :

- Soumission des mandatsCliquez sur le bouton "Envoyer" ou appuyez sur la touche "Entrée" pour soumettre vos données. Le modèle commencera à traiter votre demande, ce qui peut prendre quelques secondes en fonction de la complexité de la tâche.

- Voir les résultatsLes résultats sont affichés dans la zone de sortie. Le modèle fournira des étapes détaillées ou des résultats directs, en fonction de la nature de la tâche.

Optimiser l'expérience :

- Ajustement des paramètres du modèleL'interface actuelle est relativement simple, mais elle pourrait à l'avenir offrir des options de réglage des paramètres, telles que la température (pour contrôler le caractère aléatoire du texte généré) ou la longueur maximale de la réponse.

- Essayez encore et encoreSi vous n'êtes pas satisfait des résultats, vous pouvez adapter les questions ou essayer d'autres façons de vous exprimer.

FAQ :

- Que se passe-t-il si mon navigateur ne prend pas en charge le WebGPU ? - Il est recommandé de mettre à jour votre navigateur ou d'utiliser un navigateur compatible WebGPU tel que la dernière version de Chrome.

- La réponse du modèle est trop lente ? - Assurez-vous que vous disposez d'une bonne connexion internet et que les paramètres GPU de votre navigateur ne sont pas désactivés.

Mises en garde :

- Comme le modèle fonctionne dans le navigateur, la qualité et la vitesse de sortie peuvent être affectées par les performances de l'appareil et les conditions du réseau.

- Veuillez noter que l'utilisation de tout modèle d'IA en ligne est soumise à ses conditions d'utilisation et à sa politique de confidentialité.

Tutoriel de déploiement du WebGPU DeepSeek-R1

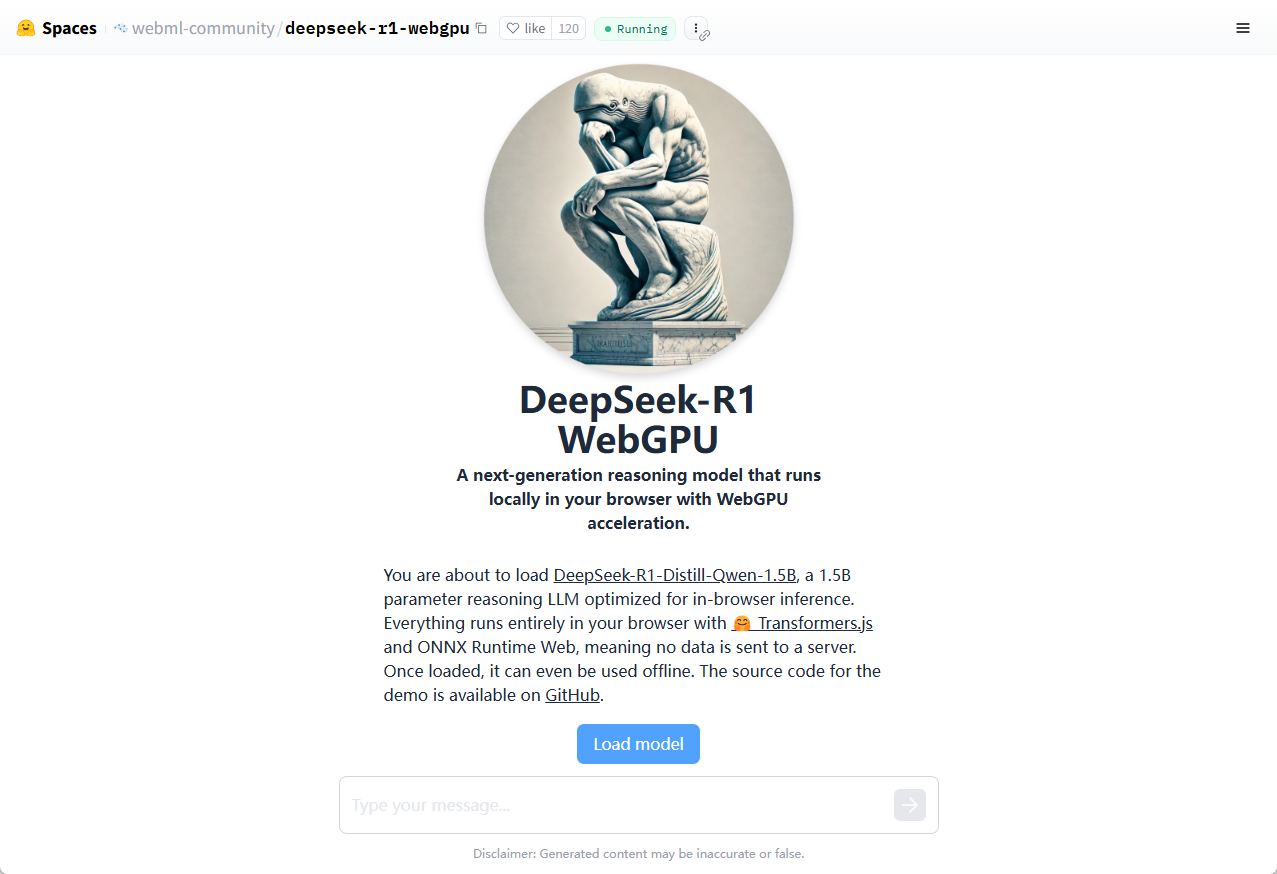

DeepSeek La WebGPU R1 est une unité de traitement basée sur le principe du "Hugging Face". Transformers.js Le DeepSeek R1 WebGPU est un exemple de modèle d'apprentissage profond conçu pour montrer comment exécuter efficacement des modèles d'apprentissage profond dans le navigateur. Le projet s'appuie sur la technologie WebGPU pour permettre une inférence de modèle significativement plus rapide, jusqu'à 100 fois plus rapide que WASM. Les WebGPU DeepSeek R1 sont principalement utilisés pour des tâches de traitement du langage naturel, et prennent en charge une large gamme de modèles pré-entraînés qui peuvent être exécutés directement dans le navigateur sans serveur.

Pour commencer

Suivez les étapes ci-dessous pour configurer et exécuter l'application.

- Clonage des dépôts

Clonez le dépôt d'exemple à partir de GitHub :

git clone https://github.com/huggingface/transformers.js-examples.git

- Aller dans le répertoire du projet

Changez le répertoire de travail pour le dossier deepseek-r1-webgpu :

cd transformers.js-examples/deepseek-r1-webgpu

- Installation des dépendances

Utilisez npm pour installer les dépendances nécessaires :

npm i

- Exécution du serveur de développement

Démarrer le serveur de développement :

npm run dev

L'application doit maintenant fonctionner localement. Ouvrez votre navigateur et visitez http://localhost:5173 Faire une vue d'ensemble.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...