Deep Searcher : extraction efficace de documents privés d'entreprise et questions-réponses intelligentes

Introduction générale

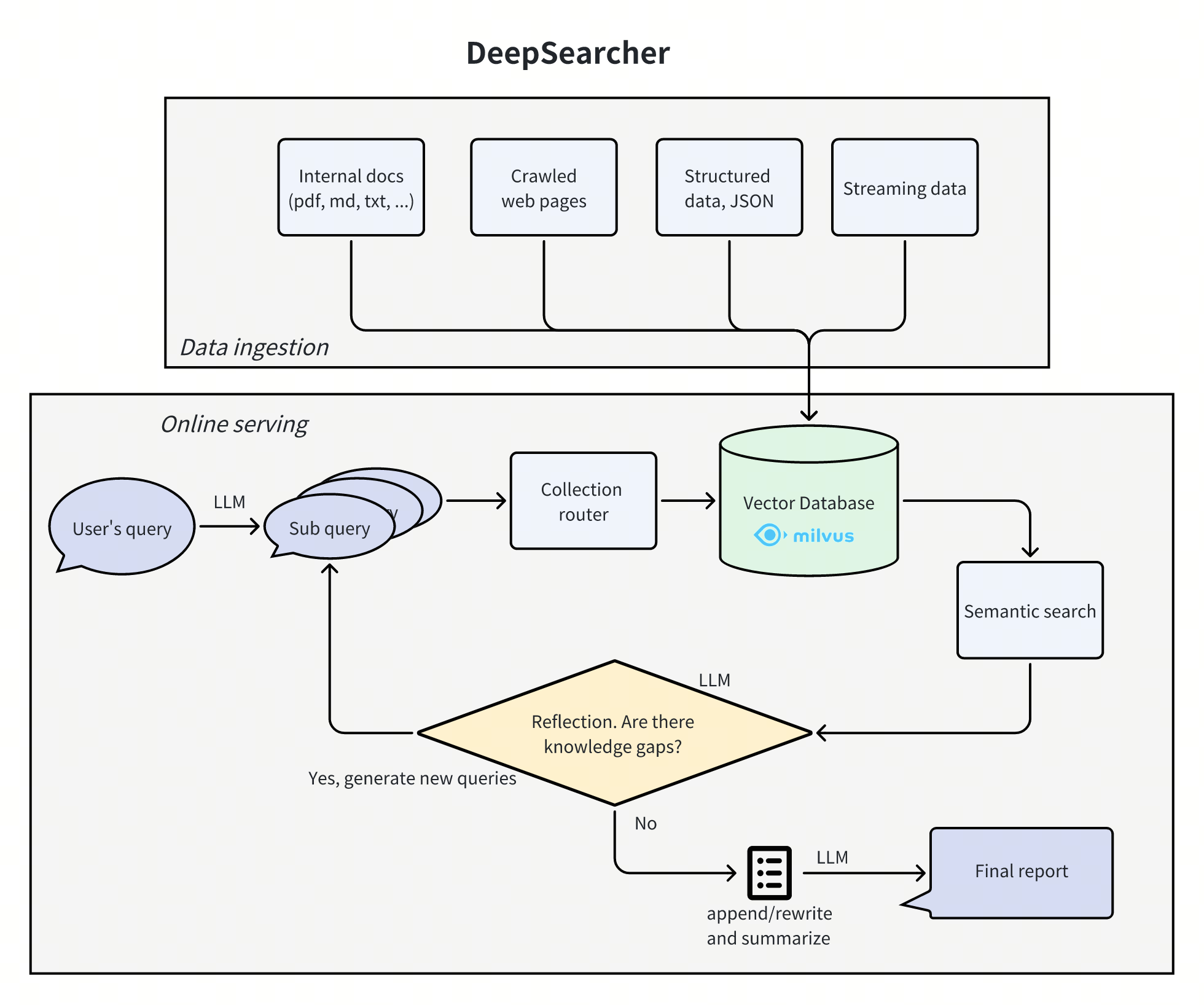

Deep Searcher est une combinaison de puissants modèles linguistiques de grande taille (tels que le DeepSeek et OpenAI) et les bases de données vectorielles (par exemple Milvus) sont des outils conçus pour rechercher, évaluer et raisonner sur la base de données privées, en fournissant des réponses très précises et des rapports complets. Deep Searcher prend en charge un large éventail de modèles d'intégration et de grands modèles de langage, et est capable de gérer des bases de données vectorielles pour garantir une recherche efficace et une utilisation sécurisée des données.

Liste des fonctions

- Recherche de données privéesLes données sont utilisées de manière optimale au sein de l'entreprise et la sécurité des données est garantie.

- Gestion des bases de données vectoriellesLe système de gestion des données vectorielles : il prend en charge les bases de données vectorielles telles que Milvus, ce qui permet de partitionner les données pour une recherche plus efficace.

- Options d'intégration flexiblesLes modèles d'encastrement sont compatibles avec une large gamme de modèles d'encastrement, ce qui facilite le choix de la meilleure option.

- Prise en charge des modèles multilinguesPrise en charge de grands modèles tels que DeepSeek, OpenAI, etc. pour des questions-réponses intelligentes et la génération de contenu.

- Chargeur de documentsLe chargement de fichiers locaux est pris en charge et l'exploration du web sera ajoutée à l'avenir.

Utiliser l'aide

Processus d'installation

- Entrepôt de clonage :

git clone https://github.com/zilliztech/deep-searcher.git

- Créer un environnement virtuel Python (recommandé) :

python3 -m venv .venv

source .venv/bin/activate

- Installer la dépendance :

cd deep-searcher

pip install -e .

- Configuration de LLM ou Milvus : Editer

examples/example1.pypour configurer LLM ou Milvus selon les besoins. - Préparez les données et exécutez l'exemple :

python examples/example1.py

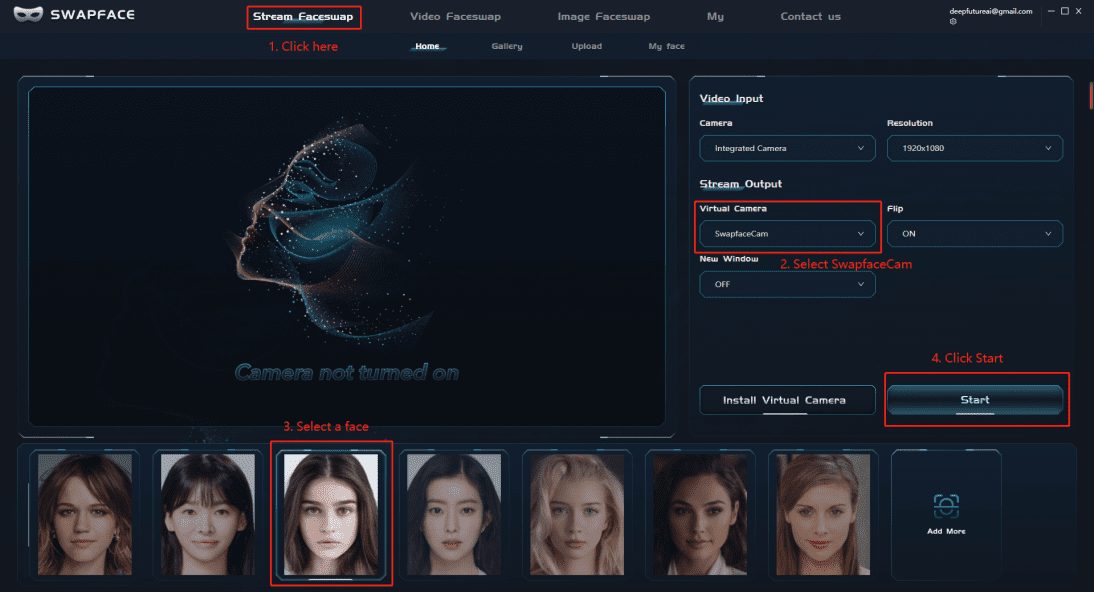

Mode d'emploi

- Configuration du LLM: En

deepsearcher.configurationutiliser le moduleset_provider_configMéthodes pour configurer le LLM. par exemple, configurer un modèle OpenAI :

config.set_provider_config("llm", "OpenAI", {"model": "gpt-4o"})

- Charger les données locales: Utilisation

deepsearcher.offline_loadingdans le moduleload_from_local_filespour charger les données locales :

load_from_local_files(paths_or_directory="your_local_path")

- Interroger les données: Utilisation

deepsearcher.online_querydans le modulequeryLes méthodes sont interrogées :

result = query("Write a report about xxx.")

Fonction détaillée du déroulement des opérations

- Recherche de données privées: :

- Maximisez l'utilisation des données au sein de votre entreprise tout en garantissant la sécurité des données.

- Le contenu en ligne peut être intégré lorsque des réponses plus précises sont nécessaires.

- Gestion des bases de données vectorielles: :

- Prend en charge les bases de données vectorielles telles que Milvus, ce qui permet de partitionner les données pour une recherche plus efficace.

- La prise en charge d'autres bases de données vectorielles (par exemple FAISS) est prévue pour l'avenir.

- Options d'intégration flexibles: :

- Compatible avec une large gamme de modèles embarqués pour une sélection aisée de la meilleure solution.

- Prise en charge des modèles multilingues: :

- Prise en charge de grands modèles tels que DeepSeek, OpenAI, etc. pour des questions-réponses intelligentes et la génération de contenu.

- Chargeur de documents: :

- Le chargement de fichiers locaux est pris en charge et l'exploration du web sera ajoutée à l'avenir.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...