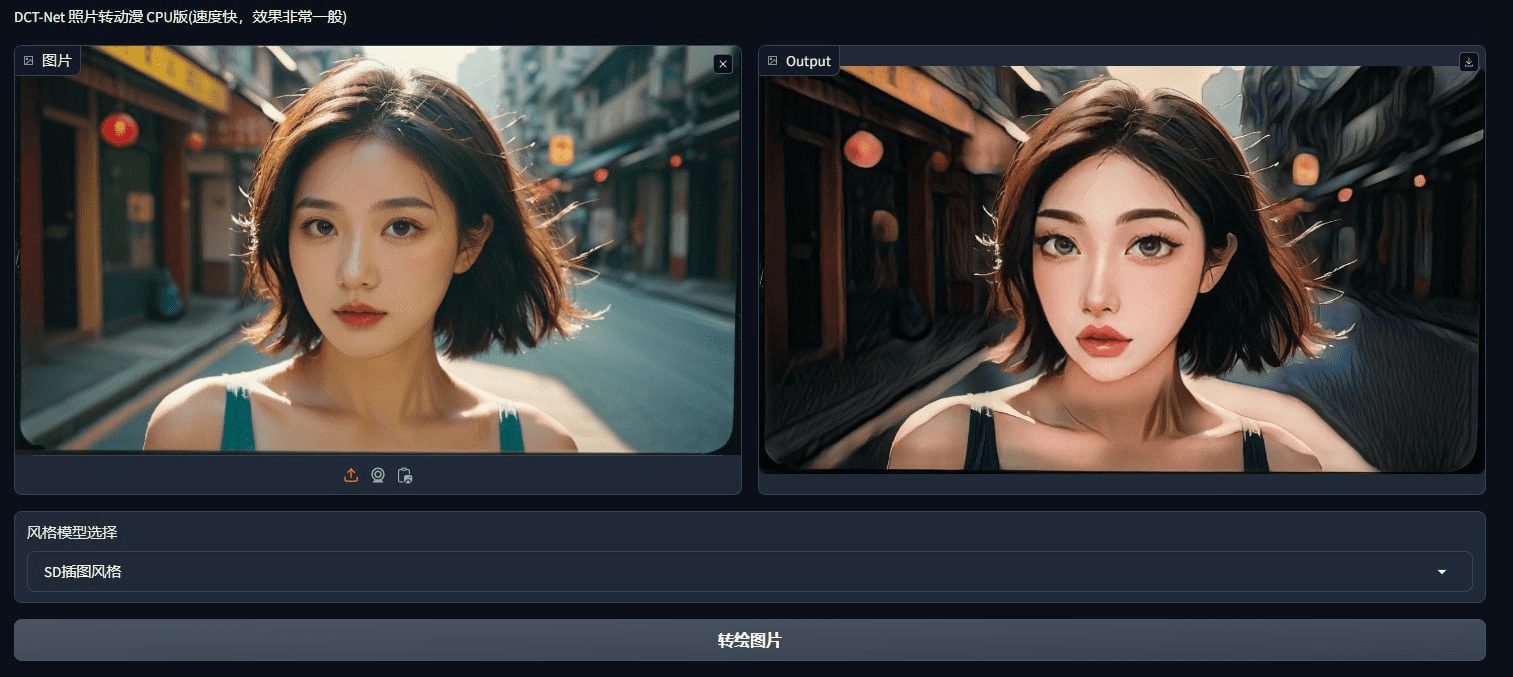

DCT-Net : un outil open source pour transposer des photos et des vidéos en animes stylisés

Introduction générale

DCT-Net est un projet open-source développé par l'Académie DAMO et l'Institut de technologie informatique Wang Xuan de l'Université de Pékin, visant à réaliser une conversion stylisée des images pour l'animation. Le projet utilise des techniques d'apprentissage profond pour convertir de manière transparente des photos naturelles en différents styles artistiques, tels que l'animation, la 3D, la peinture à la main, les croquis, etc. en utilisant la traduction calibrée par domaine. ainsi qu'aux industries du film et du jeu.

Liste des fonctions

- Fournit une large gamme de modèles pré-entraînés couvrant un large éventail de styles artistiques

- Prise en charge de la formation avec des données de style personnalisées

- Essai en ligne, aucune configuration de l'environnement local n'est requise

- Performance efficace, supportant à la fois les environnements CPU et GPU

- Conversion de style pour les images et les vidéos

Utiliser l'aide

Installation et configuration

- Installation des dépendancesLes informations suivantes sont disponibles : Vous devez tout d'abord installer le logiciel de gestion de l'information de l'entreprise

modelscopequi peut être installée à l'aide de la commande suivante :pip install "modelscope[cv]" -f https://modelscope.oss-cn-beijing.aliyuncs.com/releases/repo.html - Télécharger le modèle pré-entraînéLe modèle télécharge automatiquement le fichier de pré-entraînement lors de la première exécution du code.

Conversion des styles d'images

- Définir le modèleDéfinir cinq types de styles de visage à convertir par le modèle DCT-Net :

model_dict = { "anime": "damo/cv_unet_person-image-cartoon_compound-models", "3d": "damo/cv_unet_person-image-cartoon-3d_compound-models", "handdrawn": "damo/cv_unet_person-image-cartoon-handdrawn_compound-models", "sketch": "damo/cv_unet_person-image-cartoon-sketch_compound-models", "art": "damo/cv_unet_person-image-cartoon-artstyle_compound-models" } - Charger des images et les convertir: :

import os import cv2 from IPython.display import Image, display, clear_output from modelscope.pipelines import pipeline from modelscope.utils.constant import Tasks from modelscope.outputs import OutputKeys style = "anime" # 可选 "anime", "3d", "handdrawn", "sketch", "art" filename = "4.jpg" img_path = 'picture/' + filename img_anime = pipeline(Tasks.image_portrait_stylization, model=model_dict["anime"]) result = img_anime(img_path) save_name = 'picture/images/' + os.path.splitext(filename)[0] + '_' + style + '.jpg' cv2.imwrite(save_name, result[OutputKeys.OUTPUT_IMG]) clear_output() display(Image(save_name))

Conversion du style vidéo

- Extraire des images vidéo: :

video = 'sample_video.mp4' video_file = 'movie/' + video image_dir = 'movie/images/' vc = cv2.VideoCapture(video_file) i = 0 if vc.isOpened(): rval, frame = vc.read() while rval: cv2.imwrite(image_dir + str(i) + '.jpg', frame) i += 1 rval, frame = vc.read() vc.release() - Conversion des images vidéoStyle : Stylez chaque image en utilisant la même méthode que pour la conversion d'image, puis fusionnez les images converties en une vidéo.

Téléchargement de l'installateur en un clic

Lite (version CPU, seul le style manga est conservé)

https://drive.uc.cn/s/eab2a6fad2dd4 Mot de passe : XTQi

Version complète :

téléchargement thunderboltTéléchargement QuarkTéléchargement Baidu (6666)

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...