Mistral AI lance les modèles Codestral 25.01 : des modèles spécifiques à la programmation plus grands, plus rapides et plus puissants.

Le code à la vitesse de la touche Tab. Aujourd'hui en Continuer.dev et sera bientôt disponible sur d'autres assistants de code IA de premier plan.

De toutes les innovations en matière d'IA au cours de l'année écoulée, la génération de code a sans doute été la plus importante. À l'instar des chaînes de montage qui ont simplifié la fabrication et des calculatrices qui ont transformé les mathématiques, les modèles de codage représentent un changement important dans le développement des logiciels.

Mistral AI a été à l'avant-garde de ce changement avec le lancement de Codestral, un modèle de codage de pointe (SOTA) publié plus tôt cette année. léger, rapide et compétent dans plus de 80 langages de programmation, Codestral est optimisé pour les cas d'utilisation à faible latence et à haute fréquence et prend en charge des tâches telles que le Fill-in-the-Middle (FIM), la correction de code et la génération de tests. codestral Codestral a été utilisé par des milliers de développeurs comme un puissant assistant de codage, augmentant souvent la productivité plusieurs fois. Aujourd'hui, Codestral fait l'objet d'une mise à jour majeure.

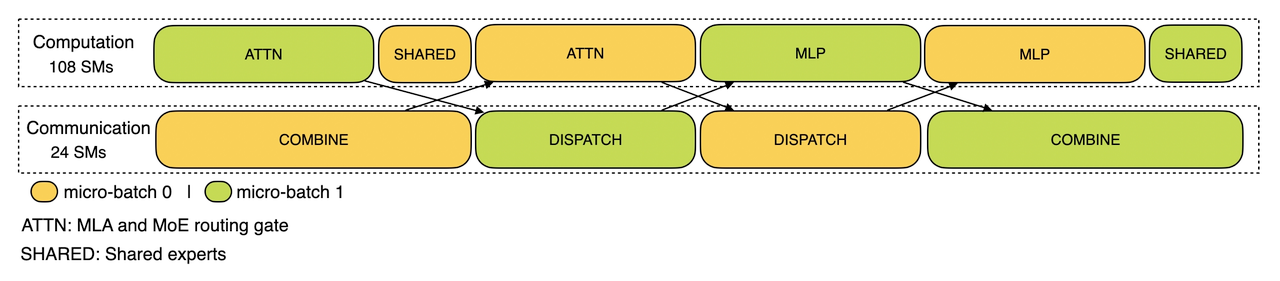

Codestral 25.01 Grâce à une architecture plus efficace et à un tokeniser amélioré par rapport à la version originale, le code est généré et complété environ deux fois plus vite. Le modèle est désormais le leader incontesté de l'écriture de code dans sa catégorie de poids et est SOTA dans tous les cas d'utilisation de la FIM.

l'étalonnage des performances

Nous avons évalué le nouveau Codestral en utilisant le principal modèle de codage avec des paramètres inférieurs à 100B, qui est largement considéré comme le meilleur pour la tâche FIM.

esquissée

| Python | SQL | Moyennes multilingues | |||

|---|---|---|---|---|---|

| modélisation | Longueur du contexte | HumanEval | MBPP | CruxEval | LiveCodeBench |

| Codestral-2501 | 256k | 86.6% | 80.2% | 55.5% | 37.9% |

| Codestral-2405 22B | 32k | 81.1% | 78.2% | 51.3% | 31.5% |

| Codellama 70B instruire | 4k | 67.1% | 70.8% | 47.3% | 20.0% |

| DeepSeek Coder 33B instruire | 16k | 77.4% | 80.2% | 49.5% | 27.0% |

| DeepSeek Coder V2 lite | 128k | 83.5% | 83.2% | 49.7% | 28.1% |

Par langue

| modélisation | HumanEval Python | HumanEval C++ | HumanEval Java | HumanEval Javascript | Le choc de l'HumanEval | HumanEval Typescript | HumanEval C# | HumanEval (moyenne) |

|---|---|---|---|---|---|---|---|---|

| Codestral-2501 | 86.6% | 78.9% | 72.8% | 82.6% | 43.0% | 82.4% | 53.2% | 71.4% |

| Codestral-2405 22B | 81.1% | 68.9% | 78.5% | 71.4% | 40.5% | 74.8% | 43.7% | 65.6% |

| Codellama 70B instruire | 67.1% | 56.5% | 60.8% | 62.7% | 32.3% | 61.0% | 46.8% | 55.3% |

| DeepSeek Coder 33B instruit | 77.4% | 65.8% | 73.4% | 73.3% | 39.2% | 77.4% | 49.4% | 65.1% |

| DeepSeek Coder V2 lite | 83.5% | 68.3% | 65.2% | 80.8% | 34.2% | 82.4% | 46.8% | 65.9% |

FIM (correspondance exacte sur une ligne)

| modélisation | HumanEvalFIM Python | HumanEvalFIM Java | HumanEvalFIM JS | HumanEvalFIM (moyenne) |

|---|---|---|---|---|

| Codestral-2501 | 80.2% | 89.6% | 87.96% | 85.89% |

| Codestral-2405 22B | 77.0% | 83.2% | 86.08% | 82.07% |

| OpenAI FIM API* | 80.0% | 84.8% | 86.5% | 83.7% |

| DeepSeek Chat API | 78.8% | 89.2% | 85.78% | 84.63% |

| DeepSeek Coder V2 lite | 78.7% | 87.8% | 85.90% | 84.13% |

| DeepSeek Coder 33B instruit | 80.1% | 89.0% | 86.80% | 85.3% |

FIM pass@1.

| modélisation | HumanEvalFIM Python | HumanEvalFIM Java | HumanEvalFIM JS | HumanEvalFIM (moyenne) |

|---|---|---|---|---|

| Codestral-2501 | 92.5% | 97.1% | 96.1% | 95.3% |

| Codestral-2405 22B | 90.2% | 90.1% | 95.0% | 91.8% |

| OpenAI FIM API* | 91.1% | 91.8% | 95.2% | 92.7% |

| DeepSeek Chat API | 91.7% | 96.1% | 95.3% | 94.4% |

- GPT 3.5 Turbo est la dernière API FIM d'OpenAI.

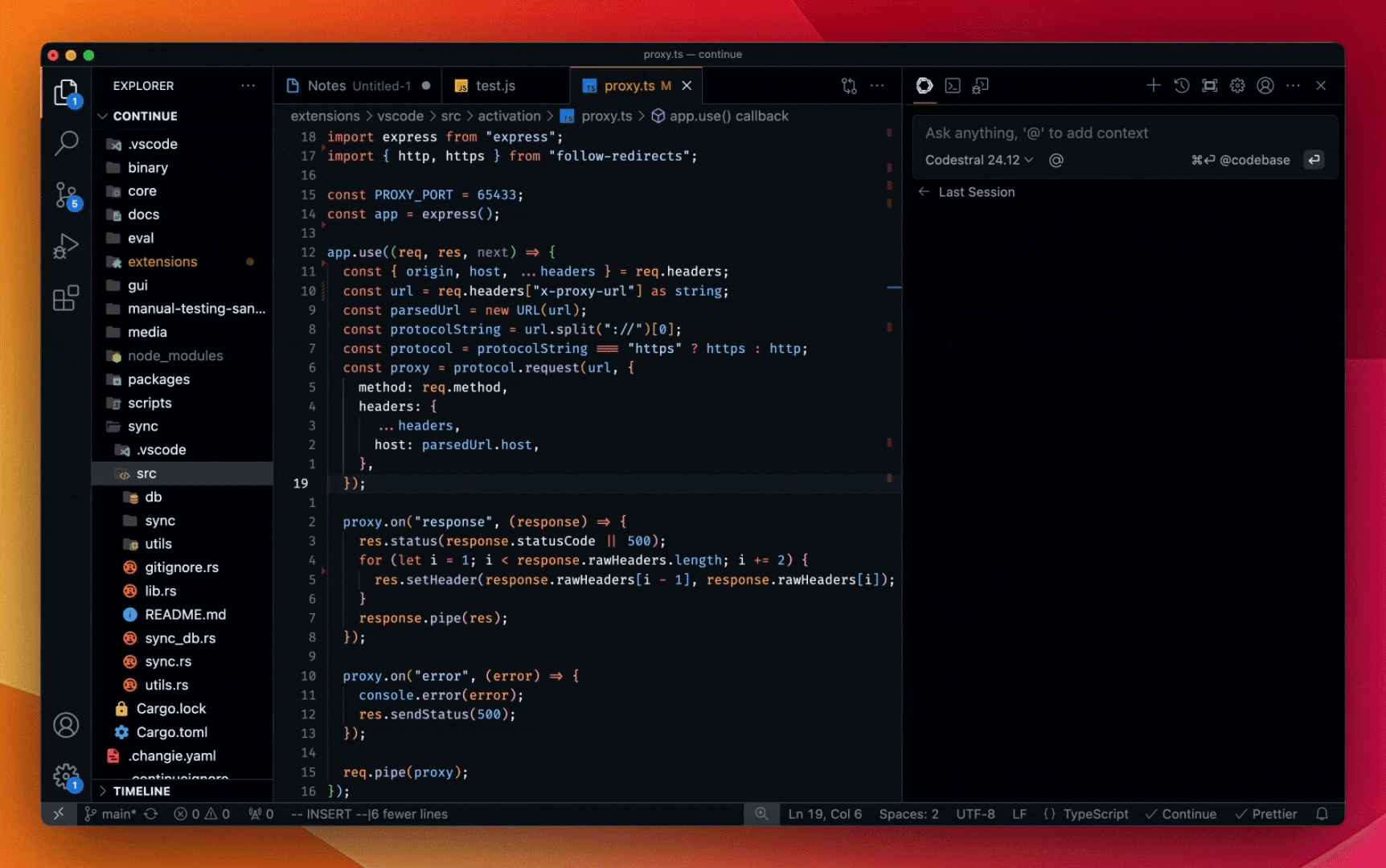

Disponible dès aujourd'hui

Codestral 25.01 est en cours de déploiement auprès des développeurs du monde entier par l'intermédiaire de nos partenaires IDE / plugin IDE. Vous pouvez sentir la différence dans la qualité de réponse et la vitesse de complétion du code en sélectionnant Codestral 25.01 dans votre sélecteur de modèle respectif.

Pour les cas d'utilisation en entreprise, en particulier ceux qui nécessitent une résidence des données et des modèles, Codestral 25.01 peut être déployé localement dans vos locaux ou au sein d'un VPC.

Consultez la démo ci-dessous, et ajoutez le fichier Continuer pour un essai gratuit dans VS Code ou JetBrains.

* : : Codestral 25.01 chat demo

Ty Dunn, cofondateur de Continue, a déclaré : "Pour les assistants de code IA, la complétion du code constitue la majeure partie du travail, ce qui nécessite des modèles qui excellent dans le Fill-in-the-Middle (FIM).Codestral 25.01 marque une avancée significative dans ce domaine.Le nouveau modèle de Mistral AI fournit des recommandations plus précises et plus rapides -- Codestral 25.01 marque une avancée significative dans ce domaine. C'est pourquoi Codestral est le modèle d'autocomplétion que nous recommandons aux développeurs".

Pour créer votre propre intégration à l'aide de l'API Codestral, rendez-vous à l'adresse suivante la Plateforme et en utilisant codestral-latestL'API est également disponible sur Vertex AI pour Google Cloud. L'API est également disponible sur Vertex AI pour Google Cloud, en avant-première privée sur Azure AI Foundry, et bientôt sur Amazon Bedrock. Documentation codestrale.

Codestral 25.01 in LMsyscopilote Il s'est hissé à la première place du palmarès des concerts en salle. Nous sommes impatients de connaître votre expérience !

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...