Ensemble de données de distillation DeepSeek-R1 à sang complet basé en Chine, prend en charge l'ensemble de données SFT de distillation R1 en Chine

Introduction générale

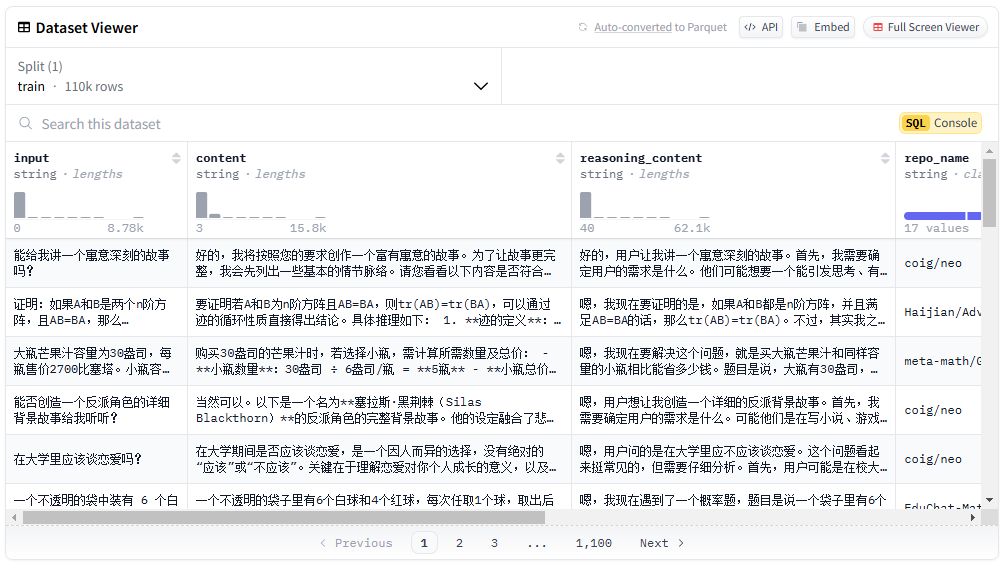

L'ensemble de données chinois de distillation DeepSeek-R1 est un ensemble de données chinoises open source contenant 110 000 pièces de données conçues pour soutenir l'apprentissage automatique et la recherche sur le traitement du langage naturel. L'ensemble de données est publié par l'équipe NLP de Liu Cong et contient non seulement des données mathématiques, mais aussi un grand nombre de types de données générales, telles que le raisonnement logique, Xiaohongshu, Zhihu, etc. Le processus de distillation de l'ensemble de données est effectué en stricte conformité avec les détails fournis par le responsable de DeepSeek-R1 afin de garantir la haute qualité et la diversité des données. Les utilisateurs peuvent télécharger et utiliser gratuitement l'ensemble de données sur les plateformes Hugging Face et ModelScope.

Liste des fonctions

- Divers types de donnéesLes données sont des données mathématiques, des raisonnements logiques, des types de données génériques, etc.

- Des données de qualité: Distillé en stricte conformité avec les détails officiels fournis par DeepSeek-R1.

- libre et gratuitLes utilisateurs peuvent le télécharger gratuitement sur les plateformes Hugging Face et ModelScope.

- Prise en charge de plusieurs applicationsLes résultats de l'étude ont été présentés dans le cadre d'un projet de recherche sur l'apprentissage automatique et le traitement du langage naturel.

- Distribution détaillée des donnéesLe système d'information sur la santé : Il fournit une catégorisation détaillée des données et des informations quantitatives.

Utiliser l'aide

Processus d'installation

- Visitez les plateformes Hugging Face ou ModelScope.

- Recherche de "Chinese-DeepSeek-R1-Distill-data-110k".

- Cliquez sur le lien de téléchargement et sélectionnez le format approprié pour le téléchargement.

Utilisation

- Chargement des ensembles de donnéesdans l'environnement Python

datasetsLa bibliothèque charge le jeu de données.

from datasets import load_dataset

dataset = load_dataset("Congliu/Chinese-DeepSeek-R1-Distill-data-110k")

- Voir les données: Utilisation

datasetLes objets permettent de visualiser des informations de base et des échantillons de l'ensemble de données.

print(dataset)

print(dataset['train'][0])

- Prétraitement des donnéesTraitement préalable des données en fonction des besoins de la recherche, comme le découpage des mots et la déduplication.

from transformers import BertTokenizer

tokenizer = BertTokenizer.from_pretrained('bert-base-chinese')

tokenized_data = dataset.map(lambda x: tokenizer(x['text'], padding='max_length', truncation=True))

- formation au modèleLa formation de modèles à l'aide de données prétraitées.

from transformers import BertForSequenceClassification, Trainer, TrainingArguments

model = BertForSequenceClassification.from_pretrained('bert-base-chinese')

training_args = TrainingArguments(output_dir='./results', num_train_epochs=3, per_device_train_batch_size=16)

trainer = Trainer(model=model, args=training_args, train_dataset=tokenized_data['train'])

trainer.train()

Fonctions vedettes Procédure d'utilisation

- Traitement mathématique des donnéesPour les données mathématiques, ajouter l'invite "Veuillez raisonner étape par étape et inscrire la réponse finale dans l'encadré {}".

def add_math_prompt(example):

example['text'] = "请一步步推理,并把最终答案放到 \\boxed {}。" + example['text']

return example

math_data = dataset.filter(lambda x: x['category'] == 'math').map(add_math_prompt)

- Raisonnement logique Traitement des donnéesTraitement spécial des données de raisonnement logique afin de garantir la logique et la cohérence des données.

def process_logic_data(example):

# 自定义逻辑处理代码

return example

logic_data = dataset.filter(lambda x: x['category'] == 'logic').map(process_logic_data)© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...