Le moment Chinchilla et le moment o3 : l'évolution de la loi d'échelle pour les grands modèles linguistiques

Lecture rapide de l'article

Cet article offre un aperçu complet et approfondi du passé et du présent de la loi d'échelle des grands modèles de langage (LLM) et de l'orientation future de la recherche en IA. Avec une logique claire et de riches exemples, l'auteur Cameron R. Wolfe emmène les lecteurs des concepts de base à la recherche de pointe, présentant une image globale du domaine de l'IA. Ce qui suit est un résumé et un commentaire sur le contenu principal de l'article et les points de vue de l'auteur :

1) Origine et développement de la loi d'échelle : de GPT à Chinchilla

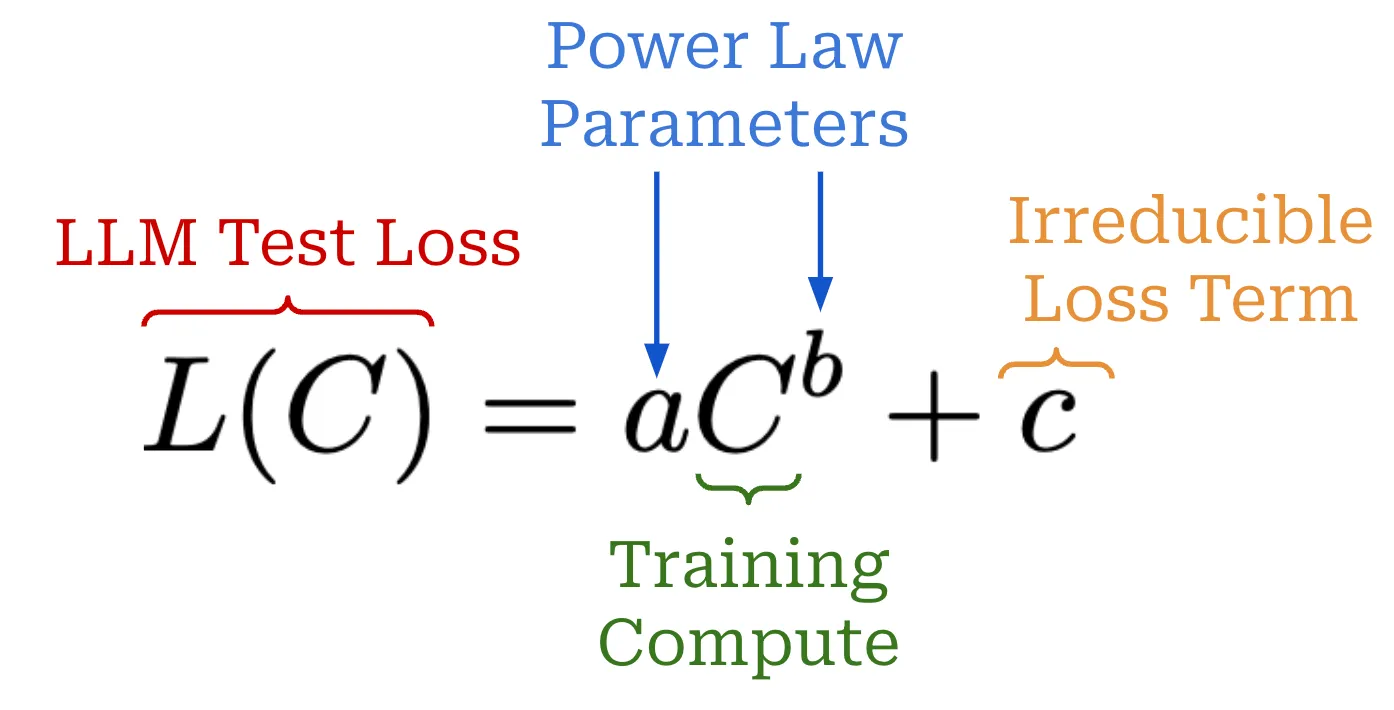

- Les auteurs commencent par affirmer que la loi d'échelle est le principal moteur du développement de grands modèles linguistiques. En introduisant le concept de base de la loi de puissance, les auteurs expliquent comment la perte de test d'un grand modèle linguistique diminue à mesure que les paramètres du modèle, la taille de l'ensemble de données et l'effort de calcul augmentent.

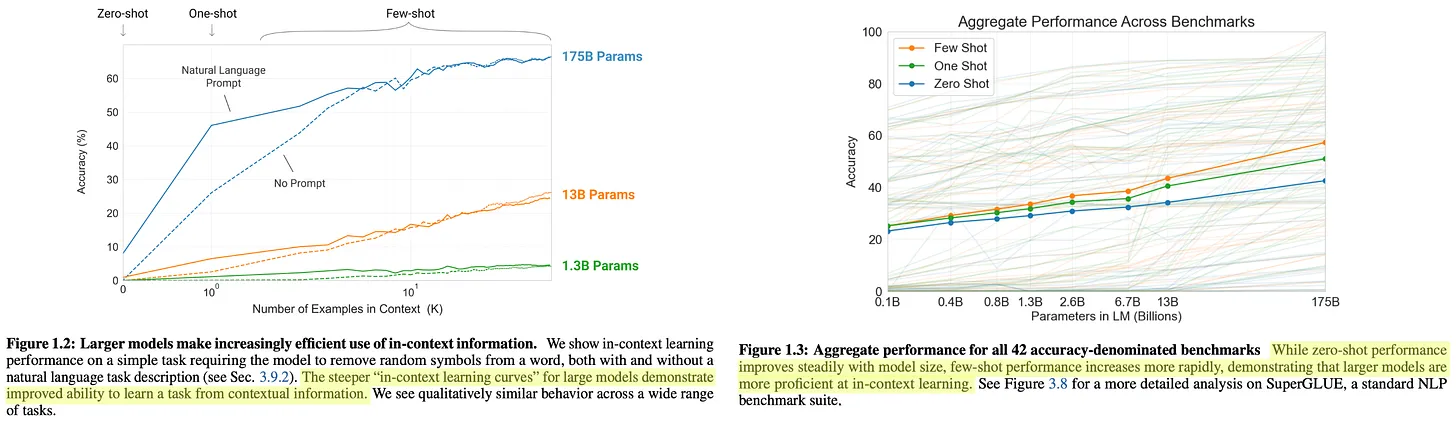

- Les auteurs examinent l'évolution de la famille des modèles GPT et démontrent de manière vivante l'application des lois d'échelle dans la pratique. Depuis les premiers GPT et GPT-2, jusqu'au GPT-3 et au mystérieux GPT-4, l'OpenAI a toujours adhéré à la stratégie consistant à "faire des miracles à partir de grands efforts", et a constamment rafraîchi la limite supérieure des capacités des grands modèles de langage. L'article décrit en détail les principales innovations, les configurations expérimentales et les performances de chaque modèle, et souligne que l'émergence du GPT-3 marque la transition d'un modèle spécialisé à un modèle de base polyvalent du grand modèle de langage, et ouvre une nouvelle ère de la recherche en IA.

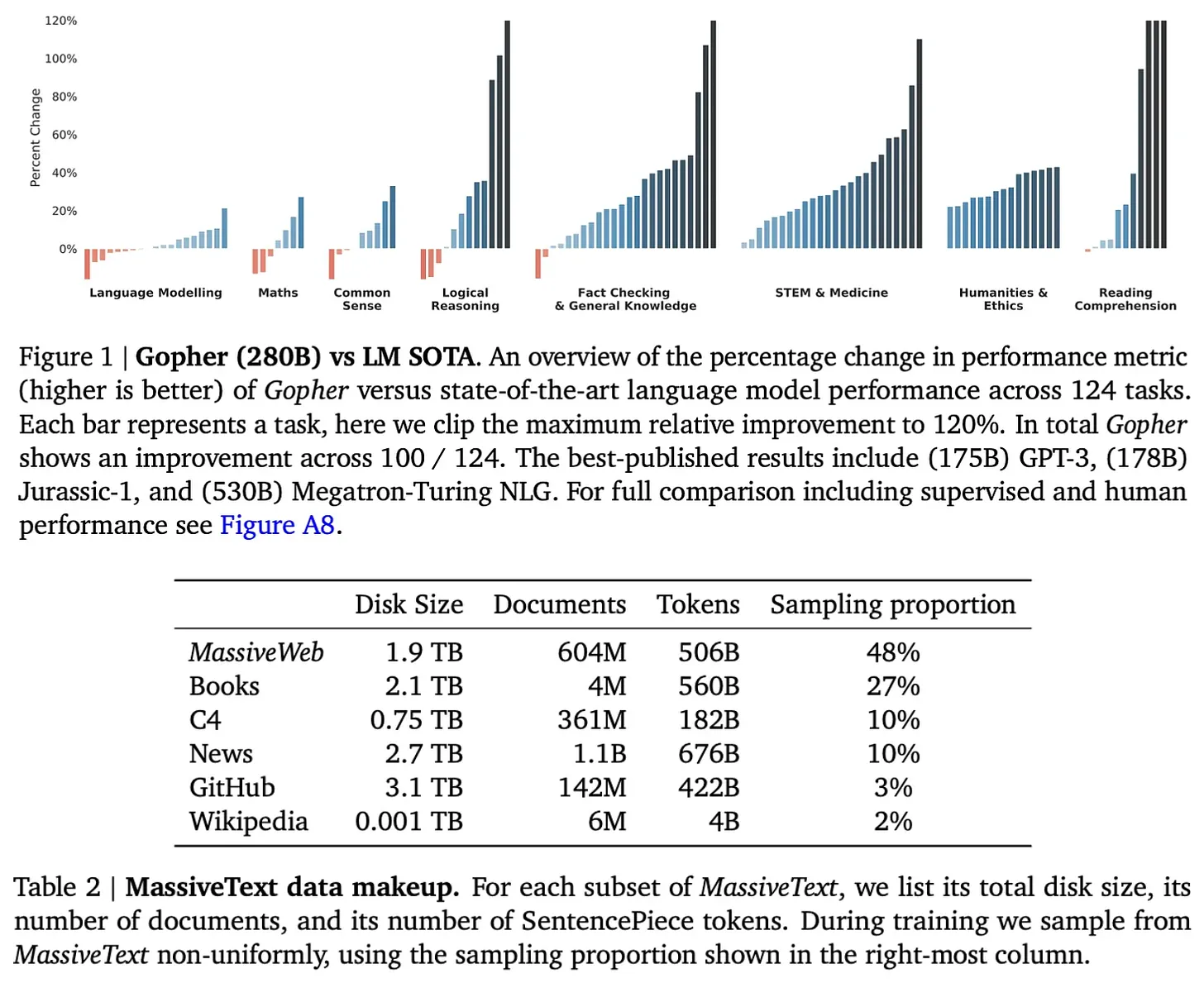

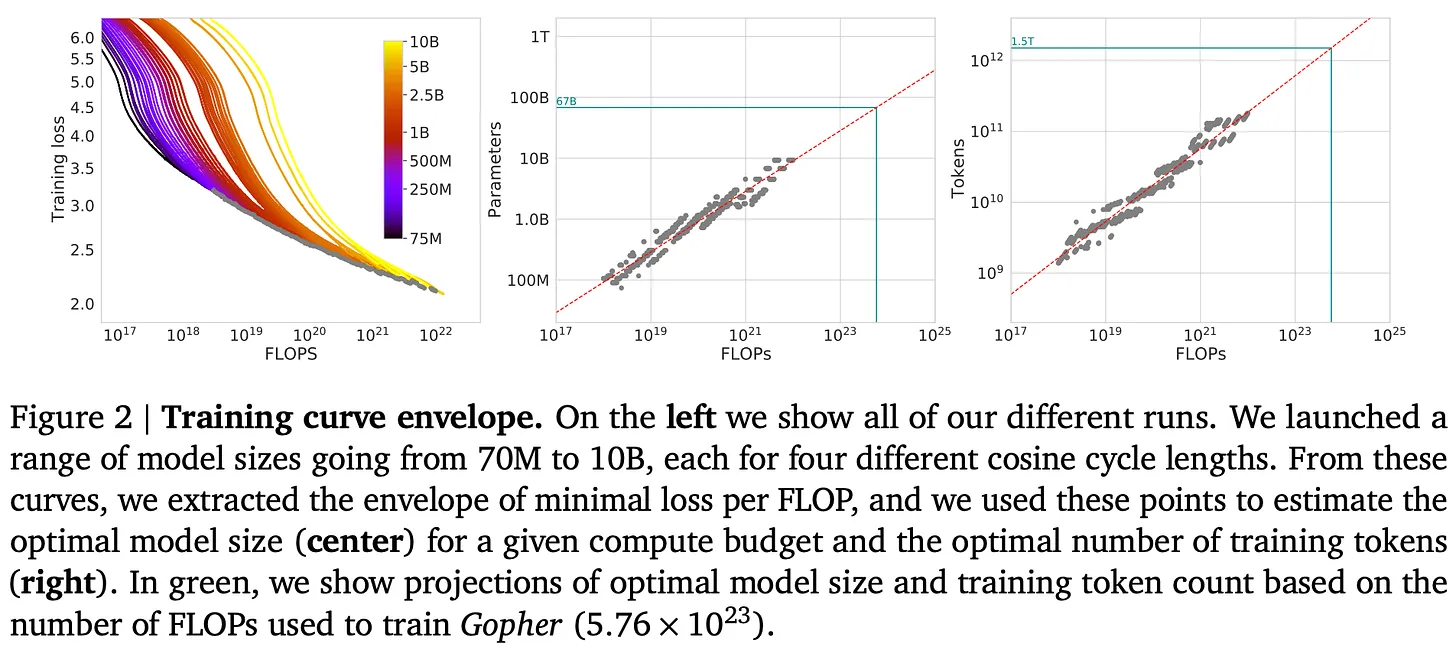

- Les auteurs ne défendent pas aveuglément l'idée que "plus c'est gros, mieux c'est", mais analysent rationnellement la loi de la taille "optimale pour le calcul" proposée par le modèle de Chinchilla. Les recherches de DeepMind ont montré que les modèles précédents étaient généralement "sous-entraînés", c'est-à-dire que la taille de l'ensemble de données était trop petite par rapport à la taille du modèle, et le succès du modèle de Chinchilla a démontré que l'augmentation de la taille de l'ensemble de données de manière appropriée peut être plus efficace que l'augmentation de la taille du modèle pour le même budget de calcul. Cette découverte a eu un impact profond sur la formation des grands modèles linguistiques ultérieurs.

Commentaire : Les auteurs présentent une introduction approfondie à la loi d'échelle, avec des explications théoriques et des exemples à l'appui, afin que même les lecteurs non spécialisés puissent comprendre ses idées fondamentales. En examinant l'évolution de la série de modèles GPT, les auteurs établissent un lien entre la loi d'échelle abstraite et le développement de modèles concrets, ce qui améliore la lisibilité et la force de persuasion de l'article. L'analyse du modèle Chinchilla démontre l'esprit de discernement de l'auteur, qui ne préconise pas l'échelle aveuglément, mais guide les lecteurs pour qu'ils réfléchissent à la manière d'utiliser plus efficacement les ressources informatiques.

2) La "disparition" de la loi de la taille : questions et réflexions

- La deuxième partie de l'article est consacrée à la récente remise en question de la loi d'échelle dans le domaine de l'IA. Les auteurs citent de nombreux rapports médiatiques qui suggèrent que l'industrie commence à se demander si la loi de l'échelle n'a pas atteint son plafond alors que le taux d'amélioration des modèles ralentit. Dans le même temps, les auteurs citent des initiés du secteur tels que Dario Amodei et Sam Altman qui soutiennent le contraire, suggérant que l'échelle est toujours une force importante qui stimule les progrès de l'IA.

- Les auteurs notent que le "ralentissement" de la loi d'échelle était dans une certaine mesure attendu. La loi d'échelle elle-même prédit qu'à mesure que l'échelle augmente, la difficulté d'améliorer les performances s'accroît de manière exponentielle. En outre, les auteurs soulignent l'importance de la définition du terme "performance". Une diminution de la perte de test n'équivaut pas nécessairement à une augmentation des capacités du grand modèle linguistique, et les attentes de l'industrie à l'égard du grand modèle linguistique varient considérablement.

- Les "goulets d'étranglement des données" sont l'un des problèmes sur lesquels les auteurs se concentrent. Le modèle Chinchilla et les études ultérieures ont souligné l'importance de la taille des données, mais la disponibilité limitée de données de haute qualité sur l'internet peut constituer un goulot d'étranglement pour le développement ultérieur de modèles de grandes langues.

Commentaire : Cette section démontre l'esprit critique de l'auteur et sa connaissance approfondie du secteur. Au lieu d'éviter la controverse, les auteurs présentent objectivement les points de vue des différentes parties et analysent les raisons possibles du "ralentissement de l'échelle" d'un point de vue technique. L'accent mis par l'auteur sur les "goulets d'étranglement des données" est particulièrement important, non seulement parce qu'il s'agit d'un véritable défi pour le développement de modèles linguistiques de grande taille, mais aussi parce qu'il s'agit d'une orientation pour la recherche future.

3) L'avenir de la recherche sur l'IA : au-delà du pré-entraînement

- La dernière partie de l'article examine les orientations futures de la recherche en IA, en se concentrant sur les grands modèles de langage, les systèmes/agents et les modèles d'inférence.

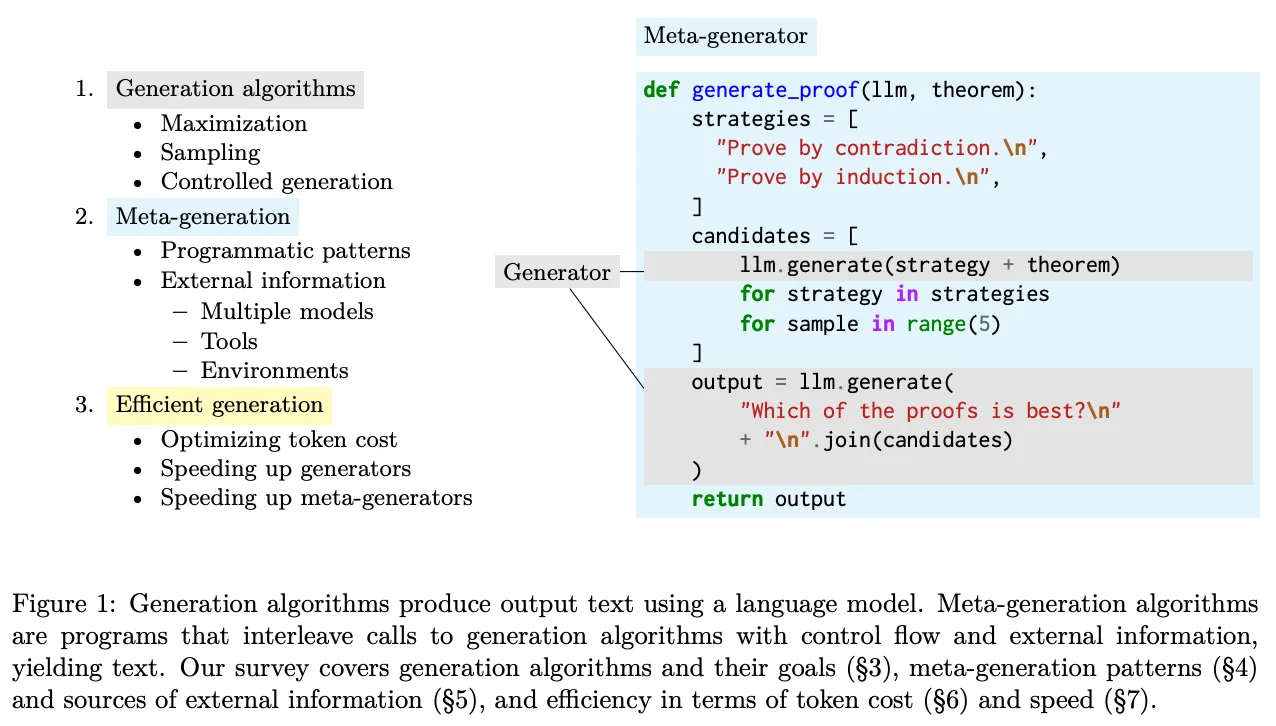

- Les auteurs affirment que même si la croissance de la taille des modèles pré-entraînés se heurte à un goulot d'étranglement, nous pouvons encore améliorer les capacités de l'IA en construisant des systèmes complexes de grands modèles de langage. L'article décrit les deux principales stratégies de décomposition des tâches et d'établissement de liens, et utilise des résumés de livres comme exemple de décomposition de tâches complexes en sous-tâches que les grands modèles de langage excellent à traiter.

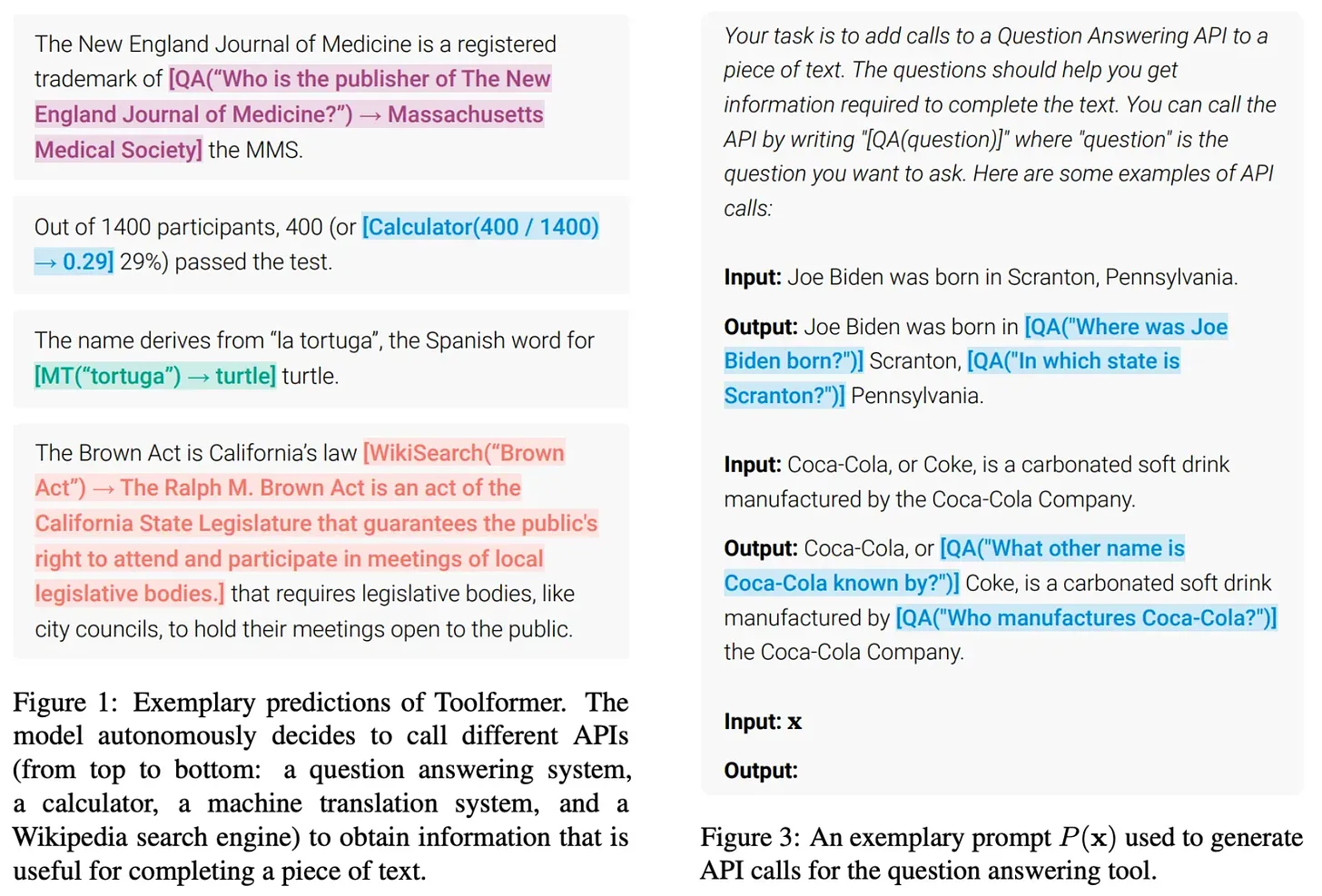

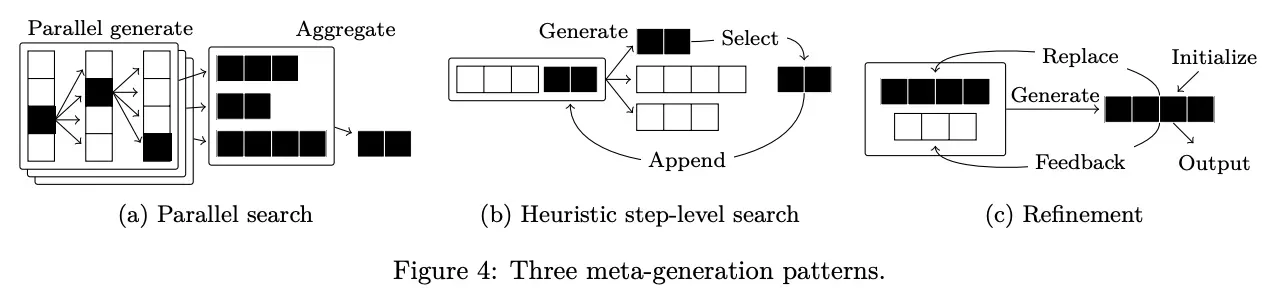

- Les auteurs discutent également des perspectives d'application des modèles de langage dans le développement de produits, en soulignant que la construction de modèles de langage réellement utiles est une orientation importante de la recherche actuelle en matière d'intelligence artificielle. En particulier, l'article met en évidence le concept d'agent, qui étend les scénarios d'application des grands modèles linguistiques en leur donnant la capacité d'utiliser des outils. Cependant, les auteurs soulignent également les défis que pose la robustesse des systèmes complexes de modélisation linguistique à grande échelle et présentent des pistes de recherche pour améliorer la fiabilité des systèmes grâce à des algorithmes de méta-génération améliorés.

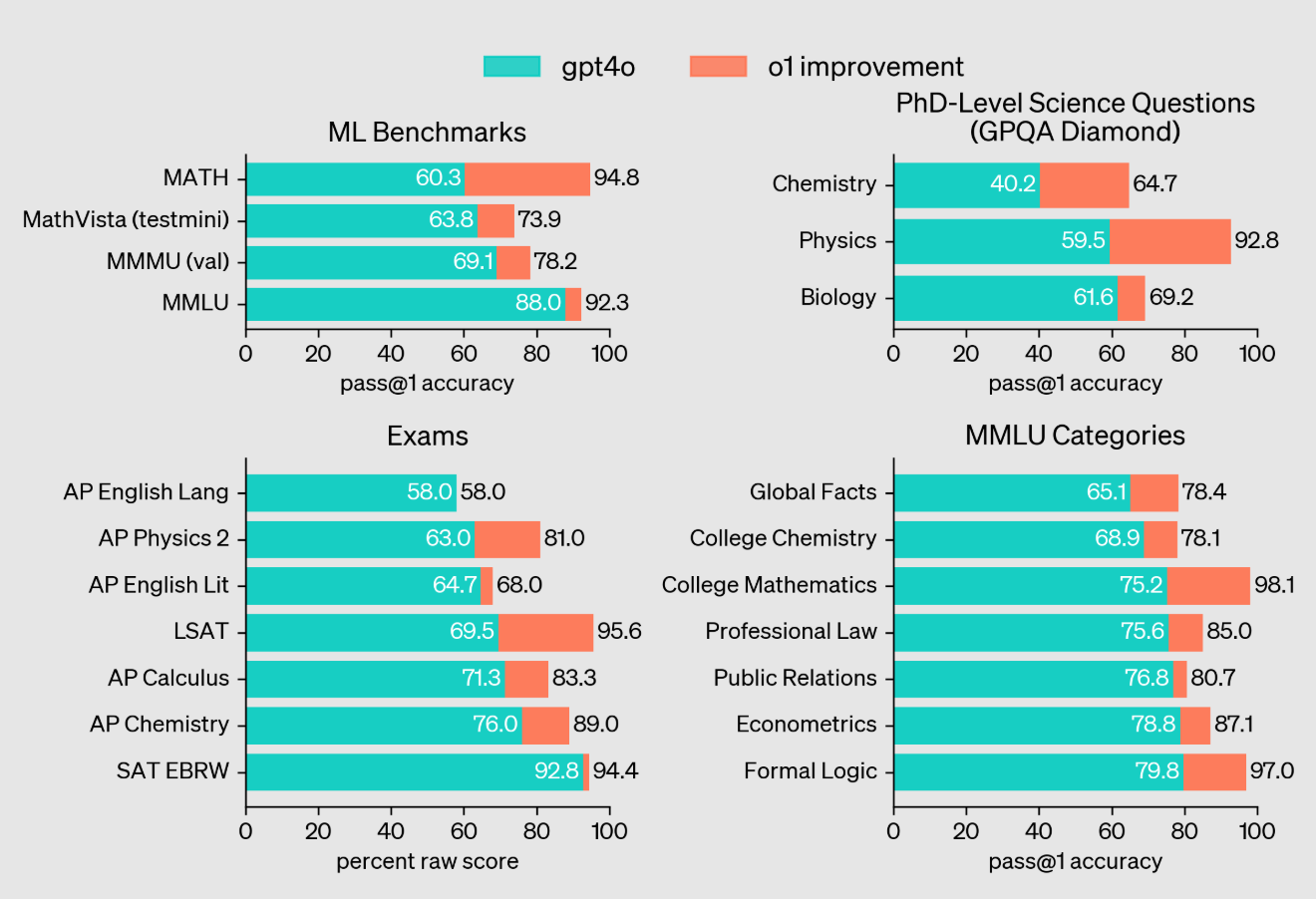

- En ce qui concerne les modèles d'inférence, les auteurs présentent les modèles o1 et o3 d'OpenAI, qui ont obtenu des résultats impressionnants sur des tâches d'inférence complexes. o3, en particulier, a surpassé les niveaux humains sur plusieurs points de référence difficiles et a même dépassé les prédictions de Terence Tao pour certains problèmes. Les auteurs soulignent que le succès des modèles o1 et o3 montre qu'en plus de la mise à l'échelle du pré-entraînement, l'inférence des modèles peut être améliorée de manière significative en augmentant les entrées de calcul au moment de l'inférence, un nouveau paradigme de mise à l'échelle.

Commentaire : Cette section est très prospective, et l'introduction des auteurs aux systèmes/agents de modélisation des grandes langues et aux modèles d'inférence ouvre de nouveaux horizons aux lecteurs. L'accent mis par les auteurs sur la construction de produits de modélisation des grandes langues est d'une grande importance pratique, non seulement pour la recherche universitaire, mais aussi pour l'application de la technologie de l'IA sur le terrain. L'introduction des modèles o1 et o3 est encourageante, car ils montrent le grand potentiel de l'IA pour les tâches de raisonnement complexes et indiquent de nouvelles directions pour la recherche future en IA.

Résumer et réfléchir :

L'article de Cameron R. Wolfe est un excellent travail qui allie ampleur et profondeur, fournissant non seulement un aperçu systématique du développement de la loi d'échelle pour les grands modèles de langage, mais aussi une perspective perspicace sur l'avenir de la recherche en IA. Le point de vue de l'auteur est objectif et rationnel, affirmant le rôle important de la loi d'échelle, mais soulignant également ses limites et ses défis. La logique de l'article est claire et bien argumentée, de sorte que même les lecteurs qui ne sont pas familiers avec le domaine de l'IA peuvent en tirer profit.

Faits marquants :

- Une explication approfondie : L'auteur a le don d'expliquer des concepts complexes dans un langage facile à comprendre, comme l'introduction des lois de puissance, des lois d'échelle et de la décomposition des tâches.

- Soutenu par des exemples concrets : L'article énumère un grand nombre de modèles et de résultats expérimentaux, tels que la série GPT, Chinchilla, Gopher, o1, o3, etc., afin de rendre les théories abstraites tangibles et applicables.

- Une revue complète de la littérature : L'article cite un grand nombre de références couvrant des articles classiques et des résultats de recherche récents dans le domaine de la modélisation des langues étendues, fournissant aux lecteurs des ressources pour une étude approfondie.

- L'ouverture d'esprit : Les auteurs ne donnent pas de réponse définitive sur l'avenir de la loi d'échelle, mais amènent plutôt le lecteur à une réflexion indépendante, telle que "Quelle sera la prochaine échelle ?". Cette question incitera d'autres chercheurs à explorer les frontières de l'IA.

Cet article mérite d'être lu attentivement par tous ceux qui suivent le développement de l'IA. Il ne se contente pas de résumer le passé, il éclaire aussi l'avenir. La valeur de l'article ne réside pas seulement dans son contenu, mais aussi dans son esprit de stimulation de la réflexion et d'encouragement de l'innovation. Je pense qu'à l'avenir, la recherche sur l'IA connaîtra d'autres percées comme celle d'o3, et que les idées à grande échelle continueront à faire progresser la technologie de l'IA sous de nouvelles formes.

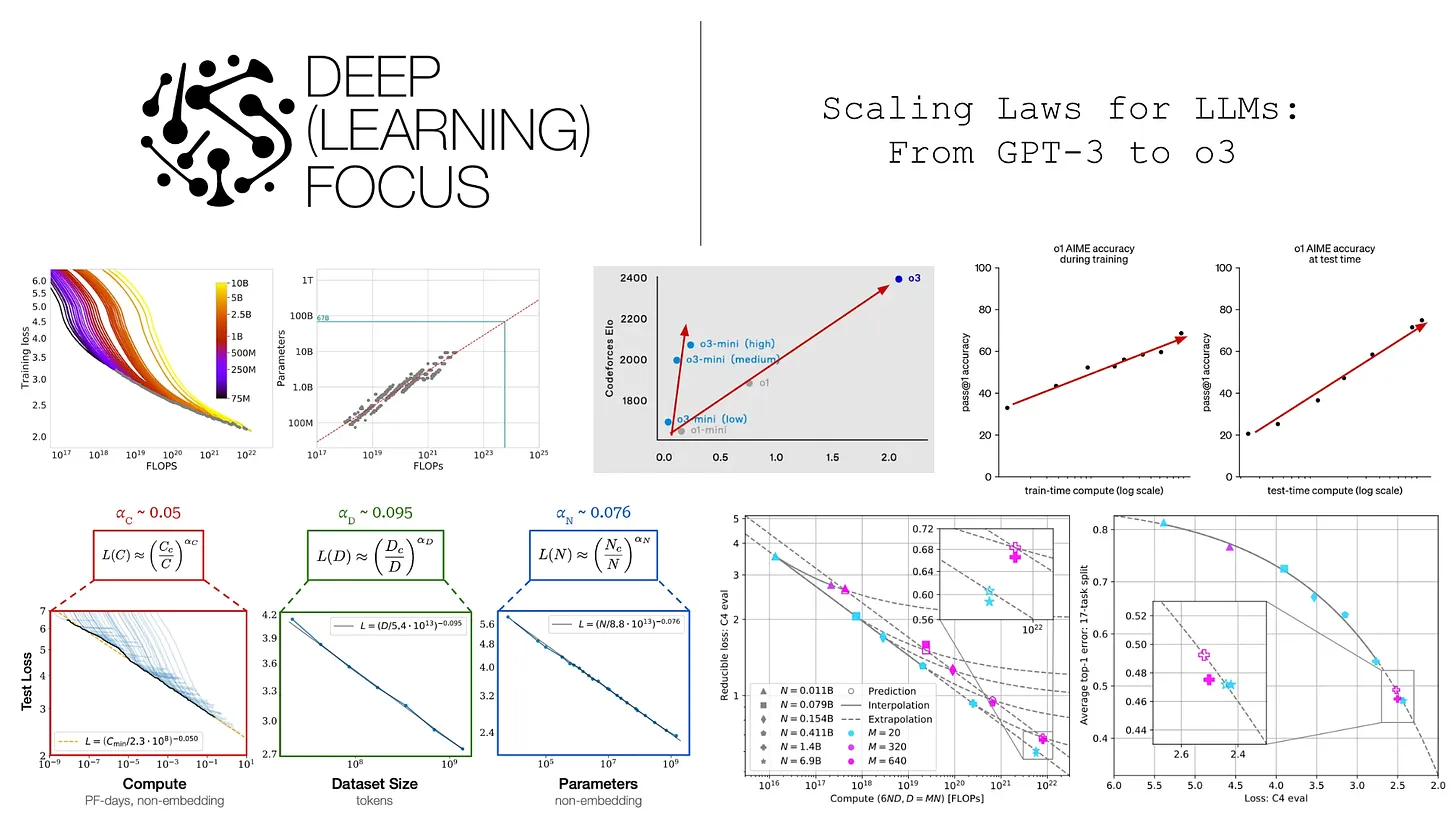

Titre :Lois d'échelle pour les grands modèles linguistiques : de GPT-3 à o3.

Texte original :https://cameronrwolfe.substack.com/p/llm-scaling-laws

Découvrez l'état actuel de la modélisation du langage à grande échelle et l'avenir de la recherche en IA...

(Sources [1, 7, 10, 21])

Les avancées les plus récentes dans la recherche sur l'IA -En particulier, le grand modèle linguistique (LLM)- C'est une question d'échelle. Si nous entraînons des modèles plus importants avec davantage de données, nous obtenons de meilleurs résultats. Cette relation peut être définie de manière plus rigoureuse par la loi d'échelle, qui est une équation décrivant comment la perte de test d'un grand modèle de langage diminue à mesure que l'on augmente une certaine quantité (par exemple, la quantité de calculs d'entraînement). La loi d'échelle nous aide à prédire les résultats d'entraînements plus importants et plus coûteux, ce qui nous donne la confiance nécessaire pour continuer à investir dans la mise à l'échelle.

"Si vous disposez d'un grand ensemble de données et que vous entraînez un très grand réseau neuronal, le succès est garanti ! - Ilya Sutskever

Pendant des années, la loi d'échelle a été une étoile polaire prévisible pour la recherche en IA. En fait, le succès des laboratoires pionniers comme OpenAI a même été attribué à leur adhésion à la loi d'échelle. Toutefois, la persistance de la loi d'échelle a récemment été remise en question par1 des rapports indiquant que des laboratoires de recherche de premier plan travaillent à la création de la prochaine génération de meilleurs modèles de grands langages. Ces affirmations peuvent nous rendre sceptiques :Y aura-t-il un goulot d'étranglement à l'échelle ? Dans l'affirmative, existe-t-il d'autres solutions ?

Cette vue d'ensemble répondra à ces questions à partir de la base, en commençant par une explication approfondie des lois d'échelle du modèle Big Language et de la recherche qui s'y rapporte. Le concept de la loi d'échelle est simple, mais il y a toutes sortes d'idées fausses dans le public à propos de la mise à l'échelle - la loi de l'échelle, la loi de l'échelle et la loi de l'échelle.La science qui sous-tend cette étude est en fait très spécifiqueNous utiliserons cette compréhension détaillée de la mise à l'échelle pour discuter des tendances récentes en matière de modélisation des grandes langues et des facteurs qui ont conduit à la "stagnation" de la loi d'échelle. Grâce à cette compréhension détaillée de la mise à l'échelle, nous discuterons des dernières tendances de la recherche sur la modélisation des langues à grande échelle, ainsi que des facteurs qui ont entraîné la "stagnation" de la loi d'échelle. Enfin, nous utiliserons ces informations pour donner une image plus claire de l'avenir de la recherche sur l'IA, en nous concentrant sur quelques idées clés...Y compris l'échelle--Ces idées peuvent continuer à faire avancer les choses.

Concepts de base pour la mise à l'échelle des grands modèles linguistiques

Pour comprendre l'état de mise à l'échelle des grands modèles de langage, nous devons d'abord établir une compréhension générale des lois d'échelle. Nous construirons cette compréhension à partir de zéro, en commençant par le concept des lois de puissance. Nous étudierons ensuite comment les lois de puissance ont été appliquées dans l'étude des grands modèles de langage pour dériver les lois d'échelle que nous utilisons aujourd'hui.

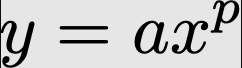

Qu'est-ce qu'une loi de puissance ?

Les lois de puissance sont un concept fondamental dans la mise à l'échelle des grands modèles linguistiques. En bref, une loi de puissance décrit simplement la relation entre deux quantités. Dans le cas d'un grand modèle linguistique, la première quantité est la perte de test du grand modèle linguistique-ou d'autres mesures de performance pertinentes (par exemple, la précision de la tâche en aval [7])- D'autre part, nous essayons de mettre à l'échelle certains paramètres, tels que le nombre de paramètres du modèle. Par exemple, lorsque l'on étudie les propriétés de mise à l'échelle d'un grand modèle linguistique, on peut voir l'énoncé suivant.

"S'il y a suffisamment de données d'apprentissage, l'échelle de la perte de validation devrait être une fonction de loi de puissance lisse approximative de la taille du modèle". - Source [4]

Une telle affirmation nous indique qu'il existe une relation mesurable entre la perte de test du modèle et le nombre total de paramètres du modèle. Une modification de l'une de ces quantités entraînera une modification invariable de l'échelle relative de l'autre. En d'autres termes, nous savons, grâce à cette relation, que l'augmentation du nombre total de paramètres du modèle - laEn supposant que d'autres conditions soient remplies (par exemple, si l'on dispose de suffisamment de données d'entraînement)--... - entraînera une réduction des pertes d'essai d'un facteur prévisible.

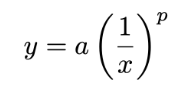

Formule de la loi de puissance. La loi de puissance de base est exprimée par l'équation suivante.

Les deux quantités étudiées ici sont x répondre en chantant ymais (pas) a répondre en chantant p est une constante qui décrit la relation entre ces quantités. Si nous traçons cette fonction de loi de puissance2 , nous obtenons la figure ci-dessous. Nous fournissons des tracés à la fois sur des échelles normales et logarithmiques, car la plupart des documents qui étudient la mise à l'échelle des grands modèles de langage utilisent des échelles logarithmiques.

Graphique de la loi de puissance fondamentale entre x et y

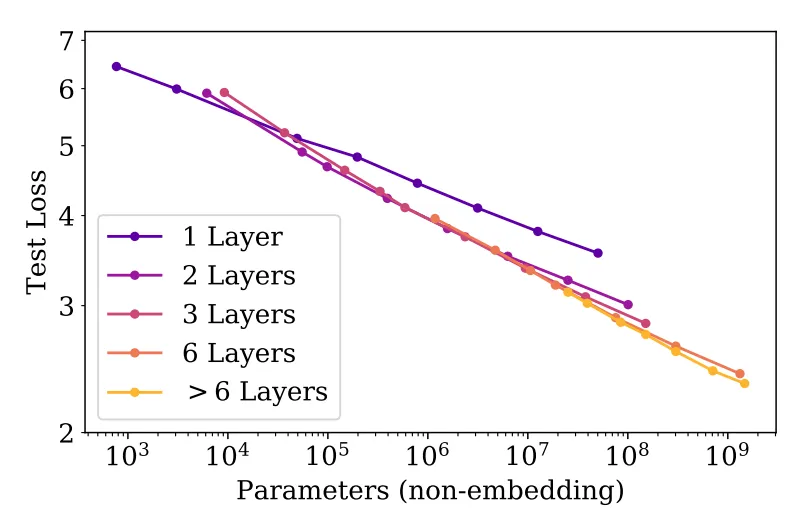

Cependant, les diagrammes fournis pour la mise à l'échelle du Big Language Model ne ressemblent pas aux diagrammes présentés ci-dessus - leIls sont généralement à l'envers.Voir l'exemple ci-dessous.

(Source [1])

L'équation de la loi de puissance inverse est presque la même que l'équation de la loi de puissance standard, mais nous nous intéressons à l'équation de la loi de puissance inverse. p Utilisez des exposants négatifs. Si l'exposant d'une loi de puissance est négatif, le graphique sera inversé ; voir l'exemple ci-dessous.

Graphique de la loi de puissance inverse entre x et y

Lorsqu'elle est représentée à l'aide d'une échelle logarithmique, cette loi de puissance inverse produit la relation linéaire qui caractérise les lois de taille de la plupart des grands modèles de langage. Presque tous les documents abordés dans cet aperçu génèrent de tels graphiques afin d'étudier la manière dont la mise à l'échelle d'une variété de facteurs différents (par exemple, la taille, le calcul, les données, etc.) affecte les performances d'un modèle de langage de grande taille. ) affecte les performances d'un grand modèle de langage. Voyons maintenant de manière plus pratique les lois de puissance en comprenant l'un des premiers articles à les étudier dans le contexte de la mise à l'échelle d'un grand modèle de langage [1].

Lois d'échelle pour la modélisation neurolinguistique [1]

Dans les premiers temps de la modélisation linguistique, nous ne comprenions pas l'impact de l'échelle sur les performances. La modélisation linguistique était un domaine de recherche prometteur, mais la génération actuelle de modèles de l'époque (par exemple, le GPT original) avait une puissance limitée. Nous n'avions pas encore découvert la puissance des modèles de plus grande taille, et la voie à suivre pour créer de meilleurs modèles linguistiques n'était pas claire.La forme du modèle (c'est-à-dire le nombre de couches et la taille) a-t-elle une importance ? L'augmentation de la taille du modèle permet-elle d'obtenir de meilleurs résultats ? Quelle quantité de données est nécessaire pour entraîner ces modèles plus grands ?

"À mesure que la taille du modèle, la taille de l'ensemble de données et la quantité de calcul utilisée pour l'apprentissage augmentent, la perte prend la forme d'une loi de puissance, certaines de ces tendances s'étendant sur plus de sept ordres de grandeur". - Source [1]

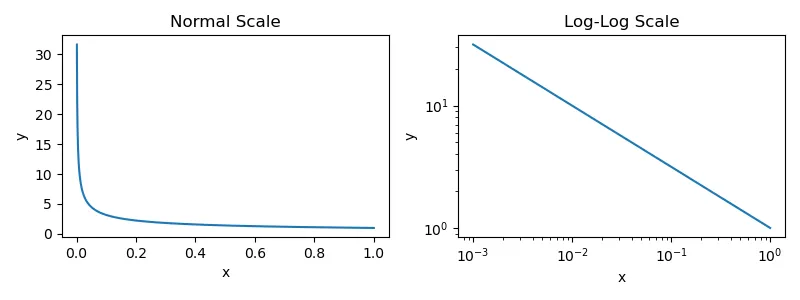

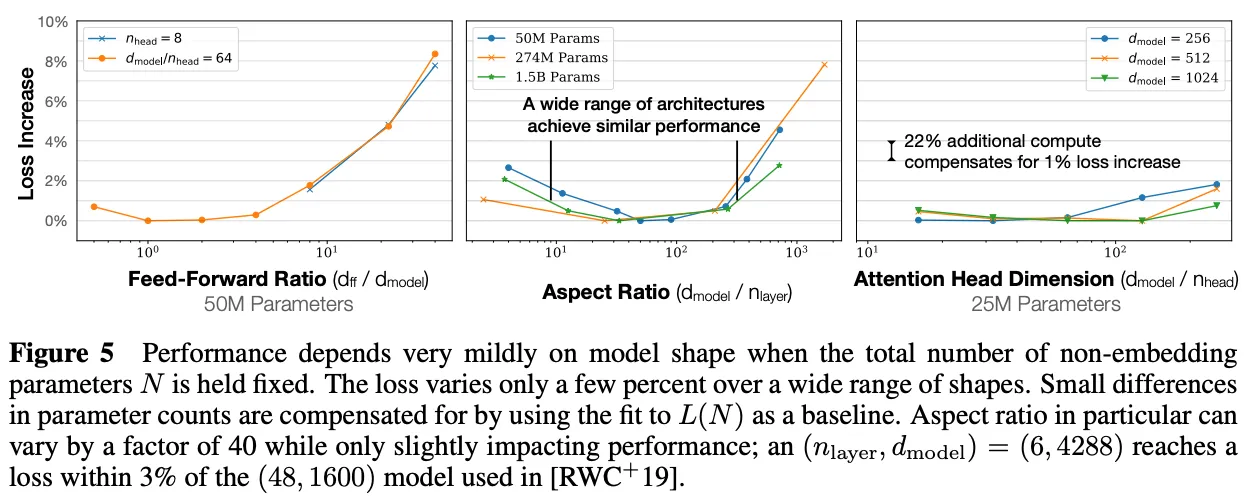

Dans [1], les auteurs ont cherché à analyser plusieurs facteurs par...Les exemples incluent la taille du modèle, la forme du modèle, la taille de l'ensemble de données, les calculs de formation et la taille du lot.- sur les performances du modèle pour répondre à ces questions. Cette analyse nous apprend que les performances du grand modèle linguistique s'améliorent progressivement au fur et à mesure que nous augmentons le nombre d'éléments d'information.

- Nombre de paramètres du modèle.

- La taille de l'ensemble de données.

- La quantité de calcul utilisée pour la formation.

Plus précisément.Lorsque les performances ne sont pas entravées par les deux autres facteurs, on observe une relation de type loi de puissance entre chaque facteur et la perte de test du grand modèle linguistique.

Dispositif expérimental.Pour adapter leurs lois de puissance, les auteurs ont pré-entraîné de grands modèles de langage sur un sous-ensemble du corpus WebText2, avec une taille allant jusqu'à 1,5 milliard de paramètres et contenant de 22 à 23 milliards de tokens. tous les modèles utilisent les 1 024 Jeton de longueur de contexte fixe et de perte standard de prédiction du prochain token (entropie croisée) pour l'apprentissage. La même perte est mesurée sur un ensemble de test réservé et utilisée comme principale mesure de performance.Ce paramètre correspond aux paramètres de pré-entraînement standard pour la plupart des grands modèles de langage..

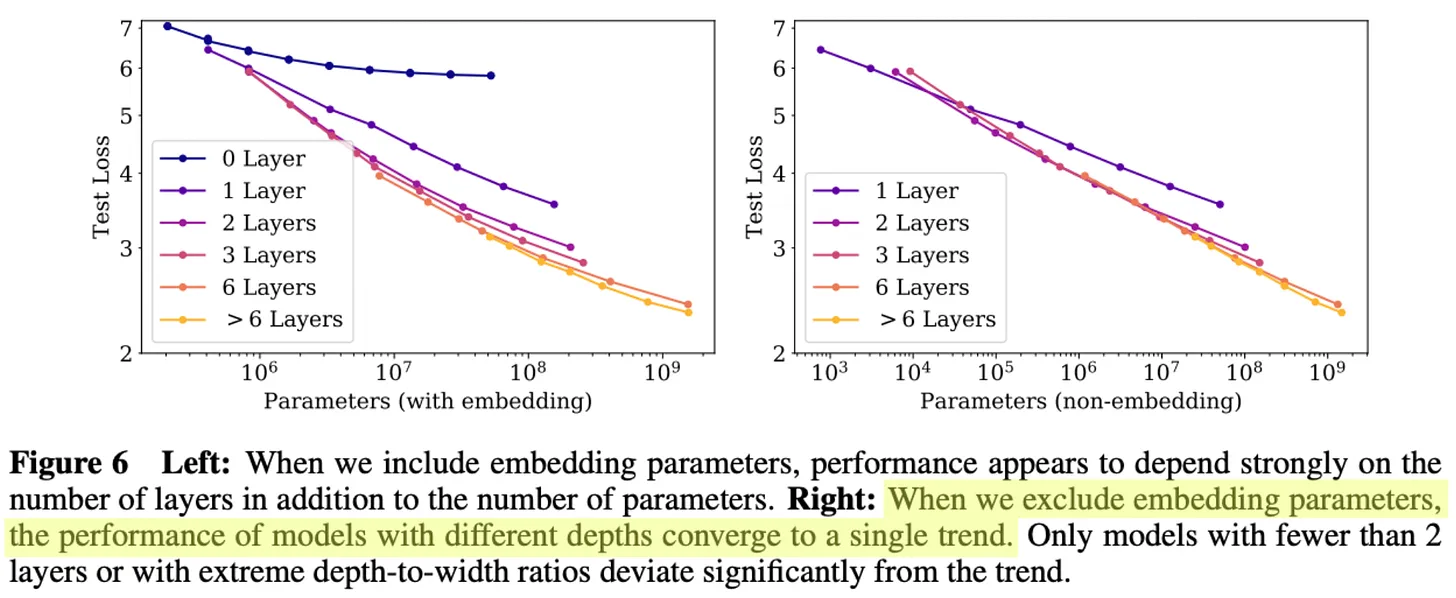

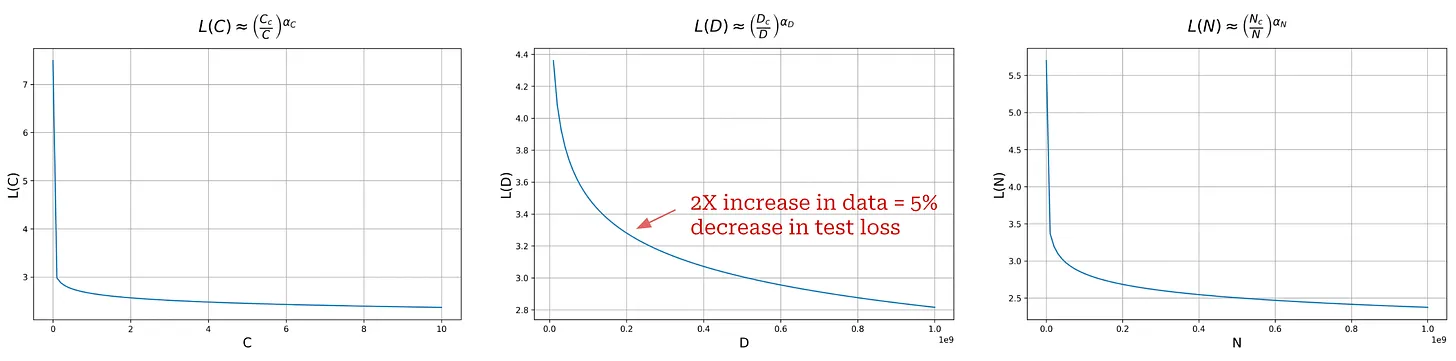

(Source [1])

Grands modèles linguistiques Lois de puissance de l'échelle.Les performances du grand modèle linguistique formé dans [1] -En ce qui concerne les pertes de tests sur WebText2- s'est avérée s'améliorer régulièrement avec davantage de paramètres, de données et de calculs3 . Ces tendances couvrent huit ordres de grandeur dans le calcul, six ordres de grandeur dans la taille du modèle et deux ordres de grandeur dans la taille de l'ensemble de données. Les relations exactes de loi de puissance et les équations adaptées à chaque relation sont indiquées dans la figure ci-dessus. Chacune de ces équations est très similaire aux équations de loi de puissance inverse que nous avons vues précédemment. Cependant, nous avons défini a = 1 et ajoutez une constante de multiplication supplémentaire de 4 à l'intérieur des parenthèses.

(Source [1])

Ces lois de puissance ne s'appliquent que lorsque la formation n'est pas entravée par d'autres facteurs. Ainsi, les trois composantes - laTaille du modèle, données et calculs-doivent tous être développés en même temps pour obtenir des performances optimales. Si nous développons l'un de ces composants de manière isolée, nous atteindrons un point de rendement décroissant.

Que nous apprend la loi de puissance ?Bien que les tracés de loi de puissance fournis dans [1] semblent prometteurs, il convient de noter que ces tracés ont été générés à l'aide de l'échelle logarithmique. Si nous générons des graphiques normaux (c'est-à-dire sans échelle logarithmique), nous obtenons la figure suivante, dans laquelle nous voyons que la forme de la loi de puissance ressemble à une décroissance exponentielle.

Graphiques de loi de puissance sans échelle logarithmique

Compte tenu d'une grande partie du discours en ligne sur la mise à l'échelle et l'AGI, une telle conclusion semble contre-intuitive. Dans de nombreux cas, l'intuition qui nous a été transmise semble être que la qualité des grands modèles de langage augmente de manière exponentielle avec la croissance logarithmique du calcul, mais ce n'est pas le cas. En fait, laIl devient de plus en plus difficile d'améliorer la qualité des modèles linguistiques de grande taille à mesure que l'échelle augmente.

(Source [1])

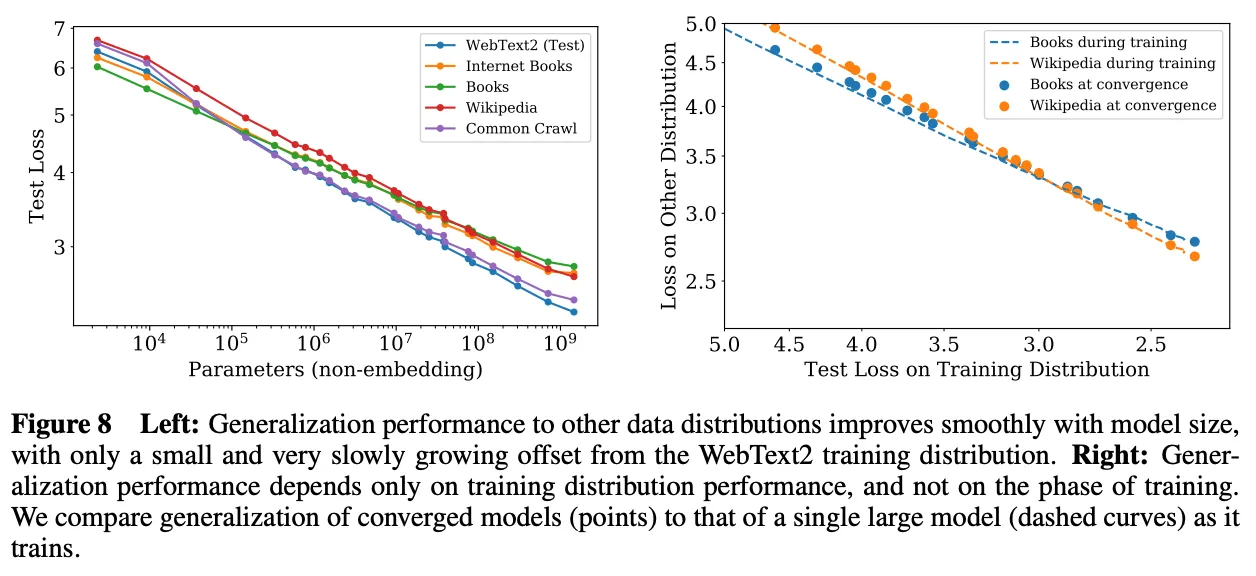

Autres résultats utiles.Outre la loi de puissance observée dans [1], nous avons vu que d'autres facteurs pris en compte, tels que la forme du modèle ou les paramètres architecturaux, ont peu d'impact sur les performances du modèle ; voir ci-dessus. L'échelle est de loin le facteur qui contribue le plus à la création de meilleurs modèles pour les langues de grande taille.L'augmentation du nombre de données, de calculs et de paramètres du modèle entraîne une augmentation régulière des performances du modèle linguistique à grande échelle..

"Les modèles de plus grande taille ont une efficacité d'échantillonnage nettement plus élevée, de sorte que la formation optimale du point de vue informatique consiste à former de très grands modèles sur des quantités relativement modestes de données et à s'arrêter bien avant la convergence". - Source [1]

Il est intéressant de noter que les analyses empiriques de [1] montrent que les grands modèles linguistiques ont tendance à avoir une efficacité d'échantillonnage plus élevée, ce qui signifie qu'ils utilisent moins de données pour atteindre le même niveau de perte de test que les modèles plus petits. C'est la raison pour laquelle leLe pré-entraînement d'un grand modèle linguistique jusqu'à la convergence est (sans doute) sous-optimal.. Au lieu de cela, nous pouvons former des modèles plus importants sur moins de données et arrêter le processus de formation avant la convergence. Cette approche est optimale en termes de quantité de calculs de formation utilisés, mais elle ne tient pas compte des coûts d'inférence. En fait, nous formons généralement des modèles plus petits sur un plus grand nombre de données parce que les modèles plus petits sont moins coûteux à héberger.

Les auteurs ont également analysé en détail la relation entre la taille du modèle et la quantité de données utilisées pour la préformation et ont constaté que la taille de l'ensemble de données n'a pas besoin d'augmenter aussi rapidement que la taille du modèle.L'augmentation de la taille du modèle d'environ 8 fois nécessite une augmentation du volume des données d'apprentissage d'environ 5 fois pour éviter l'overfitting..

(Source [1])

"Ces résultats montrent que les performances de la modélisation linguistique s'améliorent de manière régulière et prévisible lorsque la taille du modèle, les données et les calculs sont correctement dimensionnés. Nous nous attendons à ce que les modèles linguistiques de plus grande taille soient plus performants que les modèles actuels et que l'efficacité de l'échantillonnage soit plus élevée". - Source [1]

Application pratique de la loi de la taille

Le fait que le pré-entraînement à grande échelle soit si bénéfique nous place devant un petit dilemme. Les meilleurs résultats peuvent être obtenus en entraînant de grands modèles sur de grandes quantités de données. Cependant, ces entraînements sont très coûteux etCela signifie qu'ils prennent également beaucoup de risquesEt si nous dépensions 10 millions de dollars pour former un modèle qui ne répond pas à nos attentes ? Que se passe-t-il si nous dépensons 10 millions de dollars pour former un modèle qui ne répond pas à nos attentes ? Compte tenu du coût de la préformation, nous ne pouvons pas procéder à un réglage spécifique du modèle, et nous devons nous assurer que les modèles que nous formons sont performants. Nous devons développer une stratégie pour ajuster ces modèles et prédire leurs performances sans dépenser trop d'argent.

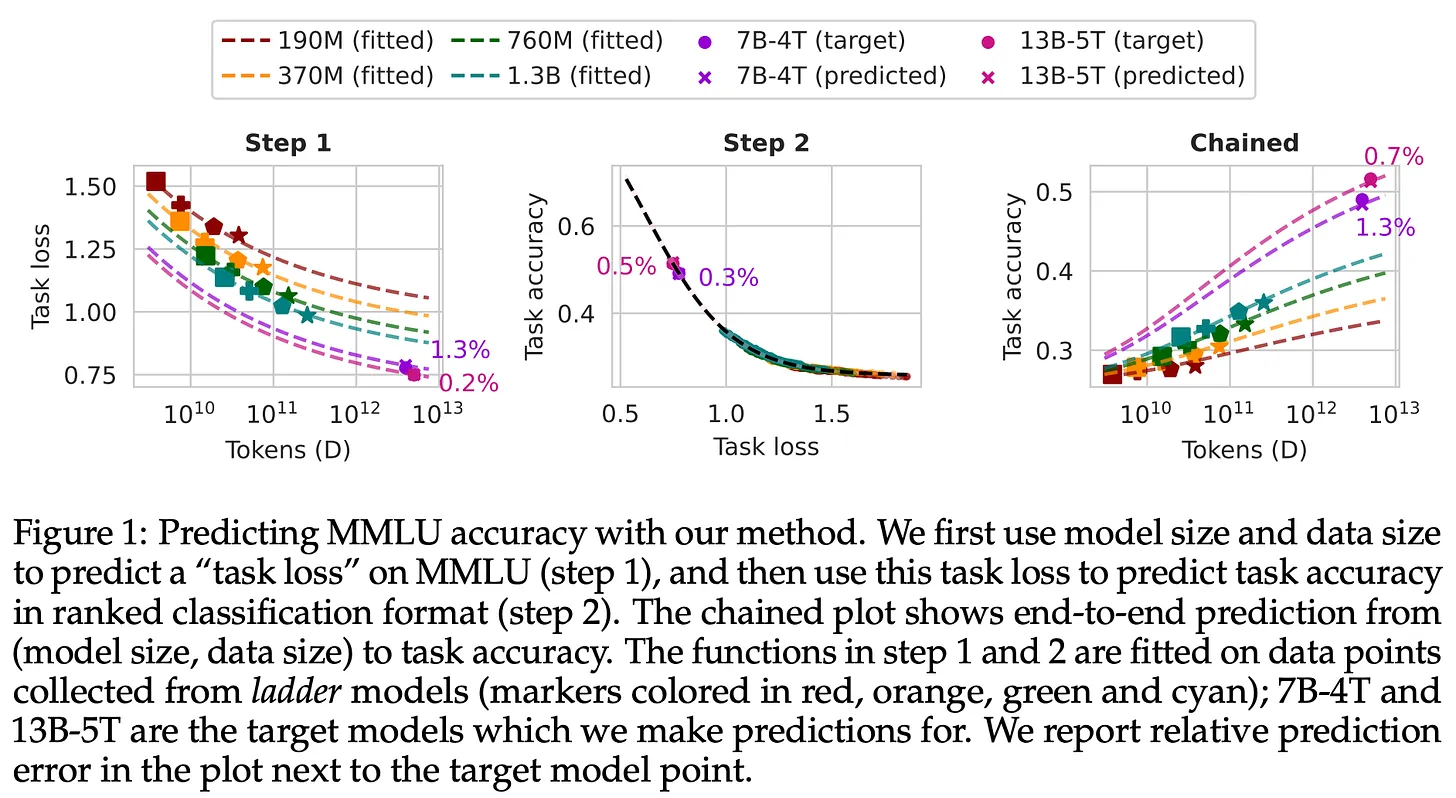

(Source [11])

- Entraîner un ensemble de modèles plus petits en utilisant différents paramètres d'entraînement.

- Adapter la loi d'échelle aux performances des modèles plus petits.

- Déduire la performance de modèles plus grands en utilisant la loi de la taille.

Bien entendu, cette approche a ses limites. Il est difficile et parfois inexact de prédire les performances de modèles plus grands à partir de modèles plus petits. Les modèles peuvent se comporter différemment en fonction de leur taille. Cependant, diverses méthodes ont été proposées pour rendre cette approche plus réalisable, et les lois d'échelle sont désormais couramment utilisées à cette fin. La possibilité d'utiliser les lois d'échelle pour prédire les performances de modèles plus grands nous donne plus de confiance (et de tranquillité d'esprit) en tant que chercheurs. En outre, la loi de taille constitue un moyen simple de justifier les investissements dans la recherche en IA.

Période de mise à l'échelle et de préformation

"C'est ce qui est à l'origine de toutes les avancées que nous observons aujourd'hui - des méga-réseaux neuronaux formés sur d'énormes ensembles de données. - Ilya Sutskever

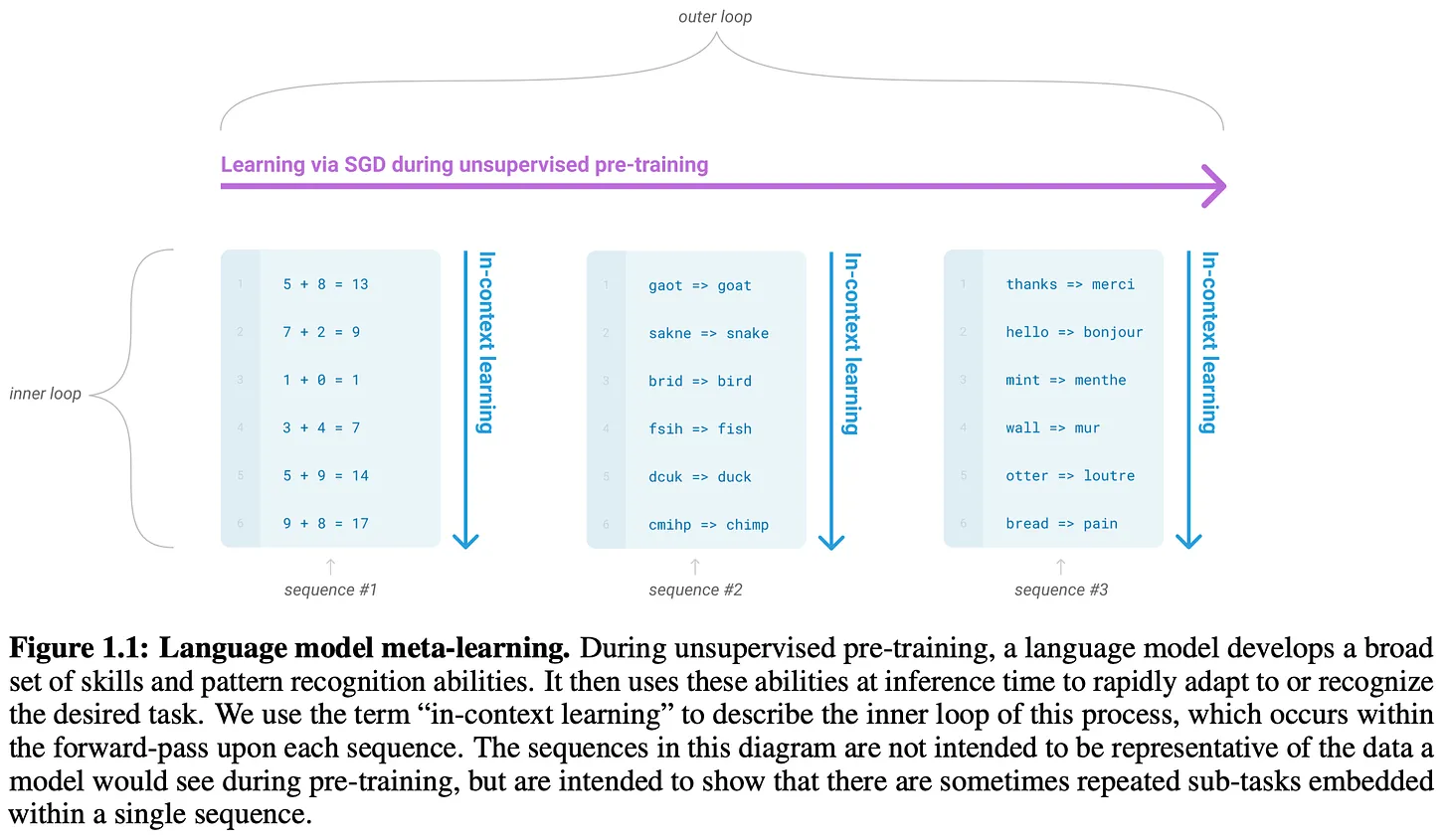

La découverte de la loi d'échelle a catalysé de nombreuses avancées récentes dans l'étude des grands modèles de langage. Pour obtenir de meilleurs résultats, il suffit d'entraîner les modèles sur des ensembles de données plus importants (et de meilleure qualité !) afin d'entraîner des modèles de plus en plus grands. (et de meilleure qualité !) pour entraîner des modèles de plus en plus grands. Cette stratégie a été utilisée pour créer plusieurs modèles de la famille GPT, ainsi que la plupart des modèles bien connus d'équipes extérieures à l'OpenAI. Nous allons ici examiner plus en détail les progrès de cette recherche sur la mise à l'échelle - laRécemment décrite par Ilya Sutskever comme "l'ère de la préformation". 5.

Série GPT : GPT [2], GPT-2 [3], GPT-3 [4] et GPT-4 [5].

Grands modèles linguistiques L'application la plus connue et la plus visible des lois d'échelle est la création de la famille de modèles GPT d'OpenAI. Nous nous concentrerons principalement sur les premiers modèles ouverts de la série - leJusqu'à GPT-3-Parce que :

- Les détails de ces modèles sont partagés plus ouvertement.

- Les modèles ultérieurs ont bénéficié des progrès de la recherche post-formation, tout en développant le processus de préformation.

Nous présenterons également quelques résultats connus de mise à l'échelle, tels que les modèles du GPT-4.

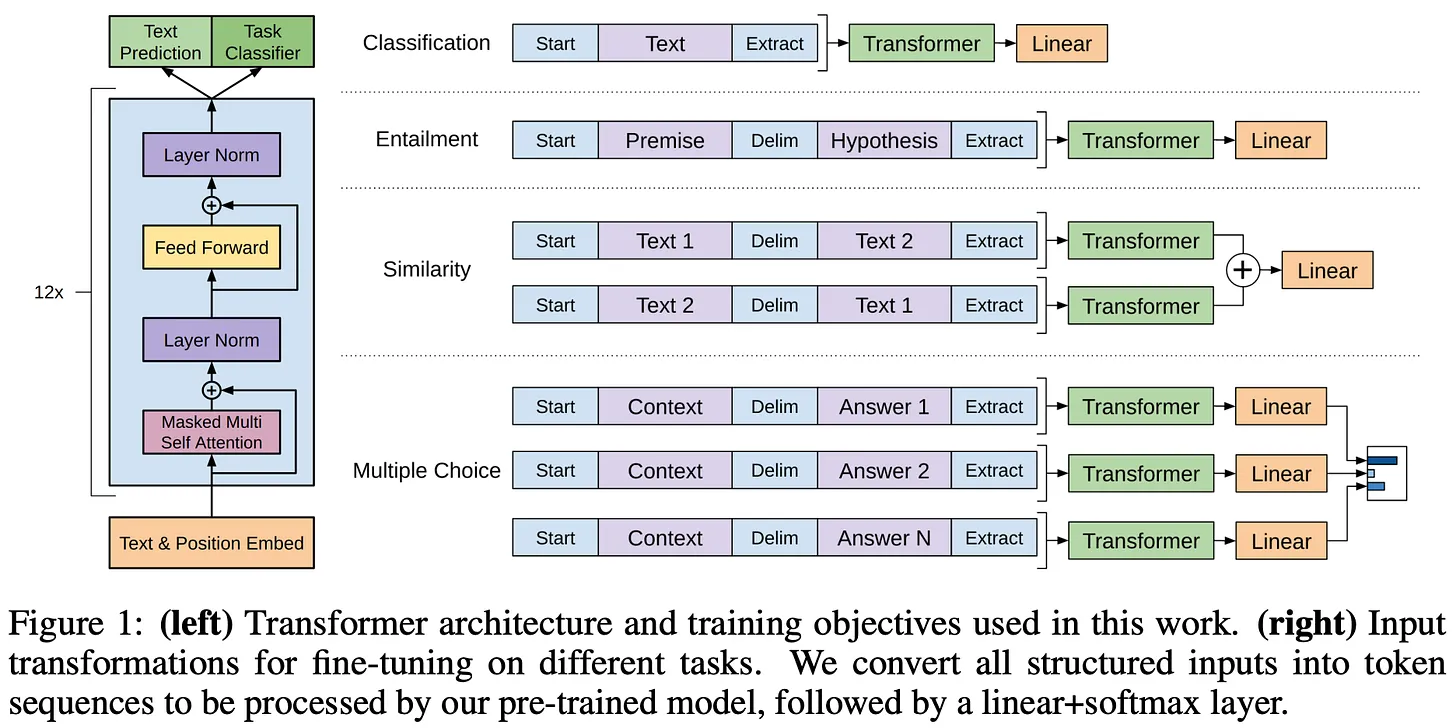

(Source [2])

- Le pré-entraînement auto-supervisé sur un texte plat est très efficace.

- Il est important d'utiliser des textes longs et continus pour le pré-entraînement.

- Ainsi pré-entraînés, les modèles individuels peuvent être affinés pour résoudre une variété de tâches différentes avec une précision de pointe6 .

Dans l'ensemble, GPT n'est pas un modèle particulièrement remarquable, mais il a jeté des bases importantes pour des travaux ultérieurs (par exemple, le Transformer à décodeur seul et le pré-entraînement auto-supervisé) qui ont exploré des modèles similaires à plus grande échelle.

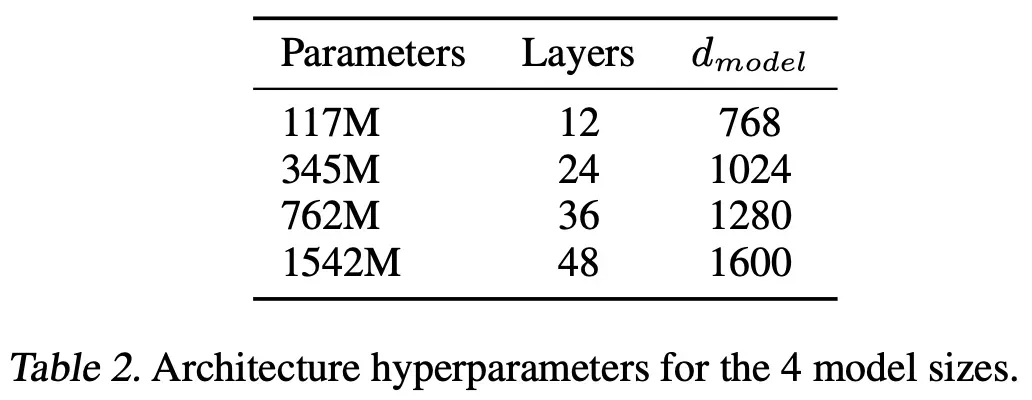

(Source [3])

- Ces modèles sont pré-entraînés sur WebText, qui i) est beaucoup plus important que BooksCorpus, et ii) Créé à partir de données extraites de l'internet.

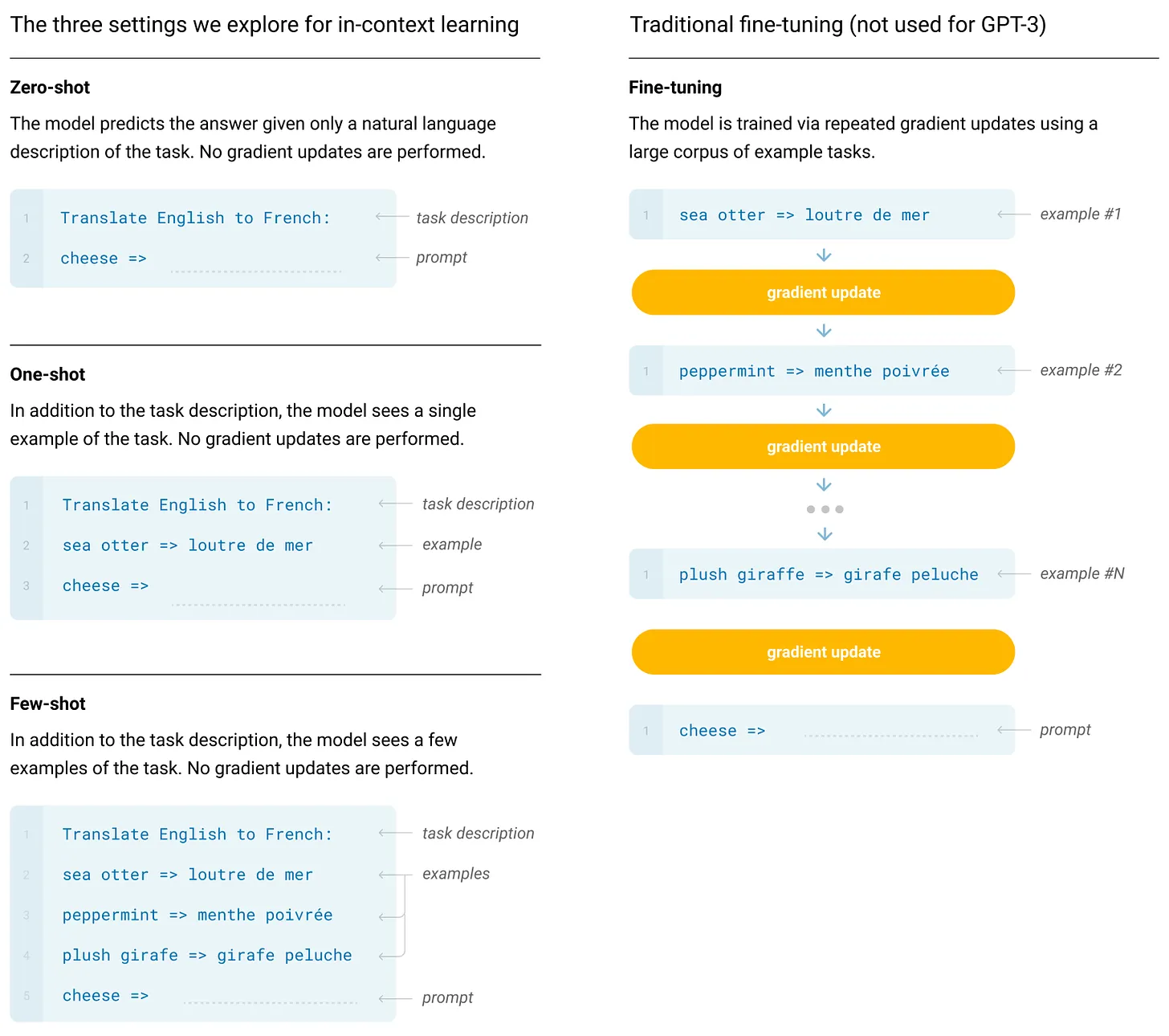

- Ces modèles ne sont pas affinés pour les tâches en aval. Au lieu de cela, nous résolvons la tâche en effectuant une inférence à zéro échantillon7 à l'aide de modèles pré-entraînés.

Les modèles GPT-2 n'atteignent pas l'état de l'art dans la plupart des tests de référence8 , mais leurs performances s'améliorent régulièrement avec l'augmentation de la taille du modèle - le modèle GPT-2 est le plus performant de tous les modèles.L'augmentation du nombre de paramètres du modèle présente des avantages évidentsVoir ci-dessous.

(Source [3])

"Les modèles linguistiques dotés d'une capacité suffisante commenceront à apprendre à déduire et à effectuer des tâches démontrées dans des séquences de langage naturel afin de mieux les prédire, quelle que soit leur méthode d'acquisition. - Source [3]

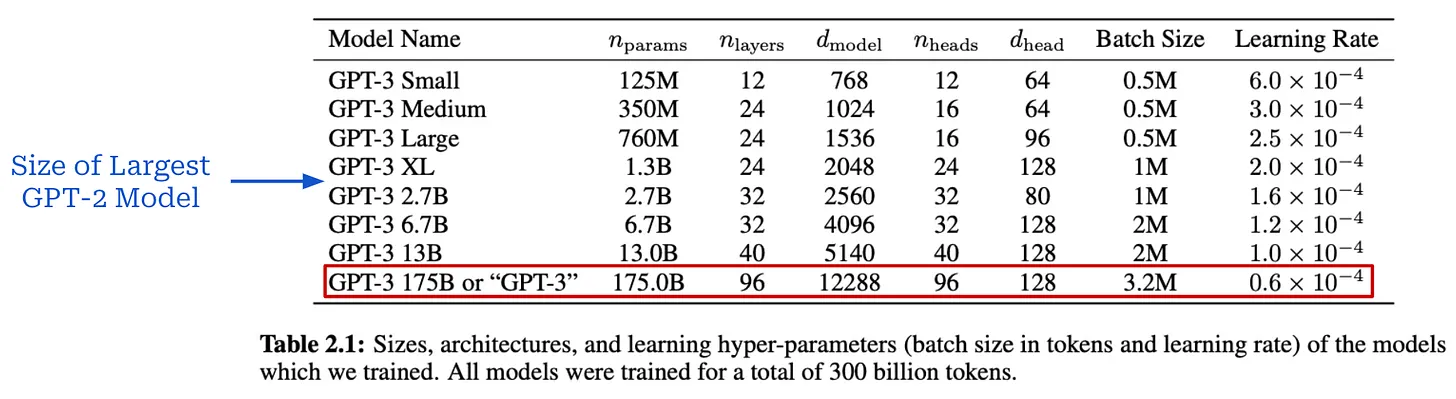

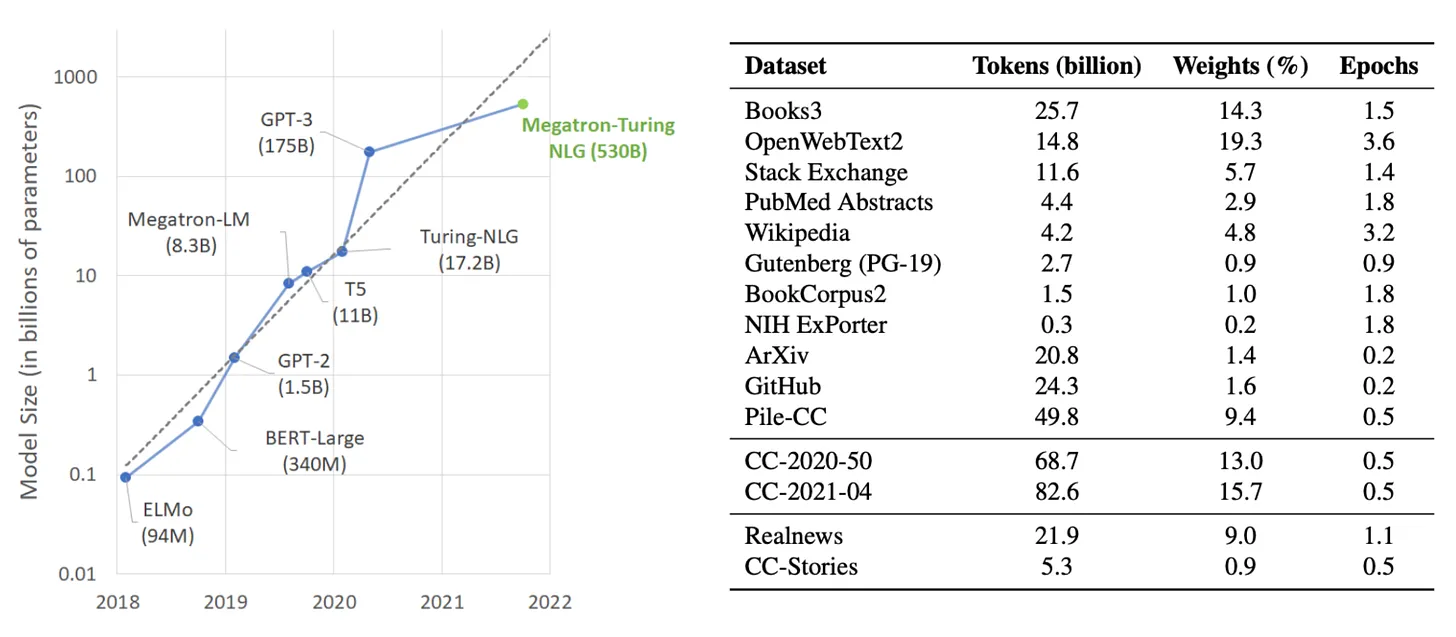

GPT-3 [4] a marqué un tournant dans la recherche en IA en démontrant clairement les avantages du pré-entraînement à grande échelle d'un grand modèle de langage. Avec plus de 175 milliards de paramètres, ce modèle est plus de 100 fois plus grand que le plus grand modèle GPT-2 ; voir ci-dessous.

(Source [4])

(Source [4])

(Source [4])

(Source [4])

(Source [4])

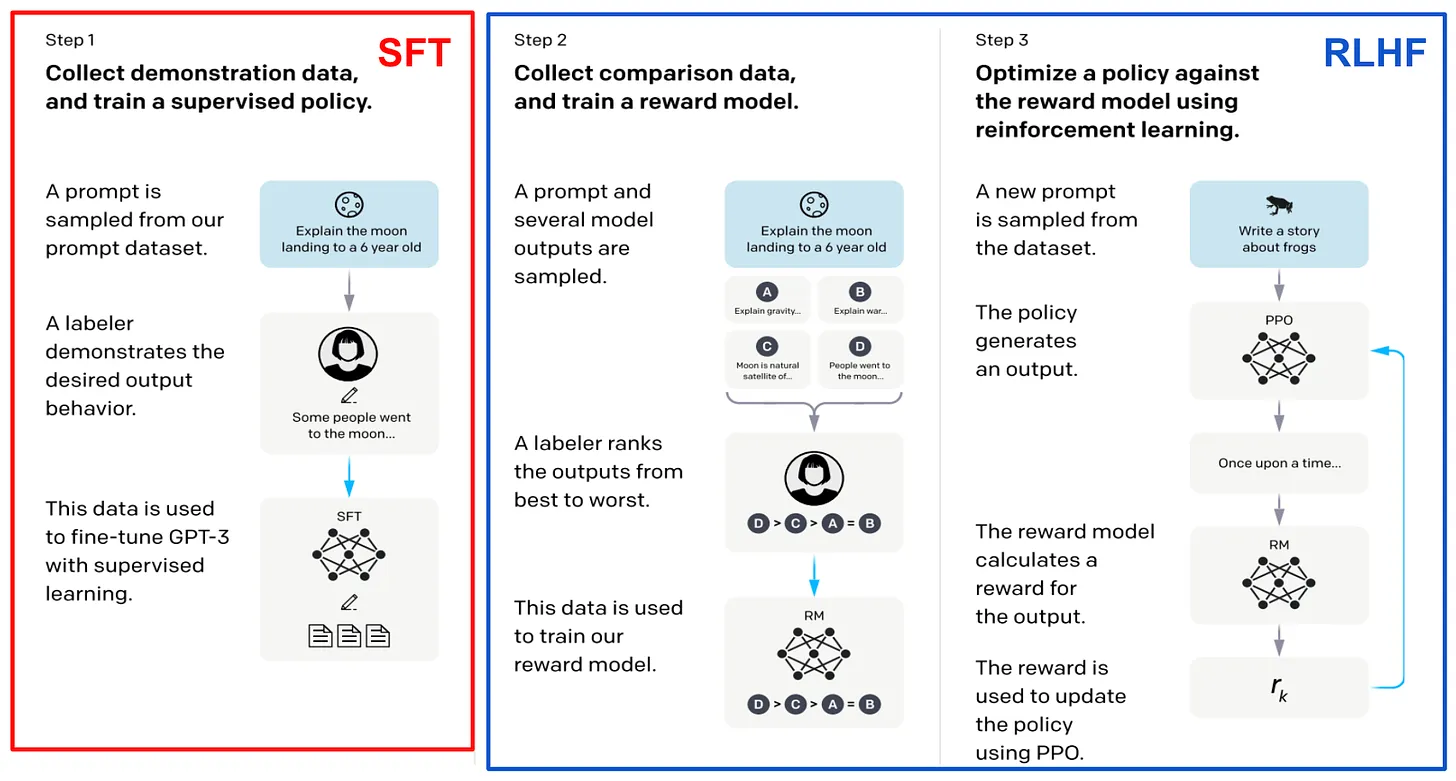

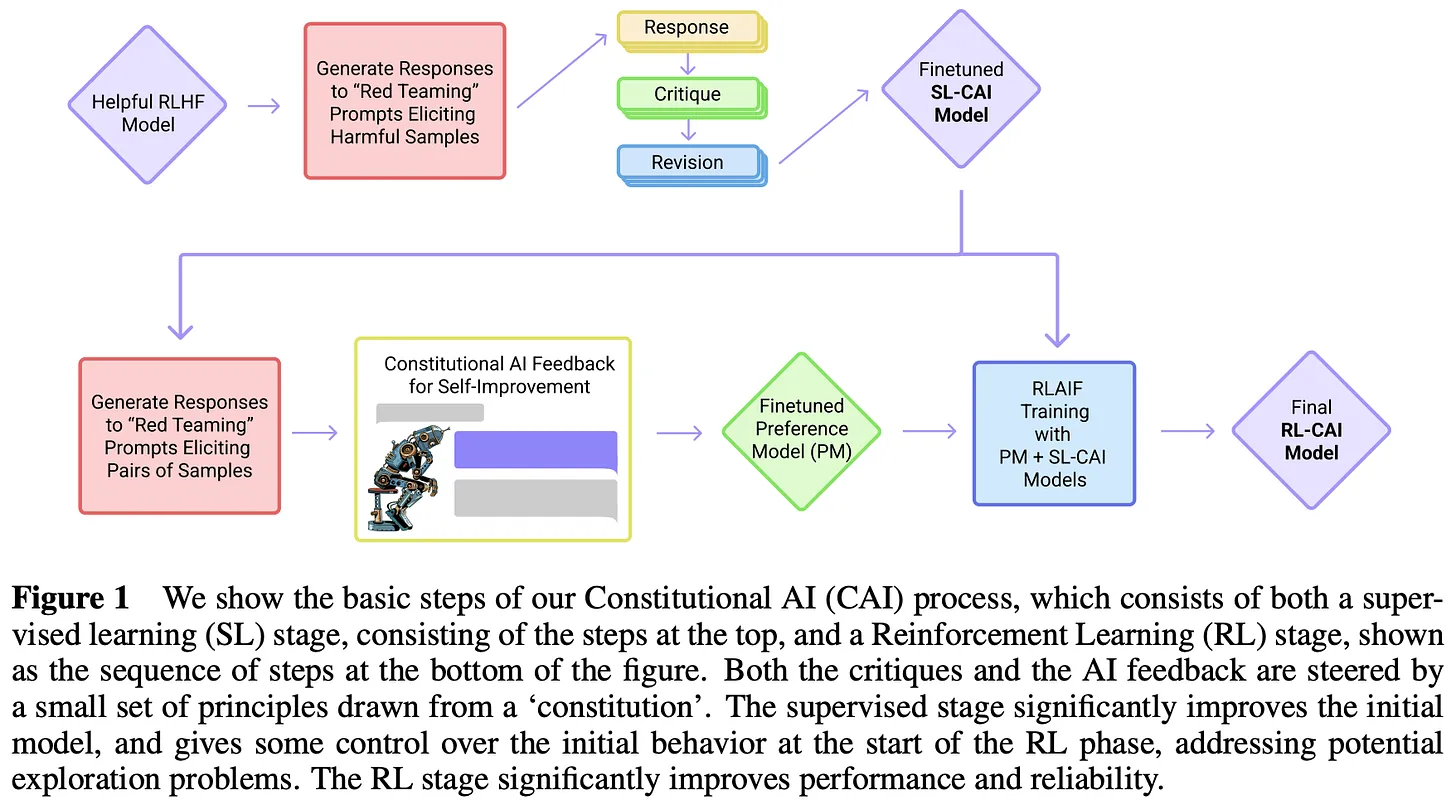

Après GPT-3. Les performances impressionnantes de GPT-3 ont suscité un grand intérêt pour l'étude des grands modèles de langage, en se concentrant principalement sur le pré-entraînement à grande échelle. Les quelques modèles suivants publiés par l'OpenAI - leInstructGPT [8], ChatGPT et GPT-4 [5].--L'utilisation d'une combinaison de pré-entraînement à grande échelle et de nouvelles techniques de post-entraînement (c'est-à-dire le réglage fin supervisé et l'apprentissage par renforcement à partir du retour d'information humain) a considérablement amélioré la qualité des grands modèles de langage. Ces modèles sont si impressionnants qu'ils ont même suscité un regain d'intérêt du public pour la recherche en IA.

"GPT-4 est un modèle basé sur un transformateur qui est pré-entraîné pour prédire le prochain jeton dans un document. Le processus d'alignement post-entraînement améliore la métrique de factorialité et l'adhésion au comportement souhaité." - Source [5]

À ce moment-là, OpenAI a commencé à publier moins de détails sur ses recherches. Au lieu de cela, les nouveaux modèles n'étaient diffusés que par l'intermédiaire de leur API, ce qui empêchait le public de comprendre comment ces modèles avaient été créés. Heureusement, certaines informations utiles peuvent être glanées dans les documents publiés par OpenAI. Par exemple, InstructGPT [8]-ChatGPT prédécesseurs-- Il existe un document connexe qui décrit en détail la stratégie post-entraînement du modèle ; voir ci-dessous. Étant donné que ce document indique également que GPT-3 est le modèle de base pour InstructGPT, il est raisonnable de déduire que l'amélioration des performances du modèle est largement indépendante du processus de pré-entraînement étendu.

(Source [8])

- GPT-4 est basé sur Transformer.

- Le modèle est pré-entraîné en utilisant la prédiction du prochain token.

- Utilisation de données publiques et de données de tiers sous licence.

- Le modèle est affiné grâce à l'apprentissage par renforcement à partir du retour d'information humain.

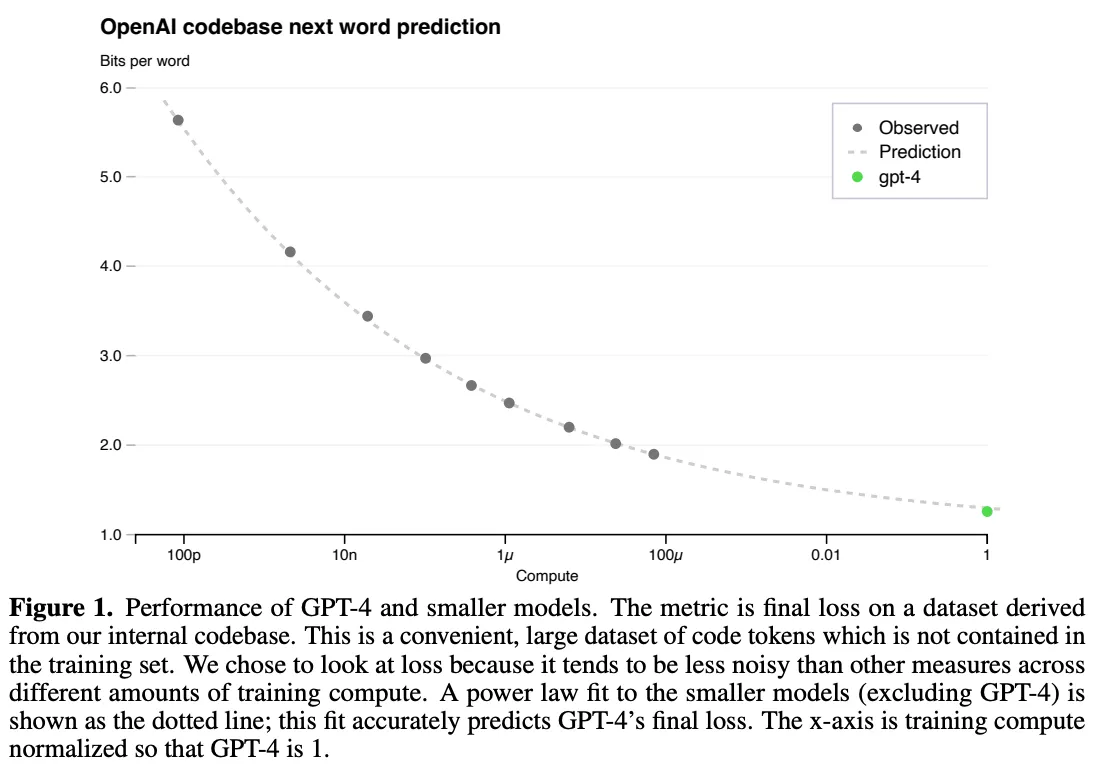

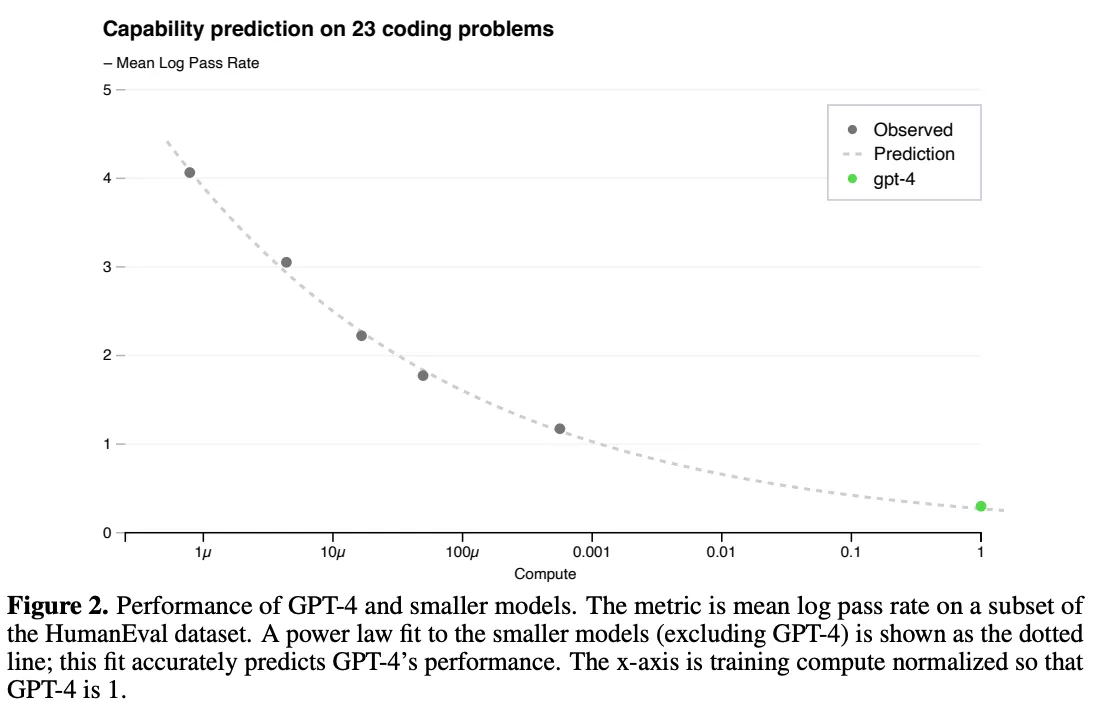

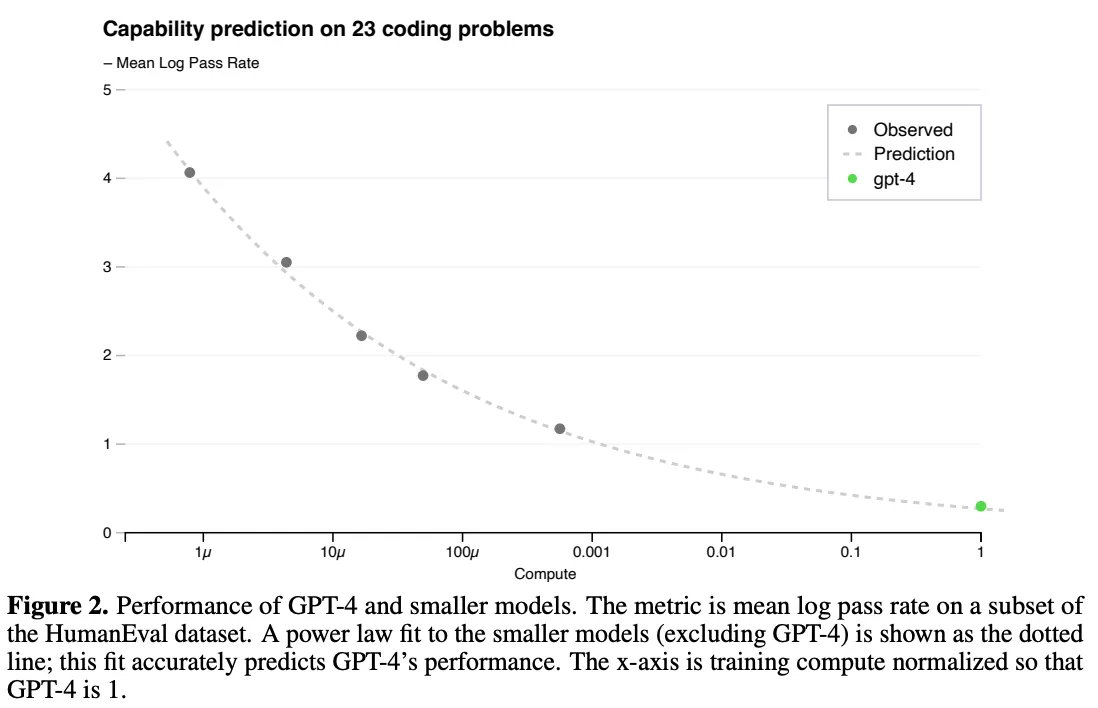

Néanmoins, l'importance de la mise à l'échelle est très apparente dans ce rapport technique. Les auteurs notent que l'un des principaux défis de ce travail est de développer une architecture de formation évolutive qui fonctionne de manière prévisible à différentes échelles, ce qui permet d'extrapoler les résultats des petites séries et donc d'avoir confiance dans les exercices de formation plus importants (et beaucoup plus coûteux !). Les auteurs soulignent qu'il s'agit là d'un défi majeur.

"La perte finale d'un grand modèle linguistique correctement entraîné ...... peut être approximée par une loi de puissance de la quantité de calcul utilisée pour entraîner le modèle." - Source [5]

Une formation préalable massive est très coûteuse, et nous n'avons généralement qu'une seule chance de bien faire les choses...Pas de place pour des ajustements spécifiques au modèle. La loi de la taille joue un rôle clé dans ce processus. Nous pouvons entraîner un modèle en utilisant 1 000 à 10 000 fois moins de calculs et utiliser les résultats de ces entraînements pour ajuster les lois de puissance. Ces lois de puissance peuvent ensuite être utilisées pour prédire les performances de modèles plus importants. En particulier, nous avons vu dans [8] que la performance de GPT-4 a été prédite en utilisant des lois de puissance qui mesurent la relation entre le calcul et la perte de test ; voir ci-dessous.

GPT-4 Formule de loi d'échelle pour l'entraînement (Source [5])

(Source [5])

(Source [5])

Chinchilla. Formation de grands modèles linguistiques optimaux sur le plan informatique [5]

(Source [9])

(Source [10])

(Source [10])

"La quantité de données de formation qui devrait être nécessaire dépasse de loin la quantité de données actuellement utilisées pour former les grands modèles. - Source [6]

Chinchilla.L'analyse fournie dans [6] souligne l'importance de la taille des données.Les modèles de grande taille doivent être entraînés sur un plus grand nombre de données pour obtenir des performances optimales.Pour vérifier ce résultat, les auteurs ont formé un modèle linguistique de 70 milliards de paramètres appelé Chinchilla. Pour vérifier cette découverte, les auteurs ont formé un grand modèle linguistique de 70 milliards de paramètres appelé Chinchilla. Par rapport aux modèles précédents, Chinchilla est plus petit, mais dispose d'un plus grand ensemble de données de pré-entraînement - le1,4 billion de jetons de formation au totalChinchilla utilise les mêmes données et la même stratégie d'évaluation que Gopher [10]. Bien que quatre fois plus petit que Gopher, Chinchilla est toujours plus performant que les modèles plus importants ; voir ci-dessous.

(Source [6])

La "disparition" de la loi d'échelle

La loi d'échelle est récemment devenue un sujet brûlant (et controversé) dans la recherche sur l'IA. Comme nous l'avons vu dans cet aperçu, l'échelle a été le moteur d'une grande partie de l'amélioration de l'IA au cours de l'ère du pré-entraînement. Cependant, alors que le rythme de publication et d'amélioration des modèles ralentit dans la seconde moitié de 202411, nous commençons à voir une remise en question généralisée de la mise à l'échelle des modèles, ce qui semble indiquer que la recherche sur l'IA - l'ère du pré-entraînement - est en train de s'effondrer.En particulier, la loi d'échelle--Il se peut que vous vous heurtiez à un mur.

- Selon Reuters, OpenAI est en train de modifier sa stratégie de produits en raison de goulets d'étranglement dans la mise à l'échelle de son approche actuelle.

- L'information indique que les améliorations du modèle GPT commencent à ralentir.

- Bloomberg met en lumière les difficultés rencontrées par plusieurs laboratoires de pointe qui tentent de mettre au point une IA plus puissante.

- Selon TechCrunch, l'échelle commence à produire des rendements décroissants.

- Time Magazine a publié un article nuancé mettant en lumière les différents facteurs de ralentissement de la recherche sur l'IA.

- Ilya Sutskever a déclaré lors de la conférence NeurIPS'24 que "la préformation telle que nous la connaissons va disparaître "*.

En même temps, de nombreux experts sont d'un avis contraire. Par exemple, (Anthropique Le PDG) a déclaré que la mise à l'échelle *"peut ...... continuer"Et Sam Altman continue de prêcher.l'expression "il n'y a pas de murs "*. Dans cette section, nous ajouterons de la couleur à cette discussion en fournissant une explication éclairée de l'état actuel de l'échelle et des différents problèmes qui peuvent exister.

La réduction d'échelle : qu'est-ce que cela signifie ? Pourquoi cela se produit-il ?

"Les deux affirmations sont probablement vraies : sur le plan technique, la mise à l'échelle fonctionne toujours. Pour les utilisateurs, le taux d'amélioration est en train de ralentir". - Nathan Lambert

Donc ......Le passage à l'échelle est-il en train de ralentir ? La réponse est complexe et dépend en grande partie de notre définition précise du "ralentissement". Jusqu'à présent, ma réponse la plus plausible à cette question est que les deux réponses sont correctes. C'est pourquoi nous ne tenterons pas de répondre à cette question. Au lieu de cela, nous allons approfondir ce qui est dit sur ce sujet afin de pouvoir construire une compréhension plus nuancée de l'état actuel (et futur) de la mise à l'échelle des grands modèles de langage.

Que nous apprend la loi d'échelle ?Tout d'abord, nous devons revoir la définition technique de la loi de la taille. La loi de la taille définit la relation entre le calcul d'apprentissage (ou la taille du modèle/de l'ensemble de données) et la perte de test d'un modèle linguistique de grande taille selon une loi de puissance. Cependant, la loi de laLa nature de cette relation est souvent mal comprise. L'idée d'obtenir des gains de performance exponentiels à partir d'une croissance logarithmique des calculs est un mythe. La loi d'échelle ressemble plutôt à une décroissance exponentielle, ce qui signifie qu'au fil du temps, nous devrons travailler plus dur pour obtenir de nouveaux gains de performance ; voir ci-dessous.

(Source [5])

"Les praticiens utilisent généralement la précision de référence en aval comme indicateur de la qualité du modèle, plutôt que la perte sur l'ensemble d'évaluation de la perplexité". - Source [7]

Définir la performance.Comment mesurer l'amélioration du modèle linguistique Big Language ? Du point de vue de la loi d'échelle, la performance d'un grand modèle linguistique est généralement mesurée par la perte de test du modèle pendant le pré-entraînement, mais l'effet d'une perte de test plus faible sur la capacité d'un grand modèle linguistique n'est pas clair.La diminution des pertes entraîne-t-elle une plus grande précision dans les tâches en aval ? La réduction des pertes permettra-t-elle de développer de nouvelles capacités pour les modèles linguistiques de grande taille ? Il y a un décalage entre ce que la loi d'échelle nous dit et ce qui nous intéresse réellement :

- La loi de la taille nous indique que l'augmentation de la taille du pré-entraînement réduira progressivement la perte de test des modèles de langage de grande taille.

- Notre objectif est d'obtenir un "meilleur" modèle de la langue dans son ensemble.

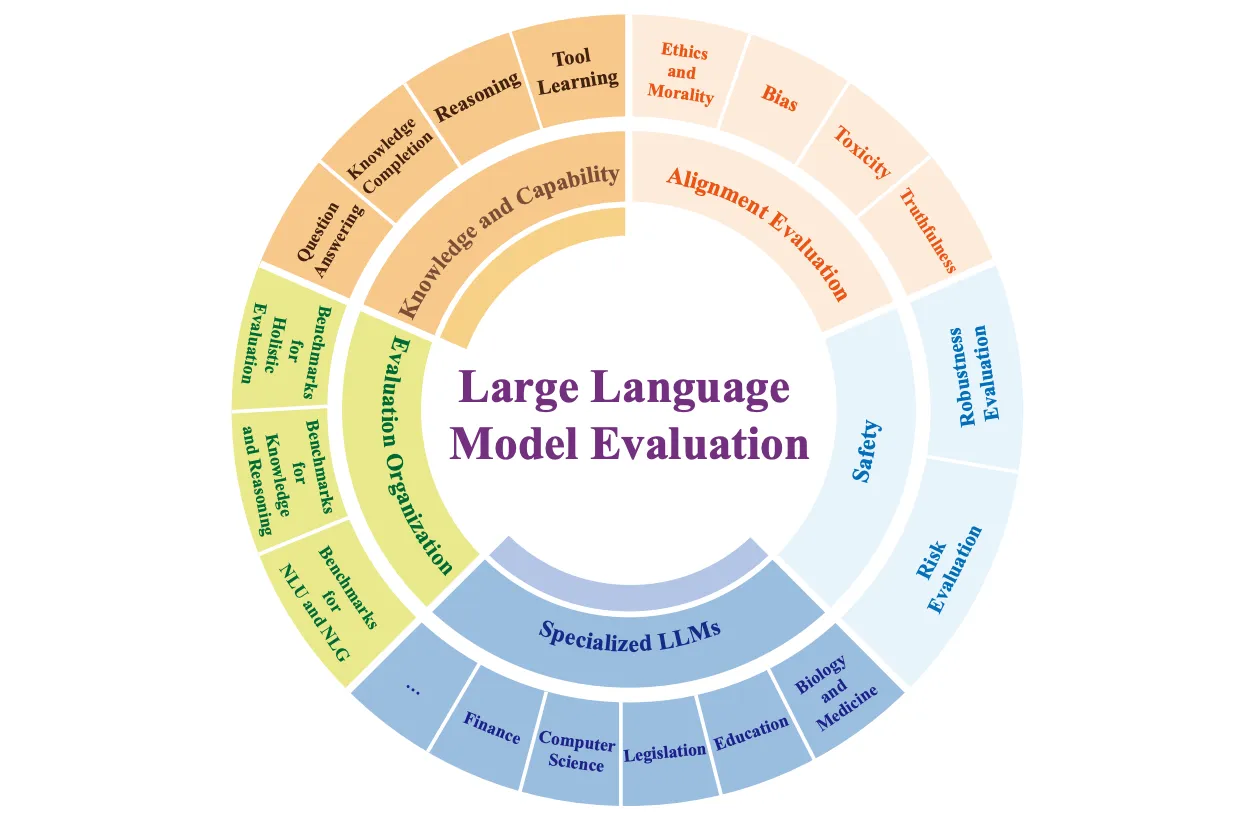

En fonction de qui vous êtes et de ce que vous attendez d'un nouveau système d'IA...et les méthodes utilisées pour évaluer ces nouveaux systèmes-seront très différents. Les utilisateurs ordinaires de l'IA ont tendance à se concentrer sur les applications de chat à usage général, tandis que les praticiens s'intéressent souvent aux performances des grands modèles de langage pour les tâches en aval. En revanche, les chercheurs des laboratoires de pointe semblent avoir des attentes élevées (et très spécifiques) à l'égard des systèmes d'IA ; par exemple, rédiger des thèses de doctorat ou résoudre des problèmes de raisonnement mathématique avancés. Compte tenu du large éventail de capacités difficiles à évaluer, il existe de nombreuses façons d'examiner les performances des grands modèles de langage ; voir ci-dessous.

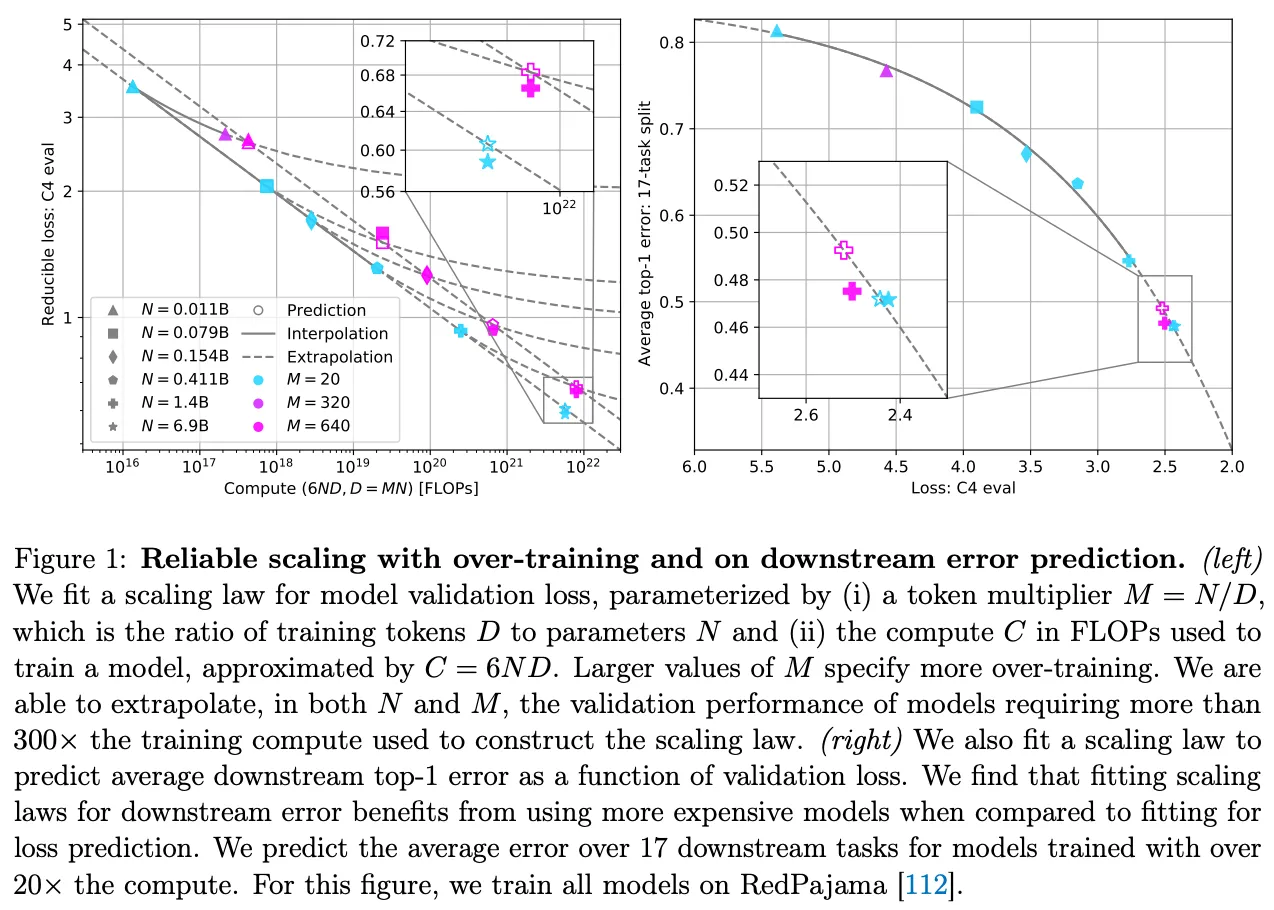

(Source [15])

La disparition des données.Afin d'augmenter la préformation de grands modèles de langage, nous devons augmenter la taille du modèle et de l'ensemble de données. Les premières recherches [1] semblent suggérer que la quantité de données est moins importante que la taille du modèle, mais Chinchilla [6] montre que la taille de l'ensemble de données est tout aussi importante. En outre, des travaux récents suggèrent que la plupart des chercheurs préfèrent "surentraîner" leurs modèles.ou les pré-entraîner sur des ensembles de données dont la taille dépasse l'optimalité de Chinchilla-afin de réduire les coûts d'inférence [7].

"Les études de mise à l'échelle se concentrent souvent sur le calcul des mécanismes d'entraînement optimaux ....... Étant donné que les grands modèles sont plus coûteux à raisonner, il est désormais courant de surentraîner les petits modèles." - Source [7]

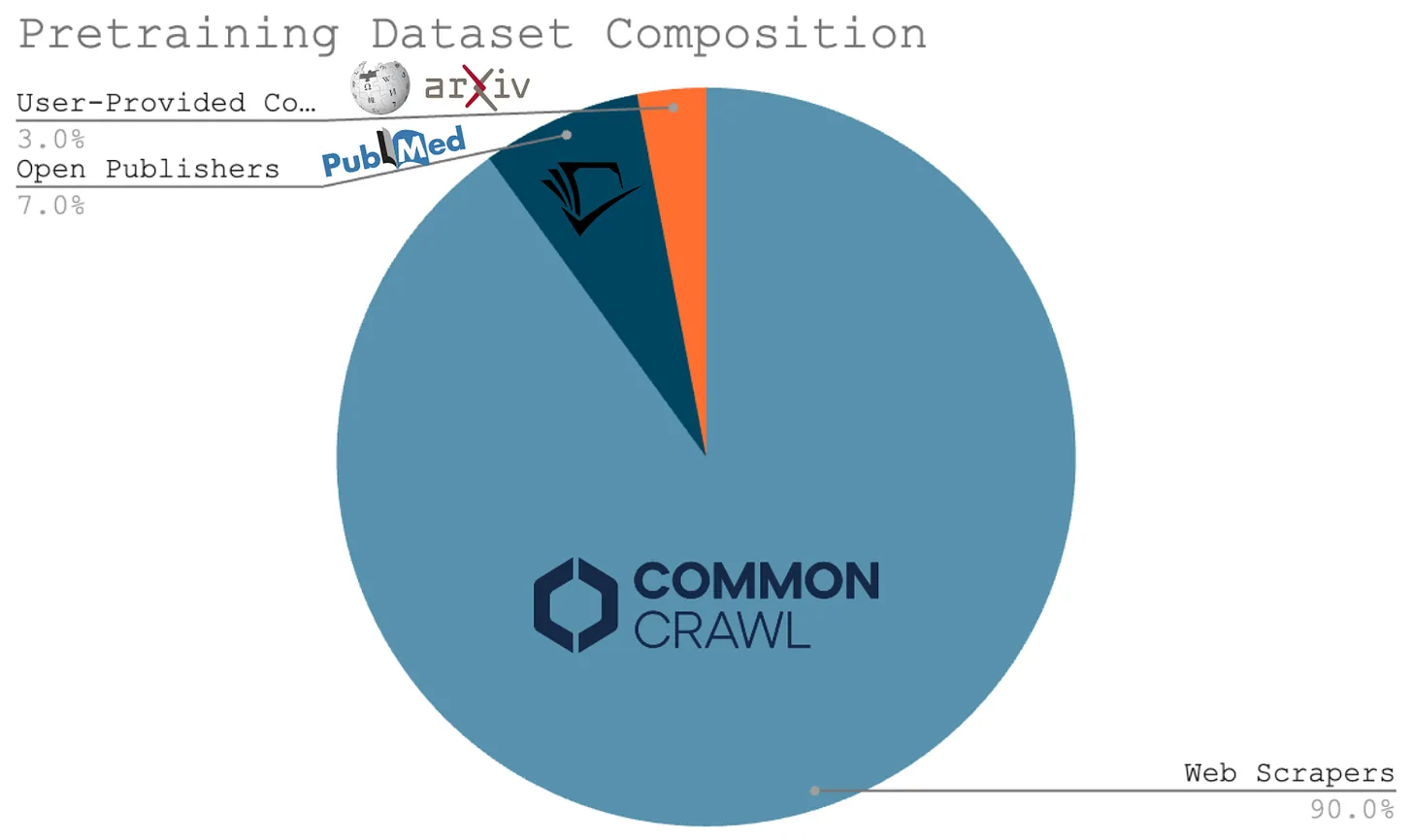

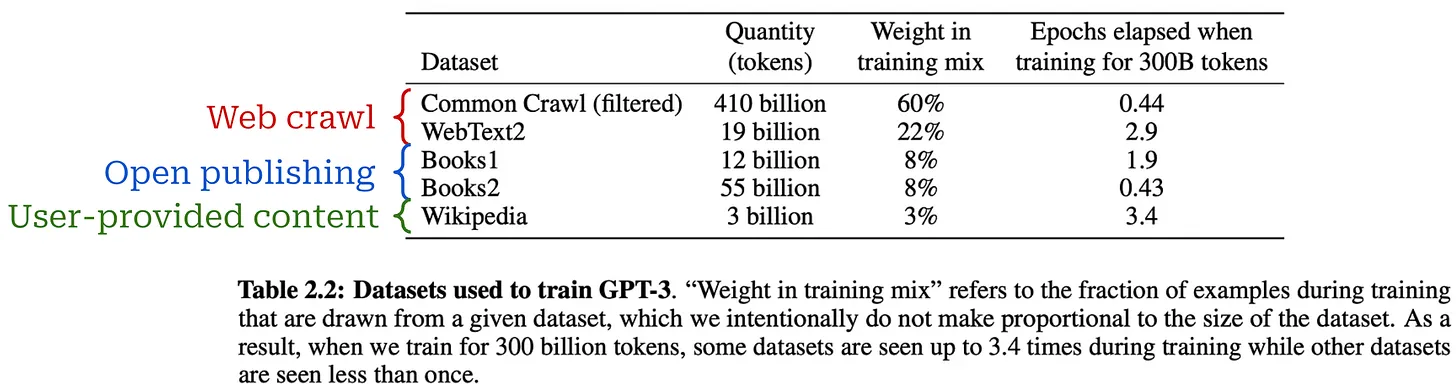

Toutes ces études nous amènent à une conclusion simple : lesExtension des grands modèles linguistiques Le pré-entraînement nécessitera la création d'ensembles de données de pré-entraînement plus importants.Ce fait constitue l'une des principales critiques de la loi de la taille pour les grands modèles de langage. Ce fait constitue l'une des principales critiques de la loi de la taille pour les modèles linguistiques de grande taille. De nombreux chercheurs ont fait valoir qu'il n'y avait peut-être pas assez de données pour continuer à mettre à l'échelle le processus de pré-entraînement. Pour rappel, la grande majorité des données de pré-entraînement utilisées pour le Big Language Model actuel ont été obtenues par l'exploration du web (voir ci-dessous). Étant donné que nous n'avons qu'un seul Internet, il pourrait être difficile de trouver des sources entièrement nouvelles de données de pré-entraînement à grande échelle et de haute qualité.

Même Ilya Sutskever a récemment avancé cet argument, affirmant que i) L'informatique se développe rapidement, mais ii) Les données n'ont pas augmenté en raison de la dépendance à l'égard de l'exploration du web. Par conséquent, il affirme que nous ne pouvons pas continuer à développer le processus de pré-entraînement indéfiniment. Le pré-entraînement tel que nous le connaissons arrivera à son terme, et nous devons trouver de nouveaux moyens de faire progresser la recherche sur l'IA. En d'autres termes."Nous avons atteint le pic de données..

Nouvelle génération d'échelle de pré-entraînement

La mise à l'échelle finira par entraîner des rendements décroissants, et les arguments centrés sur les données contre la poursuite de la mise à l'échelle sont à la fois raisonnables et convaincants. Cependant, il existe encore plusieurs axes de recherche qui pourraient améliorer le processus de pré-entraînement.

Données synthétiques.Afin d'augmenter le processus de pré-entraînement de plusieurs ordres de grandeur, nous pourrions avoir besoin de nous appuyer sur des données générées synthétiquement. Malgré les inquiétudes selon lesquelles une dépendance excessive à l'égard des données synthétiques peut entraîner des problèmes de diversité [14], nous constatons que les grands modèles de langage sont de plus en plus souvent utilisés pour l'apprentissage de la langue.Et elle semble avoir réussi à--en utilisant des données synthétiques [12]. En outre, l'apprentissage par cours [13] et les stratégies de préformation continue ont conduit à diverses améliorations significatives en ajustant les données de préformation, par exemple en modifiant la combinaison de données ou en ajoutant des données d'instruction à la fin de la préformation.

(Source [7])

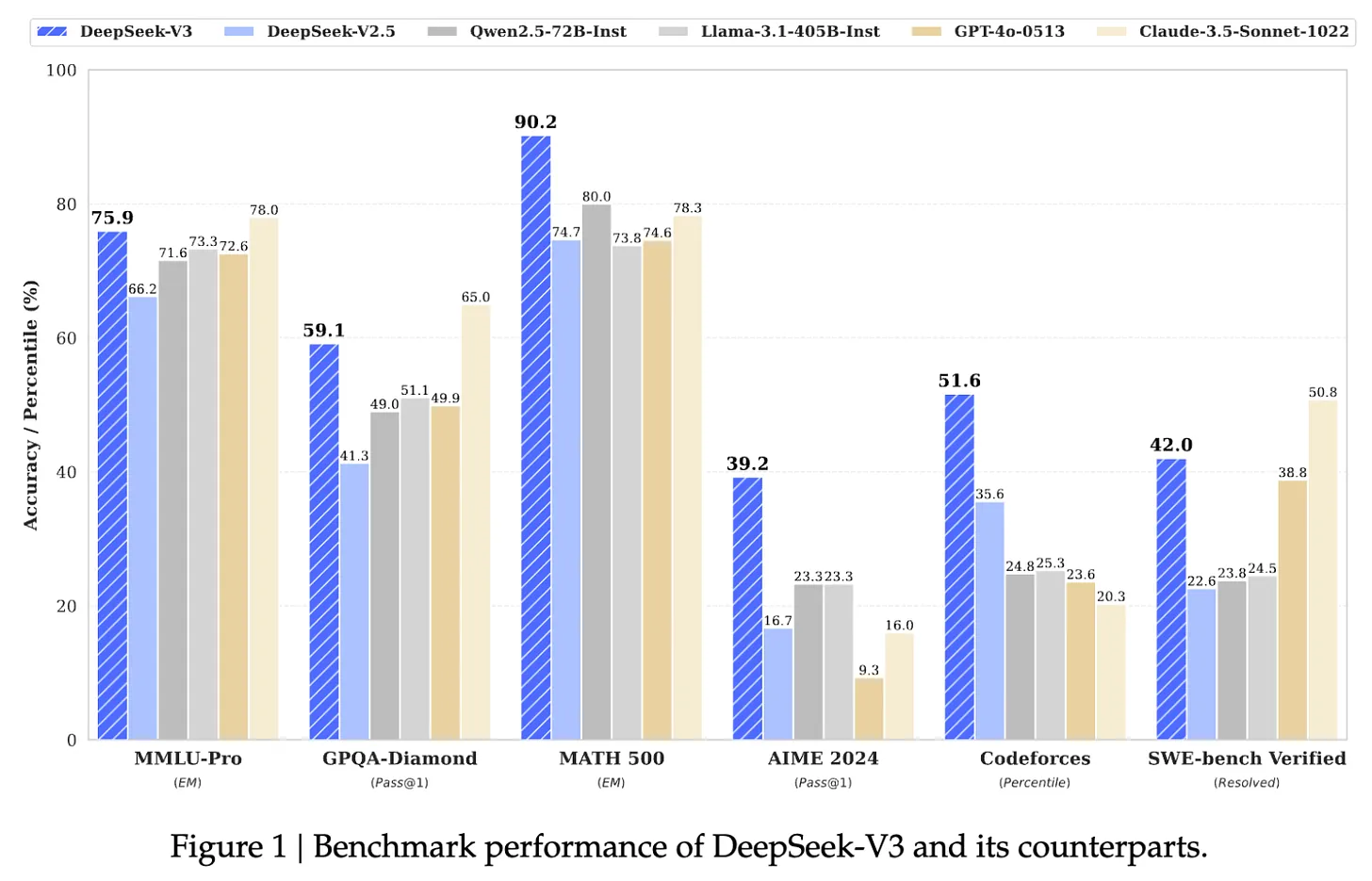

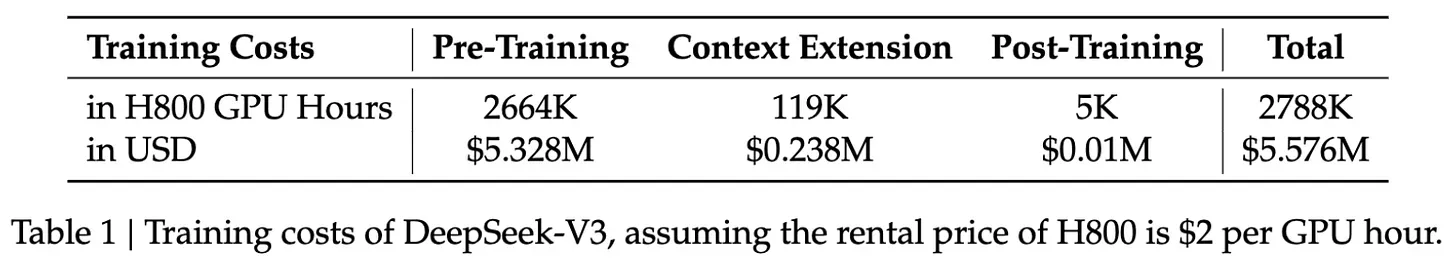

DeepSeek-v3.Malgré les récents débats, nous continuons à voir des avancées semi-fréquentes en étendant le processus de pré-entraînement pour les grands modèles de langage. Par exemple, la récente version de DeepSeek-v3 [18] - le modèle de langage le plus complet du monde - a permis d'améliorer le processus de pré-entraînement.Un paramètre de 671 milliards12 (MoE) modèle. En plus d'être open source, le modèle a été pré-entraîné sur 14,8 trillions de tokens de texte et a surpassé à la fois GPT-4o et Claude-3.5-Sonnet ; voir le graphique ci-dessous pour la performance du modèle et ici pour la licence. À titre de référence, le modèle LLaMA-3 a été entraîné sur plus de 15 billions de données textuelles brutes ; voir ici pour plus de détails.

(Source [18])

- Architecture MoE optimisée de DeepSeek-v2.

- Une nouvelle stratégie de perte sans aide pour l'équilibrage de la charge MoE.

- Prédiction multi-token des objectifs de formation.

- Affiner les capacités de raisonnement à partir de modèles de chaînes de pensée longues (similaires à l'o1 d'OpenAI).

Le modèle a également fait l'objet d'un post-entraînement, comprenant un réglage fin supervisé et un apprentissage par renforcement à partir du retour d'information humain afin de l'aligner sur les préférences de l'homme.

"Nous avons entraîné DeepSeek-V3 sur 14,8 trillions de tokens divers et de haute qualité. Le processus de pré-entraînement a été très stable. Nous n'avons pas connu de pics de pertes irrécupérables et nous n'avons pas eu à revenir en arrière tout au long du processus d'entraînement. - Source [8]

Cependant, la clé de la performance impressionnante de DeepSeek-v3 est l'échelle de pré-entraînement - leIl s'agit d'un modèle de grande taille formé sur un ensemble de données tout aussi important.DeepSeek-v3 a un processus de pré-entraînement étonnamment stable et suit la norme des grands modèles de langage à un coût très bas ! DeepSeek-v3 dispose d'un processus de pré-entraînement étonnamment stable et est entraîné à un coût raisonnable conformément à la norme des grands modèles de langage ; voir ci-dessous.Ces résultats suggèrent que les opérations de pré-entraînement plus importantes deviennent plus faciles à gérer et plus efficaces au fil du temps.

(Source [18])

- Des grappes de calcul plus importantes13.

- Plus de matériel (et de meilleure qualité).

- Beaucoup de puissance.

- de nouveaux algorithmes (par exemple, pour l'entraînement distribué à grande échelle).

Former des modèles de nouvelle génération n'est pas seulement une question de financement pour plus de GPU ; c'est un exploit d'ingénierie multidisciplinaire. Une entreprise aussi complexe prend du temps. À titre de référence, le GPT-4 a été publié en mars 2023, près de trois ans après la publication du GPT-3 - leEn particulier, 33 mois. On peut raisonnablement s'attendre à ce qu'un délai similaire (voire plus long) permette de multiplier encore l'échelle par 10 à 100.

"À chaque ordre de grandeur de la croissance de l'échelle, il faut trouver des innovations différentes. - Ege Erdil (Epoch AI)

L'avenir de la recherche en IA

Maintenant que nous avons une meilleure compréhension de l'état de la préformation à grande échelle, supposons (uniquement pour les besoins de cette discussion) que la recherche sur la préformation se heurte soudainement à un mur. Même si les capacités des modèles ne s'améliorent pas du tout dans un avenir proche, il existe un certain nombre de moyens par lesquels la recherche en IA peut continuer à évoluer rapidement. Nous avons déjà abordé certains de ces sujets (par exemple, les données synthétiques). Dans cette section, nous nous concentrerons sur deux thèmes actuellement populaires :

- Système/agent de modèles linguistiques à grande échelle.

- Modèles de raisonnement.

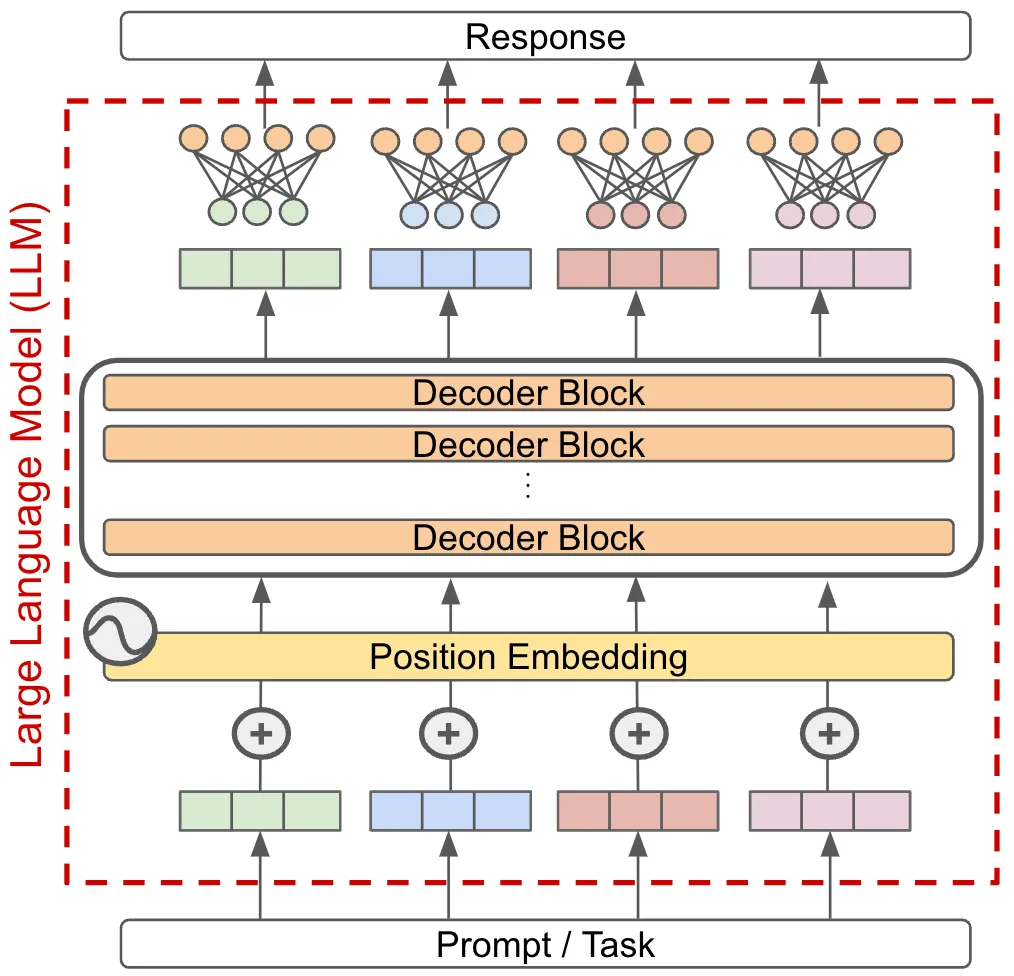

Construire un système utile de modélisation des langues étendues

La plupart des applications actuelles basées sur des modèles de Big Language fonctionnent selon un paradigme de modèle unique. En d'autres termes, nous résolvons une tâche en la transmettant à un seul Big Language Model et en utilisant directement la sortie du modèle comme réponse à cette tâche ; voir ci-dessous.

Si nous voulions améliorer un tel système (c'est-à-dire résoudre des tâches plus difficiles avec une plus grande précision), nous pourrions simplement améliorer les capacités du modèle sous-jacent, mais cette approche repose sur la création de modèles plus puissants. Au lieu de cela, nous pouvons dépasser le paradigme du modèle unique en construisant un système basé sur un modèle de grande langue qui combine plusieurs modèles de grande langue - leou autre composant-- pour résoudre des tâches complexes.

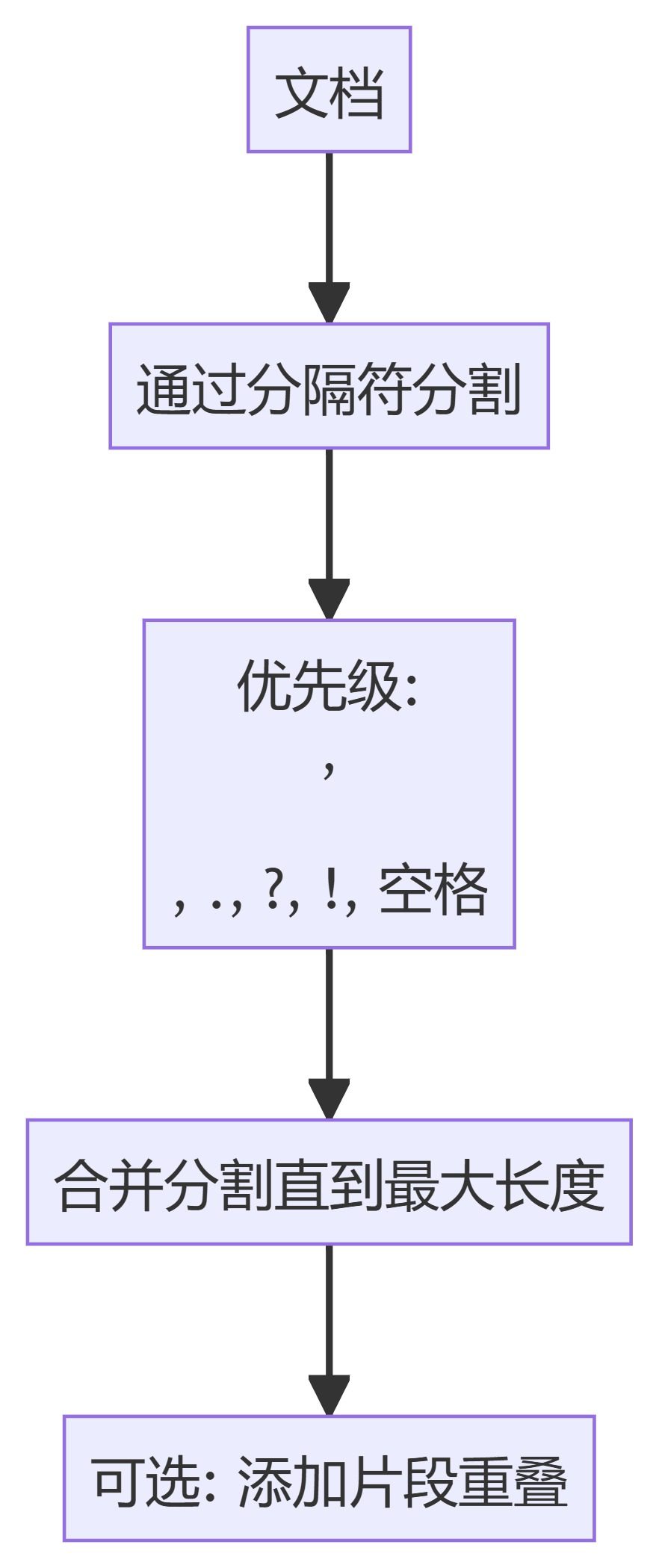

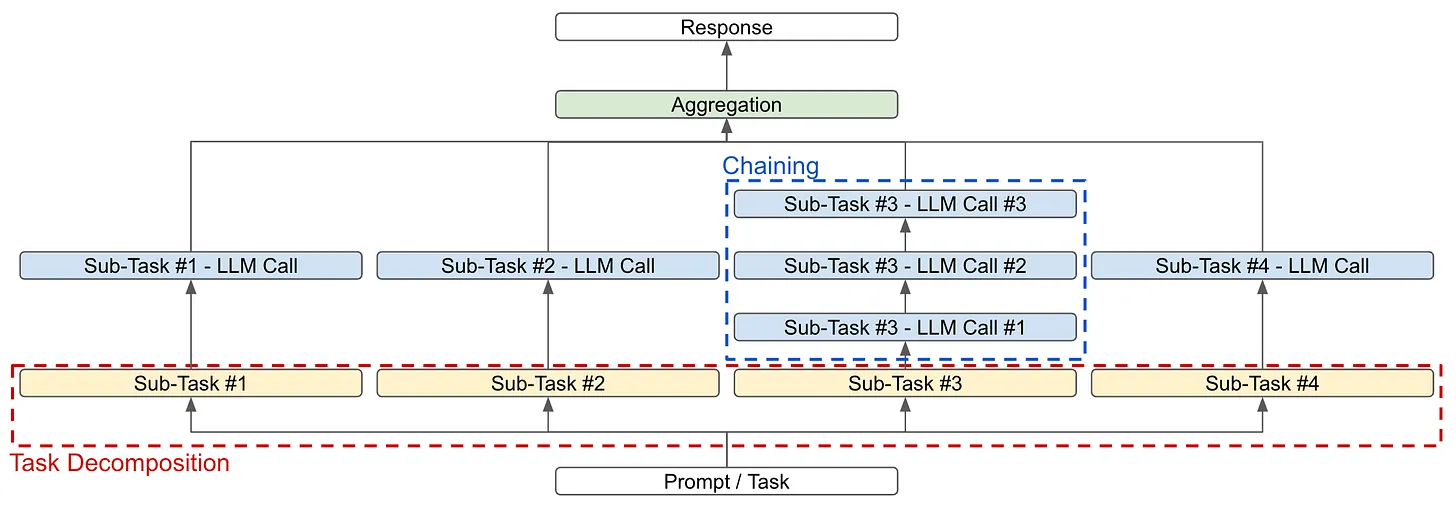

Fondements des systèmes de modélisation des grands langages. L'objectif d'un système de Big Language Model est de décomposer des tâches complexes en parties plus petites qui peuvent être plus facilement résolues par le Big Language Model ou d'autres modules. Deux stratégies principales peuvent être utilisées pour atteindre cet objectif (comme le montre la figure ci-dessus) :

- Répartition des tâchesLa tâche elle-même est divisée en sous-tâches plus petites qui peuvent être résolues individuellement et agrégées plus tard14 pour former la réponse finale.

- lien (sur un site web)Les tâches ou sous-tâches sont résolues en effectuant plusieurs appels séquentiels au grand modèle de langage plutôt qu'un seul appel.

Ces stratégies peuvent être utilisées individuellement ou en tandem. Par exemple, supposons que nous voulions construire un système pour résumer des livres. Pour ce faire, nous pouvons décomposer la tâche en commençant par résumer chaque chapitre du livre. À partir de là, nous pouvons :

- Résumer la tâche en la décomposant en plus petits morceaux de texte (comme pour la décomposition récursive/hiérarchique).

- Lier plusieurs appels de LM ensemble ; par exemple, demander à un LM d'extraire tous les faits ou informations importants d'un chapitre, et à un autre LM de générer un résumé du chapitre sur la base de ces faits clés.

Nous pouvons ensuite agréger ces résultats en demandant au Big Language Model de résumer les résumés des chapitres connectés pour former un résumé de l'ensemble du roman. Le fait que la plupart des tâches complexes puissent être décomposées en parties simples et faciles à résoudre rend ces systèmes de modélisation du langage très puissants. Au fur et à mesure que nous procédons à une décomposition et à une mise en relation plus poussées, ces systèmes peuvent devenir très complexes, ce qui en fait un domaine intéressant (et influent) de la recherche appliquée en matière d'intelligence artificielle.

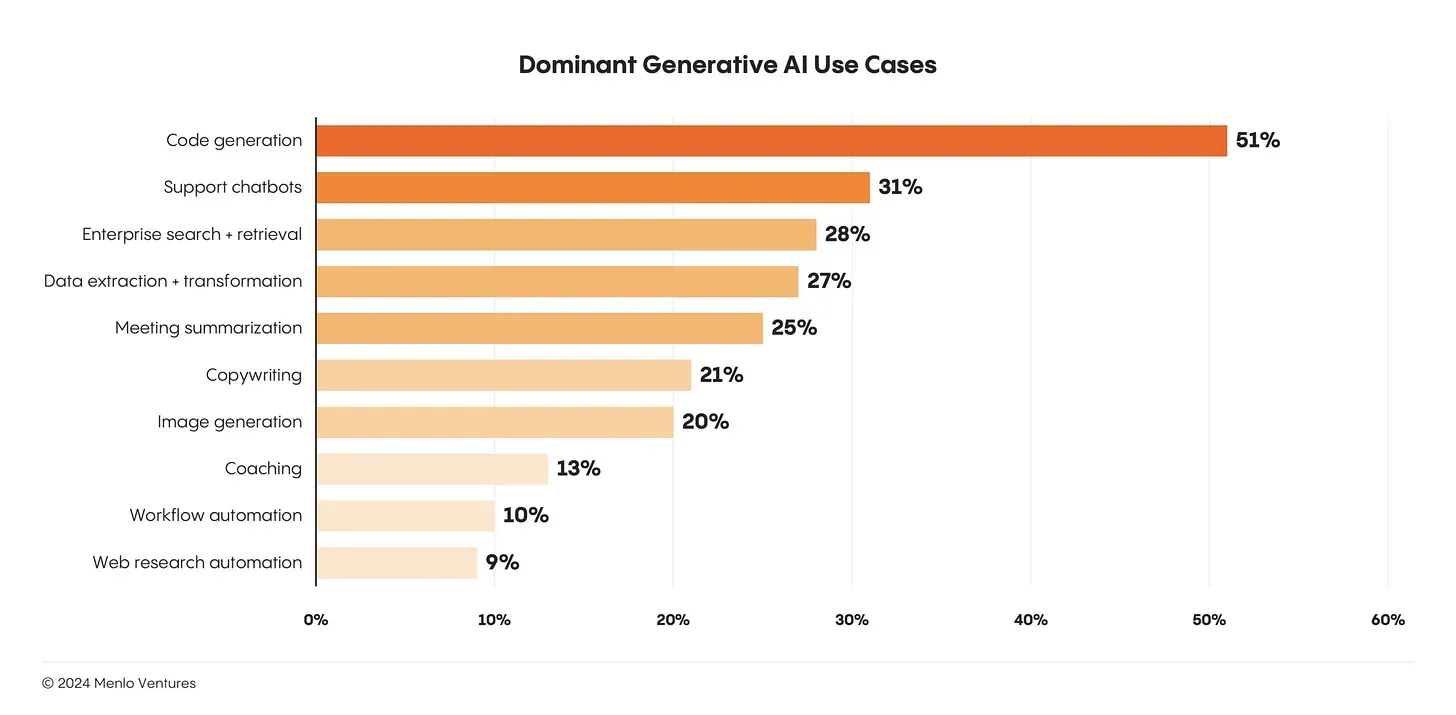

Construire des produits basés sur le Big Language Model.Malgré le succès et la popularité du modèle du grand langage, le nombre de cas d'utilisation réels (et largement adoptés) du modèle du grand langage est encore très faible. Aujourd'hui, les cas d'utilisation les plus importants du modèle du grand langage sont la génération de code et le chat, deux applications relativement évidentes du modèle du grand langage15 ; voir ci-dessous.

Compte tenu du grand nombre de domaines d'application de la modélisation linguistique à grande échelle.Le simple fait de construire des produits plus réellement utiles basés sur de grands modèles linguistiques est un domaine important de la recherche appliquée en matière d'intelligence artificielle. Nous disposons déjà de modèles très puissants, mais les utiliser pour construire des produits qui valent la peine d'être utilisés est un problème tout à fait différent. Pour résoudre ce problème, il faut apprendre à construire des systèmes de modélisation linguistique fiables et puissants.

(Source [19])

robustesseest l'un des principaux obstacles à l'élaboration de modèles de langage et de systèmes d'agents plus puissants. Supposons que nous ayons un système de grand modèle de langage qui effectue dix appels différents au grand modèle de langage. En outre, supposons que chaque appel au modèle de langage ait une probabilité de réussite de 95% et que tous les appels doivent réussir pour générer le résultat final correct. Bien que les composants individuels du système soient raisonnablement précis, leCependant, le taux de réussite de l'ensemble du système n'est que de 60%!

(Source [20])

(Source [20])

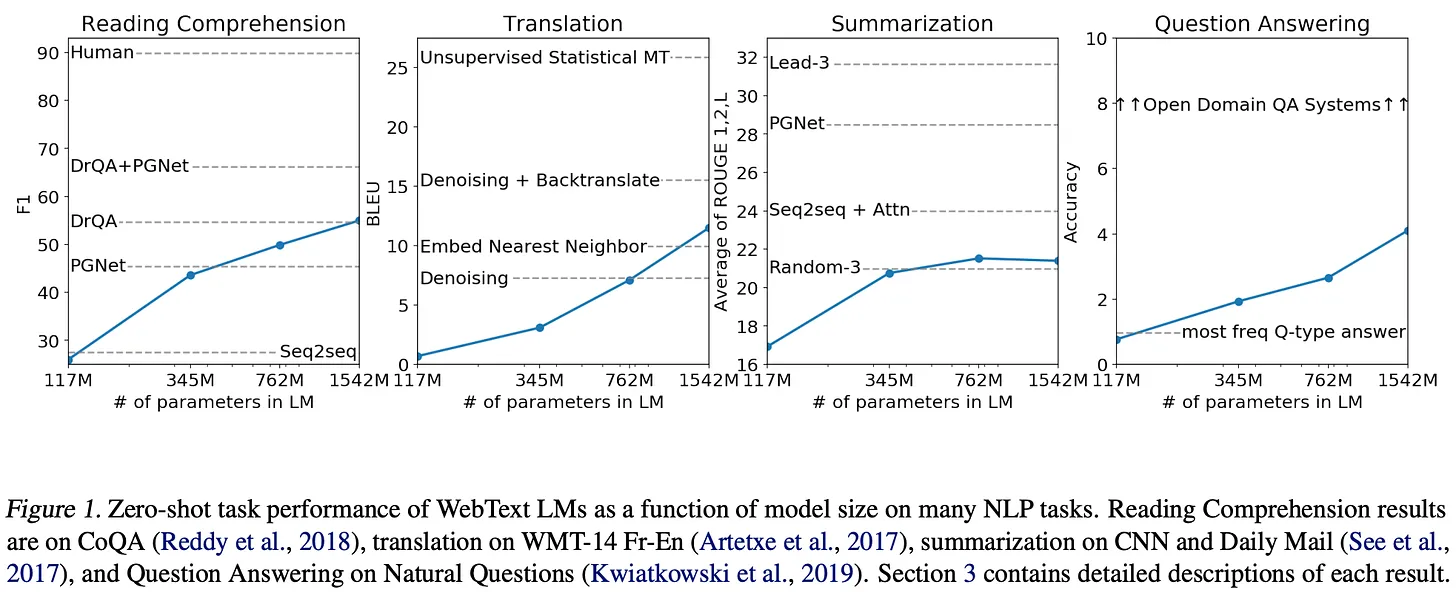

Modèles de raisonnement et nouveaux paradigmes de mise à l'échelle

L'une des critiques les plus courantes à l'égard des premiers modèles linguistiques de grande taille était qu'ils se contentaient de mémoriser des données et qu'ils n'étaient guère capables de raisonner. Cependant, l'affirmation selon laquelle les grands modèles de langage sont incapables de raisonner a été largement démentie au cours des dernières années. Des recherches récentes nous ont appris que ces modèles ont peut-être toujours eu une capacité de raisonnement inhérente, mais que nous avons dû utiliser les bons indices ou les bonnes méthodes d'entraînement pour susciter cette capacité.

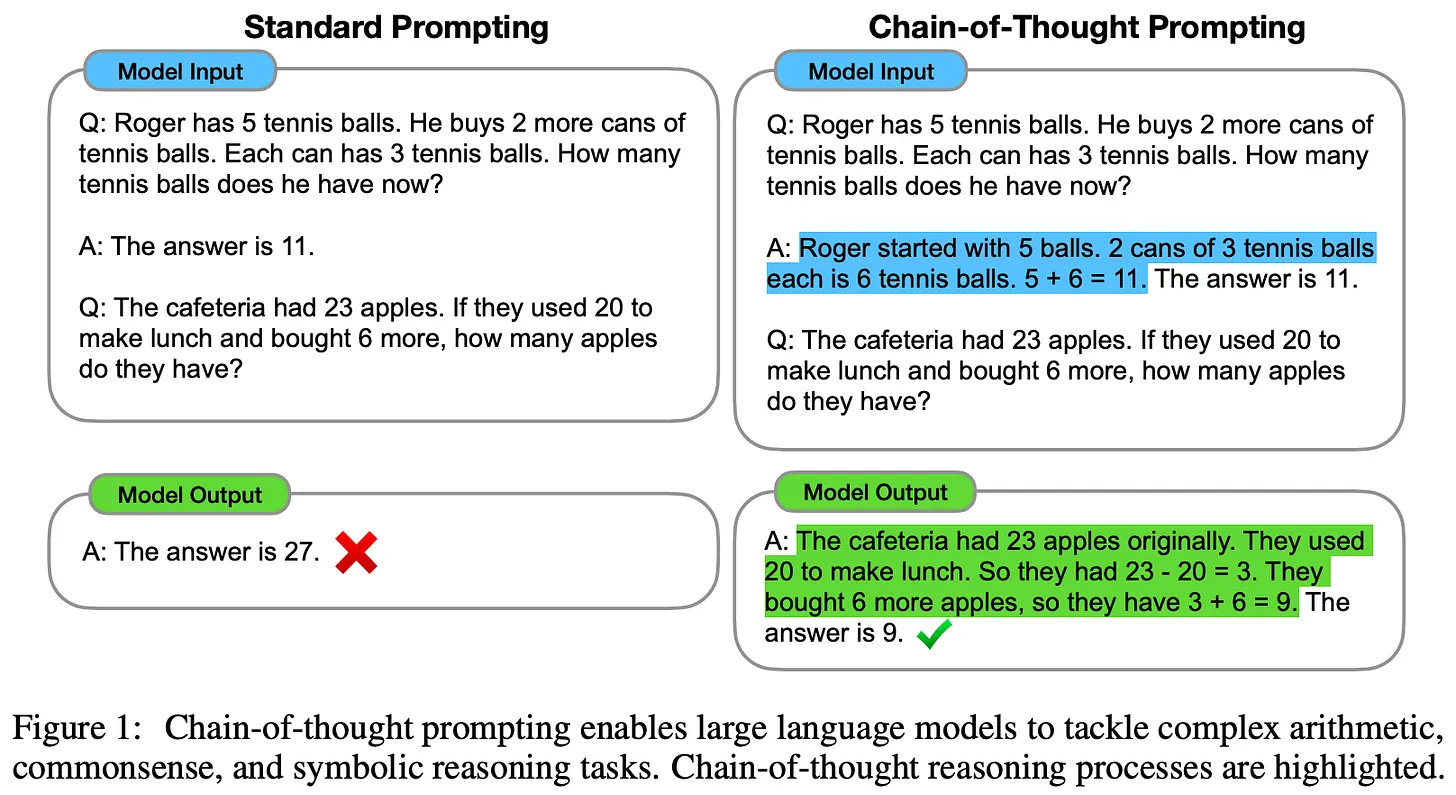

Conseils sur la chaîne de pensée (CoT) [22] a été l'une des premières techniques à démontrer les capacités d'inférence d'un grand modèle linguistique. La méthode est simple et basée sur des indices. Nous demandons simplement au grand modèle linguistique de fournir une explication de sa réponse avant de générer la réponse proprement dite ; voir ici pour plus de détails. Le pouvoir de raisonnement du grand modèle linguistique s'améliore considérablement lorsqu'il génère une justification qui décrit le processus étape par étape utilisé pour parvenir à une réponse. En outre, ces explications sont lisibles par l'homme et peuvent rendre les résultats du modèle plus interprétables !

(Source [22])

- Modèles linguistiques à grande échelle - Évaluation des juges Les modèles fournissent généralement la base de la notation avant de générer les résultats de l'évaluation finale [23, 24].

- Des stratégies supervisées de réglage fin et de réglage des instructions ont été proposées pour enseigner à des modèles de langage plus petits/ouverts de grande taille à écrire de meilleures chaînes de pensée [25, 26].

- Il est souvent demandé aux grands modèles de langage de réfléchir à leurs propres résultats, de les commenter ou de les valider, puis de les modifier en fonction de ces informations [12, 27].

Le raisonnement complexe est un sujet de recherche actif qui évolue rapidement. De nouveaux algorithmes de formation qui apprennent aux grands modèles de langage à incorporer la vérification (au niveau des étapes) [28, 29] dans leur processus de raisonnement ont montré des résultats prometteurs, et nous continuerons probablement à voir des améliorations au fur et à mesure que de nouvelles et meilleures stratégies de formation deviendront disponibles.

Modèle d'inférence o1 de l'OpenAI [o1 utilise des stratégies de raisonnement qui s'appuient fortement sur des chaînes de pensée. De la même manière que les humains réfléchissent avant de répondre à une question, o1 prend le temps de "penser" avant de fournir une réponse. En fait, la "pensée" générée par o1 est simplement une longue chaîne de pensées que le modèle utilise pour réfléchir au problème, le décomposer en étapes plus simples, essayer différentes approches pour résoudre le problème et même corriger ses propres erreurs.16 L'o1 est également une "chaîne de pensée" utilisée par le modèle pour réfléchir au problème.

"OpenAI o1 [est] un nouveau modèle de langage à grande échelle entraîné à effectuer des raisonnements complexes en utilisant l'apprentissage par renforcement. o1 réfléchit avant de répondre - il peut générer une longue chaîne de pensée interne avant de répondre à l'utilisateur". - Source [21]

Les détails de la stratégie de formation exacte de o1 n'ont pas été rendus publics. Cependant, nous savons que o1 apprend à raisonner en utilisant un algorithme "d'apprentissage par renforcement à grande échelle" qui "utilise très efficacement les données" et se concentre sur l'amélioration de la capacité du modèle à générer des chaînes de pensée utiles. D'après les commentaires publics des chercheurs de l'OpenAI et les déclarations récentes sur o1, il semble que le modèle ait été formé à l'aide d'un apprentissage par renforcement pur, ce qui contredit les suggestions antérieures selon lesquelles o1 aurait pu utiliser une forme de recherche arborescente dans son raisonnement.

Comparaison de GPT-4o et o1 sur des tâches d'inférence lourdes (Source [21])

- Top 89% dans Problèmes de programmation compétitifs sur Codeforces.

- Classement parmi les 500 meilleurs étudiants des États-Unis lors des épreuves de qualification de l'Olympiade américaine de mathématiques (AIME).

- Dépasse la précision des étudiants en doctorat sur les questions de physique, de biologie et de chimie de niveau universitaire (GPQA).

(Source [22])

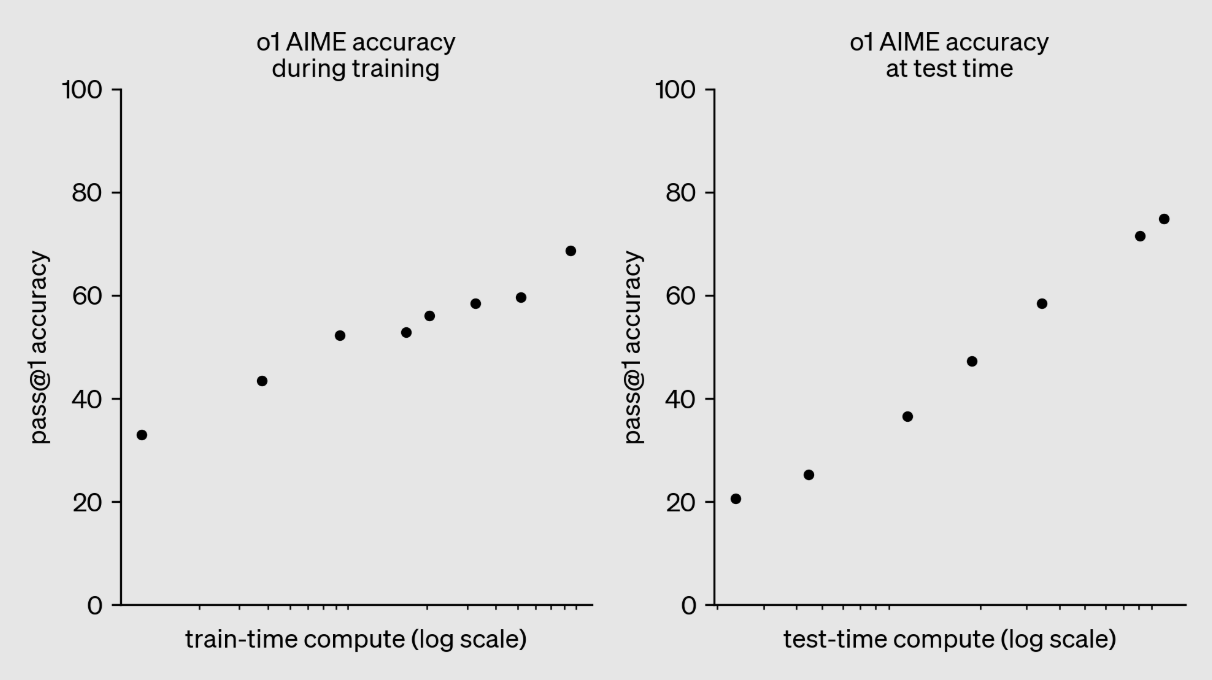

"Nous avons constaté que les performances de o1 continuaient à s'améliorer avec plus d'apprentissage par renforcement (calculé pendant l'entraînement) et plus de temps de réflexion (calculé pendant les tests)". - Source [22]

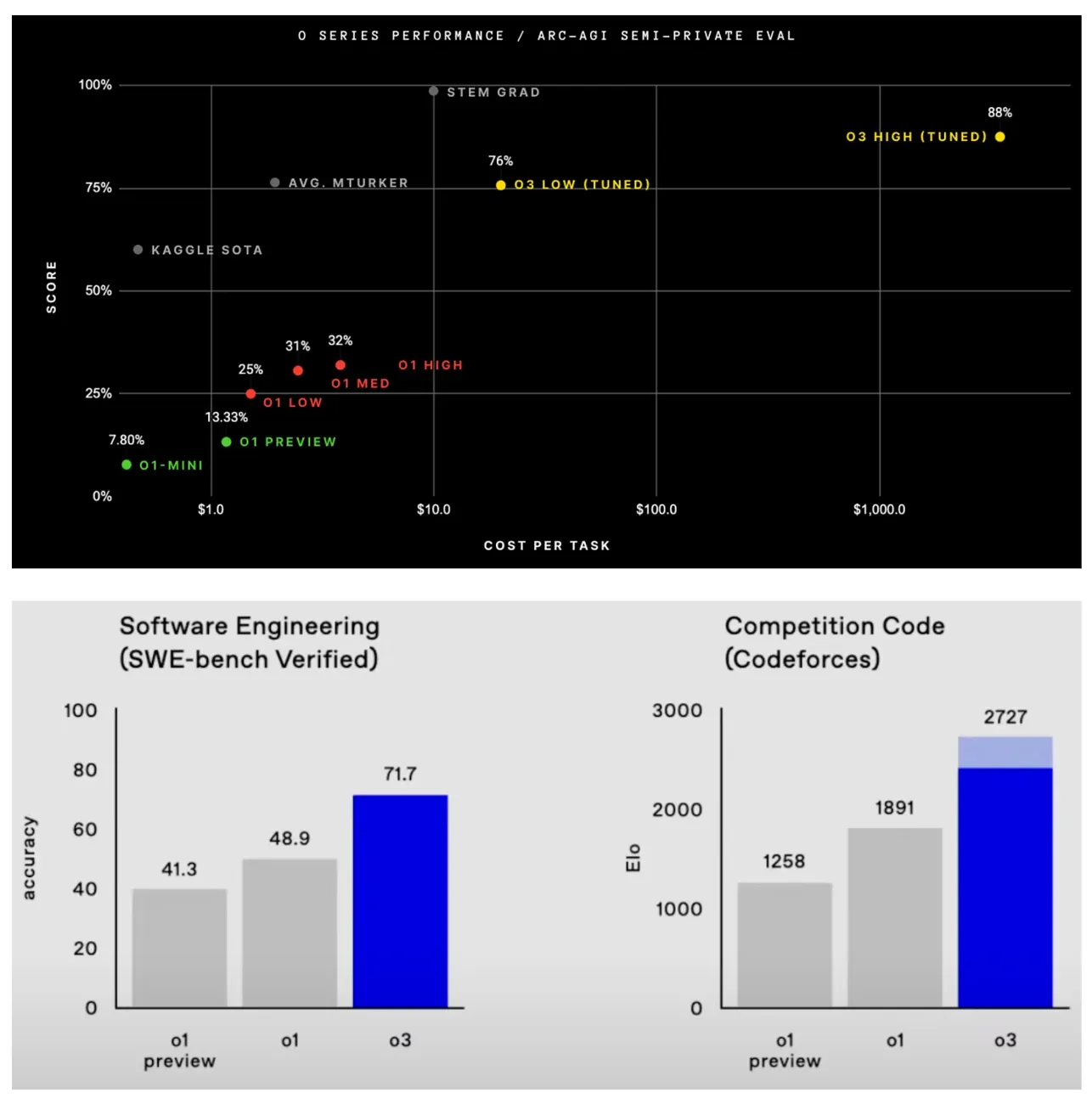

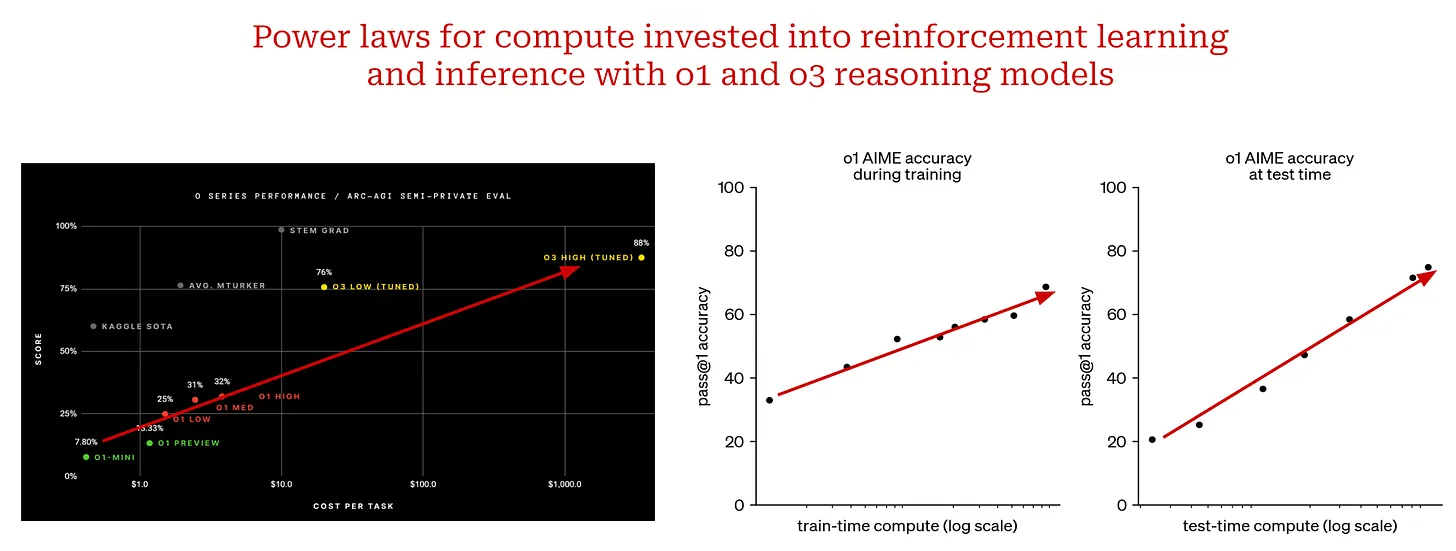

De même, nous voyons dans le graphique ci-dessus que la performance de o1 s'améliore progressivement au fur et à mesure que nous investissons davantage de calculs dans la formation par apprentissage par renforcement. C'est exactement l'approche suivie pour créer le modèle d'inférence o3. Le modèle a été évalué par l'OpenAI à la fin de l'année 2024 et très peu de détails sur o3 ont été partagés publiquement. Cependant, étant donné que le modèle a été publié si rapidement après o1 (c'est-à-dire trois mois plus tard), il est probable que o3 soit une version "mise à l'échelle" de o1, avec plus de calculs investis dans l'apprentissage par renforcement.

Au moment de la rédaction du présent document, le modèle o3 n'a pas encore été publié, mais les résultats obtenus par l'extension du modèle o1 sont impressionnants (et dans certains cas choquants). Les réalisations les plus notables de o3 sont énumérées ci-dessous :

- a obtenu un score de 87,5% sur le benchmark ARC-AGI, contre une précision de 5% pour GPT-4o. o3 a été le premier modèle à dépasser les 85% de performance humaine sur ARC-AGI. Ce test a été décrit comme l'"étoile polaire" de l'AGI et est resté invaincu pendant plus de cinq ans17 .

- Une précision de 71,7% sur SWE-Bench Verified et un score Elo de 2727 sur Codeforces placent o3 parmi les 200 meilleurs programmeurs humains compétitifs au monde.

- avec une précision de 25,2% sur le benchmark FrontierMath d'EpochAI.Amélioration de la précision de l'état de l'art par rapport à la version précédente 2.0%Terence Tao a décrit ce point de référence comme étant "extrêmement difficile" et probablement insoluble par les systèmes d'intelligence artificielle "pendant au moins quelques années". Terence Tao a décrit le point de référence comme étant "extrêmement difficile" et susceptible d'être insoluble par des systèmes d'intelligence artificielle "pendant au moins quelques années".

Une version allégée d'o3, appelée o3-mini, a également été présentée en avant-première. Elle fonctionne très bien et offre des améliorations significatives en termes d'efficacité de calcul.

(Source [21] et Voici)

- Temps de formation (apprentissage intensif) Calcul.

- Calculer lors du raisonnement.

La mise à l'échelle des modèles de style o1 diffère de la loi traditionnelle de la taille. Au lieu d'augmenter le processus de pré-entraînement, nous augmentons la quantité de calcul utilisée pour le post-entraînement et l'inférence.Il s'agit d'un tout nouveau paradigme de mise à l'échelleLes résultats obtenus jusqu'à présent par l'extension du modèle d'inférence sont très bons. Une telle constatation suggère qu'il existe clairement d'autres possibilités d'expansion au-delà du pré-entraînement. Avec l'émergence des modèles d'inférence, nous avons découvert la prochaine montagne à gravir. Bien qu'elle puisse se présenter sous différentes formes, laL'échelle continuera à stimuler les progrès de la recherche sur l'IA.

remarques finales

Nous avons désormais une vision plus claire des lois d'échelle, de leur impact sur les grands modèles de langage et de l'orientation future de la recherche en IA. Comme nous l'avons appris, de nombreux facteurs ont contribué aux récentes critiques des lois d'échelle :

- La décroissance naturelle de la loi d'échelle.

- Les attentes en matière de compétences dans le domaine de la modélisation des grandes langues varient considérablement.

- Retards dans les travaux d'ingénierie interdisciplinaires à grande échelle.

Ce sont des questions légitimes quiMais aucun d'entre eux n'indique que la mise à l'échelle ne fonctionne toujours pas comme prévu. L'investissement dans la préformation à grande échelle se poursuivra (et devrait se poursuivre), mais les améliorations deviendront de plus en plus difficiles au fil du temps. Par conséquent, d'autres axes de développement (par exemple, les agents et l'inférence) deviendront plus importants. Cependant, l'idée de base de la mise à l'échelle continuera à jouer un rôle important lorsque nous investirons dans ces nouveaux domaines de recherche. La question n'est pas de savoir si nous continuons ou non à changer d'échelle.La vraie question est de savoir ce que nous allons développer ensuite.

bibliographie

[1] Kaplan, Jared, et al. "Scaling laws for neural language models". arXiv preprint arXiv:2001.08361 (2020).[2] Radford, Alec, "Improving language understanding by generative pre-training" (2018).[3] Radford, Alec, et al. "Language models are unsupervised multitask learners". Blog de l'OpenAI 1.8 (2019): 9.[4] Brown, Tom, et al. "Language models are few-shot learners". Progrès dans les systèmes de traitement neuronal de l'information 33 (2020): 1877-1901.[5] Achiam, Josh, et al. "Gpt-4 technical report". arXiv preprint arXiv:2303.08774 (2023).[6] Hoffmann, Jordan, et al. "Training compute-optimal large language models". arXiv preprint arXiv:2203.15556 (2022).[7] Gadre, Samir Yitzhak, et al. "Language models scale reliable with over-training and on downstream tasks". arXiv preprint arXiv:2403.08540 (2024).[8] Ouyang, Long, et al. "Training language models to follow instructions with human feedback". Progrès dans les systèmes de traitement neuronal de l'information 35 (2022): 27730-27744.[9] Smith, Shaden, et al. "Using deepspeed and megatron to train megatron-turing nlg 530b, a large-scale generative language model" (Utilisation de deepspeed et de megatron pour entraîner megatron-turing nlg 530b, un modèle de langage génératif à grande échelle). arXiv preprint arXiv:2201.11990 (2022).[10] Rae, Jack W., et al. "Scaling language models : methods, analysis & insights from training gopher". arXiv preprint arXiv:2112.11446 (2021).[11] Bhagia, Akshita, et al. "Establishing Task Scaling Laws via Compute-Efficient Model Ladders". arXiv preprint arXiv:2412.04403 (2024).[12] Bai, Yuntao, et al. "Constitutional ai : Harmlessness from ai feedback". arXiv preprint arXiv:2212.08073 (2022).[13] Blakeney. Cody.et al. "Does your data spark joy ? Performance gains from domain upsampling at the end of training". arXiv preprint arXiv:2406.03476 (2024).[14] Chen, Hao, et al. "On the Diversity of Synthetic Data and its Impact on Training Large Language Models". arXiv preprint arXiv:2410.15226 (2024).[15] Guo, Zishan, et al. "Evaluating large language models : A comprehensive survey". arXiv preprint arXiv:2310.19736 (2023).[16] Xu, Zifei, et al. "Scaling laws for post-training quantized large language models". arXiv preprint arXiv:2410.12119 (2024).[17] Xiong, Yizhe, et al. "Temporal scaling law for large language models". arXiv preprint arXiv:2404.17785 (2024).[18] DeepSeek-AI et al. "DeepSeek-v3 Technical Report". https://github.com/deepseek-ai/DeepSeek-V3/blob/main/DeepSeek_V3.pdf (2024).[19] Schick, Timo, et al. "Toolformer : language models can teach themselves to use tools." arXiv preprint arXiv:2302.04761 (2023).[20] Welleck, Sean, et al. "From decoding to meta-generation : reference-time algorithms for large language models". arXiv preprint arXiv:2406.16838 (2024).[21] OpenAI et al. "Learning to Reason with LLMs". https://openai.com/index/learning-to-reason-with-llms/ (2024).[22] Wei, Jason, et al. "Chain-of-thought prompting elicits reasoning in large language models". Progrès dans les systèmes de traitement neuronal de l'information 35 (2022): 24824-24837.[23] Liu, Yang, et al. "G-eval : Nlg evaluation using gpt-4 with better human alignment". arXiv preprint arXiv:2303.16634 (2023).[24] Kim, Seungone, et al. "Prometheus : Inducing fine-grained evaluation capability in language models". Douzième conférence internationale sur les représentations d'apprentissage . 2023.[25] Ho, Namgyu, Laura Schmid et Se-Young Yun, "Large language models are reasoning teachers". arXiv preprint arXiv:2212.10071 (2022).[26] Kim, Seungone, et al. "The cot collection : improving zero-shot and few-shot learning of language models via chain-of-thought fine-tuning". arXiv preprint arXiv:2305.14045 (2023).[27] Weng, Yixuan, et al. "Large language models are better reasoners with self-verification". arXiv preprint arXiv:2212.09561 (2022).[28] Lightman, Hunter, et al. "Let's verify step by step". arXiv preprint arXiv:2305.20050 (2023).[29] Zhang, Lunjun, et al. "Generative verifiers : reward modelling as next-token prediction". arXiv preprint arXiv:2408.15240 (2024).1 Les deux principaux rapports proviennent de The Information et de Reuters.

2 Nous avons généré le dessin en utilisant les paramètres suivants :a = 1(math.) genrep = 0.5la paix 0 < x < 1.

3 Les calculs sont définis dans [1] comme suit 6NBSqui N est le nombre de paramètres du modèle quiB est la taille du lot utilisé pendant la formation.S est le nombre total d'étapes de formation.

4 Cette constante multiplicative supplémentaire ne modifie pas le comportement de la loi de puissance. Pour comprendre pourquoi il en est ainsi, nous devons comprendre la définition de l'invariance d'échelle. Les lois de puissance étant invariantes à l'échelle, les caractéristiques de base d'une loi de puissance sont les mêmes, même si l'on augmente ou diminue l'échelle d'un facteur quelconque. Le comportement observé est le même quelle que soit l'échelle !

5 Cette description est tirée du prix Test of Time Award qu'Ilya a reçu pour cet article lors de la conférence NeurIPS'24.

6 Bien que cela puisse sembler évident aujourd'hui, nous devons garder à l'esprit qu'à l'époque, la plupart des tâches de TAL (par exemple, le résumé et les questions-réponses) avaient des domaines de recherche qui leur étaient consacrés ! Chacune de ces tâches était associée à des architectures spécialisées, et le GPT était un modèle générique unique capable de surpasser la plupart de ces architectures dans un certain nombre de tâches différentes.

7 Cela signifie que nous décrivons simplement chaque tâche dans les messages-guides du grand modèle linguistique et que nous utilisons le même modèle pour résoudre les différentes tâches - laSeules les invites changent entre les tâches.

8 Il faut s'y attendre, car ces modèles utilisent l'inférence à échantillon zéro et ne sont pas du tout affinés pour les tâches en aval.

9 Par capacités "émergentes", nous entendons des compétences qui ne sont accessibles aux grands modèles linguistiques que lorsqu'ils atteignent une certaine taille (par exemple, un modèle suffisamment grand).

10 Nous définissons ici le terme "optimal sur le plan informatique" comme la configuration de formation qui produit la meilleure performance (en termes de perte de test) pour un coût informatique de formation fixe.

11 Par exemple, Anthropic ne cesse de retarder sa sortie. Claude 3.5 Opus, Google n'a publié qu'une version flash de Gemini-2, et OpenAI n'a publié que GPT-4o en 2024 (jusqu'à la sortie de o1 et o3 en décembre), qui n'est sans doute pas beaucoup plus performant que GPT-4.

12 Seuls 37 milliards de paramètres sont actifs lors de l'inférence d'un seul jeton.

13 Par exemple, xAI a récemment construit un nouveau centre de données à Memphis avec 100 000 GPU NVIDIA, et les dirigeants d'Anthropic ont l'intention de multiplier par 100 leurs dépenses de calcul au cours des prochaines années.

14 L'étape d'agrégation peut être mise en œuvre de différentes manières. Par exemple, nous pouvons agréger les réponses manuellement (par le biais d'une connexion), à l'aide d'un grand modèle linguistique, ou tout ce qui se trouve entre les deux !

15 Ce n'est pas parce que ces tâches sont simples. La génération de code et le chat sont tous deux difficiles à résoudre, mais il s'agit d'applications (sans doute) assez évidentes du Big Language Model.

16OpenAI a choisi de cacher ces longues chaînes de pensée aux utilisateurs de o1. L'argument qui sous-tend ce choix est que ces éléments fondamentaux fournissent des informations sur les processus de pensée du modèle qui peuvent être utilisées pour déboguer ou contrôler le modèle. Cependant, les modèles devraient être autorisés à exprimer leurs pensées pures sans aucun des filtres de sécurité nécessaires pour les sorties de modèles orientées vers l'utilisateur.

17 Actuellement, ARC-AGI reste techniquement invaincu parce que o3 dépasse les exigences de calcul pour l'évaluation comparative. Cependant, le modèle atteint encore une précision de 75,7% en utilisant des paramètres de calcul plus faibles.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...