ChatOllama : application locale de chat en temps réel basée sur Nuxt 3 et Ollama

Introduction générale

ChatOllama est un projet d'application de chat en ligne open source basé sur des modèles de langage à grande échelle (LLM), prenant en charge de nombreux modèles de langage et la gestion d'une base de connaissances. Les utilisateurs peuvent utiliser la plateforme pour la gestion des modèles (affichage de la liste, téléchargement, suppression), le chat avec les modèles et d'autres fonctions. Le projet utilise le cadre Nuxt 3 et fournit un guide d'installation détaillé et des lignes directrices pour le serveur de développement, que les développeurs intéressés par le développement de chatbots peuvent consulter et auxquels ils peuvent contribuer.

Liste des fonctions

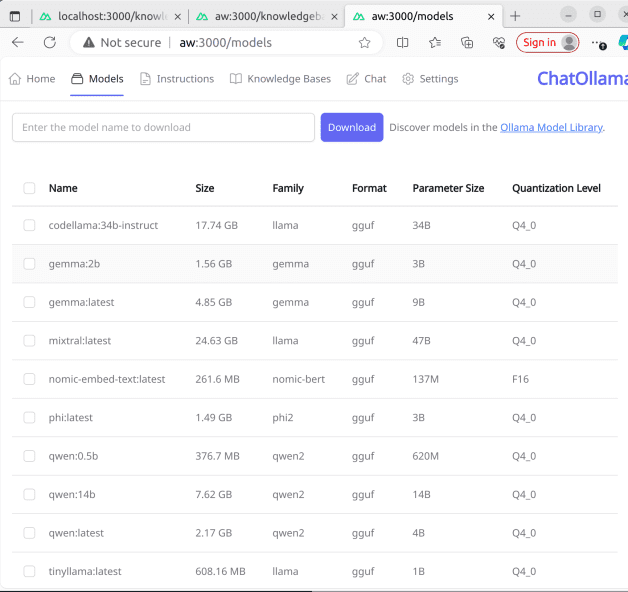

Gestion des modèles : y compris la visualisation, le téléchargement et la suppression de la liste des modèles.

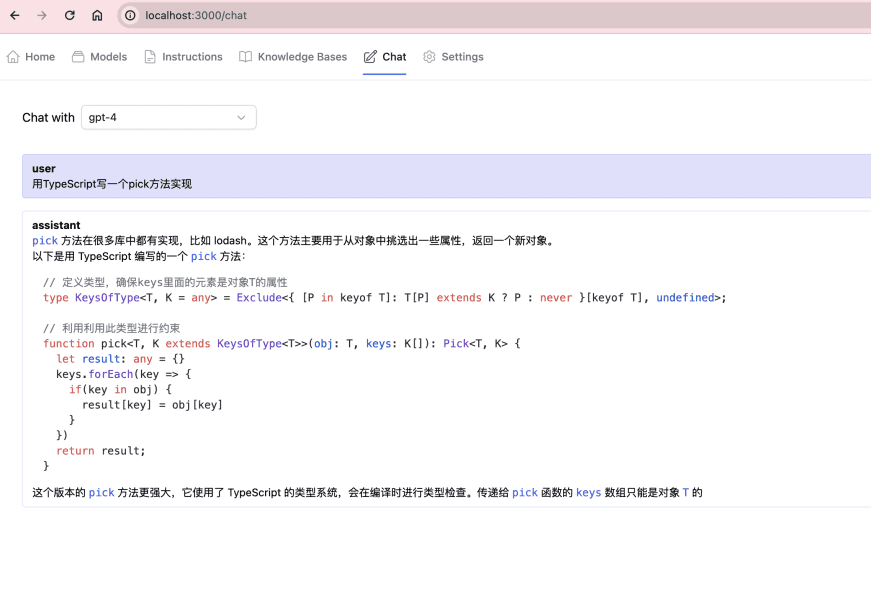

Capacité à interagir avec des modèles de chat

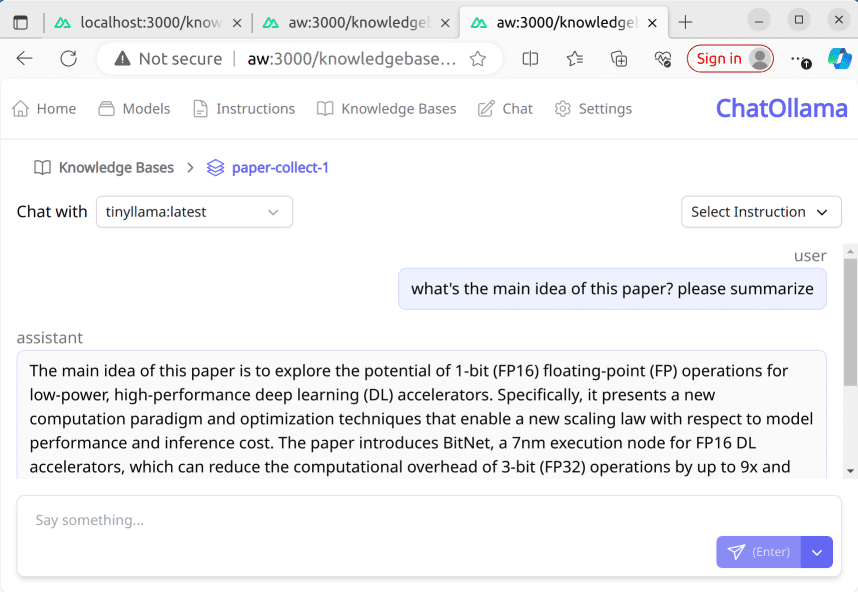

Prise en charge de la modélisation multilingue et de la gestion de la base de connaissances (base de connaissances basée sur LangChain)

Développé sur Nuxt 3 et écrit en Vue et TypeScript.

Utiliser l'aide

Installez d'abord les dépendances : npm install, pnpm install, yarn install ou bun install

Assurez-vous que le serveur Ollama fonctionne, l'environnement local s'exécute par défaut à l'adresse http://localhost:11434.

Trouvé sur http://localhost:3000上启动开发服务器 : npm run dev

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...