Audio-Reasoner : un modèle de langage à grande échelle pour le raisonnement approfondi dans le domaine de l'audio

Introduction générale

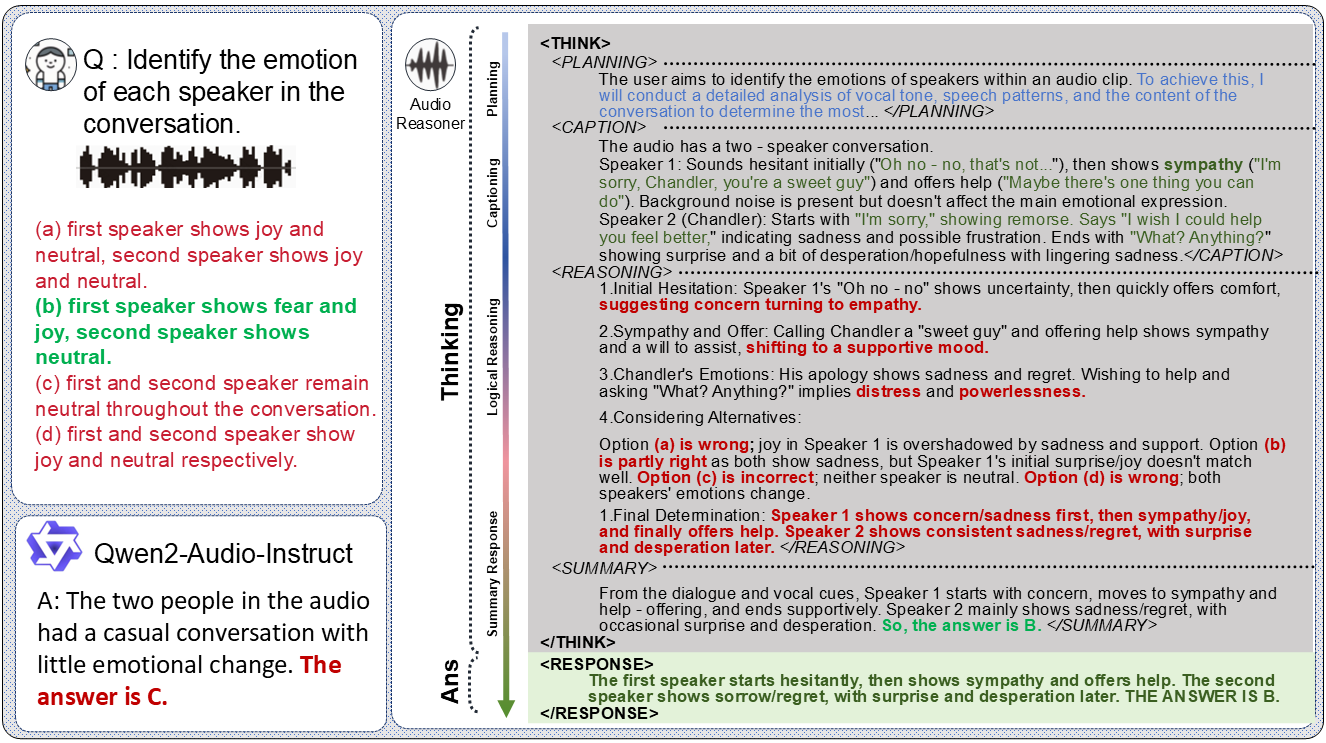

Audio-Reasoner est un projet open source développé par une équipe de l'université de Tsinghua et hébergé sur GitHub, qui se concentre sur la construction de modèles de langage à grande échelle qui prennent en charge le raisonnement profond dans l'audio. Le modèle est basé sur Qwen2-Audio-Instruct, qui permet un raisonnement complexe et une compréhension multimodale du contenu audio en introduisant la technologie structurée de la chaîne de pensée (CoT). Le projet comprend le modèle Audio-Reasoner-7B et le futur ensemble de données CoTA (avec 1,2 million d'échantillons de haute qualité), qui a permis d'améliorer les performances de 25,42% et de 14,57% dans les benchmarks MMAU-mini et AIR-Bench-Chat, respectivement.Audio-Reasoner Audio-Reasoner est un outil idéal pour les chercheurs et les développeurs, car il prend en charge le traitement du son, de la musique, de la voix et d'autres types d'audio, et convient aux scénarios d'analyse audio et de compréhension du contenu.

Liste des fonctions

- Raisonnement approfondi audioLes élèves sont capables d'analyser des données audio et de générer des processus de raisonnement et des résultats détaillés à l'aide d'une réflexion structurée en chaîne.

- Aide à la tâche multimodale: Combinaison d'entrées audio et textuelles pour des tâches de compréhension et de raisonnement multimodales.

- Traitement audio multipleLe logiciel de reconnaissance et d'analyse de l'audio permet de reconnaître et d'analyser plusieurs types d'audio, tels que la voix, la musique, la parole, etc.

- Modèles pré-entraînés très performantsLe modèle Audio-Reasoner-7B, qui excelle dans plusieurs tests de référence, est disponible sur le site web de la Commission.

- Ensemble de données de l'ACTSLe site contient 1,2 million d'échantillons pour soutenir la formation à l'inférence structurée et l'amélioration de la capacité des modèles.

- Code de raisonnement et démonstrationLe logiciel de gestion de l'information est un outil d'aide à la décision et à la prise de décision, qui fournit un code d'inférence complet et des exemples de démonstration pour les tests et le développement.

- programme open source: : À l'avenir, le processus de synthèse des données et le code d'entraînement seront ouverts afin de faciliter la collaboration de la communauté.

Utiliser l'aide

Processus d'installation

L'installation d'Audio-Reasoner nécessite la configuration de l'environnement Python et le téléchargement des poids de modèle. Les étapes suivantes sont détaillées afin de s'assurer que les utilisateurs peuvent compléter avec succès la construction :

1. cloner un dépôt GitHub

Commencez par cloner le projet Audio-Reasoner localement. Ouvrez un terminal et exécutez la commande suivante :

git clone https://github.com/xzf-thu/Audio-Reasoner.git

cd Audio-Reasoner

Cette opération permet de télécharger les fichiers du projet localement et dans le répertoire du projet.

2. créer et activer un environnement virtuel

Pour éviter les conflits de dépendances, il est recommandé de créer un environnement Python distinct à l'aide de Conda :

conda create -n Audio-Reasoner python=3.10

conda activate Audio-Reasoner

Cette commande crée et active un environnement basé sur Python 3.10 appelé "Audio-Reasoner".

3. l'installation des paquets de dépendances

Le projet prévoit requirements.txt contenant les dépendances nécessaires. Les étapes de l'installation sont les suivantes :

pip install -r requirements.txt

pip install transformers==4.48.0

Attention :transformers La version 4.48.0 doit être installée pour garantir la stabilité des performances du modèle. Installez d'abord les autres dépendances, puis spécifiez l'option transformers afin d'éviter les conflits.

4. téléchargement des poids du modèle

Le modèle Audio-Reasoner-7B a été publié sur HuggingFace et doit être téléchargé et configuré manuellement :

- entretiens HuggingFace Audio-Reasoner-7B, télécharger le fichier modèle.

- Remplir le chemin d'accès au point de contrôle téléchargé dans le code de l'application

last_model_checkpointpar exemple :

last_model_checkpoint = "/path/to/Audio-Reasoner-7B"

Comment l'utiliser

Après l'installation, les utilisateurs peuvent exécuter Audio-Reasoner via le code pour gérer les tâches audio. Voici le guide d'utilisation détaillé :

Démarrage rapide : Exécuter l'exemple de code

Le projet fournit un exemple de démarrage rapide pour aider les utilisateurs à tester la fonctionnalité du modèle :

- Préparation des fichiers audio

Par défaut, il utilise le fichierassets/test.wavou vous pouvez le remplacer par votre propre fichier audio au format WAV. Assurez-vous que le chemin d'accès est correct. - Chemins audio et questions relatives à l'édition du code

spectacle (un billet)inference.pyVous pouvez également utiliser le code suivant pour définir le chemin audio et poser des questions :audiopath = "assets/test.wav" prompt = "这段音频的节奏感和拍子是怎样的?" audioreasoner_gen(audiopath, prompt) - programme de course

Exécutez-le dans le terminal :conda activate Audio-Reasoner cd Audio-Reasoner python inference.pyLe modèle produira des résultats d'inférence structurés, notamment

<THINK>(planifier, décrire, raisonner, résumer) et<RESPONSE>(Réponse finale).

Fonctionnalité principale : raisonnement approfondi audio

Au cœur de l'Audio-Reasoner se trouve le raisonnement audio basé sur la pensée en chaîne, et voici comment cela fonctionne :

- Audio d'entrée et problèmes

- utiliser

audioreasoner_genen indiquant le chemin audio et une question spécifique. Exemple :audiopath = "your_audio.wav" prompt = "音频中是否有鸟叫声?" audioreasoner_gen(audiopath, prompt)

- utiliser

- Visualiser le résultat de l'inférence

Le modèle renvoie des processus de raisonnement détaillés, par exemple :<THINK> <PLANNING>: 检查音频中的声音特征,识别是否有鸟叫声。 <CAPTION>: 音频包含自然环境音,可能有风声和动物叫声。 <REASONING>: 分析高频声音特征,与鸟类叫声模式匹配。 <SUMMARY>: 音频中可能存在鸟叫声。 </THINK> <RESPONSE>: 是的,音频中有鸟叫声。 - Réglage des paramètres de sortie (en option)

Si une réponse plus longue ou plus souple est nécessaire, elle peut être modifiéeRequestConfigParamètres :request_config = RequestConfig(max_tokens=4096, temperature=0.5, stream=True)

Test local d'échantillons prédéfinis

Le projet comporte un test audio et des questions pour une vérification rapide :

conda activate Audio-Reasoner

cd Audio-Reasoner

python inference.py

Après l'exécution, le terminal affiche une description de l'opération. assets/test.wav Les résultats des analyses sont adaptés à la première expérience.

Caractéristique : compréhension multimodale

Audio-Reasoner permet l'analyse conjointe de l'audio et du texte. Exemple :

prompt = "这段音乐的情绪是否与‘悲伤’描述相符?"

audioreasoner_gen("sad_music.wav", prompt)

Le modèle combinera les caractéristiques audio et la sémantique du texte pour produire des résultats d'inférence.

Précautions et questions fréquemment posées

- format audioFormat WAV recommandé, taux d'échantillonnage 16kHz, mono.

- lentSi vous êtes lent, vérifiez que le GPU est activé (PyTorch pour CUDA est nécessaire).

- Le modèle ne répond pasVérifier que le chemin d'accès au modèle est correct et que les dépendances sont entièrement installées.

- Conflit de dépendanceSi l'installation échoue, essayez de créer un nouvel environnement et d'installer les dépendances dans l'ordre strict.

Utilisation avancée

- Logique de raisonnement personnalisée: : Modification

systemMots repères pour ajuster le style de raisonnement du modèle. - fichier de lot: : Will

max_batch_sizeUne valeur plus élevée (par exemple 128) permet de prendre en charge l'inférence simultanée de plusieurs fichiers audio. - Combiné avec l'ensemble de données CoTALes futurs ensembles de données de l'ACTS peuvent être utilisés pour une formation plus poussée ou pour affiner le modèle lorsqu'ils seront publiés.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...