ChatGPT reste en tête de nombreux palmarès de l'IA, mais la concurrence le suit de près.

Comment déterminer les modèles d'IA les plus puissants actuellement disponibles ? Consultez les classements pour le savoir.

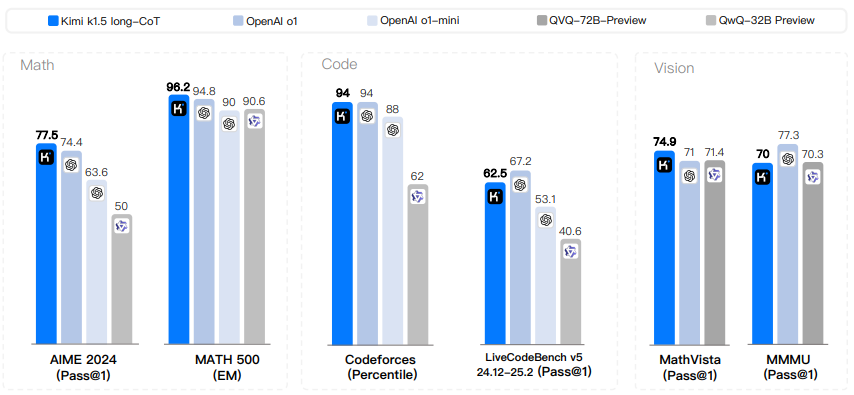

Les tableaux de classement compilés par les communautés pour les modèles d'IA ont gagné en popularité en ligne ces derniers mois, offrant une fenêtre en temps réel sur la joute des grands géants de la technologie dans l'espace de l'IA.

Les modèles d'IA sont essentiellement un ensemble de formules mathématiques enveloppées dans un code conçu pour atteindre un objectif spécifique.

Comme Gemini de Google (anciennement Bard) et les startups parisiennes Mistral AI Les nouveaux venus, comme Mistral-Medium, ont galvanisé la communauté de l'IA et se disputent la première place du classement.

Cependant, le GPT-4 d'OpenAI domine toujours.

Les gens s'intéressent aux technologies de pointe", explique Ying Sheng, doctorant en informatique à l'université de Stanford et co-créateur du classement Chatbot Arena. Je pense que les gens aiment voir les classements changer constamment. Cela montre que le jeu se poursuit et qu'il y a encore de la place pour l'amélioration."

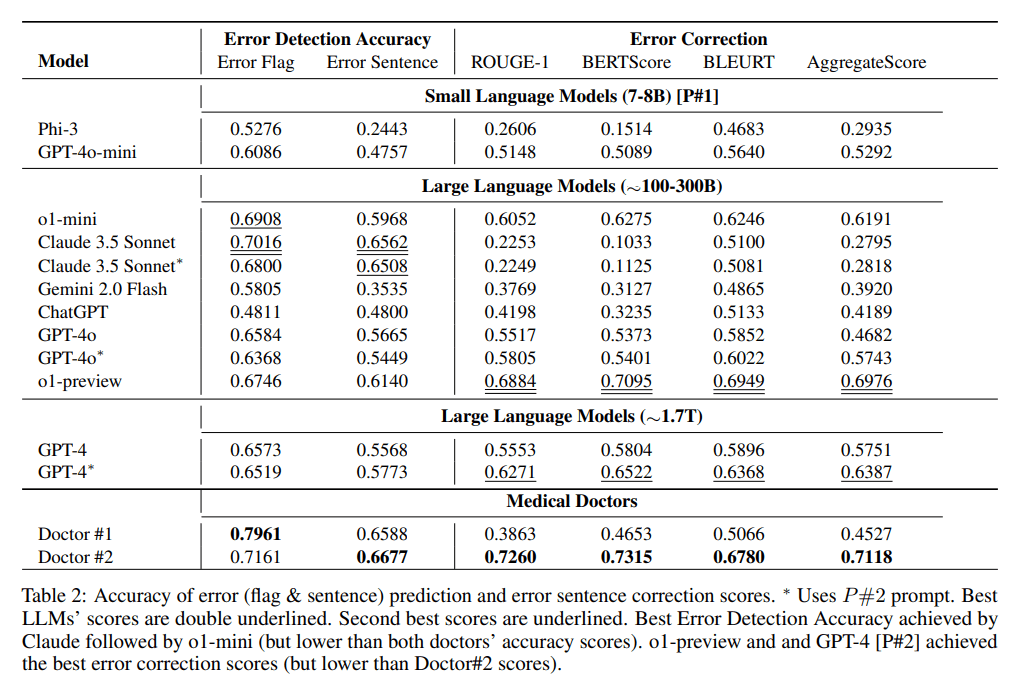

Les classements sont basés sur des tests des capacités des modèles d'IA, qui sont conçus pour déterminer ce dont l'IA est généralement capable et quels modèles pourraient être les plus adaptés à des applications spécifiques, telles que la reconnaissance vocale. Ces tests, parfois appelés tests d'étalonnage, mesurent les performances de l'IA à l'aide de paramètres tels que la proximité des vocalisations de l'IA par rapport à une voix humaine, ou le degré d'humanité des réponses d'un chatbot d'IA.

L'IA continuant d'évoluer, l'amélioration continue de ces tests est tout aussi essentielle.

Vanessa Parli, directrice de recherche à l'Institute for Artificial Intelligence du Center for the Human Dimension de l'université de Stanford, a déclaré : "Ces critères ne sont pas parfaits, mais pour l'instant, c'est la seule façon dont nous pouvons évaluer le système."

Le rapport annuel de l'institut sur l'indice Stanford Artificial Intelligence Index suit les performances techniques des modèles d'IA au fil du temps en fonction de différents paramètres. Selon M. Parli, le rapport de l'année dernière a étudié 50 critères de référence, mais n'en a retenu que 20. Cette année, le rapport éliminera certains critères obsolètes pour se concentrer sur des critères plus récents et plus complets.

Le classement Open LLM [Large Language Model] établi par Hugging Face, une plateforme d'apprentissage automatique à code source ouvert, a évalué et classé plus de 4 200 modèles au début du mois de février, tous soumis par des membres de la communauté.

Les mannequins participent à sept tests de référence clés conçus pour évaluer leurs capacités dans diverses catégories, telles que la compréhension de la lecture et la résolution de problèmes mathématiques. Le processus d'évaluation comprend des questions de mathématiques et de sciences de l'école primaire qui testent le raisonnement de bon sens des mannequins et mesurent leur tendance à diffuser des informations erronées. Certains tests sont à choix multiples, tandis que d'autres demandent aux mannequins de générer leurs propres réponses à partir d'indices.

ChatGPT-4 d'OpenAI est en tête du classement du LMSYS Chatbot Arena, suivi de près par Geminivia de Google. LMSYS

Les visiteurs peuvent consulter les performances spécifiques de chaque modèle dans un test de référence particulier, ainsi que leur score total moyen. Jusqu'à présent, aucun modèle n'a atteint la note parfaite de 100 sur un test de référence. Smaug-72B, un modèle d'IA récemment développé par la startup Abacus.AI de San Francisco, est devenu le premier modèle à dépasser les 80 points en moyenne.

De nombreux modèles linguistiques à grande échelle ont déjà dépassé les références humaines lors de ces tests, un phénomène que les chercheurs appellent "saturation", explique Thomas Wolf, cofondateur et directeur scientifique de Hugging Face. Ce phénomène se produit généralement lorsque les capacités du modèle augmentent au-delà d'un test spécifique, comme lorsqu'un élève passe du collège au lycée et dépasse progressivement le stade d'apprentissage précédent, ou lorsque le modèle a mémorisé la façon de répondre à certaines questions du test, un concept connu sous le nom de "surajustement".

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...