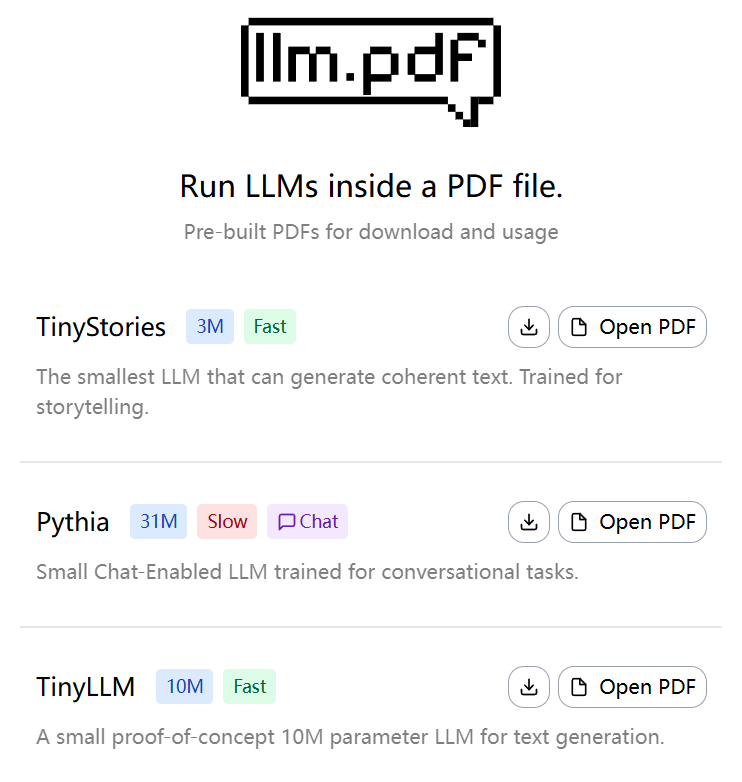

llm.pdf: Experimentelles Projekt zur Ausführung eines umfangreichen Sprachmodells in einer PDF-Datei

Allgemeine Einführung llm.pdf ist ein Open-Source-Projekt, mit dem Benutzer Large Language Models (LLMs) direkt in PDF-Dateien ausführen können. Entwickelt von EvanZhouDev und gehostet auf GitHub, demonstriert dieses Projekt einen innovativen Ansatz: durch Em...