Raycast-G4F: Kostenloser Zugang zu GPT-4, Llama-3 und vielen anderen AI-Modellen über Raycast!

Allgemeine Einführung

Raycast-G4F (GPT4Free) ist ein leistungsfähiges Raycast Die Erweiterung bietet Nutzern freien Zugang zu einer breiten Palette fortschrittlicher KI-Modelle, darunter GPT-4 und Llama-3. Die Erweiterung bietet nicht nur Dialog-Streaming in Echtzeit, sondern unterstützt auch eine Vielzahl von Funktionen wie Websuche, Datei-Upload, Bilderzeugung usw. Vor allem aber unterstützt sie mehr als 40 verschiedene KI-Anbieter und -Modelle. Vor allem unterstützt sie mehr als 40 verschiedene KI-Anbieter und -Modelle, so dass die Nutzer je nach Bedarf frei wechseln können. Die Erweiterung ist vollständig quelloffen und konzentriert sich auf den Schutz der Privatsphäre des Nutzers, wobei alle Daten lokal auf dem Gerät gespeichert werden. Obwohl sie derzeit nicht im offiziellen Raycast-Shop erhältlich ist, kann sie durch eine einfache Quellcode-Installation verwendet werden und bietet automatische Updates, um sicherzustellen, dass immer die neueste Version verfügbar ist.

Raycast-G4F ist derzeit nur für macOS verfügbar, eine Windows-Version ist in Entwicklung. Benutzer können die Erweiterung aus dem Quellcode mit einfachen Installationsschritten installieren und ihre leistungsstarken KI-Funktionen genießen.

Funktionsliste

- Dialog-Streaming-Funktionalität in Echtzeit mit Unterstützung für das Laden von Sofortnachrichten

- 18 verschiedene Befehle für unterschiedliche Einsatzszenarien

- Unterstützt den Zugang zu über 40 KI-Anbietern und -Modellen

- Intelligente Funktionen zum Speichern von Chatprotokollen und Benennen von Sitzungen

- Integrierte Web-Suchfunktion für aktuelle Informationen

- Unterstützt das Hochladen von Bild-, Video-, Audio- und Textdateien

- AI-Bilderzeugungsfunktion

- Unterstützung für die Erstellung eigener AI-Befehle

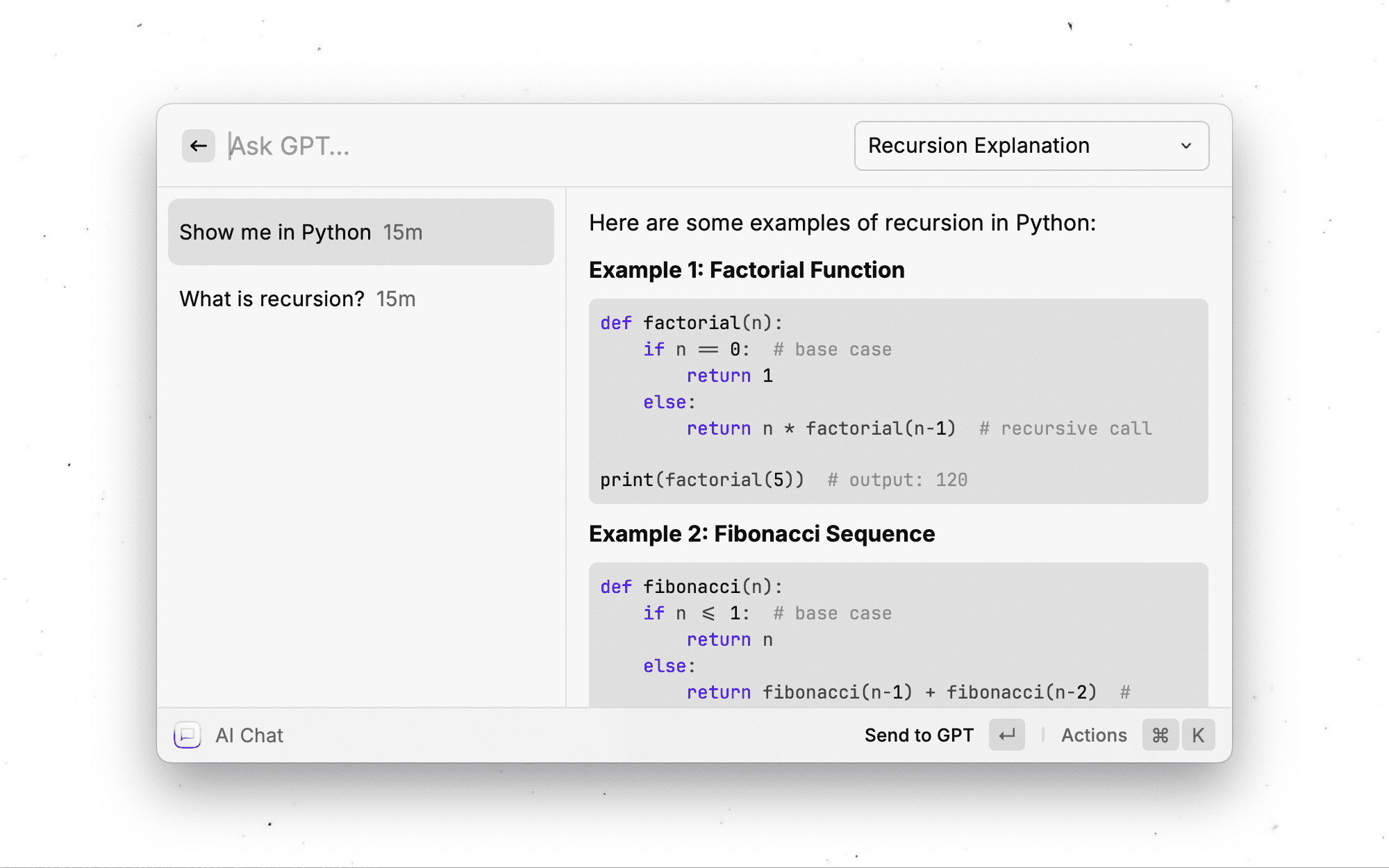

- Code-Interpreter-Funktion (Beta)

- Persistente Speicherfunktion gewährleistet sichere Datenaufbewahrung

Hilfe verwenden

1. vorbereitende Maßnahmen vor der Installation

- Vergewissern Sie sich, dass die Raycast-App installiert ist (derzeit nur auf macOS unterstützt)

- Installieren Sie Node.js (empfohlene Version v20.18.1 oder höher)

2. die Installationsschritte

- Laden Sie die neueste Version des Quellcodes von GitHub herunter oder klonen Sie das Repository

- Öffnen Sie das Terminal und gehen Sie zum Download-Ordner

- in Bewegung sein

npm ci --productionInstallation von Abhängigkeiten - (Optional) Ausführen

pip3 install -r requirements.txtInstallation von Python-Abhängigkeiten - in Bewegung sein

npm run devErstellen und Importieren von Erweiterungen

3. die Aktualisierungsmodalitäten

Automatische Aktualisierungen:

- Verwenden Sie den in der Erweiterung integrierten Befehl "Nach Updates suchen".

- Aktivieren Sie "Automatisch nach Updates suchen" in den Einstellungen (standardmäßig aktiviert)

Manuelle Aktualisierung:

Führen Sie die folgenden Befehle der Reihe nach aus:

git pullnpm ci --productionnpm run dev

4. eine Beschreibung der Nutzung der Hauptfunktionen

AI-Chat-Funktion

- Unterstützung für Echtzeit-Dialogströme

- Automatisches Speichern des Chatverlaufs

- Intelligente Benennung von Sitzungen

- Die Websuche kann in einer einzigen Sitzung aktiviert werden

Web-Suchfunktion

Es werden vier Modi angeboten:

- Deaktivieren (Standard)

- Auto-Modus: automatisch nur im AI-Chat aktiviert

- Ausgeglichener Modus: sowohl bei KI-Befehlen als auch im Chat aktiviert

- Immer aktiviert: Websuche wird für alle Abfragen verwendet

Dokumentenverarbeitungskapazität

- Unterstützt das Hochladen von Textdateien (.txt, .md, etc.).

- Einige Anbieter unterstützen Bilder, Videos und Audiodateien

- Unterstützung für den Befehl "Bildschirminhalt fragen".

Personalisierung

- Personalisierte KI-Befehle erstellen

- Einstellen von AI-Voreinstellungen

- Konfigurieren von persistentem Speicher

- Benutzerdefinierte OpenAI-kompatible APIs

5. erweiterte Funktionskonfiguration

Google Gemini API-Einstellungen

- Besuchen Sie https://aistudio.google.com/app/apikey

- Bei Google-Konto anmelden

- Erstellen eines API-Schlüssels

- Geben Sie den Schlüssel in die erweiterten Einstellungen ein

Code-Dolmetscher (beta)

- Unterstützung für die lokale Ausführung von Python-Code

- Nur bestimmte Modelle mit Funktionsaufruf-Funktion werden unterstützt

- Es wurden Sicherheitseinschränkungen konfiguriert, um eine sichere Codeausführung zu gewährleisten.

Kostenlose Modelle und Anbieter von Dienstleistungen

| Anbieter (Unternehmen) | Modellierung | Funktionalität | Stand der Dinge | Tempo | Erweiterte Autorenbewertungen und Anmerkungen |

|---|---|---|---|---|---|

| Nexra | gpt-4o (Standard) | ▶️ | Aktiv | sehr schnell | 8,5/10, das leistungsstärkste Modell. |

| Nexra | gpt-4-32k | Aktiv | mäßig | 6.5/10, keine Streaming-Unterstützung, aber sonst ein tolles Modell. | |

| Nexra | chatgpt | ▶️ | Unbekannt | sehr schnell | 7.5/10 |

| Nexra | Bing | ▶️ | Aktiv | mäßig | 8/10, basierend auf GPT-4 und mit Web-Suchfunktion. |

| Nexra | Lama-3.1 | ▶️ | Aktiv | scharf (von Messern oder Verstand) | 7/10 |

| Nexra | gemini-1.0-pro | ▶️ | Aktiv | scharf (von Messern oder Verstand) | 6.5/10 |

| DeepInfra | meta-llama-3.3-70b | ▶️ | Aktiv | scharf (von Messern oder Verstand) | 8.5/10, das neueste Modell mit großen Kontextgrößen. |

| DeepInfra | meta-llama-3.2-90b-vision | ▶️ 📄¹ | Aktiv | scharf (von Messern oder Verstand) | 8/10, das neueste Modell mit visuellen Fähigkeiten. |

| DeepInfra | meta-llama-3.2-11b-vision | ▶️ 📄¹ | Aktiv | sehr schnell | 7.5/10 |

| DeepInfra | meta-llama-3.1-405b | ▶️ | Inaktiv | mäßig | 8.5/10, modernes offenes Modell für komplexe Aufgaben. |

| DeepInfra | meta-llama-3.1-70b | ▶️ | Aktiv | scharf (von Messern oder Verstand) | 8/10 |

| DeepInfra | meta-llama-3.1-8b | ▶️ | Aktiv | sehr schnell | 7.5/10 |

| DeepInfra | llama-3.1-nemotron-70b | ▶️ | Aktiv | scharf (von Messern oder Verstand) | 8/10 |

| DeepInfra | ZaubererLM-2-8x22B | ▶️ | Aktiv | mäßig | 7/10 |

| DeepInfra | DeepSeek-V2.5 | ▶️ | Aktiv | scharf (von Messern oder Verstand) | 7.5/10 |

| DeepInfra | Qwen2.5-72B | ▶️ | Aktiv | mäßig | 7.5/10 |

| DeepInfra | Qwen2.5-Coder-32B | ▶️ | Aktiv | scharf (von Messern oder Verstand) | 7/10 |

| DeepInfra | QwQ-32B-Vorschau | ▶️ | Aktiv | sehr schnell | 7.5/10 |

| Blackbox | Sondermodell | ▶️ | Aktiv | scharf (von Messern oder Verstand) | 7.5/10 mit sehr schneller Generierung mit eingebauten Web-Suchfunktionen, aber optimiert für die Codierung. |

| Blackbox | lama-3.1-405b | ▶️ | Aktiv | scharf (von Messern oder Verstand) | 8.5/10 |

| Blackbox | Lama-3.1-70b | ▶️ | Aktiv | sehr schnell | 8/10 |

| Blackbox | gemini-1.5-Blitz | ▶️ | Aktiv | blitzschnell | 7.5/10 |

| Blackbox | qwq-32b-vorschau | ▶️ | Aktiv | blitzschnell | 6.5/10 |

| Blackbox | gpt-4o | ▶️ | Aktiv | sehr schnell | 7.5/10 |

| Blackbox | claude-3.5-sonnet | ▶️ | Aktiv | scharf (von Messern oder Verstand) | 8.5/10 |

| Blackbox | gemini-pro | ▶️ | Aktiv | scharf (von Messern oder Verstand) | 8/10 |

| DuckDuckGo | gpt-4o-mini | ▶️ | Aktiv | blitzschnell | 8/10, authentisches GPT-4o-mini-Modell mit starkem Schutz der Privatsphäre. |

| DuckDuckGo | claude-3-haiku | ▶️️ | Aktiv | blitzschnell | 7/10 |

| DuckDuckGo | meta-llama-3.1-70b | ▶️️ | Aktiv | sehr schnell | 7.5/10 |

| DuckDuckGo | Mixtral-8x7b | ▶️️ | Aktiv | blitzschnell | 7.5/10 |

| BestIM | gpt-4o-mini | ▶️ | Inaktiv | blitzschnell | 8.5/10 |

| Felsen | claude-3.5-sonnet | ▶️ | Aktiv | scharf (von Messern oder Verstand) | 8.5/10 |

| Felsen | claude-3-opus | ▶️ | Aktiv | scharf (von Messern oder Verstand) | 8/10 |

| Felsen | gpt-4o | ▶️ | Aktiv | scharf (von Messern oder Verstand) | 7.5/10 |

| Felsen | gpt-4 | ▶️ | Aktiv | scharf (von Messern oder Verstand) | 7.5/10 |

| Felsen | lama-3.1-405b | ▶️ | Aktiv | scharf (von Messern oder Verstand) | 7.5/10 |

| Felsen | Lama-3.1-70b | ▶️ | Aktiv | sehr schnell | 7/10 |

| ChatgptFree | gpt-4o-mini | ▶️ | Aktiv | blitzschnell | 8.5/10 |

| AI4Chat | gpt-4 | Aktiv | sehr schnell | 7.5/10 | |

| DarkAI | gpt-4o | ▶️ | Aktiv | sehr schnell | 8/10 |

| Mhystisch | gpt-4-32k | Aktiv | sehr schnell | 6.5/10 | |

| PizzaGPT | gpt-4o-mini | Aktiv | blitzschnell | 7.5/10 | |

| Meta-KI | meta-llama-3.1 | ▶️ | Aktiv | mäßig | 7/10, das neueste Modell mit Internetzugang. |

| Replizieren Sie | Mixtral-8x7b | ▶️ | Aktiv | mäßig | ?/10 |

| Replizieren Sie | meta-llama-3.1-405b | ▶️ | Aktiv | mäßig | ?/10 |

| Replizieren Sie | meta-llama-3-70b | ▶️ | Aktiv | mäßig | ?/10 |

| Replizieren Sie | meta-llama-3-8b | ▶️ | Aktiv | scharf (von Messern oder Verstand) | ?/10 |

| Phind | Phind Instant | ▶️ | Aktiv | blitzschnell | 8/10 |

| Google Internet-Unternehmen Zwillinge | Auto (gemini-1.5-pro, gemini-1.5-flash) | ▶️ 📄 | Aktiv | sehr schnell | 9/10, sehr gutes allgemeines Modell, erfordert jedoch einen API-Schlüssel. (Es istkostenlos(Bitte beachten Sie den folgenden Abschnitt) |

| Google Gemini (Experimentell) | Auto (ändert sich häufig) | ▶️ 📄 | Aktiv | sehr schnell | - |

| Google Gemini (Nachdenken) | Auto (ändert sich häufig) | ▶️ 📄 | Aktiv | sehr schnell | - |

| Benutzerdefinierte OpenAI-kompatible API | - | ▶️ | Aktiv | - | Ermöglicht Ihnen die Verwendung einer beliebigen benutzerdefinierten OpenAI-kompatiblen API. |

▶️ - Unterstützung von Streaming.

© urheberrechtliche Erklärung

Artikel Copyright AI-Austauschkreis Alle, bitte nicht ohne Erlaubnis vervielfältigen.

Ähnliche Artikel

Keine Kommentare...