Oliva: ein sprachgesteuerter Multi-Intelligenz-Assistent für die Produktsuche

Allgemeine Einführung

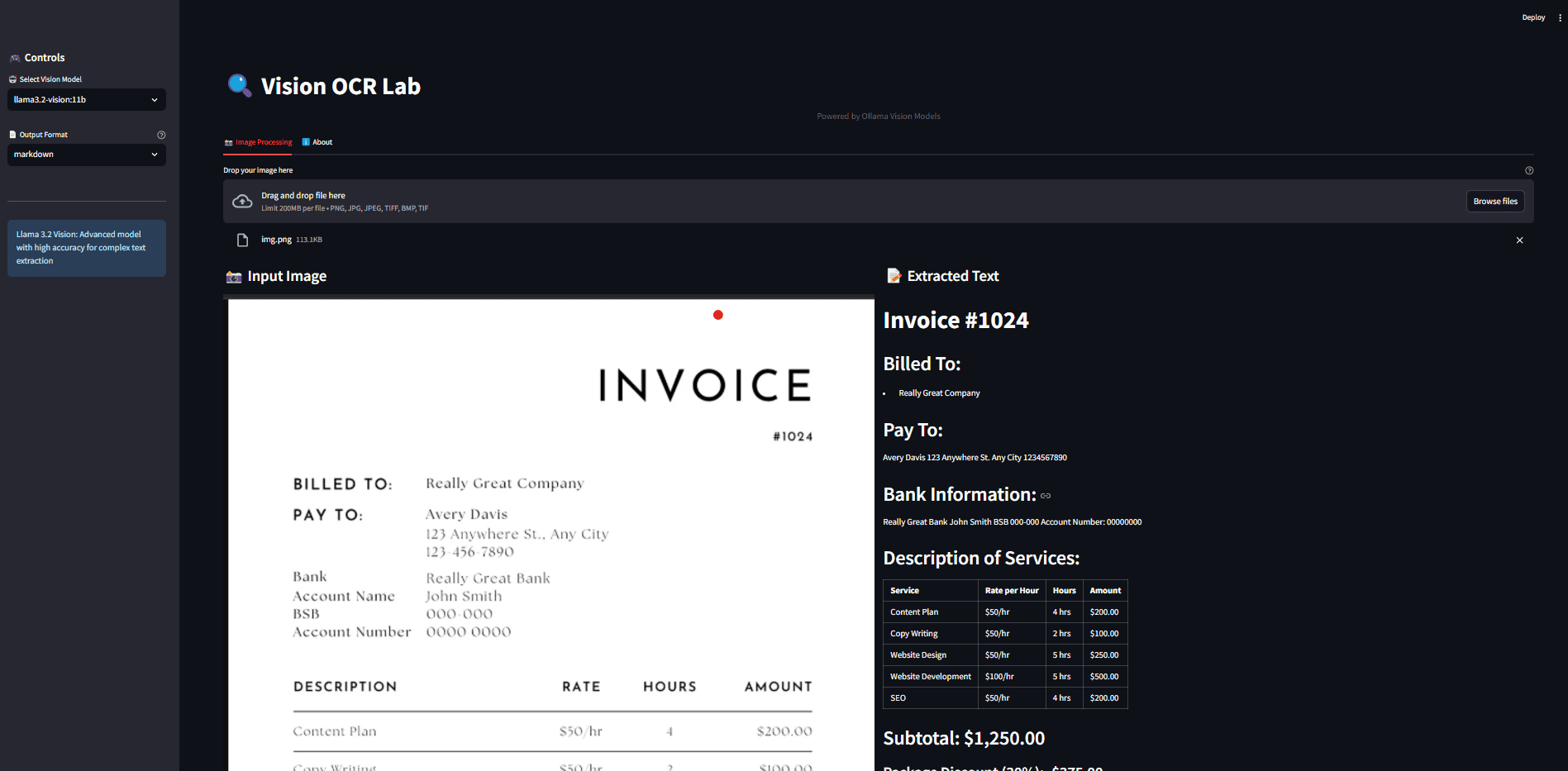

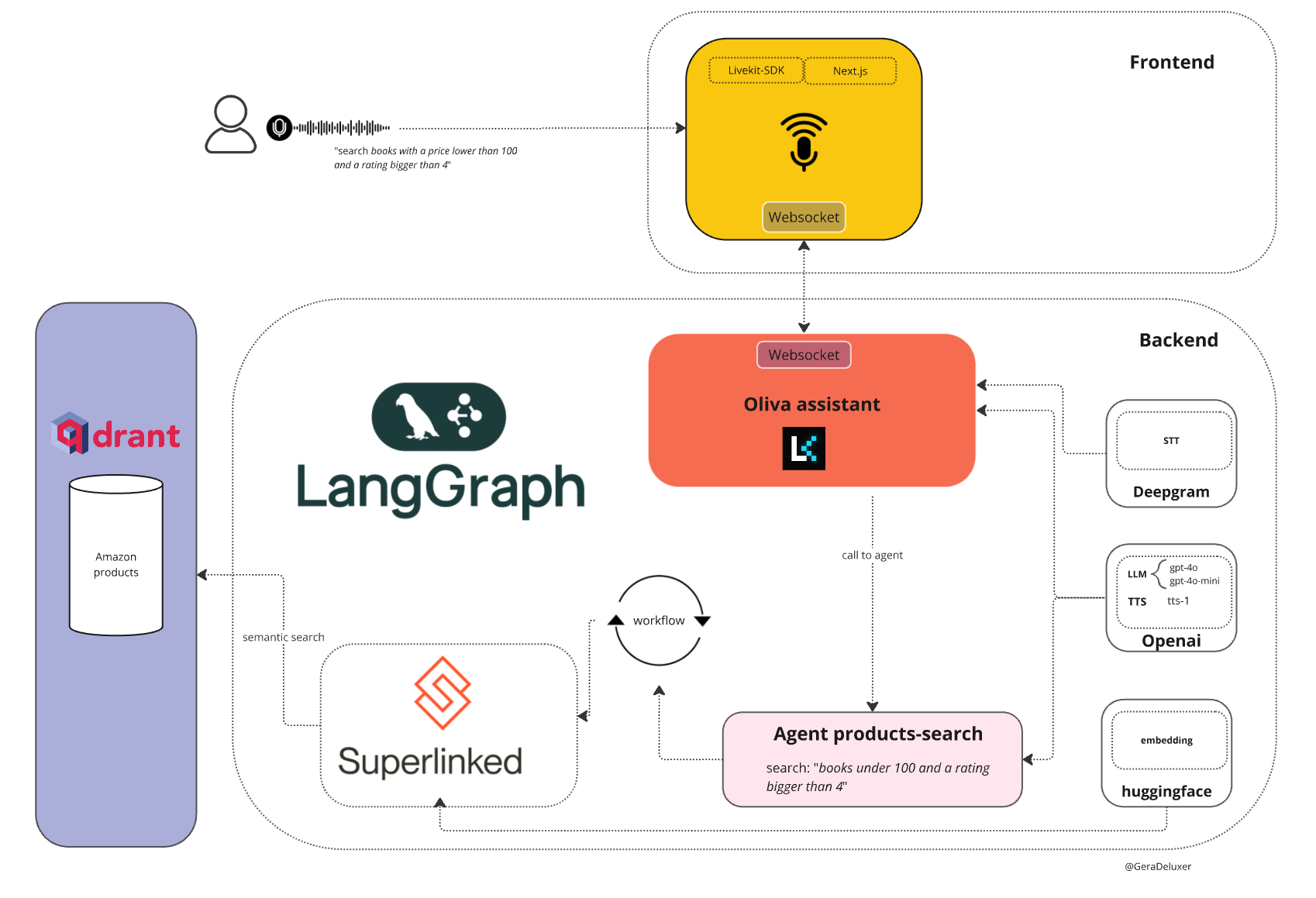

Oliva ist ein von Deluxer auf GitHub entwickeltes quelloffenes Multi-Intelligenz-Assistenz-Tool. Oliva ist ein von Deluxer auf GitHub entwickeltes quelloffenes Multi-Intelligenz-Assistenz-Tool, das Nutzern bei der Suche nach Produktinformationen in der Qdrant-Datenbank durch die Zusammenarbeit mehrerer KI-Intelligenzen hilft. Oliva ist für Entwickler und Forscher geeignet, und der Code steht den Nutzern vollständig zum Herunterladen, Ändern und Bereitstellen zur Verfügung. Es ist nicht nur ein praktisches Werkzeug, sondern auch eine Plattform, um etwas über Multiintelligenz-Architektur zu lernen. Das Projekt stützt sich auf moderne Technologie-Stacks wie Livekit und Deepgram, die Sprachinteraktion in Echtzeit unterstützen.

Funktionsliste

- Sprachgesteuerte Suche: Der Benutzer gibt per Stimme Befehle ein und der intelligente Körper erledigt die Suchaufgabe.

- Multi-Intelligenz-Zusammenarbeit: Mehrere KI-Intelligenzen teilen sich die Verarbeitungsaufgaben, koordiniert von einer übergeordneten Intelligenz.

- Unterstützung der semantischen Suche: Auf der Grundlage von LangChain und Superlinked ermöglicht sie die präzise Suche nach Inhalten.

- Offener Quellcode: Der vollständige Code wird zur Verfügung gestellt, und die Benutzer können die Funktionalität frei ändern und erweitern.

- Lokale oder Cloud-Bereitstellung: Unterstützung für den lokalen Betrieb oder auf einem Server mit hoher Flexibilität.

Hilfe verwenden

Oliva ist ein Open-Source-Projekt, das auf GitHub basiert. Sie müssen die Umgebung und die Abhängigkeiten vor der Verwendung konfigurieren. Im Folgenden finden Sie eine detaillierte Installations- und Nutzungsanleitung, die Ihnen einen schnellen Einstieg ermöglicht.

Einbauverfahren

- Vorbereiten der Python-Umgebung

Oliva benötigt Python 3.12 oder höher. Prüfen Sie die Version:

python --version

Wenn Sie nicht die richtige Version haben, können Sie sie von der Python-Website herunterladen und installieren.

- Klonprojekt

Öffnen Sie https://github.com/Deluxer/oliva, klicken Sie auf die Schaltfläche "Code", kopieren Sie den HTTPS-Link und führen Sie ihn aus:

git clone https://github.com/Deluxer/oliva.git

Sie müssen zuerst Git installieren, Download-Adresse: offizielle Git-Website.

- Wechseln Sie in das Projektverzeichnis

Herunterladen und in den Ordner gehen:

cd oliva

- Erstellen einer virtuellen Umgebung

Um Abhängigkeitskonflikte zu vermeiden, empfiehlt es sich, eine virtuelle Umgebung zu erstellen:

python -m venv .venv

Aktivieren Sie die Umwelt:

- Fenster:

.venv\Scripts\activate - Mac/Linux:

source .venv/bin/activate

- Installation von Abhängigkeiten

ausnutzenuvAbhängigkeiten bei der Werkzeugsynchronisation:

uv sync

Dadurch wird automatisch die virtuelle Umgebung erstellt und alle Abhängigkeiten wie LangChain, Superlinked usw. installiert. Wenn Sie nicht über uvinstallieren Sie es zuerst:

pip install uv

- Konfigurieren der Qdrant-Datenbank

Qdrant mit Docker ausführen:

docker run -p 6333:6333 -p 6334:6334 -e QDRANT__SERVICE__API_KEY=your_api_key -v "$(pwd)/qdrant_storage:/qdrant/storage:z" qdrant/qdrant

Sie müssen zuerst Docker installieren. Laden Sie es von der offiziellen Docker-Website herunter. Platzieren Sie die your_api_key Ersetzen durch einen benutzerdefinierten Schlüssel.

- Einrichten eines Livekit-Kontos

existieren Livekit Wolke Registrieren Sie sich für die folgenden Informationen:

LIVEKIT_URL=wss://your-project.livekit.cloud

LIVEKIT_API_KEY=your_key

LIVEKIT_API_SECRET=your_secret

Speichern Sie diese Werte in einer Umgebungsvariablen.

- Umgebungsvariablen konfigurieren

Kopieren Sie die Beispieldatei und bearbeiten Sie sie:

cp .env.example .env

existieren .env Die Datei ist gefüllt mit Livekit und Deepgram (Deepgram muss in der Deepgram Offizielle Website (Für den Zugang registrieren).

- Befüllung der Datenbank

auf der Grundlage von tabellarische-semantische-suche-lehrgang Anweisungen zum Einrichten der Daten, oder entpacken Sie einfach dieassets/snapshot.zipSchnappschüsse zu Qdrant.

Hauptfunktionen

- Starten des Sprachassistenten

Führen Sie es im Projektverzeichnis aus:

make oliva-start

Dadurch wird der Sprachassistenzdienst gestartet. Stellen Sie sicher, dass Qdrant und Livekit ausgeführt werden.

- Verbinden mit der Front-End-Schnittstelle

Interviews Agent SpielplatzWenn Sie ein Livekit-Projekt haben, geben Sie Ihre Livekit-Projekt-Anmeldeinformationen ein, um sich mit dem Assistenten zu verbinden. Oder führen Sie ihn lokal aus: - Klon (Lehnwort) Agent Spielplatz Lagerhaus::

git clone https://github.com/livekit/agents-playground.git - Installieren Sie die Abhängigkeiten und starten Sie:

npm install npm run start

Geben Sie einen Sprachbefehl in die Schnittstelle ein, z. B. "Suche nach einem Produkt".

- semantische Suche

Es gibt zwei Möglichkeiten der Suche: - Verwenden Sie Superlinked:

make agent-search-by-superlinked - Verwenden Sie JSON-Dateien:

make agent-search-by-json

Die Suchergebnisse werden von Intelligenzen aus der Qdrant-Datenbank geliefert.

Featured Function Bedienung

- Sprachinteraktion

Oliva unterstützt die Eingabe von Befehlen per Sprache. Nach dem Start, im Agent Spielplatz Klicken Sie auf das Mikrofonsymbol in Deepgram und sagen Sie, was Sie wollen (z. B. "Finde ein Mobiltelefon"). Deepgram wandelt die Sprache in Text um, und die Intelligenzen verarbeiten sie und liefern die Ergebnisse. Die Supervisor-Intelligenz entscheidet, welche Intelligenz die Aufgabe übernehmen soll. - Multi-Intelligenz-Zusammenarbeit

Das Projekt verwendet einen grafischen Workflow (LangGraph) mit mehreren Knoten (z. B. Suchen, Erzeugen) und bedingten Kanten. Die Konfigurationsdatei befindet sich im Verzeichnisapp/agents/langchain/config/in dem intelligentes Körperverhalten eingestellt werden kann. Die Kernlogik imapp/agents/Katalog. - Benutzerdefinierte Erweiterungen

Möchten Sie Funktionen hinzufügen? Bearbeiten Sieapp/agents/implementations/im Code des intelligenten Körpers. Um zum Beispiel ein neues Werkzeug hinzuzufügen, müssen Sie dieapp/agents/langchain/tools/Definiert in.

caveat

- Vergewissern Sie sich, dass Sie eine gute Internetverbindung haben. Livekit und Deepgram benötigen eine Internetverbindung.

- Das Projekt hat viele Abhängigkeiten, und die Erstkonfiguration kann mehrere Debugging-Sitzungen erfordern.

- Überprüfen Sie GitHub Commits, um sicherzustellen, dass Sie den neuesten Code verwenden.

Mit diesen Schritten können Sie Oliva vollständig ausführen und die sprachgesteuerte Suchfunktion erleben.

Anwendungsszenario

- Produkt-Informationen anfragen

Der Benutzer fragt per Sprache nach Produktdetails und Oliva liefert Ergebnisse aus der Qdrant-Datenbank, die sich für E-Commerce-Szenarien eignen. - Technisches Lernen

Die Entwickler untersuchen multiintelligente Körperarchitekturen und ändern den Code, um verschiedene Arbeitsabläufe zu testen. - Live-Demo

Demonstration der Sprachassistenten-Funktionalität in Meetings, um die Möglichkeiten der KI-Zusammenarbeit hervorzuheben.

QA

- Was soll ich tun, wenn mein Sprachassistent nicht antwortet?

Überprüfen Sie, ob die Livekit- und Deepgram-Schlüssel richtig konfiguriert sind und ob die Netzwerkverbindung funktioniert. - Was sollte ich tun, wenn Qdrant nicht startet?

Stellen Sie sicher, dass Docker ausgeführt wird und die Ports 6333 und 6334 nicht belegt sind. - Kann es offline verwendet werden?

Die Sprachfunktion erfordert eine Internetverbindung, und die Suchfunktion kann offline ausgeführt werden, wenn die Daten lokalisiert sind.

© urheberrechtliche Erklärung

Artikel Copyright AI-Austauschkreis Alle, bitte nicht ohne Erlaubnis vervielfältigen.

Ähnliche Artikel

Keine Kommentare...