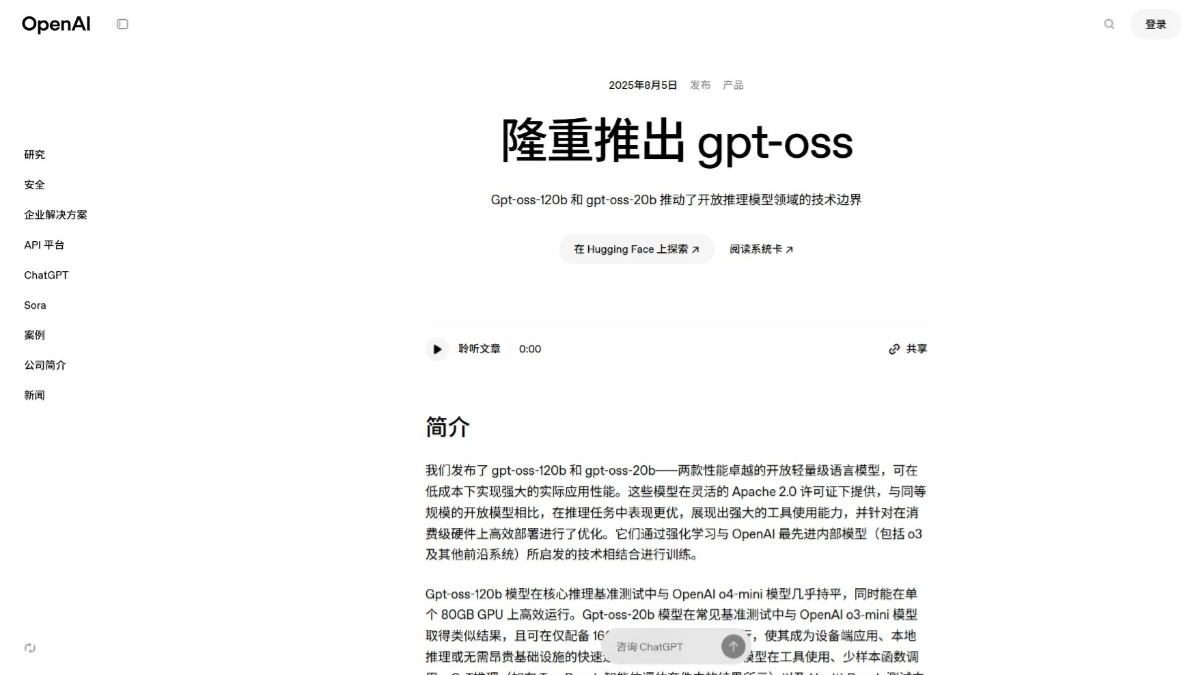

gpt-oss - eine Familie von quelloffenen Inferenzmodellen von OpenAI

Was ist gpt-oss

gpt-oss ist OpenAIs Familie von Open-Source-Inferenzmodellen, die effiziente, flexible und einfach zu implementierende KI-Lösungen für Entwickler ermöglichen. gpt-oss besteht aus zwei Versionen, gpt-oss-120B, mit 117 Milliarden Parametern und Unterstützung für den Betrieb auf 80-GB-Grafikprozessoren, und gpt-oss-20B, mit 21 Milliarden Parametern und Unterstützung für die Verwendung auf normalen Geräten mit 16 GB RAM. gpt-oss-20B mit 21 Milliarden Parametern für den Einsatz auf einem normalen Gerät mit 16 GB RAM. Beide basieren auf der MoE-Architektur, unterstützen eine Kontextlänge von 128k und bieten eine schnelle Inferenz mit einer Leistung, die der von o4-mini und o3-minigpt-oss unterstützt Werkzeugaufrufe, Kettendenken, eignet sich für mehrstufige Inferenzaufgaben und bietet Open-Source-Funktionen zur Anpassung von Gewichten und Inferenzstärke für verschiedene Szenarien.

Hauptmerkmale von gpt-oss

- Werkzeugtechnische FähigkeitenUnterstützung für den Aufruf externer Tools, wie z. B. Web-Suchen oder die Ausführung von Python-Code, um komplexe Aufgaben zu lösen.

- Unterstützung für verkettete SchlussfolgerungenDas Modell zerlegt komplexe Aufgaben Schritt für Schritt und löst sie dann einzeln. Es eignet sich für Probleme, die eine mehrstufige Argumentation erfordern.

- geringer RessourcenbedarfDas gpt-oss-20B läuft auf einem gewöhnlichen Gerät mit 16 GB RAM, und das gpt-oss-120B läuft auf einem einzelnen 80-GB-Grafikprozessor, der an verschiedene Hardwareumgebungen angepasst werden kann.

- Schnelle Reaktion auf SchlussfolgerungenDas Modell ist in der Lage, mit einer Geschwindigkeit von 40-50 Token/s zu schlussfolgern, und zeigt gute Leistungen in Szenarien, die schnelle Antworten erfordern.

- Open Source und AnpassungVollständige Modellgewichte und Code werden zur Verfügung gestellt, und die Benutzer können sie lokal anpassen, um die Anforderungen bestimmter Aufgaben besser zu erfüllen.

- Einstellbare InferenzstärkeAbschnitt: Unterstützt niedrige, mittlere und hohe Einstellungen für die Inferenzstärke, die der Benutzer je nach Bedarf und Szenario anpassen kann, wobei das Verhältnis zwischen Latenz und Leistung ausgewogen ist, um den besten Nutzen zu erzielen.

Die offizielle Website-Adresse von gpt-oss

- Projekt-Website:: https://openai.com/zh-Hans-CN/index/introducing-gpt-oss/

- GitHub-Repository:: https://github.com/openai/gpt-oss

- HuggingFace-Modellbibliothek:: https://huggingface.co/collections/openai/gpt-oss-68911959590a1634ba11c7a4

- Online-Erlebnis-Demo:: https://gpt-oss.com/

Leistung von gpt-oss

- Wettbewerb ProgrammierungIm Programmiertest des Codeforces-Wettbewerbs erreichte gpt-oss-120B 2622 Punkte und gpt-oss-20B 2516 Punkte. Beide Versionen schnitten besser ab als einige der Open-Source-Modelle und etwas schlechter als die Closed-Source o3-mini und o4-mini, die starke Programmierfähigkeiten demonstrieren.

- Allgemeine Problemlösunggpt-oss-120B übertrifft OpenAI's o3-mini und ist nahe am Niveau von o4-mini in MMLU (Multi-task Language Understanding) und HLE (Human Level Evaluation) Tests. Dies zeigt, dass gpt-oss eine hohe Genauigkeit und logisches Denkvermögen bei der Bewältigung von generischen Problemen hat.

- Werkzeug AufrufSowohl gpt-oss-120B als auch gpt-oss-20B übertreffen den o3-mini von OpenAI in der TauBench Intelligent Body Evaluation Suite und erreichen oder übertreffen sogar das Niveau des o4-mini. Dies zeigt, dass gpt-oss eine hohe Effizienz und Genauigkeit beim Aufrufen externer Tools (z. B. Websuche, Code-Interpreter usw.) aufweist und komplexe Probleme effektiv lösen kann.

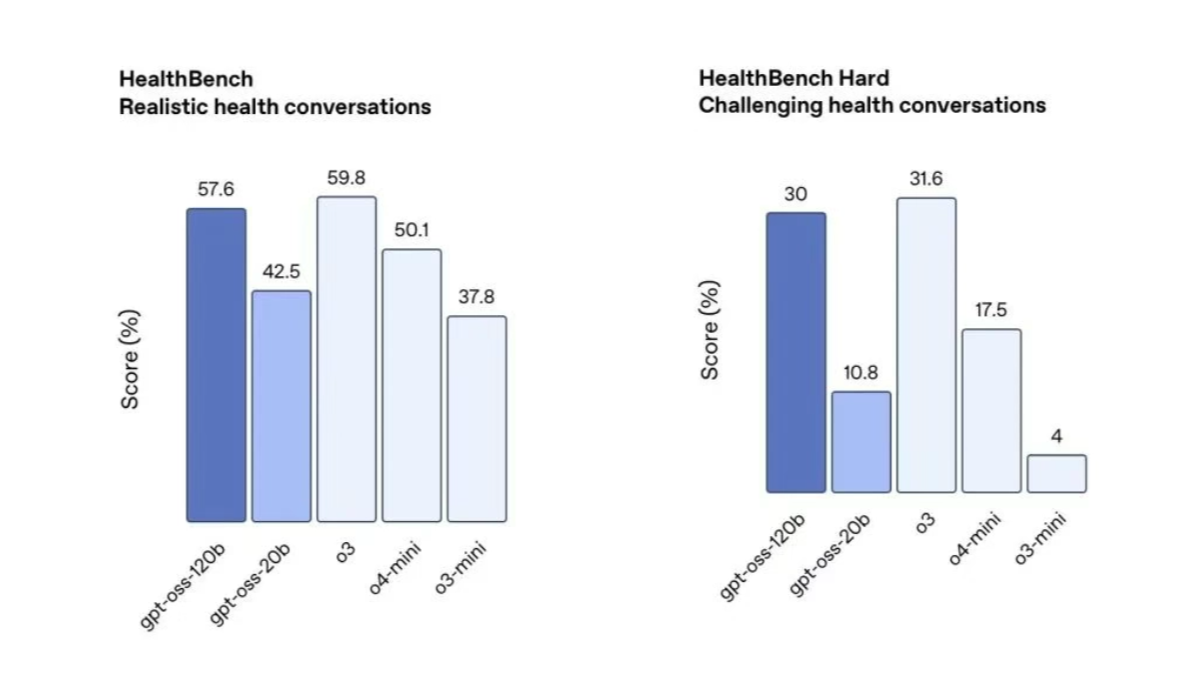

- Fragen und Antworten zur GesundheitIm HealthBench-Test übertrifft gpt-oss-120B den o4-mini, und gpt-oss-20B erreicht ein mit dem o3-mini vergleichbares Niveau. Dies zeigt, dass gpt-oss eine hohe Genauigkeit und Zuverlässigkeit im Umgang mit gesundheitsbezogenen Fragen hat und den Nutzern wertvolle Ratschläge und Informationen geben kann.

Wie man gpt-oss verwendet

- Plattform für Online-Erlebnisse::

- Online-Erlebnis-Adresse: Besuchen Sie das Online-Erlebnis unter https://gpt-oss.com/

- Verfahren::

- Öffnen Sie den obigen Link.

- Geben Sie eine Frage oder eine Anweisung auf der Webseite ein.

- Klicken Sie auf "Absenden", um eine Antwort des Modells zu erhalten.

- GitHub-Repository-Bereitstellung::

- Besuchen Sie das GitHub-Repository unter:: https://github.com/openai/gpt-oss

- Klon-Lager::

git clone https://github.com/openai/gpt-oss.git

cd gpt-oss- Installation von Abhängigkeiten::

pip install -r requirements.txt- Download ModellgewichteWählen Sie die Gewichtsdatei für gpt-oss-20b oder gpt-oss-120b aus und legen Sie sie im angegebenen Verzeichnis ab.

- BetriebsmodellAusführen des Modellinferenzskripts gemäß den Anweisungen im Repository. Beispiel:

python run_inference.py --model gpt-oss-20b --input "你的输入文本"Die wichtigsten Vorteile von gpt-oss

- Open Source und FlexibilitätVollständige Modellgewichte und Code werden zur Verfügung gestellt, um die lokale Feinabstimmung und Anpassung an spezifische Bedürfnisse zu unterstützen.

- Effiziente InferenzleistungInferenzgeschwindigkeiten von bis zu 40-50 Token/s, niedrige Latenzzeiten für schnelle Reaktionsszenarien.

- Breites Spektrum an EinsatzmöglichkeitenDas Unternehmen unterstützt eine breite Palette von Hardware-Umgebungen, von durchschnittlichen Geräten mit 16 GB RAM bis hin zu Hochleistungsgeräten mit 80-GB-GPUs.

- Starke ArgumentationUnterstützt verkettete Schlussfolgerungen und den Aufruf von Werkzeugen, was schrittweise Lösungen für komplexe Probleme ermöglicht und den Anwendungsbereich erweitert.

- Sicherheit und VerlässlichkeitDie Pre-Training-Phase filtert schädliche Daten und führt eine Feinabstimmung durch, um sicherzustellen, dass das Modell sicher und zuverlässig ist.

Personen, für die gpt-oss bestimmt ist

- Entwickler und IngenieureEntwickler und Ingenieure benötigen Open-Source-Modelle für die Projektentwicklung, das Rapid Prototyping oder die Anpassung, und die Flexibilität und der offene Quellcode der Modelle können diese Anforderungen erfüllen.

- Datenwissenschaftler und ForscherDatenwissenschaftler und Forscher interessieren sich für die internen Mechanismen des Modells und möchten diese feinabstimmen, experimentieren oder untersuchen. Der Open-Source-Charakter des Modells unterstützt sie dabei, das Modell eingehend zu untersuchen und zu optimieren.

- GeschäftskundeGeschäftsanwender benötigen leistungsstarke und kostengünstige Inferenzmodelle für intelligenten Kundenservice, Datenanalyse oder Automatisierungsaufgaben, für die die kostenlosen kommerziellen und effizienten Inferenzfunktionen des Modells ideal sind.

- Lehrkräfte und StudentenIn der Bildung als Lernhilfe, um Schülern bei der Beantwortung von Fragen zu helfen, Schreibhinweise zu geben oder Programmierübungen durchzuführen.

- kreativer MitarbeiterDas Modell hilft Schriftstellern, Drehbuchautoren, Spieleentwicklern usw., kreative Inhalte zu erstellen, sich inspirieren zu lassen und die kreative Effizienz zu steigern.

© urheberrechtliche Erklärung

Artikel Copyright AI-Austauschkreis Alle, bitte nicht ohne Erlaubnis vervielfältigen.

Ähnliche Artikel

Keine Kommentare...