GLM-4.5 - Smart Spectrum Open Source SOTA Modell für Reasoning, Code und Intelligenz

Was ist GLM-4.5

GLM-4.5 ist ein quelloffenes SOTA-Modell von Smart Spectrum, das für Anwendungen im Bereich der intelligenten Körper entwickelt wurde und die Funktionen der Argumentation, der Codegenerierung und des intelligenten Körpers umfasst. Das Modell basiert auf der Mixed Expert (MoE)-Architektur und besteht aus zwei Versionen, GLM-4.5 mit 355 Milliarden Parametern und GLM-4.5-Air mit 106 Milliarden Parametern und 32 Milliarden bzw. 12 Milliarden Aktivierungsparametern. Das Modell zeigt gute Leistungen bei der Argumentation, Codegenerierung und anderen Aufgaben, unterstützt multimodale Eingaben und Ausgaben und bietet einen "Denkmodus" und einen "Nicht-Denkmodus" zur Anpassung an komplexe Aufgaben und unmittelbare Reaktionsanforderungen. Das Modell zeichnet sich durch eine hohe Parametereffizienz, niedrige API-Aufrufkosten und eine hohe Generierungsgeschwindigkeit aus. Es eignet sich für Full-Stack-Entwicklung, Programmierhilfe, Inhaltserstellung und andere Szenarien und ist damit das derzeit beste Open-Source-Modell.

Hauptfunktionen von GLM-4.5

- logisches DenkvermögenGLM-4.5 ist in der Lage, komplexe Denkaufgaben zu bewältigen, wie z.B. logisches Denken, mathematisches Problemlösen usw. Die Denkfähigkeit ist in einer Reihe von Benchmarks ausgezeichnet und liegt auf dem höchsten Niveau von Open-Source-Modellen.

- CodegenerierungDas Modell generiert qualitativ hochwertige Codeschnipsel und unterstützt mehrere Programmiersprachen. Es hilft Entwicklern, schnell Code-Frameworks zu generieren, Code-Fehler zu beheben, die Code-Struktur zu optimieren usw., und ist kompetent bei Full-Stack-Entwicklungsaufgaben.

- Intelligent Body AnwendungenUnterstützung für Tool-Aufrufe, Web-Browsing und andere Funktionen, Unterstützung für den Zugriff auf Code Intelligence Body Frameworks wie Claude Code und Roo Code für Aufgaben des intelligenten Körpers für komplexe Anwendungen des intelligenten Körpers.

- Generierung von InhaltenEs kann verschiedene Arten von Inhalten generieren, wie z. B. Artikel, Nachrichtenberichte, kreative Texte usw. Es eignet sich für die Erstellung von Inhalten, Werbetexten und anderen Szenarien und bietet dem Benutzer Unterstützung bei der Generierung von Rich Text.

GLM-4.5 offizielle Website-Adresse

- GitHub-Repository:: https://github.com/zai-org/GLM-4.5

- HuggingFace Lagerhaus: https://huggingface.co/collections/zai-org/glm-45-687c621d34bda8c9e4bf503b

- ModelScope Lagerhaus:: https://modelscope.cn/collections/GLM-45-b8693e2a08984f

- Online-Erlebnis-Demo::

- HuggingFace: https://huggingface.co/spaces/zai-org/GLM-4.5-Space

- ModelScope:: https://modelscope.cn/studios/ZhipuAI/GLM-4.5-Demo

Wie man GLM-4.5 verwendet

- Erfahrung mit Online-Plattformen::

- Wisdom Spectrum Clear Speech Plattform: Zugangintellektuell anregende RedeWebsite, um die volle Funktionalität von GLM-4.5, einschließlich Dialoggenerierung, Codegenerierung und Inferenzaufgaben, direkt und kostenlos zu erleben.

- Z.ai-Plattform: durch Z.ai Plattform, auf der Sie die Funktionen von GLM-4.5 schnell ausprobieren und testen können.

- API-AufrufeSmart Spectrum AI bietet eine API-Schnittstelle, auf die Benutzer über die BigModel.co.uk Die Plattform führt API-Aufrufe durch. Die API unterstützt eine Vielzahl von Funktionen, einschließlich Texterstellung, Codegenerierung und Inferenzaufgaben.

- Bereitstellung durch offenen Quellcode::

- GitHub-RepositorienBesuchen Sie das GitHub-Repository für GLM-4.5, um den Modellcode und zugehörige Ressourcen zu erhalten, die Sie selbst einsetzen und verwenden können.

- HuggingFace LagerhausBesuchen Sie das HuggingFace-Repository für GLM-4.5, um mit den von HuggingFace bereitgestellten Tools und Umgebungen zu testen.

- ModelScope LagerhausZugriff auf das ModelScope-Repository in GLM-4.5 für die Modellbereitstellung und Anwendungsentwicklung unter Verwendung der ModelScope-Plattformfunktionalität.

- HuggingFace ErlebnisraumBesuchen Sie den GLM-4.5 Experience Space von HuggingFace, um die Funktionen des Modells zu testen.

- ModelScope ErlebnisraumBesuchen Sie ModelScopes GLM-4.5 Experience Space für Online-Erfahrungen und Tests.

Technische Indikatoren von GLM-4.5

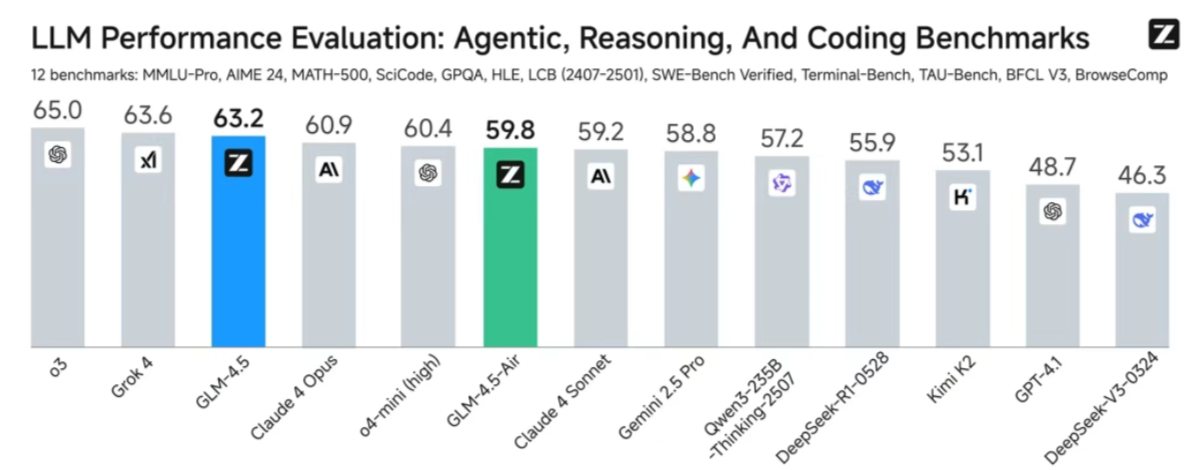

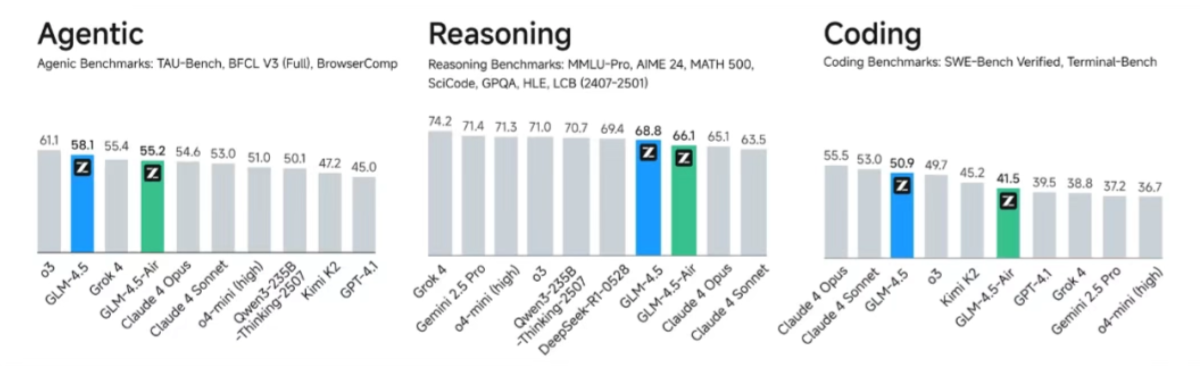

- Gesamtleistung SOTAUnter 12 repräsentativen Evaluierungsbenchmarks erreichte GLM-4.5 den dritten Platz bei globalen Modellen, den ersten Platz bei inländischen Modellen und den ersten Platz bei Open-Source-Modellen. Zu den Evaluierungs-Benchmarks gehören MMLU Pro, AIME 24, MATH 500, SciCode, GPQA, HLE, LiveCodeBench, SWE-Bench Verified, Terminal-Bench, TAU-Bench, BFCL v3 und BrowseComp, was beweist, dass GLM-4.5 für mehrere Inferenzen, Code-Generierung und intelligente Körperanwendungen verwendet werden kann. Die hervorragende Leistung von GLM-4.5 in verschiedenen Szenarien wie Inferenz, Codegenerierung und intelligenten Anwendungen.

- Höhere ParametereffizienzGLM-4.5 hat nur die Hälfte der Anzahl der Parameter von DeepSeek-R1 und ein Drittel der Anzahl von Kimi-K2 und schneidet bei vielen Standard-Benchmarks deutlich besser ab. In der SWE-Bench Verified-Liste, die die Leistungsfähigkeit des Modellcodes misst, liegt die GLM-4.5-Serie an der Pareto-Grenze des Verhältnisses von Leistung zu Parametern, was bedeutet, dass die GLM-4.5-Serie bei gleichem Maßstab die beste Leistung erzielt.

- Geringe Kosten, hohe GeschwindigkeitDie GLM-4.5-Reihe erzielt bahnbrechende Ergebnisse in Bezug auf Kosten und Effizienz bei gleichzeitiger Optimierung der Leistung: Der Preis für API-Aufrufe liegt bei nur 0,8 $/Million Token für die Eingabe und 2 $/Million Token für die Ausgabe und damit deutlich unter den Preisen der Mainstream-Modelle. Die Hochgeschwindigkeitsversion kann bis zu 100 Token/Sek. generieren, was niedrige Latenzzeiten und hohe Gleichzeitigkeit unterstützt, wobei die Kosteneffizienz und das interaktive Erlebnis berücksichtigt werden.

Die wichtigsten Vorteile von GLM-4.5

- Integration von MehrfachkompetenzenGLM-4.5 ist das erste Modell, das Argumentation, Codegenerierung und intelligente Körperfunktionen vereint, um gleichzeitig die vielfältigen Anforderungen komplexer Argumentation, Codeentwicklung und intelligenter Körperaufgaben zu erfüllen.

- Ausgezeichnete InferenzleistungGLM-4.5 steht in mehreren Benchmarks für logisches Denken an der Spitze des Open-Source-Modells und ist in der Lage, komplexe Denkaufgaben wie logisches Denken, mathematisches Problemlösen und andere leistungsstarke Denkfähigkeiten zu bewältigen.

- Effizientes hybrides ArgumentationsmodellDas Modell sieht zwei Arten des Denkens vor, den "Denkmodus" und den "Nicht-Denkmodus". Der Denkmodus eignet sich für komplexe Aufgaben, die tiefgreifende Analysen erfordern, während der Nicht-Denkmodus schnelle Antworten auf unmittelbare Bedürfnisse ermöglicht und ein Gleichgewicht zwischen Effizienz und Leistung schafft.

- Hohe ParametereffizienzGLM-4.5 hat eine geringe Anzahl von Parametern, schneidet aber bei vielen Standard-Benchmarks besser ab. Zum Beispiel führt GLM-4.5 das Verhältnis Leistung/Parameter bei Tests der Codegenerierungsfähigkeit an.

- Geringe Kosten und hohe GeschwindigkeitDie API-Aufrufe von GLM-4.5 sind sehr erschwinglich, mit Eingabekosten von nur 0,8 $/Millionen Token und Ausgabekosten von 2 $/Millionen Token sowie Generierungsgeschwindigkeiten von bis zu 100 Token/Sekunde, was Implementierungen mit niedriger Latenz und hoher Währung unterstützt.

- multimodale UnterstützungGLM-4.5 unterstützt multimodale Ein- und Ausgaben und kann mehrere Datentypen wie Text und Bilder verarbeiten, was die Handhabung komplexer intelligenter Körperaufgaben erleichtert, z. B. bei multimodalen Interaktionsszenarien wie Web-Browsing und Tool-Aufruf.

Personen, für die GLM-4.5 bestimmt ist

- Entwickler und ProgrammiererSchnelles Generieren von Code-Frameworks, Beheben von Fehlern, Optimieren von Strukturen und Verbessern der Entwicklungseffizienz mit Hilfe von Code-Generierungs- und Programmierhilfefunktionen.

- Ersteller von InhaltenSchnelles Erstellen von ersten Entwürfen für Artikel, Nachrichten, Kreativtexte und vieles mehr, das kreative Inspiration bietet und hilft, kreative Engpässe zu überwinden.

- Akademische ForscherAls Forschungsinstrument zur Erforschung aktueller Themen im Bereich der natürlichen Sprachverarbeitung und der künstlichen Intelligenz zum Vergleich und zur Verbesserung von Modellen.

- GeschäftskundeIntelligente Kundenbetreuung, Erstellung von Datenanalyseberichten und Entwicklung von Automatisierungstools zur Verbesserung der Effizienz von Geschäftsabläufen.

- Lehrkräfte und StudentenLehrer erstellen Lehrmaterial und Schüler nutzen ihre Lernunterstützungsfunktionen, z. B. zum Erstellen von Notizen und Erklären von Konzepten.

© urheberrechtliche Erklärung

Artikel Copyright AI-Austauschkreis Alle, bitte nicht ohne Erlaubnis vervielfältigen.

Ähnliche Artikel

Keine Kommentare...