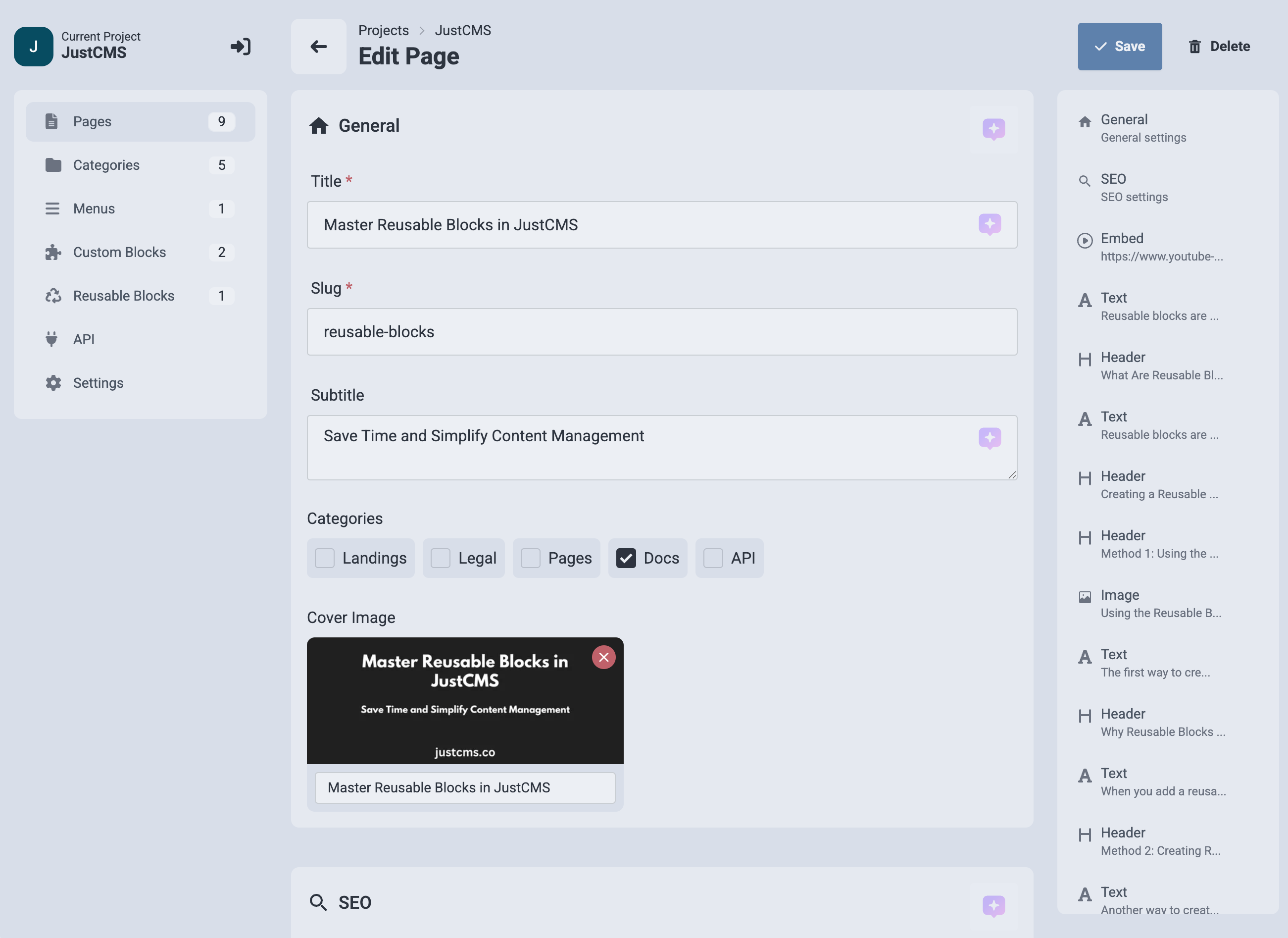

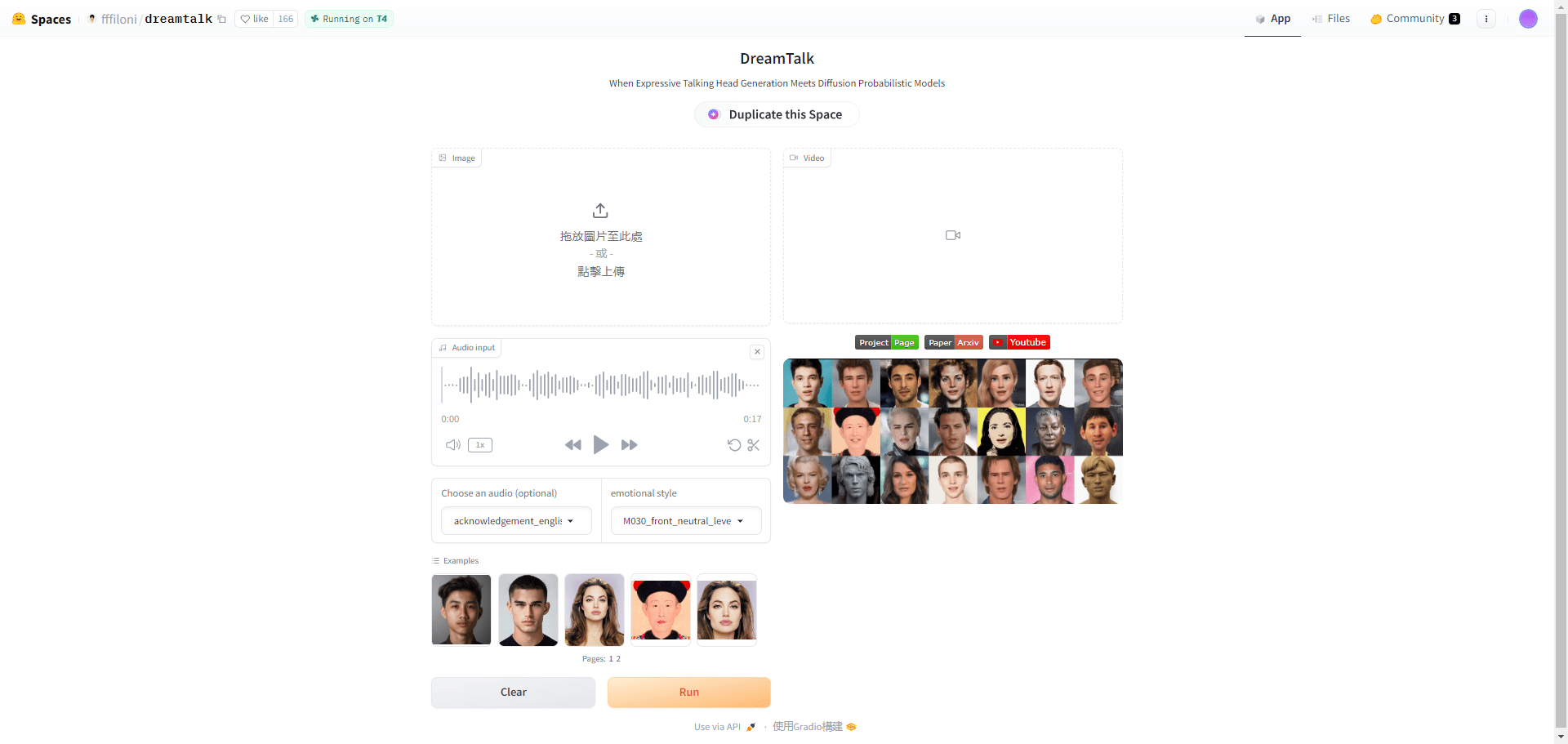

DreamTalk: Erzeugen Sie ausdrucksstarke Sprechvideos mit einem einzigen Avatarbild!

DreamTalk Allgemeine Einführung

DreamTalk ist ein diffusionsmodellgesteuertes System zur Erzeugung ausdrucksstarker Sprecherköpfe, das gemeinsam von der Tsinghua-Universität, der Alibaba-Gruppe und der Huazhong-Universität für Wissenschaft und Technologie entwickelt wurde. Es besteht aus drei Hauptkomponenten: einem Netzwerk zur Rauschunterdrückung, einem Lippenexperten und einem Stilprädiktor. Es ist in der Lage, vielfältige und realistische Sprecherköpfe auf der Grundlage von Audioeingaben zu erzeugen. Das System ist in der Lage, mehrsprachige und verrauschte Audiodaten zu verarbeiten und liefert qualitativ hochwertige Gesichtsbewegungen und eine genaue Mundsynchronisation.

DreamTalk-Funktionsliste

Erzeugen Sie realistische Videos mit sprechenden Köpfen auf der Grundlage von Audiodaten

Unterstützt mehrere Sprachen und Spracheingabe

Unterstützt die Ausgabe von mehreren Stilen und Ausdrücken

Unterstützung für benutzerdefinierte Charakter-Avatare und Stilreferenzen

Unterstützung für Online-Demo und Code-Download

DreamTalk-Hilfe

Besuchen Sie die Projekt-Homepage für weitere Informationen und Demo-Videos

Besuchen Sie die Adresse des Papiers, um technische Details und experimentelle Ergebnisse zu lesen

Besuchen Sie die GitHub-Adresse, um den Code und das vorab trainierte Modell herunterzuladen

Folgen Sie der Installationsanleitung, um die Umgebung und die Abhängigkeiten zu konfigurieren

Führen Sie inference_for_demo_video.py aus, um Schlussfolgerungen zu ziehen und das Video zu erzeugen

Einstellen der Ein- und Ausgabeoptionen gemäß den Parameterbeschreibungen

DreamTalk Online-Erlebnis-Adresse

© urheberrechtliche Erklärung

Artikel Copyright AI-Austauschkreis Alle, bitte nicht ohne Erlaubnis vervielfältigen.

Ähnliche Artikel

Keine Kommentare...