AI no jimaku gumi: Automatische Generierung und Übersetzung von mehrsprachigen Untertiteln für Videos mit Hilfe von KI

Allgemeine Einführung

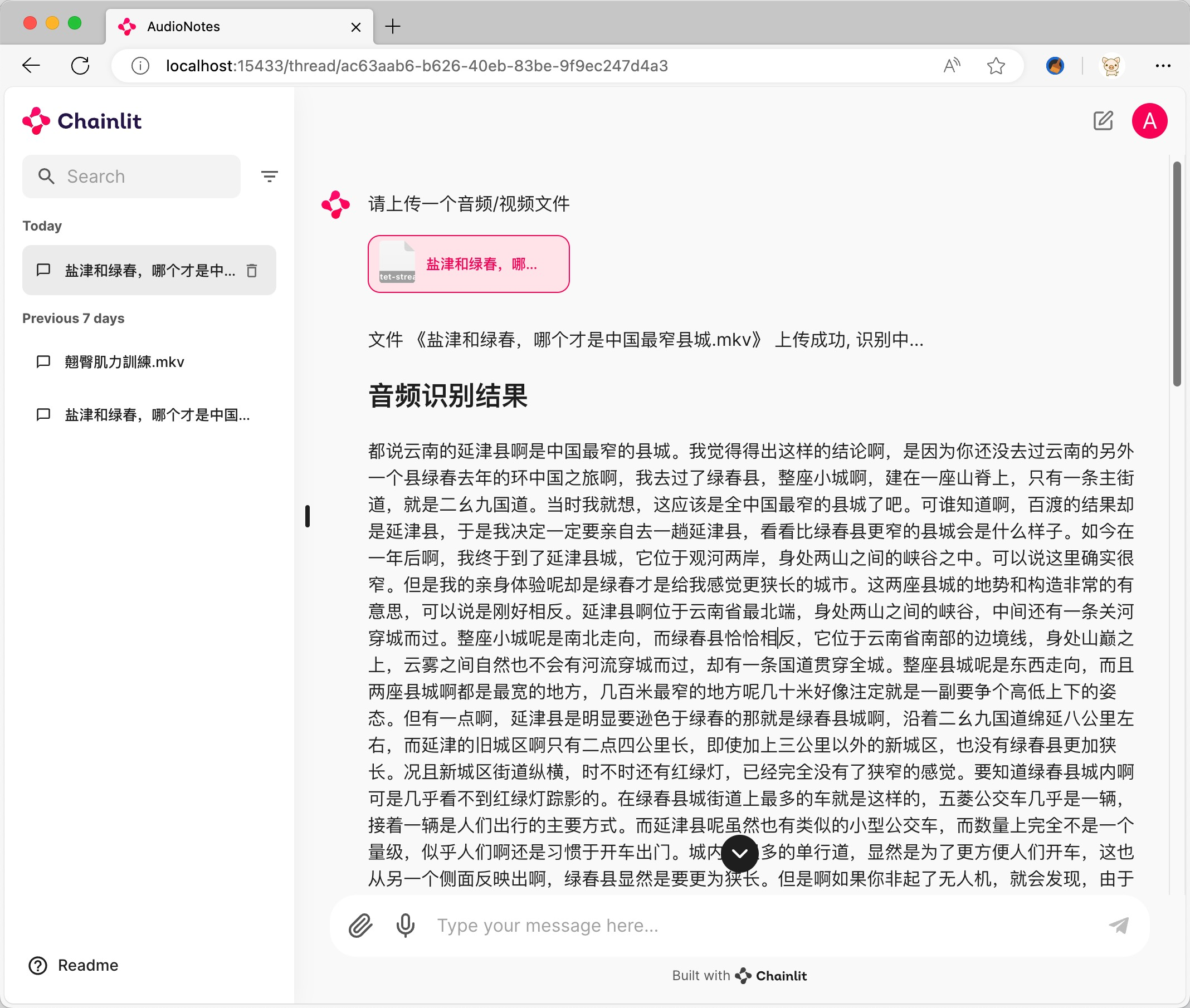

AI no jimaku gumi (AI no subtitle group) ist ein leistungsstarkes Kommandozeilen-Tool zur Verarbeitung von Videountertiteln, das sich auf die automatische Extraktion, Transkription und Übersetzung von Videountertiteln konzentriert. Das Tool integriert fortschrittliche KI-Technologien, darunter Flüstern Spracherkennungsmodelle und eine Vielzahl von Übersetzungs-Backends (z. B. DeepL, LLM usw.) ermöglichen eine effiziente Verarbeitung von Video- und Audioinhalten und die Erstellung von qualitativ hochwertigen Untertiteldateien. Es unterstützt die Konvertierung zwischen mehreren Sprachen, darunter Englisch, Japanisch, Chinesisch, Koreanisch und andere gängige Sprachen, und bietet flexible Optionen für die Ausgabe von Untertiteln. Als Open-Source-Projekt stellt es nicht nur den vollständigen Quellcode zur Verfügung, sondern unterstützt auch die plattformübergreifende Nutzung und kann unter Linux, macOS und anderen wichtigen Betriebssystemen ausgeführt werden.

Funktionsliste

- Automatische Extraktion von Audioinhalten aus Videos und Erkennung von Sprache

- Unterstützt mehrere Untertitelquellen: Audioerkennung, Container-Extraktion, OCR-Erkennung

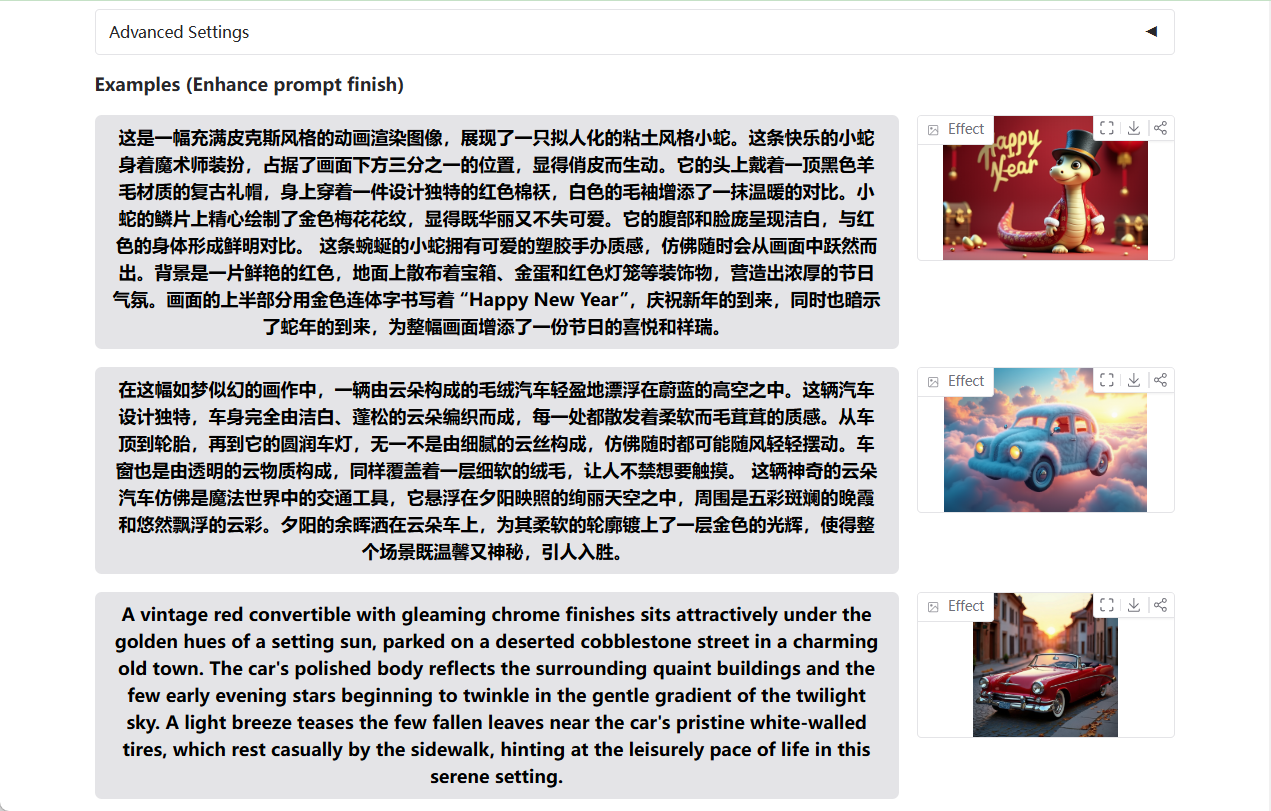

- Integration mit mehreren Übersetzungs-Backends: DeepL, LLM, etc.

- Unterstützung für die Übersetzung aus und in viele gängige Sprachen

- Konfigurierbares Untertitel-Ausgabeformat (derzeit wird das SRT-Format unterstützt)

- Unterstützt das Abfangen und Verarbeiten von Videoclips

- Bietet Debugging-Modi: nur Audioextraktion, nur Transkription, nur Übersetzung und andere Optionen

- Unterstützung für benutzerdefinierte AI-Modellpfade und Konfigurationen

- Plattformübergreifende Unterstützung (Linux, macOS, Windows werden unterstützt)

Hilfe verwenden

1. die Vorbereitung der Umwelt

Windows-Systeme in Vorbereitung...

Abhängigkeiten von der Linux-Systeminstallation:

- Ubuntu-Benutzer:

apt-get install -y clang cmake make pkg-config libavcodec-dev libavdevice-dev libavfilter-dev libavformat-dev libavutil-dev libpostproc-dev libswresample-dev libswscale-dev

- Fedora-Benutzer:

dnf install clang cmake ffmpeg-free-devel make pkgconf-pkg-config

- Arch Linux Benutzer:

pacman -S clang cmake ffmpeg make pkgconf

macOS-Systeminstallationsabhängigkeiten:

Verwenden Sie den Homebrew-Paketmanager:

brew install cmake ffmpeg

2. die Installationsschritte

- Klonen Sie das Code-Repository:

git clone https://github.com/Inokinoki/ai-no-jimaku-gumi.git

cd ai-no-jimaku-gumi

- Kompilieren Sie das Projekt:

cargo build

- Laden Sie das Modell Whisper herunter:

wget https://huggingface.co/ggerganov/whisper.cpp/resolve/main/ggml-tiny.bin

3. grundlegende Verwendung

Das Tool bietet mehrere Konfigurationsmöglichkeiten:

--input-video-path: Geben Sie den Pfad der Eingangsvideodatei an (erforderlich)--source-languageQuellsprache (Standard: ja)--target-languageSprache: Zielsprache (Standard: en)--ggml-model-pathAI-Modellpfad (Standard: ggml-tiny.bin)--subtitle-output-pathUntertitel: Untertitel-Ausgabepfad (Standard: output.srt)

4. die Backend-Konfiguration der Übersetzung

DeepL translation backend (Standard):

- Setzen von Umgebungsvariablen:

export DEEPL_API_KEY=你的API密钥

export DEEPL_API_URL=https://api.deepl.com # 付费API版本需要

LLM Translation Backend:

- Setzen von Umgebungsvariablen:

export CUSTOM_API_KEY=sk-xxxxxxxxxxxxxxxxxxxxxxx

- Beispiel für die Verwendung:

./target/debug/ainojimakugumi --input-video-path video.webm \

--translator-backend llm \

--llm-api-base https://your-api-endpoint.com/v1/ \

--llm-prompt 'translate this to English' \

--llm-model-name 'gpt-4o-mini' \

--ggml-model-path ggml-small.bin

5. erweiterte Funktionen

- ausnutzen

--start-timeim Gesang antworten--end-timeKann bestimmte Videoclips verarbeiten --only-extract-audioNur Audio extrahieren (zur Fehlersuche)--only-transcript: Nur Untertitel in der Originalsprache--only-translateNur Übersetzungsfunktion- Unterstützt mehrere Optionen für Untertitelquellen: Audio (Standard), Container, OCR.

© urheberrechtliche Erklärung

Artikel Copyright AI-Austauschkreis Alle, bitte nicht ohne Erlaubnis vervielfältigen.

Ähnliche Artikel

Keine Kommentare...