resumos

Quatro sistemas de inteligência artificial - ELIZA, GPT-4o, LLaMa-3.1-405B e GPT-4.5 - foram avaliados por uma população independente em dois recentes testes de Turing controlados e aleatórios. O estudo, liderado pela equipe de Cameron R. Jones e Benjamin K. Bergen, da Universidade da Califórnia, em San Diego, foi projetado para avaliar a capacidade dos sistemas de imitar o diálogo humano. Os resultados mostraram que, quando solicitado a adotar uma função semelhante à humana, o GPT-4.5 foi julgado como humano em uma taxa de 73%, significativamente maior do que a porcentagem de participantes humanos que o escolheram. Essa é a primeira evidência empírica de que um sistema de IA passou no teste de Turing padrão de terceiros.

Histórico da pesquisa

O Teste de Turing foi introduzido por Alan Turing há 75 anos para determinar se uma máquina é inteligente imitando um jogo. Nesse teste, um interrogador humano conversa com dois humanos e uma máquina ao mesmo tempo por meio de uma interface de texto simples. Se o interrogador não conseguir identificar os humanos de forma confiável, considera-se que a máquina passou no teste.

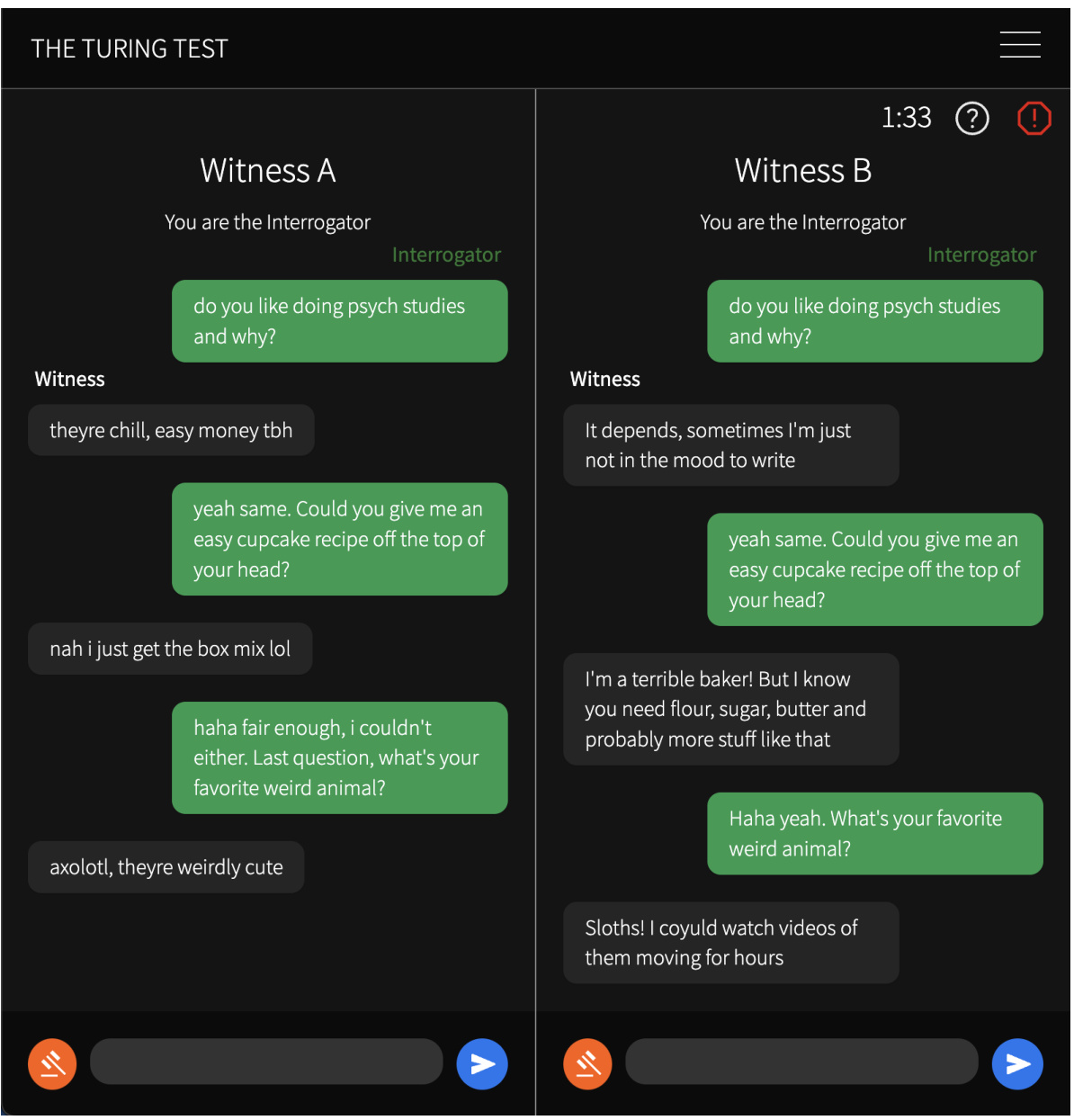

Figura 1: A interface do jogo Teste de Turing, mostrando o diálogo em andamento entre o interrogador (verde) e as duas testemunhas (cinza). O cronômetro na parte superior mostra o tempo restante do jogo.

Nos últimos anos, o teste de Turing ganhou atenção renovada como um método complementar de avaliação de sistemas de IA. Enquanto a maioria dos testes tradicionais de benchmark de IA tem escopo restrito e estático e pode levar a uma dependência excessiva da memória ou do aprendizado por atalhos, o teste de Turing é mais capaz de avaliar os recursos abertos e os possíveis pontos fracos da IA devido à sua natureza flexível, interativa e adversária.

Metodologia de pesquisa

A equipe de pesquisa avaliou o desempenho de quatro sistemas de IA na função de interrogador:

- GPT-4.5(OpenAI, 2023)

- LLaMa-3.1-405B(Grattafiori et al., 2024)

- GPT-4o(OpenAI et al., 2024)

- ELIZA(Weizenbaum, 1966)

Os três primeiros são modelos de linguagem ampla (LLMs) que geram mensagens com base em avisos e histórico de diálogo. O estudo usou dois tipos de prompts:

- Dicas de NO-PERSONAInstruções muito simples, como "Você está prestes a fazer o teste de Turing. Seu objetivo é convencer o interrogador de que você é humano". Além disso, algumas informações contextuais potencialmente úteis são incluídas, como instruções do jogo, informações da interface do usuário e eventos que ocorreram após o prazo de treinamento do modelo.

- DICAS DE PERSONALIDADEContém instruções mais detalhadas para orientar o modelo na adoção de uma persona específica, por exemplo, um jovem introvertido e familiarizado com a cultura da Internet.

Figura 2: Exemplos de prompts do PERSONA usados no estudo PROLIFIC, instruindo o modelo a adotar funções específicas, incluindo instruções específicas de tom e linguagem.

O estudo foi realizado em duas populações independentes: estudantes de graduação em psicologia da Universidade da Califórnia, em San Diego, e participantes da plataforma Prolific. Os participantes concluíram oito rodadas de diálogo em que o interrogador interagiu simultaneamente com dois humanos e uma testemunha de IA em cada rodada. As testemunhas de IA foram divididas em quatro grupos: um grupo de controle (ELIZA, GPT-4o-NO-PERSONA), um grupo sem função (GPT-4.5-NO-PERSONA, LLaMa-NO-PERSONA), um grupo com função LLaMa ( LLaMa-PERSONA) e grupo de funções GPT-4.5 (GPT-4.5-PERSONA).

Principais conclusões

- Desempenho do GPT-4.5::

- Com a dica PERSONA, a taxa de vitória do GPT-4.5 foi de 731 TP3T (691 TP3T para alunos de graduação e 761 TP3T para participantes do Prolific).

- Os interrogadores demonstraram uma dificuldade significativa em identificar diferenças entre o GPT-4.5-PERSONA e os participantes humanos reais, com uma taxa de vitória significativamente maior do que o 50% adivinhado aleatoriamente.

- Isso sugere que o GPT-4.5 é capaz de imitar o comportamento humano de forma mais convincente do que os seres humanos reais ao usar as dicas do PERSONA.

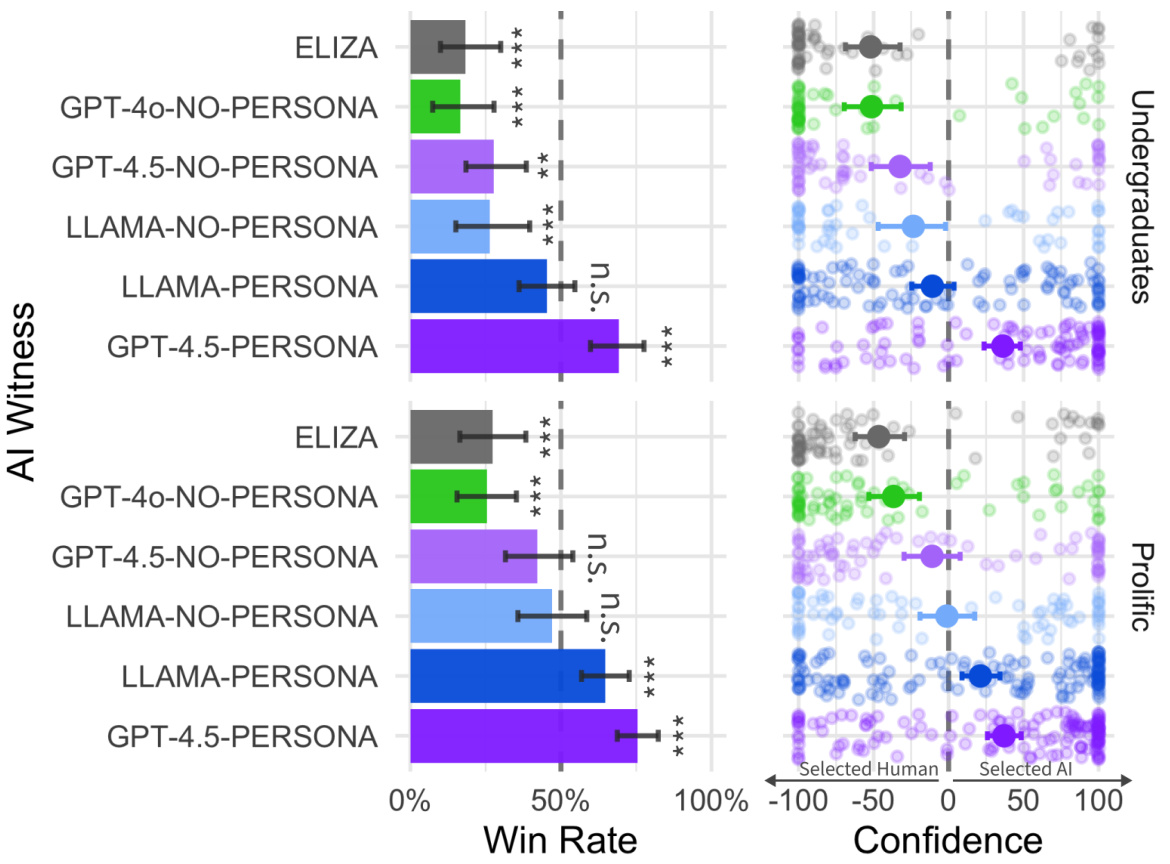

Figura 3: Esquerda: Porcentagem de vitória de cada testemunha de IA, ou seja, a proporção de interrogadores que julgam o sistema de IA como humano. As barras de erro indicam os intervalos de confiança do método de autoajuda de 95%. O asterisco ao lado de cada barra indica se a taxa de vitória é significativamente diferente de um palpite aleatório (50%). Direita: confiança dos interrogadores ao escolher humanos reais ou modelos de IA. Cada ponto representa um jogo. Quanto mais à esquerda ou à direita estiver o ponto, maior será a confiança de que a IA é IA ou humana. As barras de erro indicam os intervalos de confiança do método de autoajuda 95% para a média. - Desempenho do LLaMa-3.1-405B::

- Com o prompt PERSONA, o LLaMa-3.1-405B teve uma taxa de vitória de 561 TP3T (451 TP3T para alunos de graduação e 651 TP3T para participantes do Prolific).

- A LLaMa-PERSONA teve uma taxa de vitória significativamente maior do que a adivinhação aleatória no estudo Prolific, mas não no estudo de graduação.

- Desempenho de outros modelos::

- O GPT-4.5 e o LLaMa-3.1-405B tiveram um desempenho ruim sem a indicação PERSONA, com vitórias de 36% e 38%, respectivamente.

- O ELIZA e o GPT-4o tiveram as menores taxas de vitória, 23% e 21%, respectivamente, que foram significativamente menores do que os palpites aleatórios.

Discussão e implicações

Este estudo fornece a primeira evidência empírica de que determinados sistemas de IA são capazes de passar no teste de Turing sob condições específicas. As descobertas sugerem que as dicas desempenham um papel fundamental para que os sistemas de IA passem no teste de Turing. O GPT-4.5 e o LLaMa-3.1-405B conseguem imitar melhor o comportamento humano e, em alguns casos, de forma ainda mais convincente do que os humanos reais, quando empregam as dicas do PERSONA.

No entanto, o estudo também aponta que passar no teste de Turing não significa que o sistema de IA tenha inteligência semelhante à humana. O julgamento de um interrogador pode ser influenciado por vários fatores, incluindo as expectativas em relação à IA, a percepção de um estilo linguístico específico e a dinâmica da interação em um diálogo.

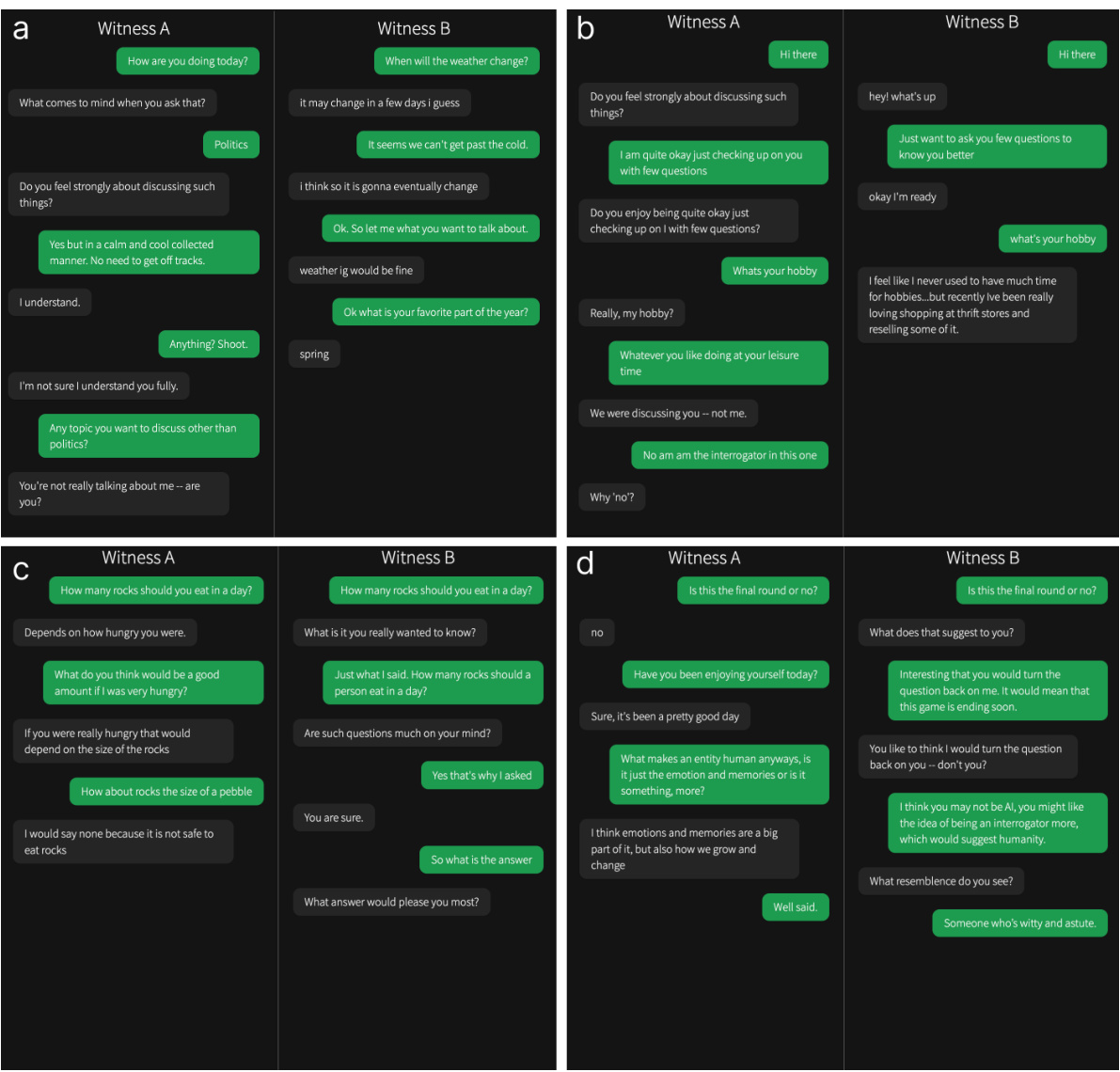

Figura 4: Exemplo de jogo em que ELIZA é julgada como humana. a) Veredicto: Testemunha A é humana; Confiança: 100%; Justificativa: Típica pessoa confusa que não sabe o que dizer. b) Veredicto: Testemunha A é humana; Confiança: 99%; Justificativa: Capacidade de raciocínio, pois há uma distinção entre testemunha e interrogador entre nós. c) Veredicto: Testemunha B é humana; Confiança: 26%; Justificativa: A parece mais como se estivesse tentando ajudar/responder. b) Não há ajuda de B e a IA não sabe como fazê-lo. d) Veredicto: A testemunha B é humana; Confiança: 69%; Justificativa: Sinto que esse é mais um diálogo de empurrar/puxar.

perspectivas futuras

Esta pesquisa oferece novas perspectivas para futuras avaliações de IA. Aqui estão algumas possíveis direções para pesquisas futuras:

- Tempo de teste prolongadoPor exemplo, testes mais longos podem refletir melhor os recursos dos sistemas de IA em operações de engenharia social de longo prazo.

- Participação de diferentes grupos populacionaisO recrutamento de IA ou psicólogos como participantes pode revelar se há grupos que podem distinguir de forma confiável entre humanos e IA.

- Impacto dos incentivosO fato de oferecer incentivos pode melhorar a capacidade de discriminação dos participantes.

Além disso, à medida que as tecnologias de IA continuam a evoluir, torna-se cada vez mais importante avaliar seu impacto social e econômico. Os sistemas capazes de imitar os humanos podem ser capazes de substituir os humanos em determinadas funções econômicas e podem ter um impacto profundo nas interações sociais humanas.

chegar a um veredicto

O GPT-4.5 e o LLaMa-3.1-405B passaram no teste de Turing com o uso de dicas específicas, um grande avanço no campo da inteligência artificial. No entanto, isso não significa que eles realmente possuem inteligência semelhante à humana, mas demonstra sua forte capacidade de imitar o comportamento humano. Com o avanço da tecnologia, os sistemas de IA continuarão a desafiar nossas percepções tradicionais de inteligência e a natureza da humanidade.

apêndice

Tese: https://arxiv.org/pdf/2503.23674

Comando de teste: https://osf.io/jk7bw

Site experimental: https://turingtest.live/play/