Introdução geral

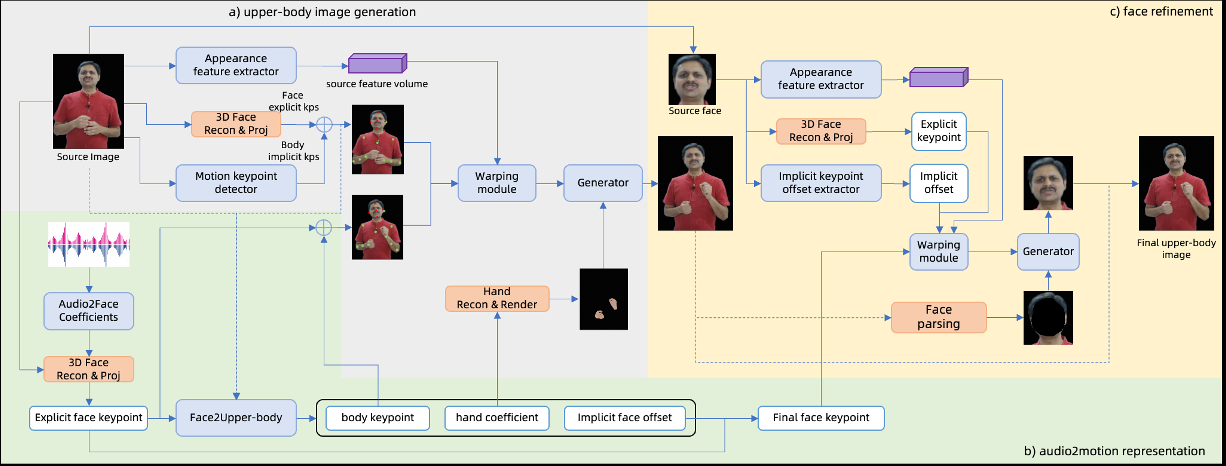

O ChatAnyone é um projeto inovador desenvolvido pela equipe do HumanAIGC. Ele usa tecnologia de inteligência artificial para gerar um vídeo de retrato humano digital com movimentos da parte superior do corpo a partir de uma única foto e entrada de áudio. Com base em um modelo hierárquico de difusão de movimento, o projeto gera movimentos de cabeça, gestos e expressões adequados para apresentar avatares ou animar pessoas digitais. O ChatAnyone apresenta geração eficiente, com suporte para resolução de 512×768 e saída de vídeo de 30 quadros por segundo. O projeto está atualmente no GitHub mostrando detalhes técnicos, mas ainda não é totalmente de código aberto, atraindo a atenção de muitos usuários interessados na tecnologia de geração de pessoas digitais.

Lista de funções

- Vídeo de geração de fotosGeração de vídeos humanos digitais com movimentos da parte superior do corpo a partir de uma única foto e entrada de áudio.

- controle de movimentoSuporte para gerar movimentos naturais da cabeça, gestos e expressões.

- sincronização de áudioMovimentos labiais: os movimentos labiais são combinados com o áudio para aumentar o realismo.

- Alto desempenhoSuporte à resolução de 512×768 a 30 quadros por segundo na GPU 4090.

- Vitrine de tecnologiaCompartilhe os resultados por meio de uma página do GitHub para que os usuários possam aprender e explorar.

Usando a Ajuda

O ChatAnyone é atualmente um projeto de demonstração de tecnologia e não é totalmente de código aberto, portanto não pode ser baixado ou instalado diretamente. O conteúdo a seguir baseia-se em informações oficiais e descreve detalhadamente sua funcionalidade e lógica operacional para ajudar os usuários a entender o projeto e aguardar um possível uso aberto no futuro.

Funções principais

1. geração de vídeos a partir de fotos

- lógica operacionalImagem: O usuário fornece uma foto de retrato e um trecho de áudio (por exemplo, uma gravação de fala ou canto), e o sistema gera um vídeo da pessoa digital com movimentos da parte superior do corpo. O vídeo inclui movimentos como giros de cabeça e gestos.

- efeitoResolução de vídeo de saída de até 512 x 768 com uma taxa de quadros de 30 quadros por segundo. Os movimentos humanos digitais são combinados com o ritmo do áudio, o que é adequado para a exibição de imagens virtuais.

- UsoFuncionalidade: A funcionalidade é conhecida atualmente por meio de vídeos de demonstração ou documentação oficial, e uma versão beta poderá ser aberta no futuro.

2. controle de movimento

- lógica operacionalO sistema gera movimentos naturais da parte superior do corpo com base no áudio, incluindo a dinâmica da cabeça e das mãos. Os usuários podem aprender sobre a gama de movimentos por meio de exemplos.

- efeitoA pessoa digital gerada pode apresentar diferentes estilos de movimento, como acenos de cabeça e mudanças de gestos, para aumentar a expressividade.

- UsoEsse recurso está em fase de demonstração, e os usuários podem ver como ele funciona na página do GitHub.

3. sincronização de áudio

- lógica operacionalO sistema gera movimentos labiais que correspondem ao ritmo do som após a entrada de um áudio nítido.

- efeitoLábios: os lábios são altamente sincronizados com o áudio para âncoras virtuais ou apresentações animadas.

- Uso: Atualmente experimentado por meio de um vídeo de amostra oficial, o teste do usuário pode ser suportado no futuro.

Como obter mais informações

- Visite a página oficial: Ir para

https://github.com/HumanAIGC/chat-anyoneVeja a descrição do projeto e o vídeo de apresentação. - Acompanhe as atualizaçõesCódigo-fonte aberto: O projeto ainda não é de código-fonte aberto, mas a equipe pode liberar códigos ou ferramentas no futuro. Recomenda-se verificar o repositório do GitHub regularmente.

- Entre em contato com a equipePara obter mais informações, deixe uma mensagem no GitHub ou encontre os detalhes de contato oficiais.

advertência

- O ChatAnyone é atualmente um projeto de demonstração de tecnologia e não pode ser usado diretamente.

- A geração requer hardware de alto desempenho (por exemplo, 4090 GPUs), o que é difícil de ser experimentado localmente pelo usuário comum.

- O projeto poderá ter seu código aberto no futuro, e um guia mais detalhado estará disponível nesse momento.

cenário do aplicativo

- Apresentação de imagem virtual

Os usuários podem gerar vídeos de pessoas digitais com fotos para mostrar imagens virtuais personalizadas. - Produção de conteúdo de animação

Os criadores podem usar o vídeo gerado por uma pessoa digital de meio-tamanho para criar curtas-metragens ou conteúdo de apresentação. - Estudos técnicos

Os pesquisadores podem aprender sobre técnicas de geração de pessoas digitais orientadas por áudio por meio do projeto.

QA

- O ChatAnyone pode bater papo em tempo real?

No momento, não. Ele se concentra na geração de vídeos a partir de fotos e áudio, e não em uma ferramenta de bate-papo ao vivo. - Que tipos de fotos são compatíveis?

A apresentação oficial é baseada em fotografias de retratos, e os requisitos específicos podem ser encontrados em documentos futuros. - O vídeo está disponível comercialmente?

Atualmente, não há uma licença explícita; é necessário aguardar o código aberto para visualizar o contrato.