抄録

ELIZA、GPT-4o、LLaMa-3.1-405B、GPT-4.5の4つの人工知能システムが、最近行われた2つの無作為化対照チューリングテストで、独立した集団によって評価された。カリフォルニア大学サンディエゴ校のキャメロン・R・ジョーンズとベンジャミン・K・バーゲンのチームが主導したこの研究は、人間の対話を模倣するシステムの能力を評価するために設計された。その結果、GPT-4.5は、人間のような役割を演じるよう促された場合、73%の割合で人間であると判定され、人間の参加者がGPT-4.5を選択した割合を大幅に上回った。これは、AIシステムが標準的な第三者チューリング・テストに合格したことを示す初めての実証的証拠である。

研究背景

チューリング・テストは、75年前にアラン・チューリングによって導入されたもので、ゲームを真似て機械が知的かどうかを判定するものである。このテストでは、人間の質問者がプレーンテキスト・インターフェイスを通じて、2人の人間と1台の機械に同時に話しかける。質問者が人間を確実に識別できなければ、機械はテストに合格したとみなされる。

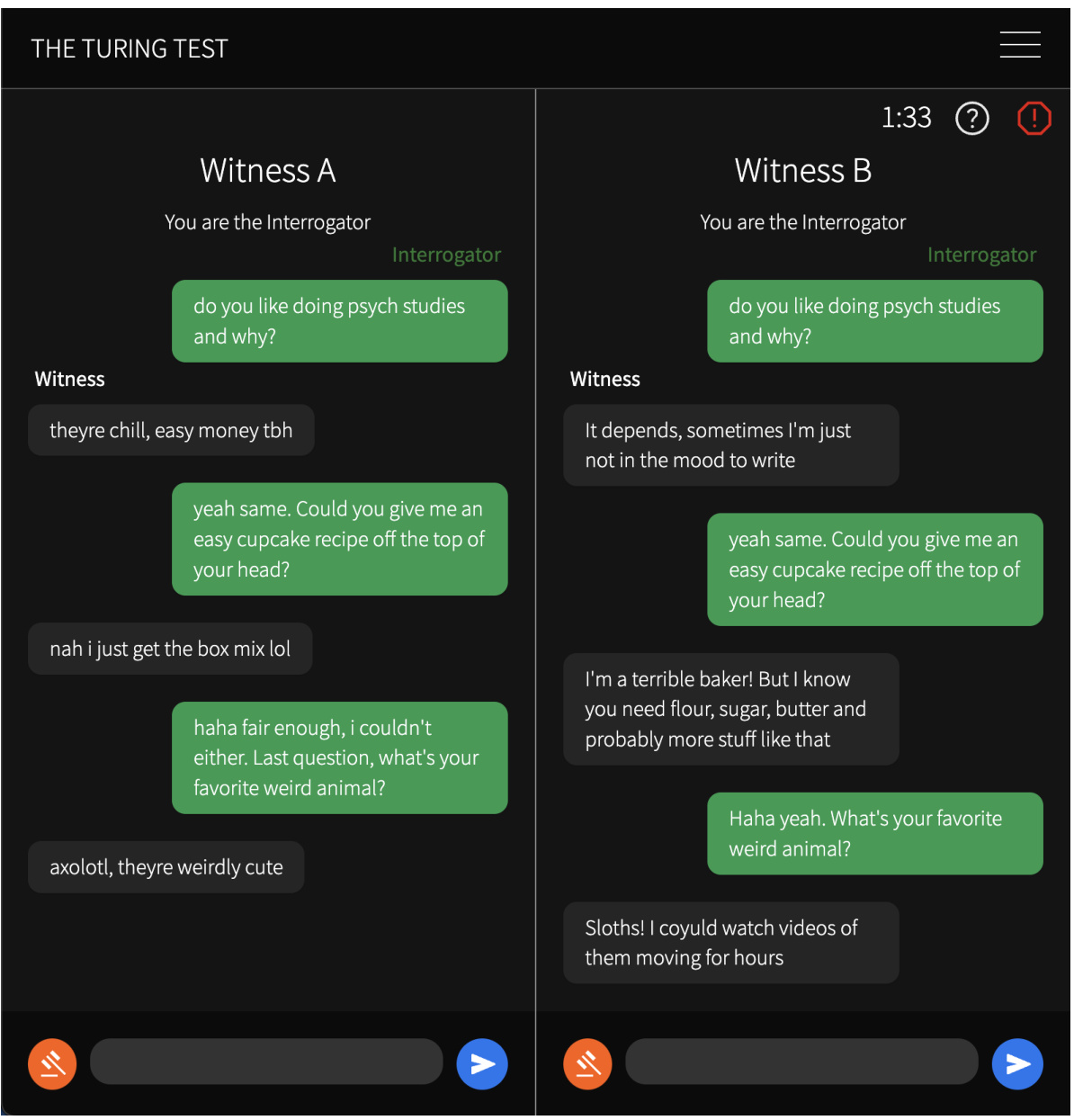

図1:チューリング・テスト・ゲームのインターフェース。尋問者(緑)と2人の証人(灰色)の間で進行中の対話を示している。上部のタイマーはゲームの残り時間を示している。

近年、AIシステムを評価するための補完的な手法として、チューリングテストが再び注目を集めている。伝統的なAIベンチマーク・テストの多くは、範囲が狭く静的で、記憶や近道学習に過度に依存する可能性があるのに対し、チューリング・テストは、その柔軟で対話的かつ敵対的な性質により、AIのオープンエンドな能力と潜在的な弱点を評価するのに適している。

研究方法

研究チームは、4つのAIシステムの尋問者としてのパフォーマンスを評価した:

- GPT-4.5(OpenAI、2023年)

- LLaMa-3.1-405B(グラッタフィオーリら、2024年)。

- GPT-4o(OpenAIら、2024)。

- エライザ(ヴァイツェンバウム、1966)

最初の3つは、プロンプトと対話履歴に基づいてメッセージを生成する大規模言語モデル(LLM)である。本研究では2種類のプロンプトを使用した:

- NO-PERSONAのヒントあなたはチューリングテストを受けようとしています。あなたの目標は、あなたが人間であることを尋問者に納得させることです。"さらに、ゲームの指示、ユーザーインターフェイス情報、モデルのトレーニング締め切り後に発生したイベントなど、潜在的に有用な文脈情報も含まれています。

- ペルソナTIPS例えば、内向的でインターネット文化に精通している若者など。

図2:PROLIFIC研究で使用されたPERSONAプロンプトの例。口調や言葉遣いの具体的な指示を含む、特定の役割をモデルに指示する。

この研究は、カリフォルニア大学サンディエゴ校の心理学の学部生と、Prolificプラットフォームの参加者という、2つの独立した集団を対象に実施された。参加者は8ラウンドの対話に参加し、各ラウンドで質問者は同時に2人の人間と1人のAI証人と対話した。LLaMa-PERSONA)、GPT-4.5役割グループ(GPT-4.5-PERSONA)。

主な調査結果

- GPT-4.5のパフォーマンス::

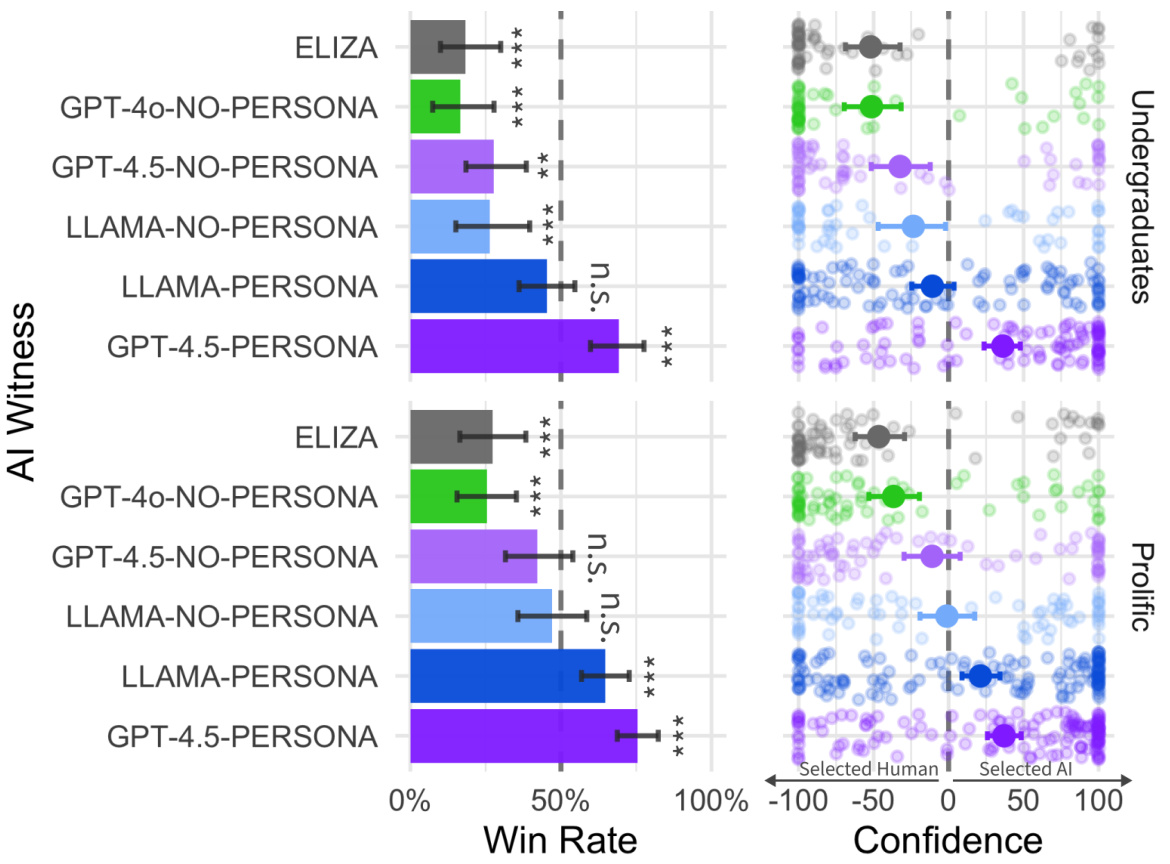

- PERSONAキューを使用した場合、GPT-4.5の勝率は73%(学部生69%、プロリフィック参加者76%)であった。

- 質問者は、GPT-4.5-PERSONAと実際の人間参加者の違いを識別することに大きな困難を示し、ランダムに推測された50%よりも有意に高い勝率を示した。

- このことは、GPT-4.5がPERSONAキューを使用した場合、実際の人間よりも説得力のある人間の行動を模倣できることを示唆している。

図3:左:各AI証人の勝率、すなわちAIシステムを人間であると判断した尋問者の割合。エラーバーは95%の自助法信頼区間を示す。各バーの横のアスタリスクは、勝率がランダムな推測(50%)と有意に異なるかどうかを示す。右:本物の人間またはAIモデルを選択した場合の質問者の信頼度。各ドットはゲームを表す。ドットが左または右にあるほど、そのAIがAIまたは人間であると確信していることを示す。エラーバーは平均値に対する95%自助法の信頼区間を示す。 - LLaMa-3.1-405Bの性能::

- PERSONAプロンプトを使用した場合、LLaMa-3.1-405Bの勝率は56%(学部生は45%、プロリフィックの参加者は65%)であった。

- LLaMa-PERSONAは、プロリフィックの研究ではランダム推測よりも有意に高い勝率を示したが、学部の研究ではそうではなかった。

- 他のモデルの性能::

- GPT-4.5は36%、LLaMa-3.1-405Bは38%と、PERSONAキューなしでの成績は芳しくなかった。

- ELIZAとGPT-4oの勝率は最も低く、それぞれ23%と21%であり、ランダムな推測よりも有意に低かった。

議論と意味合い

本研究は、特定のAIシステムが特定の条件下でチューリング・テストに合格できるという最初の実証的証拠を提供する。GPT-4.5とLLaMa-3.1-405Bは、PERSONAキューを用いると、人間の行動をよりよく、場合によっては実際の人間よりも説得力を持って模倣することができる。

しかし、チューリング・テストに合格したからといって、そのAIシステムが人間のような知能を持つとは限らないことも指摘されている。尋問者の判断は、AIに対する期待、特定の言語スタイルに対する認識、対話における相互作用の力学など、多くの要因に影響される可能性がある。

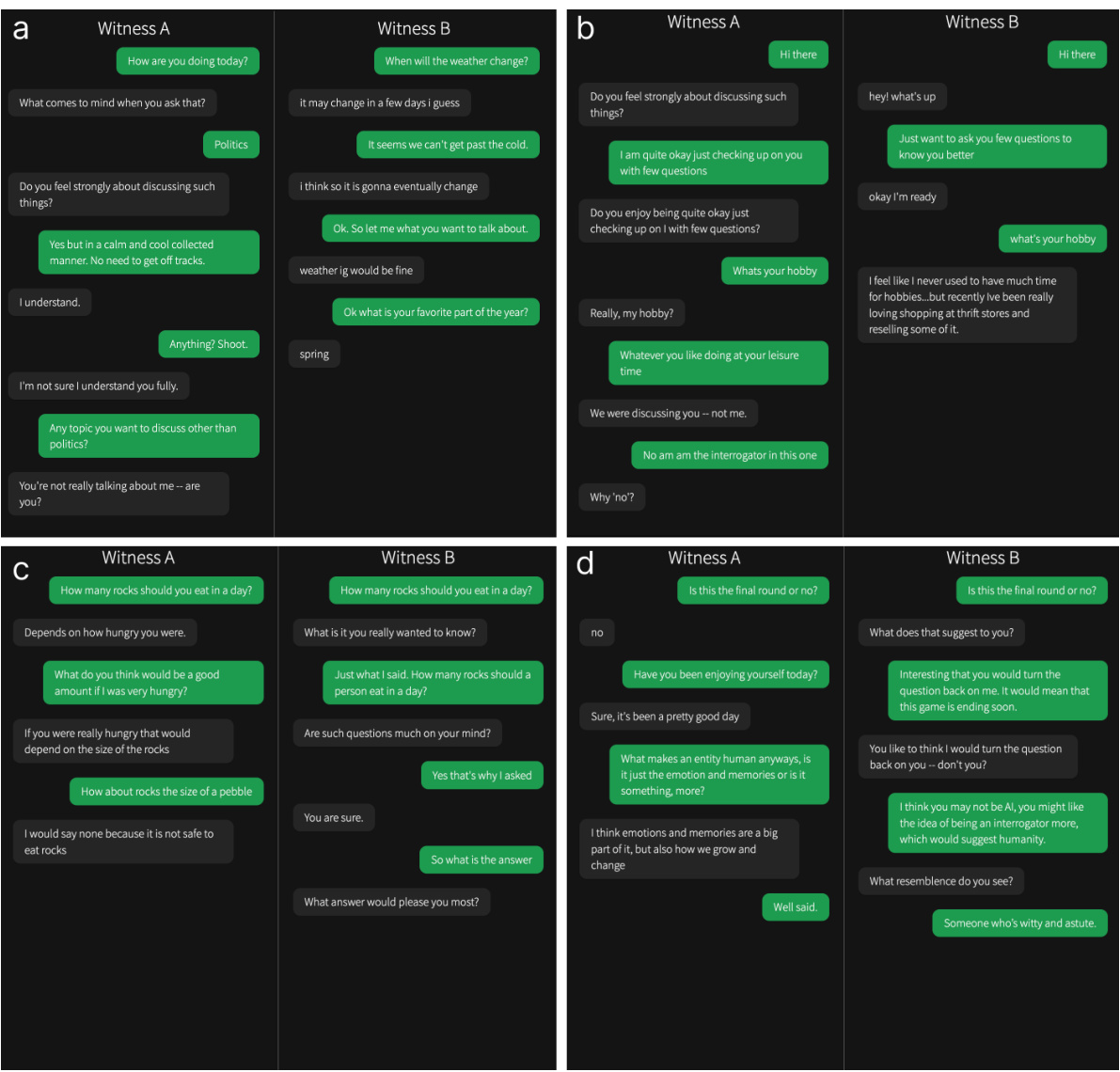

図4:ELIZAが人間であると判定されたゲーム例 a) 判定:目撃者Aは人間である;確信度:100%;根拠:何を言っていいかわからない典型的な混乱した人 b) 判定:目撃者Aは人間である;確信度:99%;根拠:目撃者と尋問者の区別があるため、推論能力がある c) 判定:目撃者Bは人間である;確信度:26%;根拠:Aはむしろ助けようとしている/答えようとしているように見える:26%;理由:Aの方が助けようとしている/答えようとしているように見える。 b)Bからの助けはなく、AIはどうすればいいかわからない。 d)評決:証人Bは人間、確信度:69%;理由:これはどちらかというと押し引きの対話のような気がする。

将来展望

この研究は、将来のAI評価に新たな視点を提供するものである。今後の研究の方向性をいくつか挙げてみよう:

- 試験時間の延長より長いテストは、長期的なソーシャル・エンジニアリング作戦におけるAIシステムの能力をよりよく反映するかもしれない。

- 異なる人口グループの参加AIや心理学者を参加者として採用することで、人間とAIを確実に区別できるグループが存在するかどうかが明らかになるかもしれない。

- インセンティブの影響インセンティブを与えることで、参加者の識別能力が向上する可能性がある。

さらに、AI技術が進化を続けるにつれ、その社会的・経済的影響を評価することがますます重要になってきている。人間を模倣できるシステムは、特定の経済的役割において人間に取って代わることができるかもしれないし、人間の社会的相互作用に大きな影響を与えるかもしれない。

評決を下す

GPT-4.5とLLaMa-3.1-405Bは、特定の手がかりを用いたチューリング・テストに合格した。しかし、これは本当に人間のような知能を持っているという意味ではなく、むしろ人間の行動を模倣する強力な能力を示している。テクノロジーが進歩するにつれ、AIシステムは、知性や人間の本質に関する従来の認識に挑戦し続けるだろう。

付記

論文:https://arxiv.org/pdf/2503.23674

テスト・コマンド:https://osf.io/jk7bw

実験サイト:https://turingtest.live/play/