Allgemeine Einführung

SiliconCloud bietet kosteneffiziente GenAI-Services, die auf hervorragenden Open-Source-Basismodellen basieren.

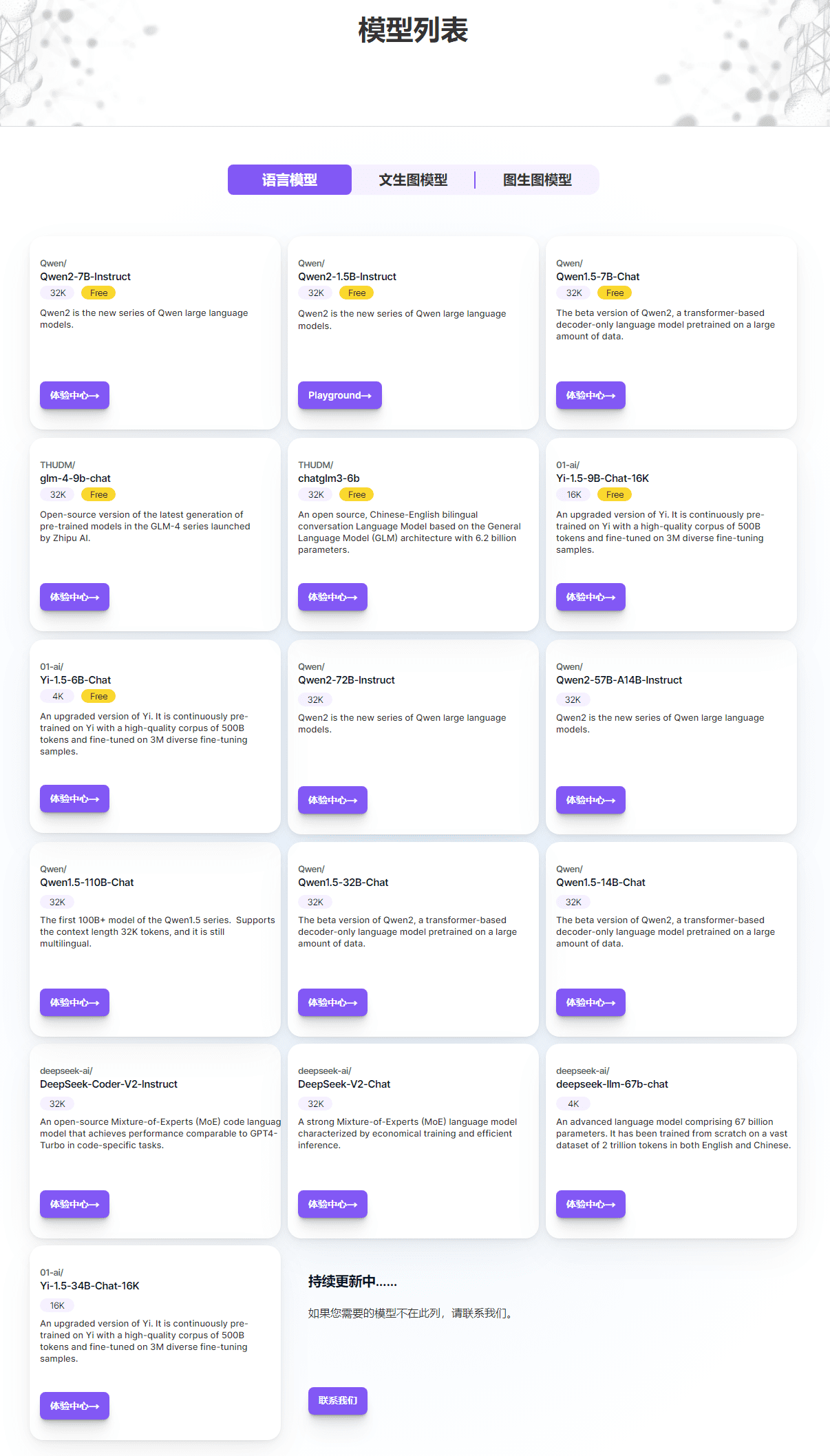

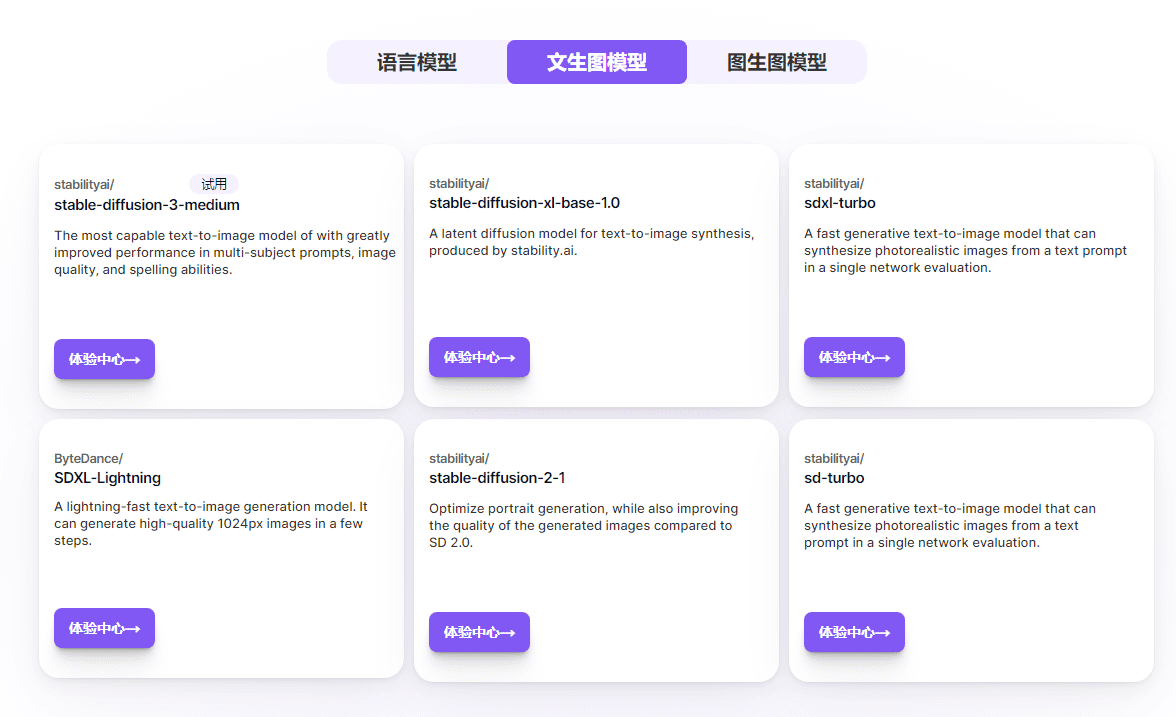

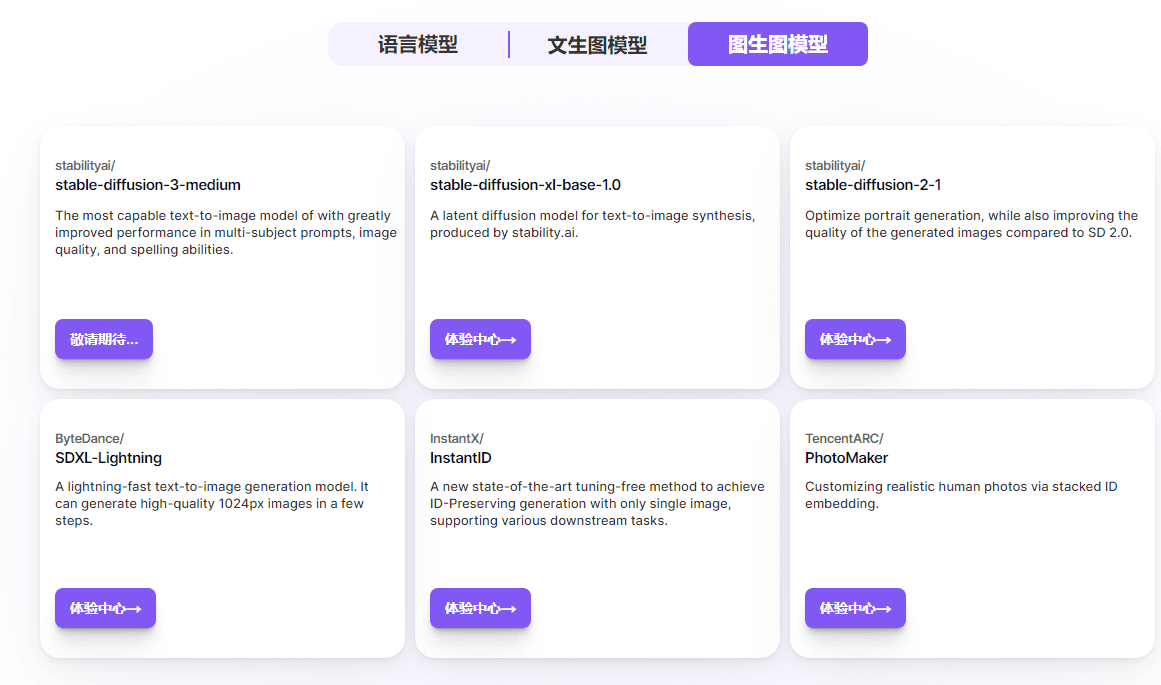

Im Gegensatz zu den meisten Big-Model-Cloud-Service-Plattformen, die nur ihre eigenen Big-Model-APIs zur Verfügung stellen, verfügt SiliconCloud über eine breite Palette von Open-Source-Big-Language-Modellen und Bilderzeugungsmodellen, darunter Qwen, DeepSeek, GLM, Yi, Mistral, LLaMA 3, SDXL und InstantID, die es den Nutzern ermöglichen, frei zwischen den für verschiedene Anwendungsszenarien geeigneten Modellen zu wechseln. Die Nutzer können frei zwischen den Modellen für verschiedene Anwendungsszenarien wechseln.

Darüber hinaus bietet SiliconCloud sofort einsatzbereite Dienste zur Beschleunigung der Inferenz großer Modelle, um Ihre GenAI-Anwendungen effizienter zu gestalten.

Für Entwickler bietet SiliconCloud mit einem Klick Zugang zu den besten Open-Source-Modellen. Dies ermöglicht Entwicklern eine schnellere Anwendungsentwicklung und mehr Erfahrung, während gleichzeitig die Kosten für Versuch und Irrtum bei der Anwendungsentwicklung deutlich reduziert werden.

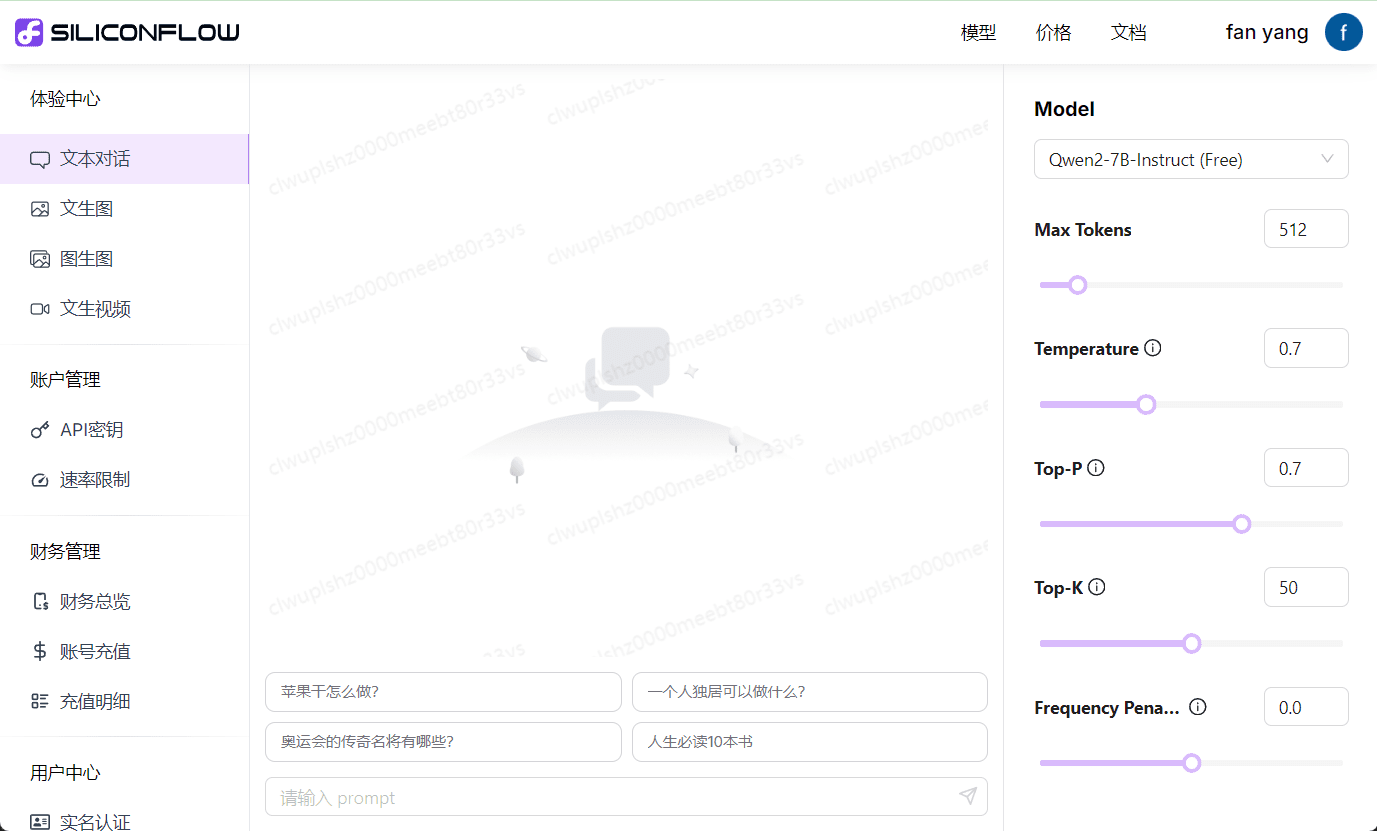

Auf der Seite SiliconCloud-Modelle können Sie die Sprachmodelle, Text-zu-Graph-Modelle und Graph-zu-Graph-Modelle sehen, die wir derzeit unterstützen, und auf "Experience Centre" klicken, um die Modelle in Aktion zu testen.

Silicon Mobility 20 Millionen Token Belohnungsregistrierungsportal

Modell Liste

Freie Model-Liste

| Qwen/Qwen2-7B-Instruct | 32K |

|---|---|

| Qwen/Qwen2-1.5B-Instruct | 32K |

| Qwen/Qwen1.5-7B-Chat | 32K |

| thudm/glm-4-9b-chat | 32K |

| THUDM/chatglm3-6b | 32K |

| 01-ai/Yi-1.5-9B-Chat-16K | 16K |

| 01-ai/Yi-1.5-6B-Chat | 4K |

| google/gemma-2-9b-it | 8K |

| internlm/internlm2_5-7b-chat | 32K |

| meta-llama/Meta-Llama-3-8B-Instruct | 8K |

| meta-llama/Meta-Llama-3.1-8B-Instruct | 8K |

| mistralai/Mistral-7B-Anleitung-v0.2 | 32K |

Verwendung der SiliconCloud-API

Basis-URL: https://api.siliconflow.cn/v1

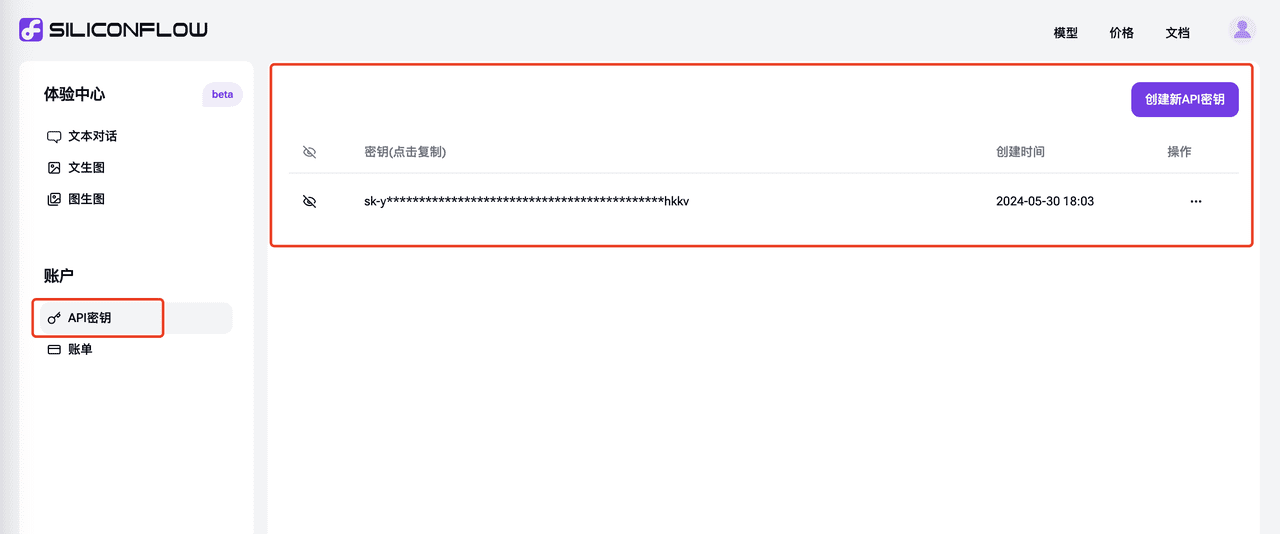

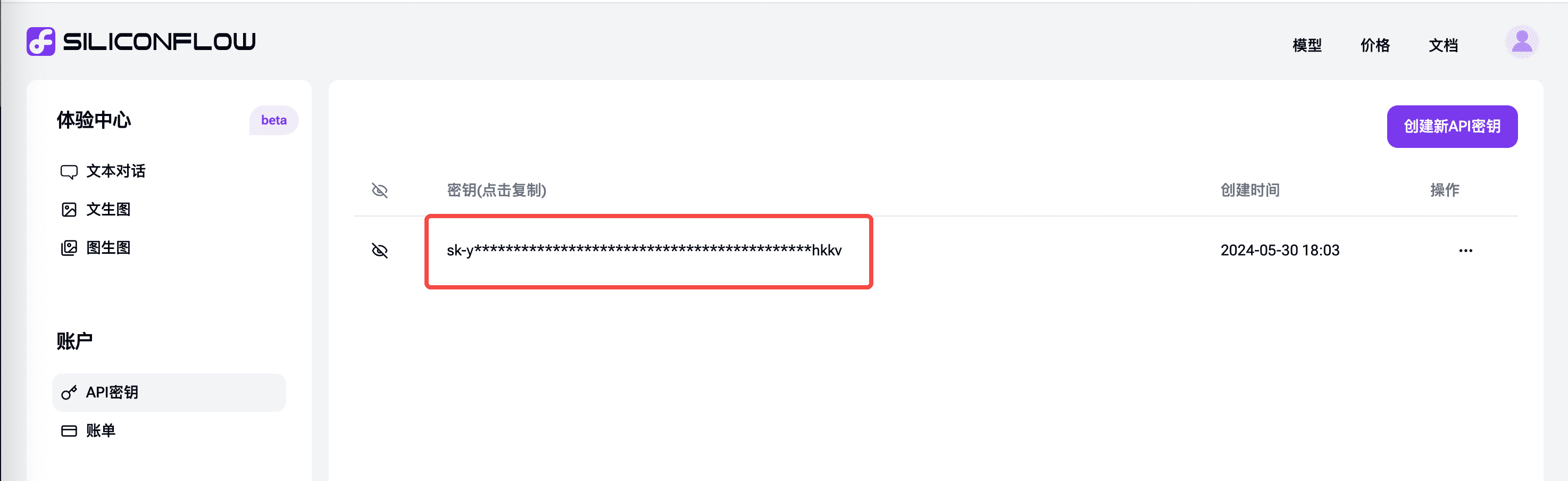

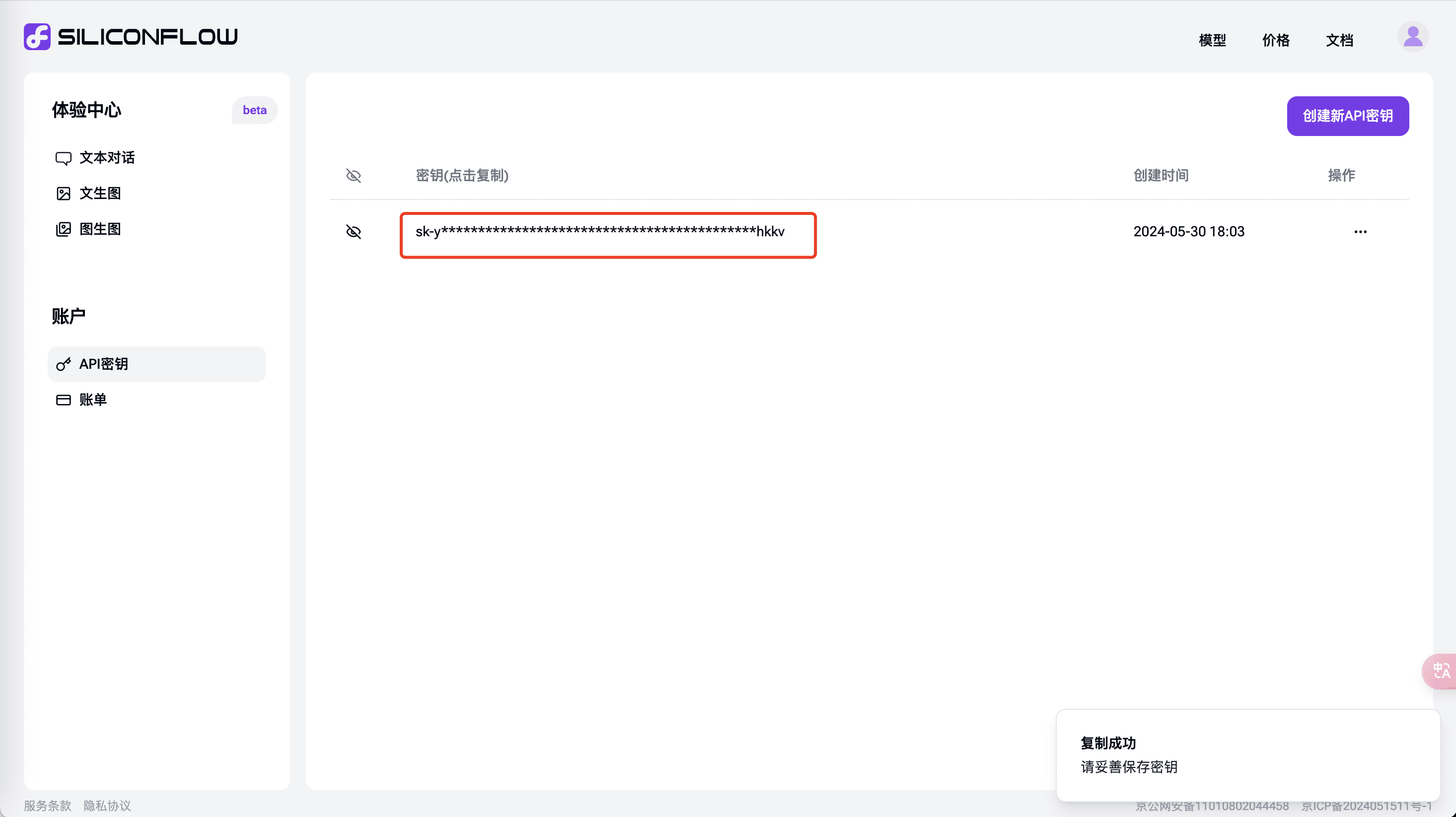

API-Schlüssel generieren

Auf der Registerkarte "API-Schlüssel Klicken Sie auf Neuen API-Schlüssel erstellen und auf Kopieren, um ihn in Ihrem API-Szenario zu verwenden.

Verwendung der SiliconCloud API in der immersiven Übersetzung

Nutzen Sie die API-Funktionen von SiliconCloud für eine schnelle sprachübergreifende Übersetzung in der immersiven Übersetzung

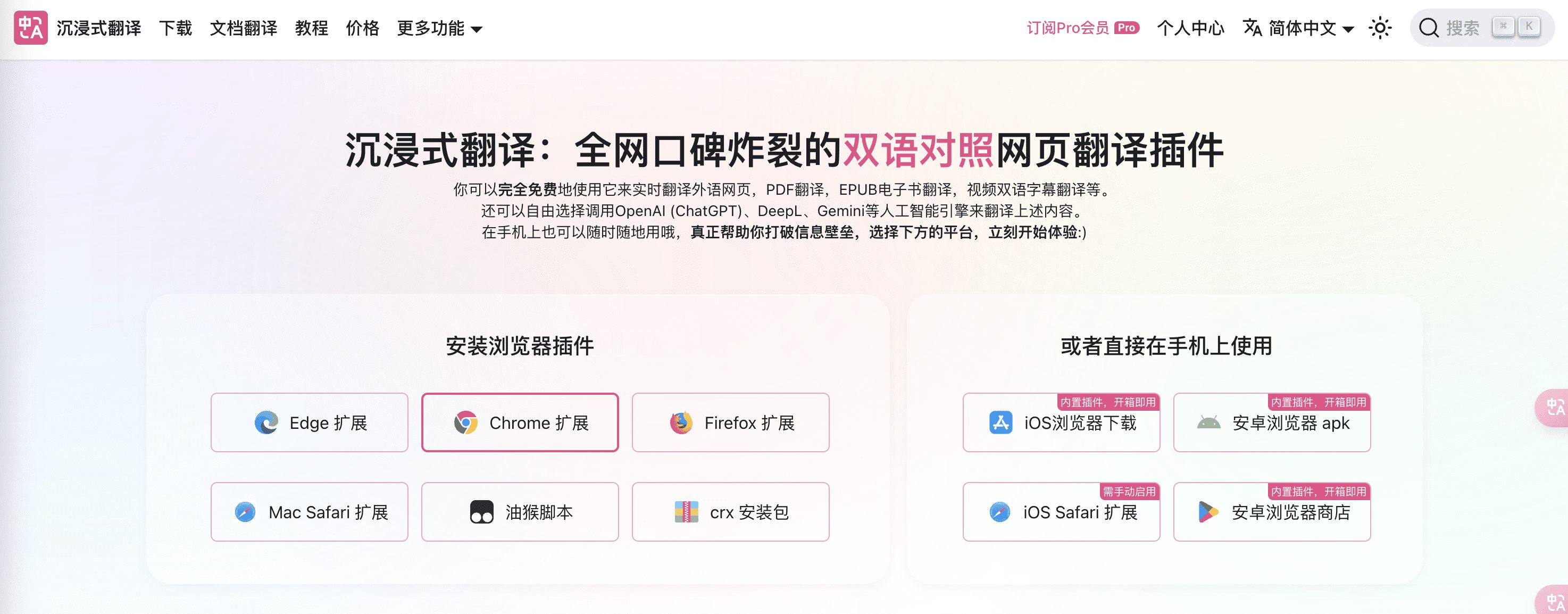

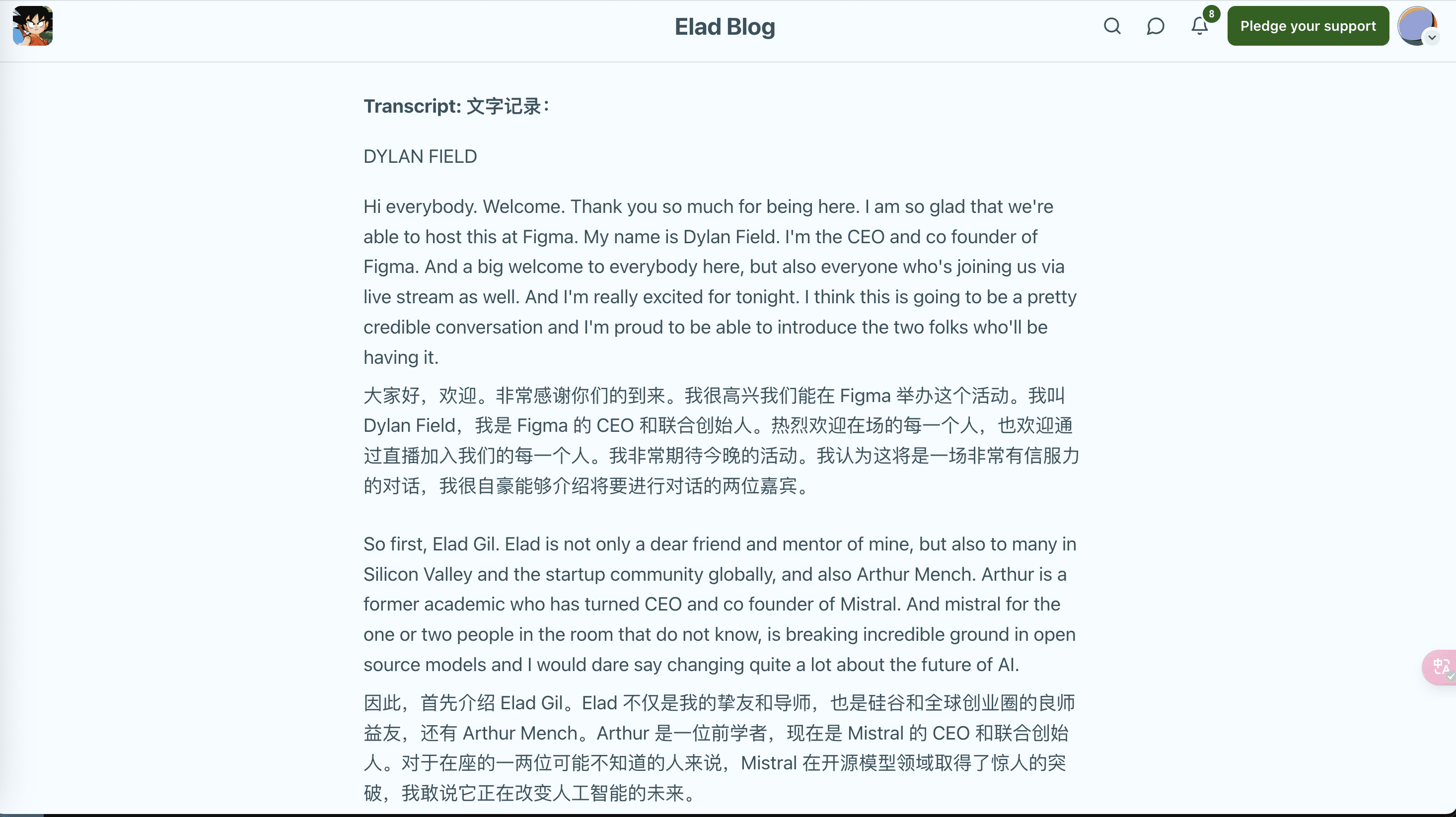

Als zweisprachiges Webseiten-Übersetzungs-Plugin mit explosivem Online-Ruf kombiniert Immersive Translation die sprachübergreifende Verständnisfähigkeit des Big Language Model, um fremdsprachige Inhalte in Echtzeit zu übersetzen, was für das Lesen von Webseiten, die PDF-Übersetzung, die Übersetzung von EPUB-E-Books, die Übersetzung von zweisprachigen Video-Untertiteln und andere Szenarien angewendet werden kann, und unterstützt die Verwendung einer Vielzahl von Browser-Plug-ins und Apps. Seit der Markteinführung im Jahr 2023 hat diese hochgelobte zweisprachige KI-Erweiterung zur Webseitenübersetzung mehr als 1 Million Nutzern geholfen, die Sprachbarriere zu überwinden und frei aus der globalen Weisheit zu schöpfen.

SiliconCloud von SiliconFlow war kürzlich der erste Anbieter einer Reihe großer Modelle wie GLM4, Qwen2, DeepSeek V2, Yi usw., und die Modelle sind sehr schnell. Wie können diese beiden kombiniert werden, um die Fähigkeiten in immersiven Übersetzungsszenarien zu verbessern?

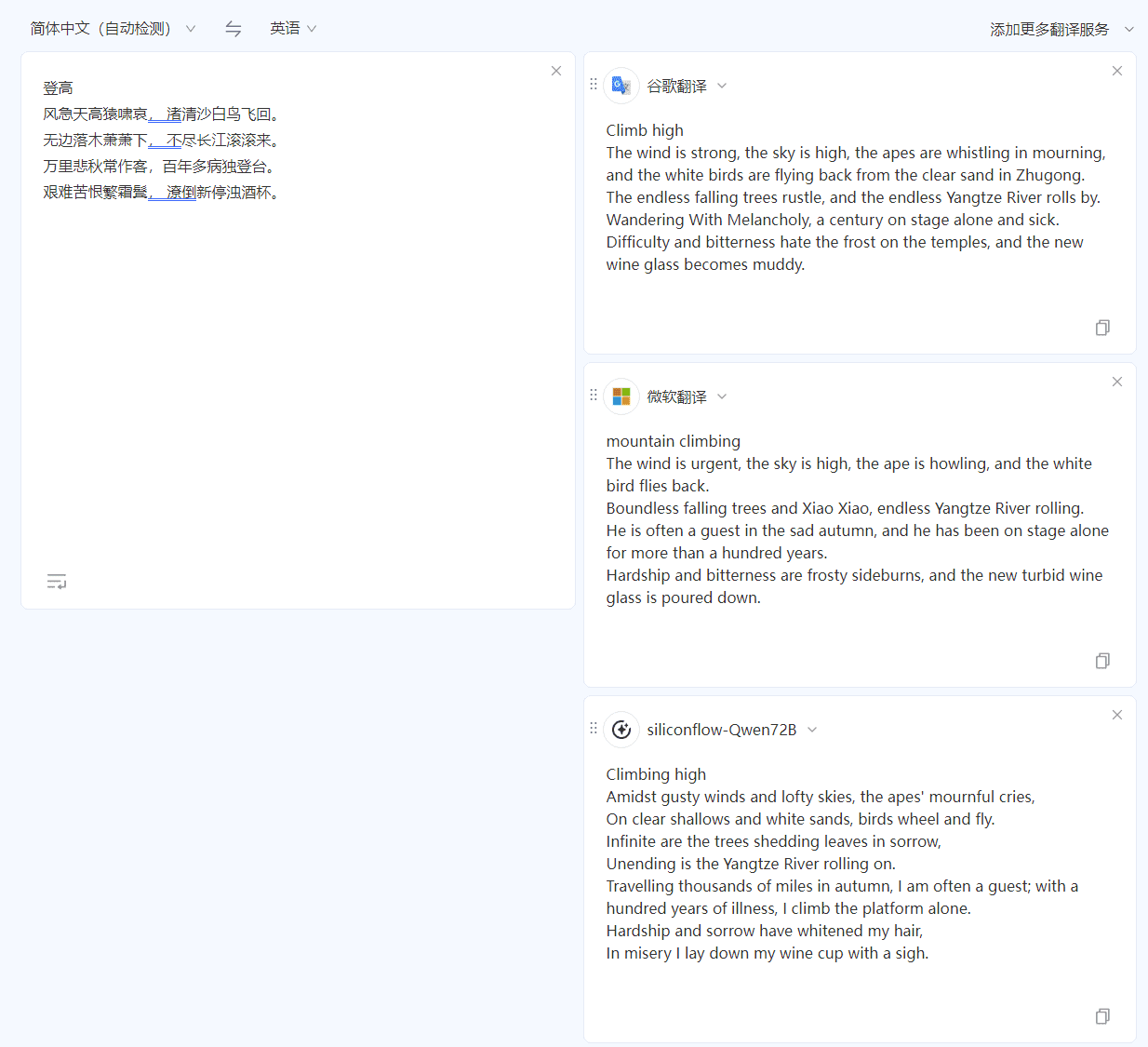

Prüfen Sie zunächst die Wirksamkeit der Behandlung

Nehmen wir eine bekannte chinesisch-englische Übersetzung als Beispiel. Bei der Verwendung des Klassikers "Aufsteigende Höhen" von Du Fu für den Test "Chinesisch-Englisch" bietet das von Silicon Mobility bereitgestellte Modell QWen 72B im Vergleich zu Google Translate und Microsoft Translate ein authentischeres Verständnis der chinesischen Sprache, und die Übersetzung ist auch näher am Stil des Originaltexts.

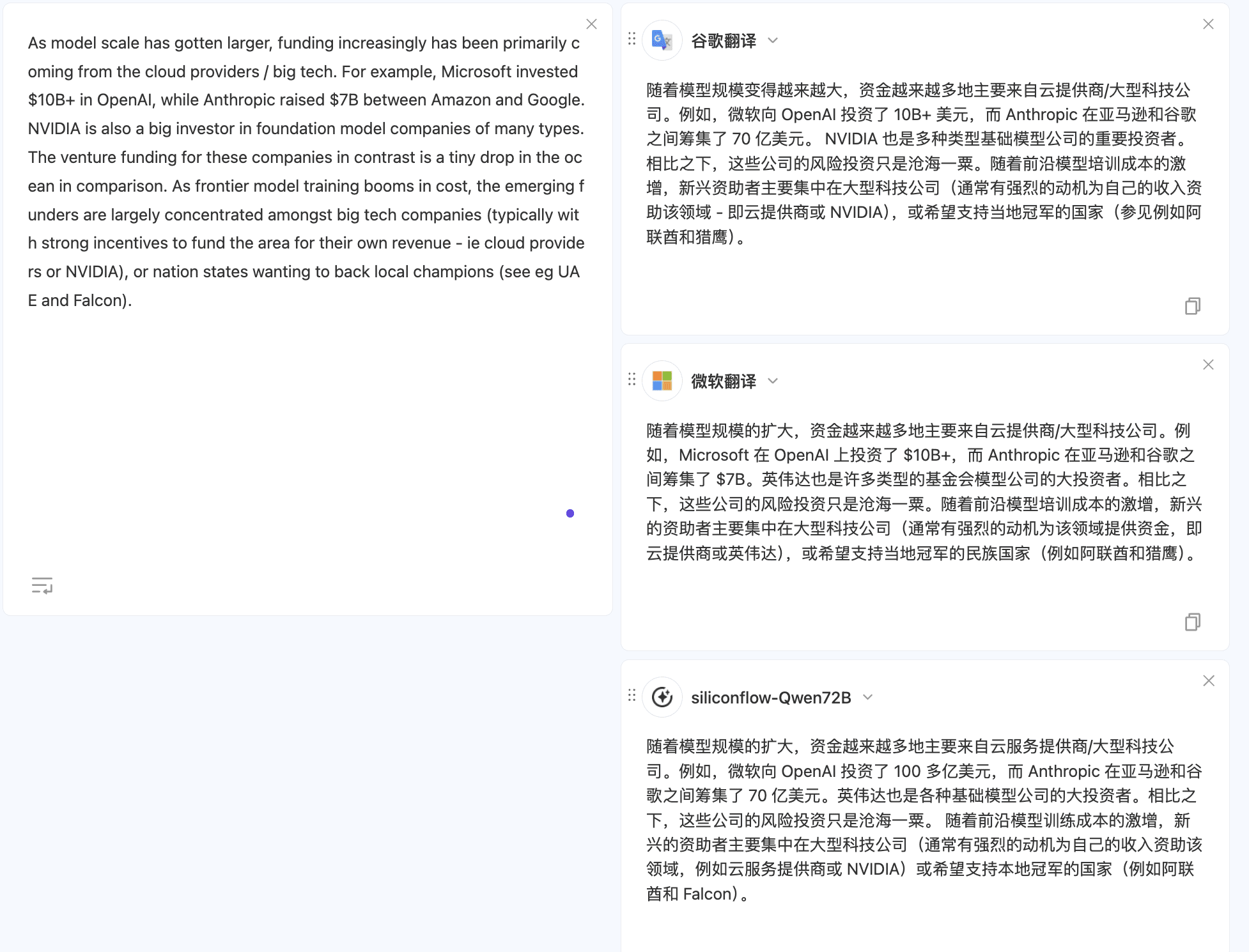

Das von Silicon Mobility zur Verfügung gestellte Modell liefert auch bessere Ergebnisse bei der Übersetzung desselben Textes vom Englischen ins Chinesische, wobei die Übersetzungen flüssiger sind.

Um andere Szenarien auszuprobieren, kann man einfachMultimodell-Vergleich übersetzter Dokumente Die Konfiguration der SiliconCloud-bezogenen Modelle wird im Abschnitt "Konfigurationsverfahren" beschrieben.

Konfigurationsverfahren: Standardkonfiguration

- Wählen Sie "Browser-Plug-in installieren" auf der Immersive Translation-Website und folgen Sie den Anweisungen. Wenn Sie das entsprechende Plug-in bereits installiert haben, überspringen Sie bitte diesen Schritt.

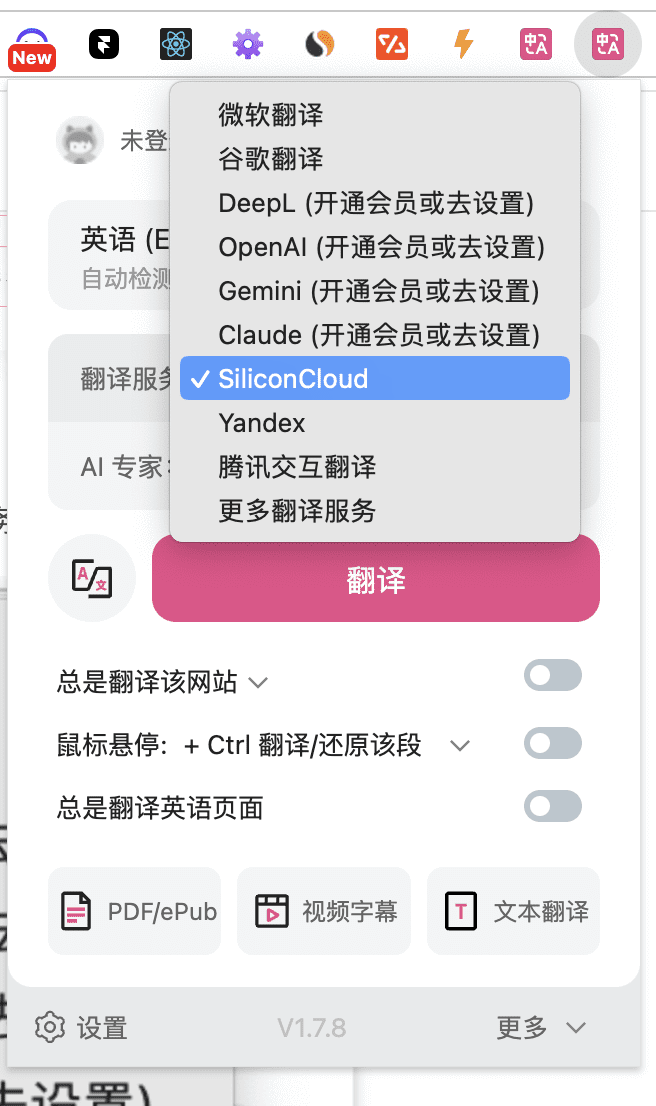

- Setzen Sie "Übersetzungsdienst" auf "SiliconCloud" im Immersive Translation Symbol, um den Übersetzungsdienst von SiliconCloud zu nutzen.

Damit sind die Standardeinstellungen abgeschlossen.

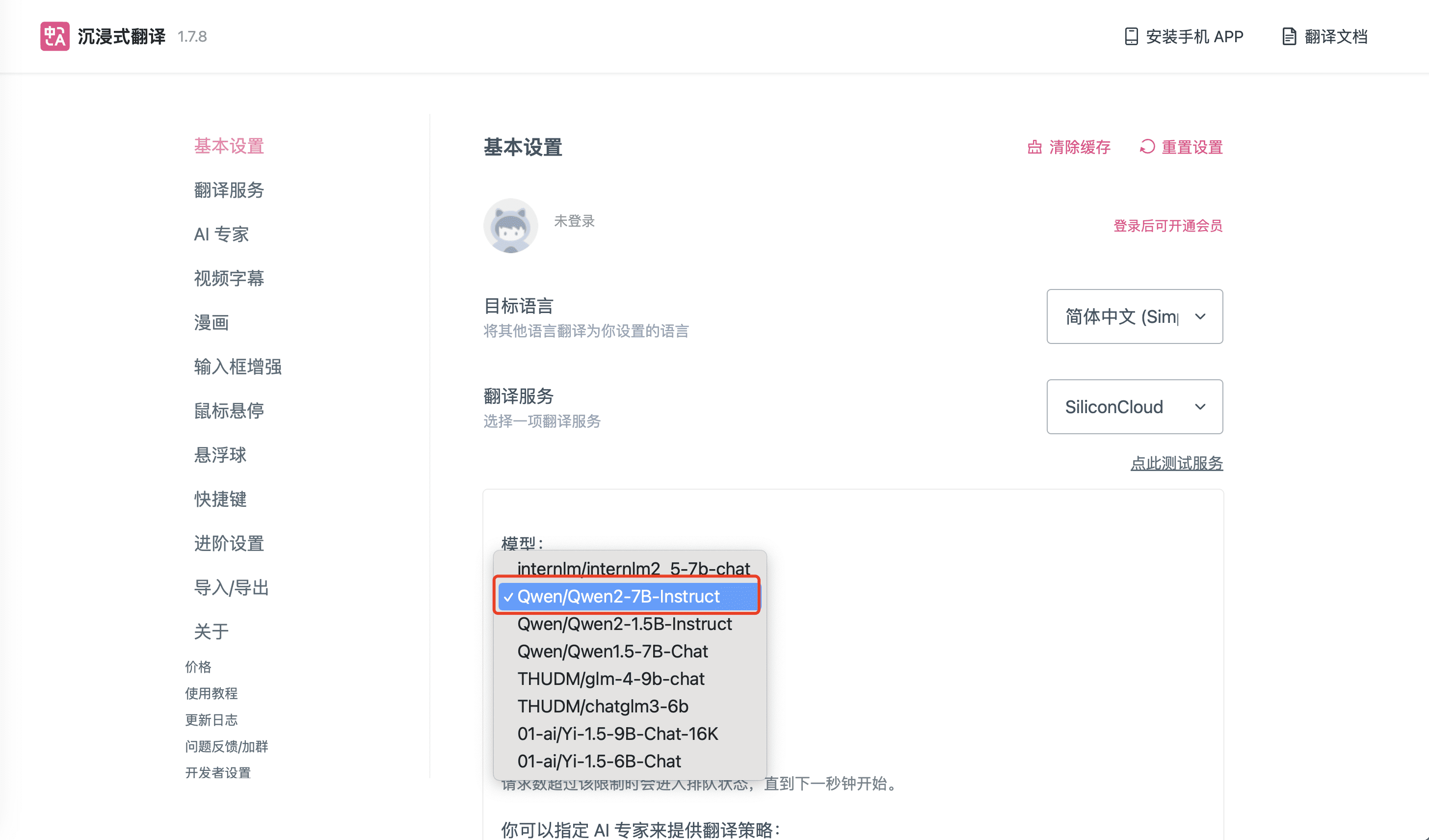

Wählen Sie andere kostenlose Modelle von SiliconCloud als die Standardeinstellungen:

- Das Standardmodell in den obigen Einstellungen ist "Qwen/Qwen2-7B-Instruct" von SiliconCloud, wenn Sie zu anderen SiliconCloud-Modellen wechseln möchten, klicken Sie auf "Einstellungen" im obigen Symbol. Wenn Sie zu anderen SiliconCloud-Modellen wechseln möchten, klicken Sie auf "Einstellungen" im obigen Symbol, um SiliconCloud-bezogene Einstellungen vorzunehmen.

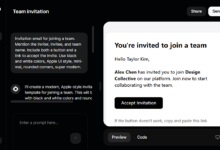

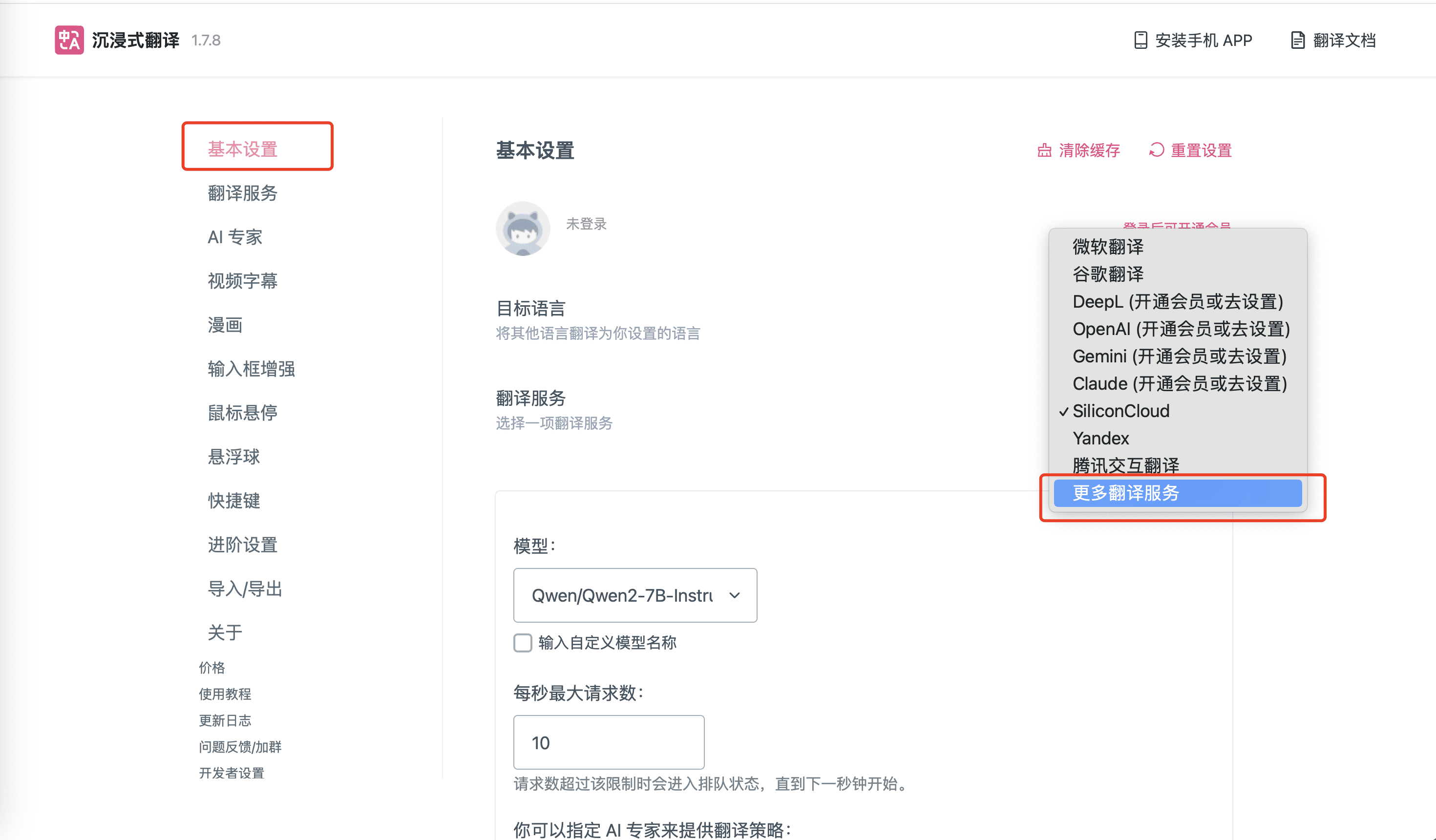

Wählen Sie andere Größenmodelle für SiliconCloud als die Standardeinstellungen:

- Wenn Sie andere SiliconCloud-Modelle als die oben genannten 8 Modelle verwenden möchten, klicken Sie auf das Symbol der Immersive Translation-Erweiterung und suchen Sie die entsprechende Option "Einstellungen", wie in der Abbildung unten gezeigt, und wählen Sie "Weitere Übersetzungsdienste".

- Fügen Sie ihm Informationen über das SiliconCloud-Modell hinzu!

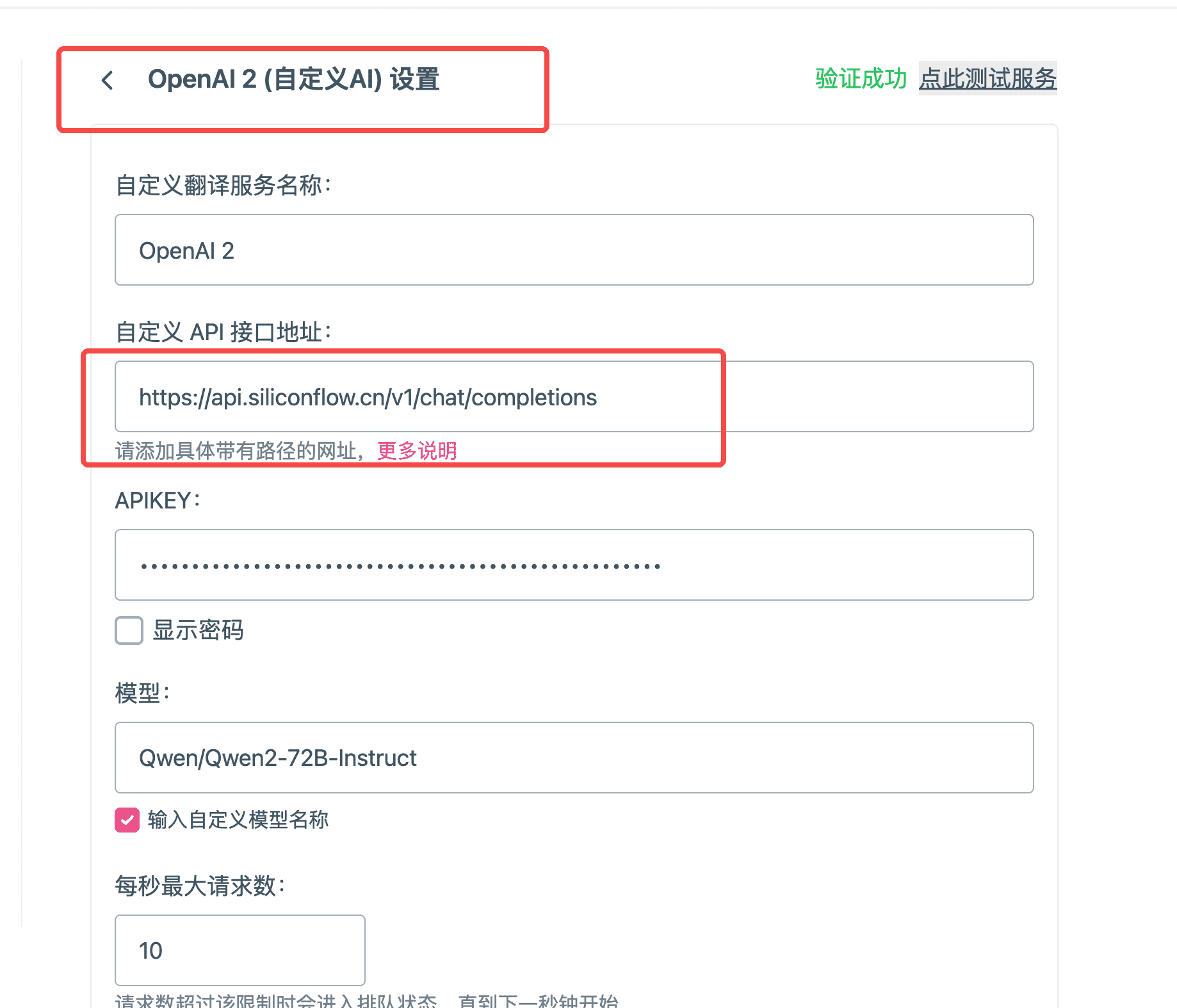

- Individueller Name des Übersetzungsdienstes: Geben Sie einfach den Namen entsprechend Ihrer aktuellen Situation ein, hier "Qwen/Qwen2-72B-Instruct".

- Adresse der benutzerdefinierten API-Schnittstelle:

- API-Adresse:https://api.siliconflow.cn/v1/chat/completions

- Weitere Informationen finden Sie unterhttps://docs.siliconflow.cn/reference/chat-completions-1

APIKEY: VonAPI-Schlüssel Klicken Sie auf Copy Over im Fenster

- Modellname: der Name des Modells in siliconcloud, hier ist es "Qwen/Qwen2-72B-Instruct", er kann verwendet werden.Liste der PlattformmodelleErmittelt die Namen aller derzeit unterstützten Modelle.

- Vergewissern Sie sich, dass der Test erfolgreich war, indem Sie in der oberen rechten Ecke auf Test klicken.

- Nachdem Sie nun die relevanten Modellkonfigurationspunkte ausgefüllt haben, können Sie das große Sprachmodell von SiliconCloud verwenden, um Übersetzungen im Immersive Translator Plugin bereitzustellen.

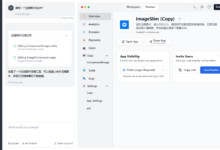

Verwendung der SiliconCloud-API in dedify

Als häufiger Nutzer von dify-Workflows stellt SiliconCloud die neuesten Modelle wie GLM4 , Qwen2, DeepSeek V2, Yi, etc. zum ersten Mal zur Verfügung und die Modelle sind sehr schnell, das muss das erste Mal sein, um anzudocken!

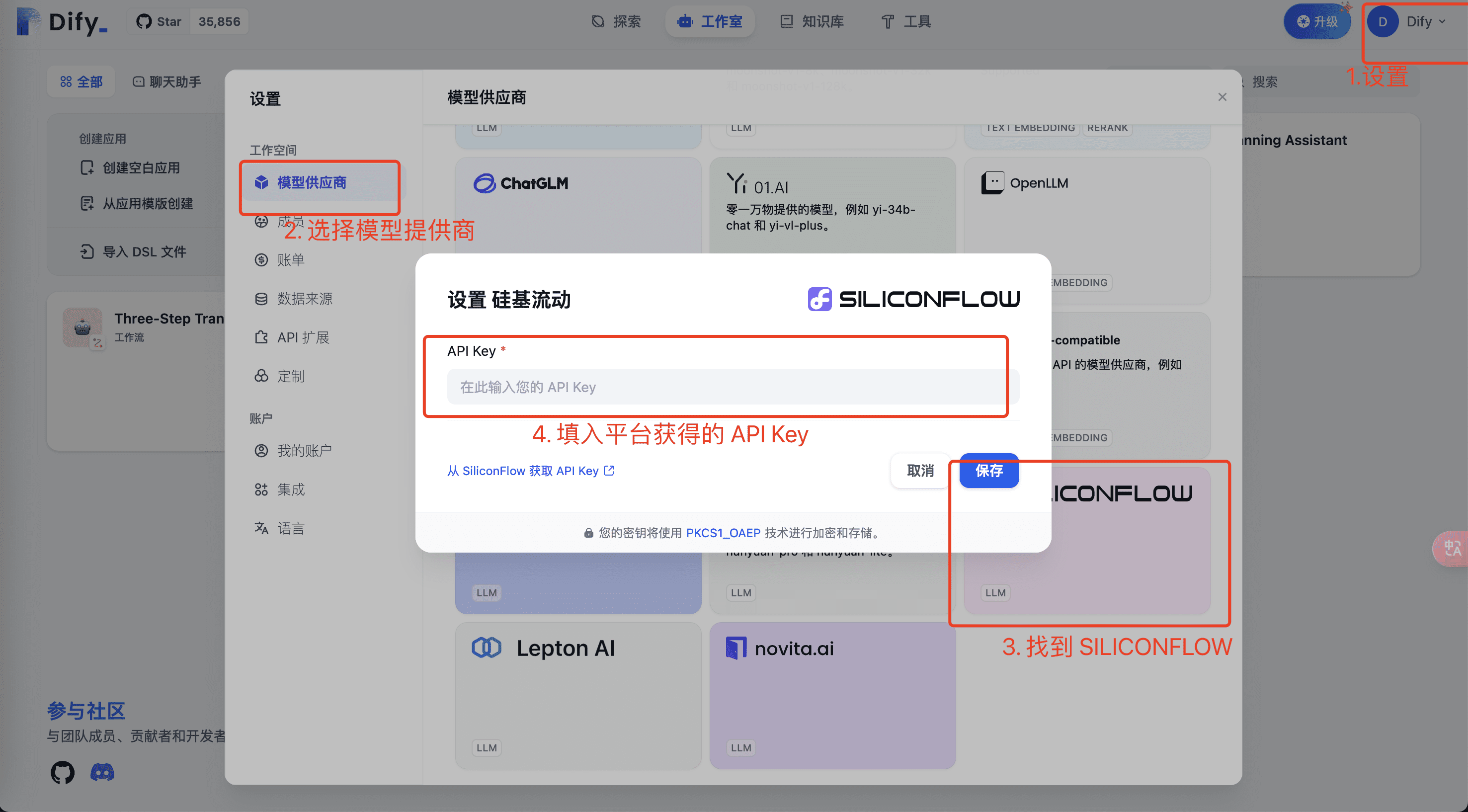

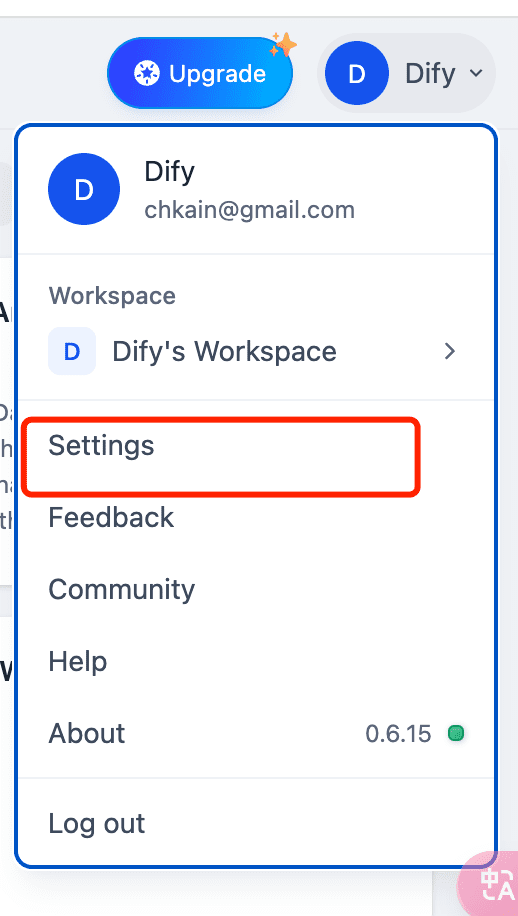

- Legen Sie in Setup das Modell und den API-Schlüssel für Ihr SiliconCloud-Plattformkonto fest, um das große Modell einzurichten.

- Geben Sie die relevanten Modell- und API-Schlüsselinformationen für die SiliconCloud-Plattform ein und klicken Sie zur Überprüfung auf Speichern. Verwenden Sie dieSiliconCloud APIKeyErmitteln Sie den API-Schlüssel des aktuellen Benutzers und kopieren Sie ihn in die oben genannte Umgebung.

- Als nächstes sehen Sie die SiliconFlow-bezogenen Modelle im oberen Bereich des Modellanbieters.

- Verwendung von SiliconCloud-Korrespondenzmodellen in Anwendungen

Nach diesen Schritten sind Sie bereit, die umfangreichen und schnellen LLM-Modelle von SiliconFlow in Ihren Dify-Entwicklungsanwendungen zu verwenden.

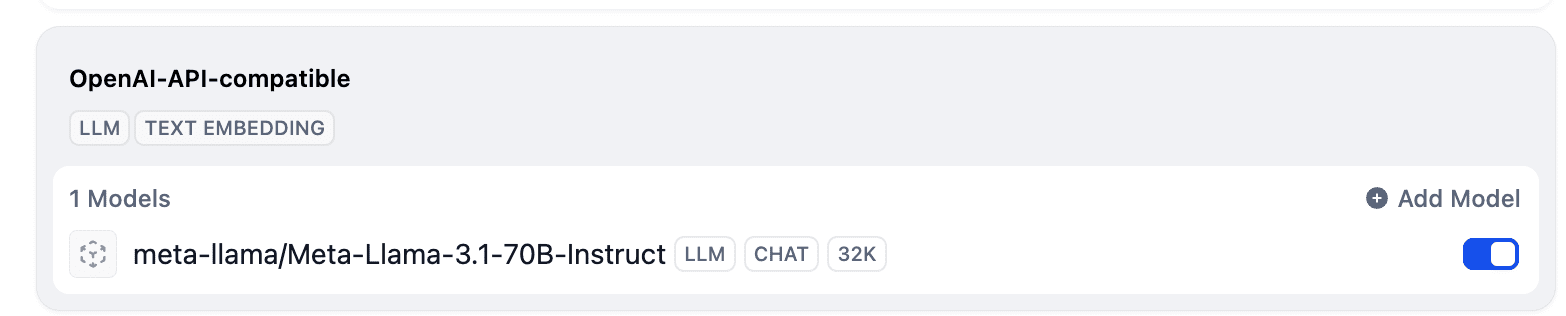

SiliconCloud-Modelle, die derzeit nicht im dify-Quellcode enthalten sind

Derzeit werden immer noch neue Modelle in SiliconCloud eingeführt, aufgrund des iterativen Rhythmus beider Parteien können einige Modelle nicht zum ersten Mal in Dify präsentiert werden, und hier richten wir uns nach dem folgenden Prozess.

- Öffnen Sie die Einstellungen von dify, um die Einstellungen vorzunehmen.

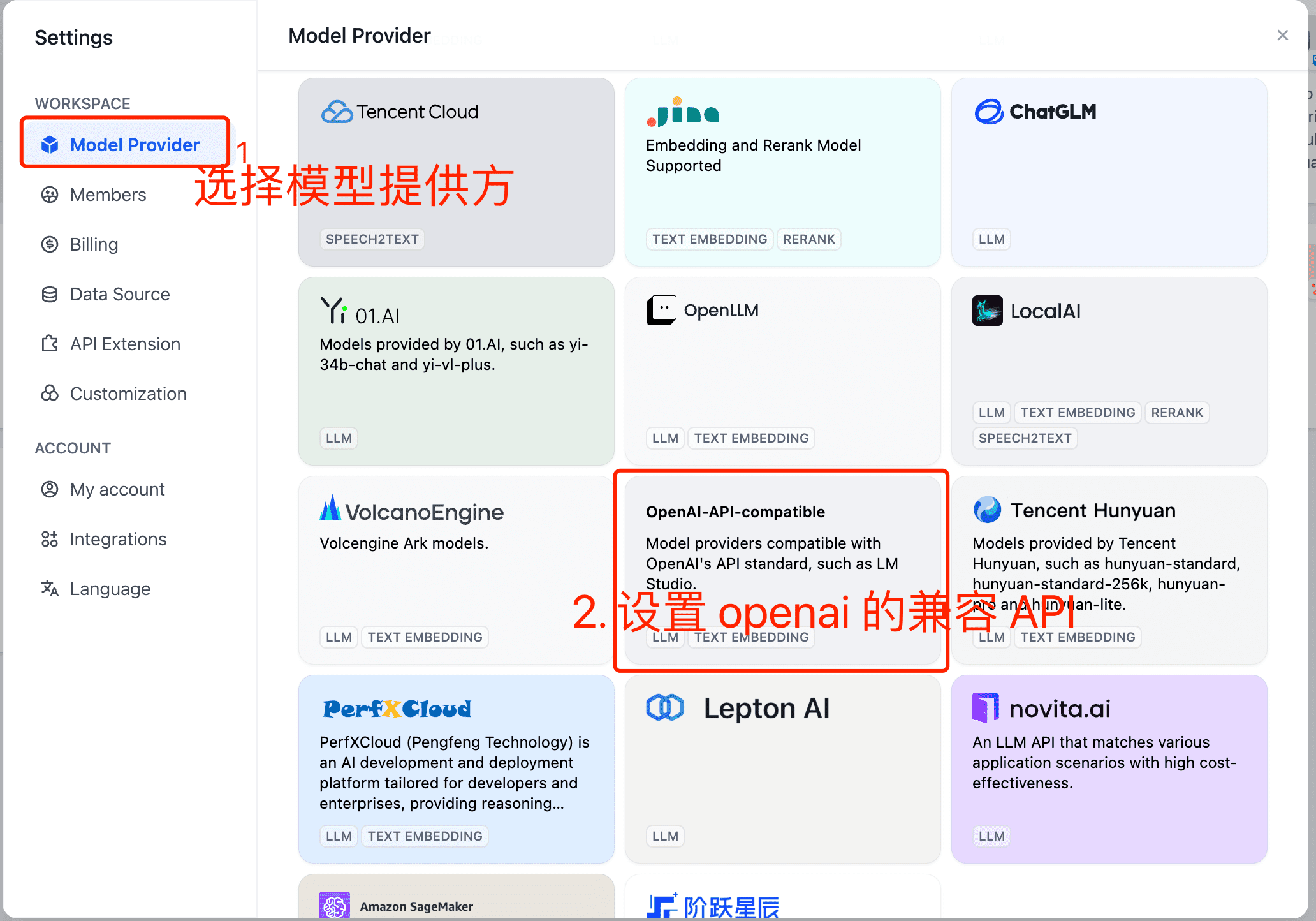

- Wählen Sie in den Einstellungen den Modellanbieter und stellen Sie "openai-kompatible API" ein.

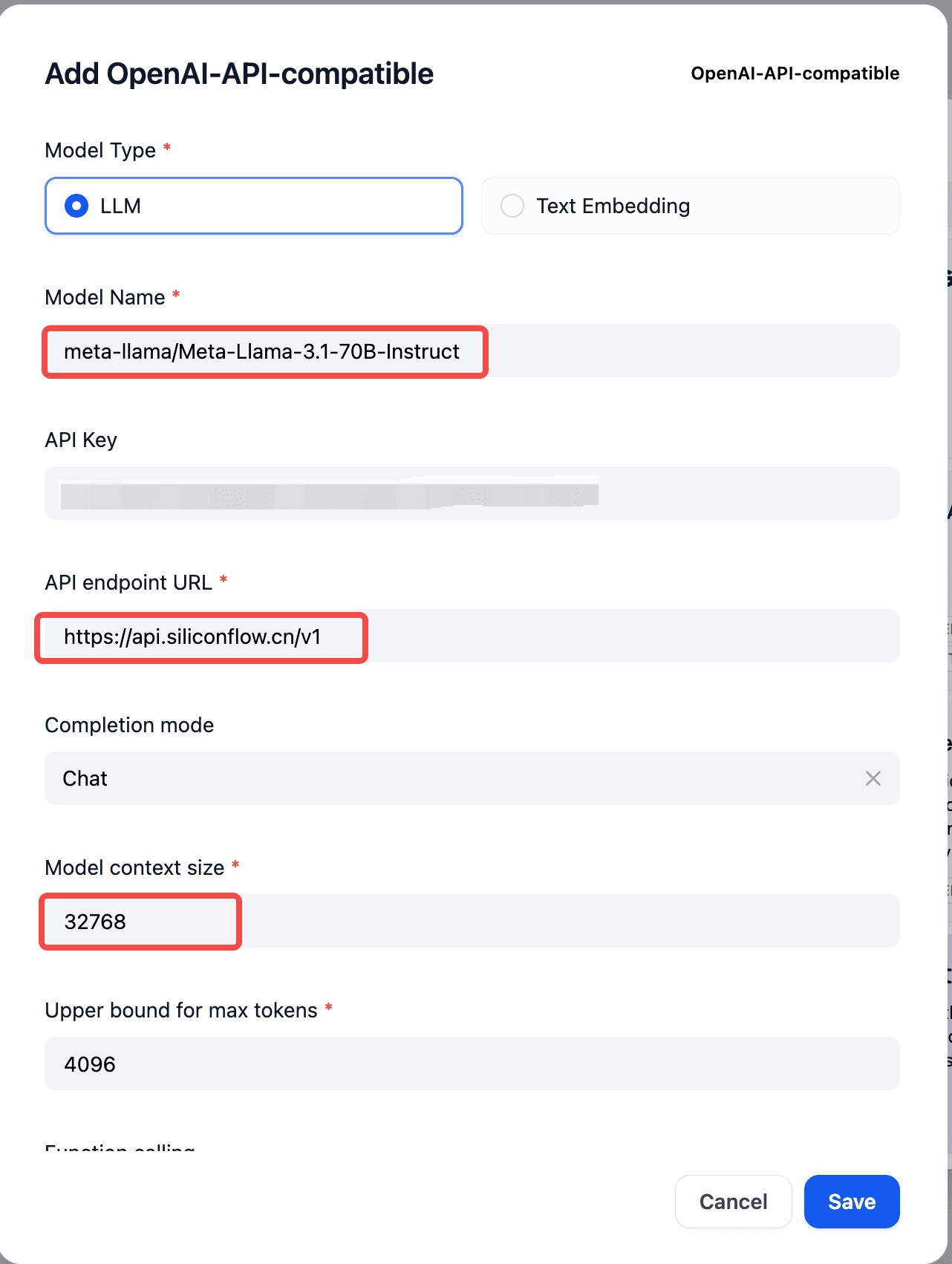

- Legen Sie den entsprechenden SiliconCloud-Modellnamen, den API-Schlüssel und den API-Endpunkt in der

Modellname: vonhttps://docs.siliconflow.cn/reference/chat-completions-1 Schauen Sie in das Dokument.

API-Schlüssel: vonhttps://cloud.siliconflow.cn/account/ak Bitte beachten Sie, dass Sie bei der Verwendung eines Modells aus Übersee die folgenden Bestimmungen beachten müssenhttps://docs.siliconflow.cn/docs/use-international-outstanding-models Dokumentationsregeln für die Authentifizierung mit echtem Namen.

API-Endpunkt-URL:https://api.siliconflow.cn/v1

- Sobald die Einrichtung abgeschlossen ist, können Sie die oben hinzugefügten Modelle in der Modellliste sehen.