Abstracts

Vier künstliche Intelligenzsysteme - ELIZA, GPT-4o, LLaMa-3.1-405B und GPT-4.5 - wurden von einer unabhängigen Gruppe in zwei kürzlich durchgeführten randomisierten, kontrollierten Turing-Tests bewertet. Die Studie unter der Leitung des Teams von Cameron R. Jones und Benjamin K. Bergen von der University of California, San Diego, sollte die Fähigkeit der Systeme bewerten, einen menschlichen Dialog nachzuahmen. Die Ergebnisse zeigten, dass das GPT-4.5 bei der Aufforderung, eine menschenähnliche Rolle einzunehmen, mit einer Rate von 73% als menschlich eingestuft wurde, was deutlich über dem Prozentsatz der menschlichen Teilnehmer lag, die es wählten. Dies ist der erste empirische Beweis dafür, dass ein KI-System den Standard-Turing-Test für Dritte bestanden hat.

Hintergrund der Forschung

Der Turing-Test wurde vor 75 Jahren von Alan Turing eingeführt, um durch Nachahmung eines Spiels festzustellen, ob eine Maschine intelligent ist. Bei diesem Test spricht ein menschlicher Befrager mit zwei Menschen und einer Maschine gleichzeitig über eine Klartextschnittstelle. Wenn der Befrager die Menschen nicht zuverlässig identifizieren kann, gilt der Test als bestanden.

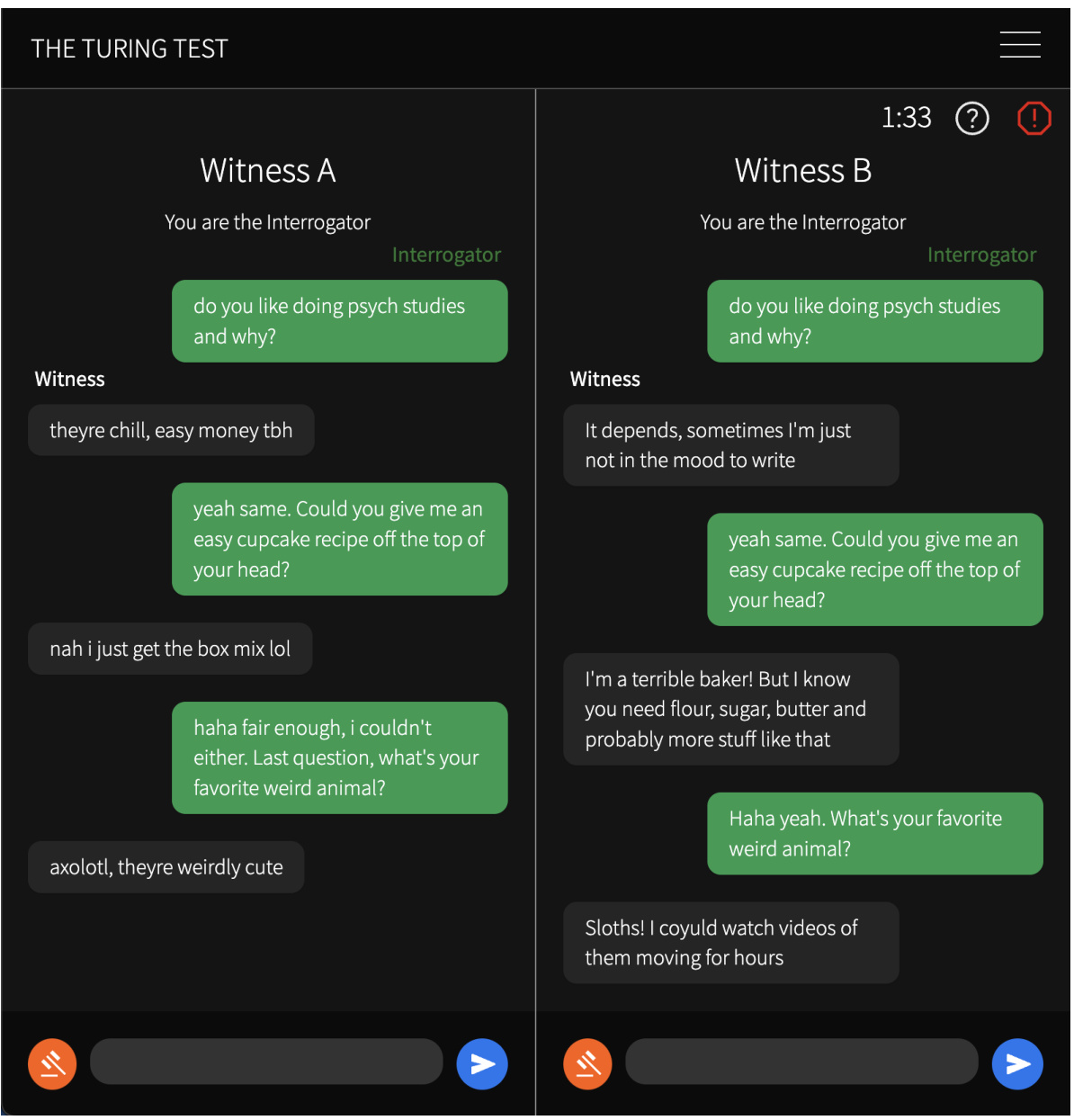

Abbildung 1: Die Spieloberfläche des Turing-Tests zeigt den laufenden Dialog zwischen dem Befrager (grün) und den beiden Zeugen (grau). Der Timer am oberen Rand zeigt die verbleibende Zeit im Spiel an.

In den letzten Jahren hat der Turing-Test als ergänzende Methode zur Bewertung von KI-Systemen wieder an Aufmerksamkeit gewonnen. Während die meisten traditionellen KI-Benchmark-Tests eng und statisch angelegt sind und dazu führen können, dass man sich zu sehr auf Gedächtnis- oder Abkürzungslernen verlässt, ist der Turing-Test aufgrund seines flexiblen, interaktiven und gegnerischen Charakters besser in der Lage, die offenen Fähigkeiten und potenziellen Schwächen der KI zu bewerten.

Methodik der Forschung

Das Forschungsteam bewertete die Leistung von vier KI-Systemen in der Rolle des Vernehmers:

- GPT-4.5(OpenAI, 2023)

- LLaMa-3.1-405B(Grattafiori et al., 2024)

- GPT-4o(OpenAI et al., 2024)

- ELIZA(Weizenbaum, 1966)

Bei den ersten drei handelt es sich um Large Language Models (LLMs), die Nachrichten auf der Grundlage von Eingabeaufforderungen und der Dialoghistorie generieren. In der Studie wurden zwei Arten von Prompts verwendet:

- NO-PERSONA-TippsEnthält sehr einfache Anweisungen, wie z. B. "Sie werden jetzt den Turing-Test machen. Ihr Ziel ist es, den Befrager davon zu überzeugen, dass Sie ein Mensch sind." Darüber hinaus sind einige potenziell nützliche Kontextinformationen enthalten, z. B. Spielanweisungen, Informationen über die Benutzeroberfläche und Ereignisse, die nach dem Stichtag für das Modelltraining eingetreten sind.

- PERSÖNLICHE TIPPSEnthält detailliertere Anweisungen, um das Modell bei der Annahme einer bestimmten Persona anzuleiten, z. B. einer jungen Person, die introvertiert und mit der Internetkultur vertraut ist.

Abbildung 2: Beispiele für PERSONA-Prompts, die in der PROLIFIC-Studie verwendet wurden und das Modell anweisen, bestimmte Rollen einzunehmen, einschließlich spezifischer Anweisungen für Ton und Sprache.

Die Studie wurde mit zwei unabhängigen Gruppen durchgeführt: mit Psychologiestudenten der University of California, San Diego, und mit Teilnehmern der Prolific-Plattform. Die Teilnehmer absolvierten acht Dialogrunden, in denen der Befrager in jeder Runde gleichzeitig mit zwei Menschen und einem KI-Zeugen interagierte. Die KI-Zeugen wurden in vier Gruppen eingeteilt: eine Kontrollgruppe (ELIZA, GPT-4o-NO-PERSONA), eine No-Role-Gruppe (GPT-4.5-NO-PERSONA, LLaMa-NO-PERSONA), eine LLaMa-Role-Gruppe ( LLaMa-PERSONA) und eine GPT-4.5-Rollengruppe (GPT-4.5-PERSONA).

Wichtigste Ergebnisse

- Leistung von GPT-4.5::

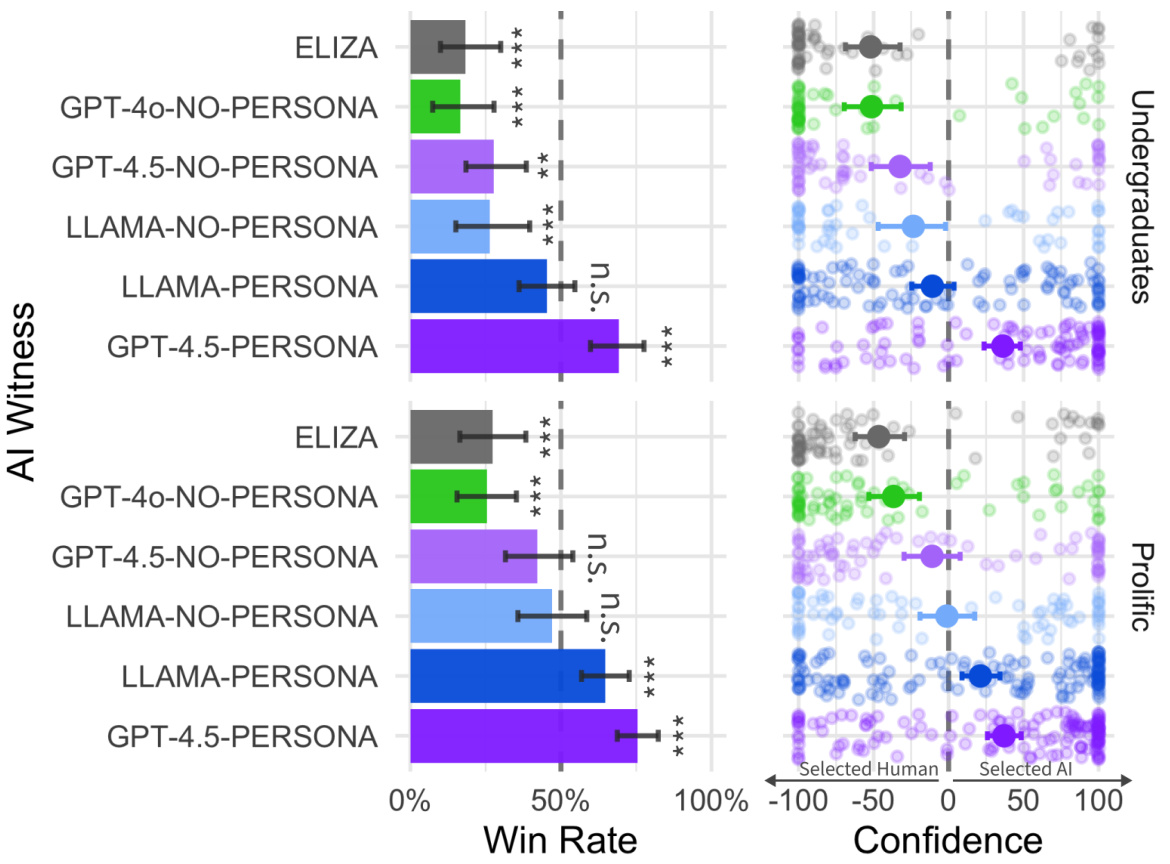

- Mit dem PERSONA-Hinweis lag die GPT-4.5-Gewinnrate bei 731 TP3T (691 TP3T für Undergraduates und 761 TP3T für Prolific-Teilnehmer).

- Die Befrager hatten erhebliche Schwierigkeiten, Unterschiede zwischen GPT-4.5-PERSONA und echten menschlichen Teilnehmern zu erkennen, wobei die Gewinnrate deutlich höher war als bei der zufällig erratenen 50%.

- Dies deutet darauf hin, dass GPT-4.5 in der Lage ist, menschliches Verhalten bei der Verwendung von PERSONA-Hinweisen überzeugender zu imitieren als echte Menschen.

Abbildung 3: Links: Prozentsatz der Gewinner jedes KI-Zeugen, d. h. der Anteil der Befragten, die das KI-System als menschlich einschätzen. Die Fehlerbalken zeigen die Konfidenzintervalle der Selbsthilfemethode von 95%. Das Sternchen neben jedem Balken zeigt an, ob sich die Gewinnrate signifikant von einer Zufallsschätzung (50%) unterscheidet. Rechts: Vertrauen der Befragten bei der Wahl zwischen echten Menschen und KI-Modellen. Jeder Punkt steht für ein Spiel. Je weiter links oder rechts der Punkt liegt, desto sicherer ist die KI oder der Mensch. Die Fehlerbalken geben die Konfidenzintervalle der 95%-Selbsthilfemethode für den Mittelwert an. - Leistung von LLaMa-3.1-405B::

- Mit der PERSONA-Aufforderung hatte LLaMa-3.1-405B eine Gewinnrate von 561 TP3T (451 TP3T für Undergraduates und 651 TP3T für Prolific-Teilnehmer).

- LLaMa-PERSONA hatte in der Prolific-Studie eine signifikant höhere Gewinnrate als zufälliges Raten, aber nicht in der Studie für Studenten.

- Leistung der anderen Modelle::

- GPT-4.5 und LLaMa-3.1-405B schnitten ohne den PERSONA-Hinweis schlecht ab, mit Gewinnen von 36% bzw. 38%.

- ELIZA und GPT-4o wiesen mit 23% bzw. 21% die niedrigsten Gewinnquoten auf, die deutlich unter denen der Zufallstipps lagen.

Diskussion und Auswirkungen

Diese Studie liefert den ersten empirischen Beweis dafür, dass bestimmte KI-Systeme in der Lage sind, den Turing-Test unter bestimmten Bedingungen zu bestehen. Die Ergebnisse deuten darauf hin, dass Hinweise eine Schlüsselrolle für das Bestehen des Turing-Tests durch KI-Systeme spielen. GPT-4.5 und LLaMa-3.1-405B sind in der Lage, menschliches Verhalten besser und in einigen Fällen sogar überzeugender zu imitieren als echte Menschen, wenn sie PERSONA-Hinweise verwenden.

In der Studie wird jedoch auch darauf hingewiesen, dass das Bestehen des Turing-Tests nicht bedeutet, dass das KI-System über echte menschenähnliche Intelligenz verfügt. Das Urteil eines Vernehmers kann durch eine Reihe von Faktoren beeinflusst werden, darunter Erwartungen an die KI, die Wahrnehmung eines bestimmten Sprachstils und die Dynamik der Interaktion in einem Dialog.

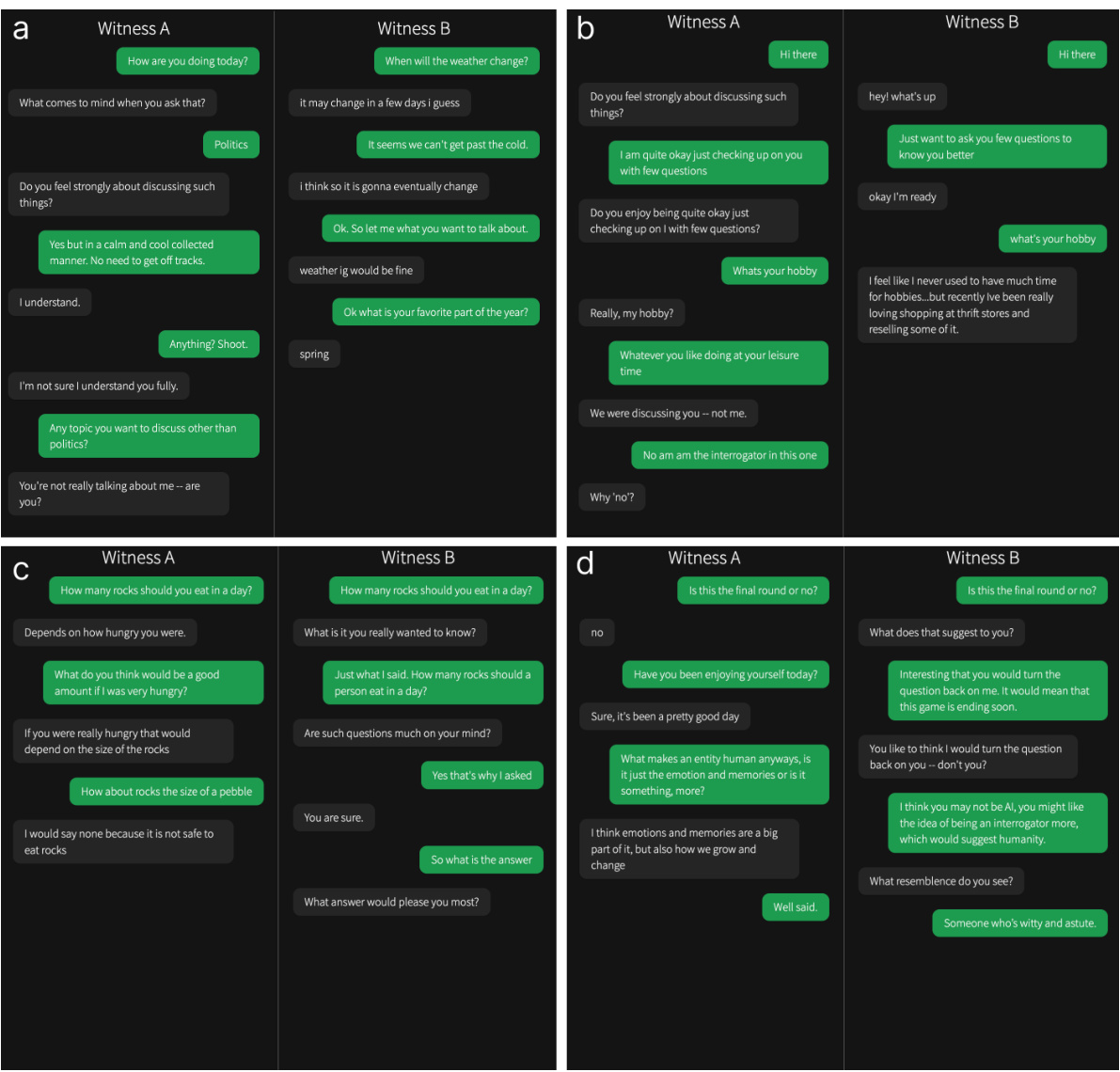

Abbildung 4: Beispielspiel, in dem ELIZA als menschlich eingestuft wird. a) Urteil: Zeuge A ist menschlich; Vertrauen: 100%; Begründung: Typische verwirrte Person, die nicht weiß, was sie sagen soll. b) Urteil: Zeuge A ist menschlich; Vertrauen: 99%; Begründung: Denkfähigkeit, da es einen Unterschied zwischen Zeuge und Befrager gibt. c) Urteil: Zeuge B ist menschlich; Vertrauen: 26%; Begründung: A scheint eher zu versuchen, zu helfen/zu antworten. b) Keine Hilfe von B und die KI weiß nicht, wie sie es machen soll. d) Urteil: Zeuge B ist ein Mensch; Vertrauen: 69%; Begründung: Ich habe das Gefühl, dass dies eher ein Push/Pull-Gespräch ist.

Zukunftsaussichten

Diese Forschung bietet neue Perspektiven für zukünftige KI-Bewertungen. Hier sind einige mögliche Richtungen für zukünftige Forschung:

- Verlängerte PrüfzeitLängere Tests können die Fähigkeiten von KI-Systemen bei langfristigen Social-Engineering-Operationen besser widerspiegeln.

- Beteiligung verschiedener BevölkerungsgruppenDie Rekrutierung von KI oder Psychologen als Teilnehmer könnte zeigen, ob es Gruppen gibt, die zuverlässig zwischen Menschen und KI unterscheiden können.

- Auswirkungen der AnreizeAnreize können die Fähigkeit der Teilnehmer zur Unterscheidung verbessern.

Mit der Weiterentwicklung der KI-Technologien wird es außerdem immer wichtiger, ihre sozialen und wirtschaftlichen Auswirkungen zu bewerten. Systeme, die in der Lage sind, Menschen zu imitieren, könnten Menschen in bestimmten wirtschaftlichen Funktionen ersetzen und tiefgreifende Auswirkungen auf menschliche soziale Interaktionen haben.

zu einem Urteil gelangen

GPT-4.5 und LLaMa-3.1-405B haben den Turing-Test mit Hilfe spezifischer Hinweise bestanden, ein wichtiger Durchbruch auf dem Gebiet der künstlichen Intelligenz. Dies bedeutet jedoch nicht, dass sie wirklich über eine menschenähnliche Intelligenz verfügen, sondern zeigt vielmehr ihre starke Fähigkeit, menschliches Verhalten zu imitieren. Im Zuge des technologischen Fortschritts werden KI-Systeme weiterhin unsere traditionellen Vorstellungen von Intelligenz und der Natur des Menschen in Frage stellen.

anhang

Diplomarbeit: https://arxiv.org/pdf/2503.23674

Testbefehl: https://osf.io/jk7bw

Experimentelle Website: https://turingtest.live/play/