Allgemeine Einführung

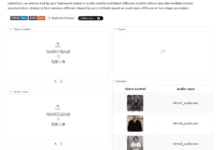

Open-VoiceCanvas ist eine Open-Source-Plattform für Sprachsynthese, die vom ItusiAI-Team entwickelt wurde. Sie unterstützt mehr als 50 Sprachen, wandelt Text in natürliche Sprache um und ermöglicht es Ihnen, durch Hochladen von Audiodaten eine personalisierte Stimme zu klonen. Das Projekt integriert OpenAI TTS, AWS Polly und MiniMax Sprachdienste und bietet eine breite Palette von Timbre-Optionen und Sprachratenanpassung. Der Code 100% ist quelloffen und wird auf GitHub gehostet, wo Nutzer ihn kostenlos herunterladen und verändern können. Er unterstützt außerdem Google- und GitHub-Logins sowie Stripe-Zahlungen für die einfache Freischaltung von erweiterten Funktionen. Dieses Tool eignet sich für Entwickler, Inhaltsersteller und normale Nutzer.

Funktionsliste

- Unterstützt die Text-zu-Sprache-Umwandlung in mehr als 50 Sprachen.

- Bietet eine Reihe von Sprachdiensten: OpenAI TTS (natürliche Sprache), AWS Polly (mehrsprachig), MiniMax (für Chinesisch optimiert).

- Unterstützt die Auswahl männlicher und weiblicher Stimmen mit einstellbarer Sprechgeschwindigkeit.

- Mit der Funktion zum Klonen von Tönen können Benutzer Audiodaten hochladen, um individuelle Töne zu erstellen.

- Unterstützt das Hochladen von Textdateien und das Herunterladen von Audiodateien, verarbeitet lange Texte ohne Druck.

- Integrierte Google- und GitHub-Anmeldungen, mehrsprachige Oberfläche und dunkle/helle Themes.

- Über Stripe sind Abonnementdienste verfügbar, darunter kostenlose Testversionen, monatliche/jährliche Zahlungen und Volumenabrechnungen.

Hilfe verwenden

Open-VoiceCanvas ist ein leistungsstarkes Open-Source-Tool. Hier finden Sie eine ausführliche Anleitung zur Installation und Nutzung, damit Sie schnell loslegen können.

Einbauverfahren

- Vorbereiten der Umgebung

Bevor Sie beginnen, vergewissern Sie sich, dass die folgenden Tools auf Ihrem Computer installiert sind:- Git: zum Herunterladen von Code.

- Node.js (18.x oder höher empfohlen): Führt das Front-End und Back-End aus.

- npm: Paketverwaltungswerkzeug für Node.js.

Prüfen Sie, ob sie installiert ist:

git --version

node --version

npm --version

Wenn es fehlt, können Sie es auf der offiziellen Website herunterladen und installieren.

- Klonen von Code

Öffnen Sie ein Terminal und geben Sie den folgenden Befehl ein, um das Projekt herunterzuladen:

git clone https://github.com/ItusiAI/Open-VoiceCanvas.git

Rufen Sie den Projektkatalog auf:

cd Open-VoiceCanvas

- Installation von Abhängigkeiten

Führen Sie den folgenden Befehl aus, um die erforderlichen Bibliotheken zu installieren:

npm install

Wenn das Netzwerk langsam ist, verwenden Sie einen Inlandsspiegel:

npm install --registry=https://registry.npmmirror.com

- Umgebungsvariablen konfigurieren

Erstellen Sie im Stammverzeichnis des Projekts die Datei.envfügen Sie die folgende Konfiguration hinzu (Sie müssen sie durch Ihren eigenen Schlüssel ersetzen):

# OpenAI

OPENAI_API_KEY="your_openai_api_key"

# AWS Polly

NEXT_PUBLIC_AWS_REGION="us-east-1"

NEXT_PUBLIC_AWS_ACCESS_KEY_ID="your_aws_access_key_id"

NEXT_PUBLIC_AWS_SECRET_ACCESS_KEY="your_aws_secret_access_key"

# MiniMax

MINIMAX_API_KEY="your_minimax_api_key"

MINIMAX_GROUP_ID="your_minimax_group_id"

# 数据库

DATABASE_URL="your_neon_db_url"

# Stripe

STRIPE_SECRET_KEY="your_stripe_secret_key"

NEXT_PUBLIC_STRIPE_PUBLISHABLE_KEY="your_stripe_publishable_key"

STRIPE_WEBHOOK_SECRET="your_stripe_webhook_secret"

# NextAuth

NEXTAUTH_URL="http://localhost:3000"

NEXTAUTH_SECRET="your_nextauth_secret"

# OAuth

GITHUB_ID="your_github_client_id"

GITHUB_SECRET="your_github_client_secret"

GOOGLE_ID="your_google_client_id"

GOOGLE_SECRET="your_google_client_secret"

Diese Schlüssel müssen von den offiziellen Websites der entsprechenden Dienste bezogen werden, z. B. OpenAI, AWS, MiniMax, Neon, Stripe und GitHub/Google OAuth.

- Durchführung einer Datenbankmigration

Konfigurieren Sie die Datenbank und führen Sie sie aus:

npx prisma migrate dev

Damit wird die PostgreSQL-Datenbank initialisiert.

- Auslöseverfahren

Geben Sie den folgenden Befehl ein, um den Entwicklungsserver zu starten:

npm run dev

Nach dem Start greift der Browser auf die http://localhost:3000Sie können die Schnittstelle sehen.

Hauptfunktionen

Text-to-Speech

- Öffnen Sie die Webseite, melden Sie sich an und gehen Sie zum Hauptbildschirm.

- Geben Sie einen Text in das Texteingabefeld ein, z. B. "Hallo, heute ist Mittwoch".

- Wählen Sie die Sprache (mehr als 50 werden unterstützt, z. B. Chinesisch, Englisch, Japanisch usw.).

- Wählen Sie einen Sprachdienst: OpenAI TTS, AWS Polly oder MiniMax.

- Wählen Sie eine Klangfarbe (männlich oder weiblich, z. B. "nova" von OpenAI oder "Joanna" von AWS).

- Stellen Sie die Sprechgeschwindigkeit ein (Bereich 0,5-2,0, 1,0 ist normal).

- Klicken Sie auf "Erzeugen", um eine Vorschau des Tons in wenigen Sekunden zu erhalten.

- Klicken Sie auf "Herunterladen", um eine MP3-Datei zu speichern.

Sound-Klonen

- Gehen Sie auf die Seite "Sound Cloning".

- Klicken Sie auf "Audio hochladen" und wählen Sie einen klaren 10-20 Sekunden langen Audioclip (WAV- oder MP3-Format).

- Geben Sie den Namen des Tons ein, z. B. "Meine Stimme".

- Klicken Sie auf "Klonen" und warten Sie 1-2 Minuten, bis der Vorgang abgeschlossen ist.

- Nach erfolgreichem Klonen erscheint der neue Ton in der Tonliste.

- Kehren Sie zur Seite "Text-to-Speech" zurück, wählen Sie "Ton klonen" und geben Sie Text ein, um Sprache zu erzeugen.

Bearbeitung von Dokumenten

- Klicken Sie auf dem Hauptbildschirm auf "Textdatei hochladen".

- Wählen Sie eine

.txtDatei, wird der Inhalt automatisch in das Eingabefeld geladen. - Erzeugen Sie Audio, nachdem Sie die Sprache, die Klangfarbe und die Sprechgeschwindigkeit eingestellt haben.

- Lange Texte werden automatisch segmentiert, um eine reibungslose Erstellung zu gewährleisten.

Abonnieren und Anmelden

- Klicken Sie oben rechts auf "Anmelden" und wählen Sie die Google- oder GitHub-Kontoautorisierung.

- Melden Sie sich an, um Zeichenquoten und Klonzahlen anzuzeigen.

- Klicken Sie auf "Abonnieren" und wählen Sie ein kostenloses Probeabonnement, ein Monatsabonnement oder ein Jahresabonnement.

- Geben Sie Ihre Zahlungsinformationen über Stripe ein und schalten Sie weitere Funktionen frei, wenn Sie Ihr Abonnement abschließen.

caveat

- Audio-AnforderungenDer zum Klonen verwendete Ton sollte klar und frei von Hintergrundgeräuschen sein.

- Sicherheit der Schlüssel: Verschenken Sie es nicht.

.envSchlüssel in der Datei. - NetzanforderungModelle müssen für den ersten Lauf heruntergeladen werden, damit das Netz stabil bleibt.

- Technische UnterstützungSie können einen Fehler auf GitHub melden, wenn Sie auf Probleme stoßen.

Mit diesen Schritten können Sie die Möglichkeiten von Open-VoiceCanvas voll ausschöpfen. Das Open-Source-Design unterstützt auch die Anpassung durch Entwickler, z. B. das Hinzufügen neuer Sprachdienste oder das Optimieren der Schnittstelle.

Anwendungsszenario

- Erstellung von Inhalten

Moderatoren können damit mehrsprachige Beiträge erstellen und Aufnahmezeit sparen.

Beschreibung des Szenarios: Ein YouTuber erstellt Videokommentare auf Chinesisch und Englisch und lädt die Audiodaten direkt zur Bearbeitung herunter. - Pädagogische Unterstützung

Lehrer konvertieren Lehrbücher in Sprache, um Unterrichtsaudios zu erstellen.

Szenariobeschreibung: Ein Englischlehrer lädt einen Text hoch und generiert eine amerikanische Aussprache, die die Schüler zum Üben hören können. - Personalisierte Anwendungen

Die Entwickler klonen ihre eigenen Stimmen, um einzigartige Sprachassistenten zu schaffen.

Beschreibung des Szenarios: Ein Programmierer klont eine Stimme und integriert sie in ein Smart-Home-System, um das Wetter mit seiner eigenen Stimme zu übertragen. - Erholungsnutzung

Die Benutzer erzeugen lustige Stimmen, die sie mit Freunden teilen können.

Szenario: Jemand generiert ein "Happy Birthday"-Audio mit der Stimme eines Freundes als Überraschungsgeschenk.

QA

- Welche Sprachdienste werden unterstützt?

Unterstützung für OpenAI TTS (natürliche Sprache), AWS Polly (mehrsprachig) und MiniMax (für Chinesisch optimiert). - Was braucht es, um eine Stimme zu klonen?

Benötigt werden 10-20 Sekunden eines klaren Tons im WAV- oder MP3-Format mit möglichst wenig Hintergrundgeräuschen. - Was ist der Unterschied zwischen der kostenlosen Version und der kostenpflichtigen Version?

Die kostenlose Version ist auf Zeichen und Klone beschränkt, die kostenpflichtige Version bietet mehr Kontingente und Tonoptionen. - Wie kann ich einen Startfehler beheben?

Überprüfen Sie die Node.js-Version (18.x empfohlen), um sicherzustellen, dass die Umgebungsvariablen korrekt konfiguriert und die Abhängigkeiten vollständig installiert sind.