Allgemeine Einführung

NSFW Detector ist ein KI-basiertes Tool zur Erkennung von anstößigen Inhalten, das hauptsächlich dazu dient, zu erkennen, ob Bilder, Videos, PDF-Dateien usw. anstößige Inhalte enthalten. Das Tool verwendet Falconsai/nsfwBildNSFW Detector unterstützt den CPU-Betrieb ohne die Notwendigkeit eines Grafikprozessors und ist für die meisten Server geeignet. Er bietet Dienste über eine API für die einfache Integration mit anderen Anwendungen und unterstützt die Docker-Bereitstellung für den verteilten Einsatz. Mit hoher Genauigkeit und Datensicherheit kann das Tool lokal ausgeführt werden, um Benutzerdaten zu schützen.

Funktionsliste

- AI-ErkennungErmöglicht die hochpräzise Erkennung unangenehmer Inhalte auf der Grundlage von KI-Modellen.

- Unterstützung mehrerer DateitypenUnterstützung für die Erkennung von Bildern, Videos, PDF-Dateien und Dateien in komprimierten Paketen.

- CPU-Betrieb: Keine GPU-Unterstützung erforderlich, für die meisten Server geeignet.

- API-Dienste: Die Erkennungsdienste werden über eine API zur einfachen Integration in andere Anwendungen bereitgestellt.

- Docker-BereitstellungUnterstützt die Docker-Bereitstellung für verteilte Bereitstellungen.

- lokaler BetriebSicherheit: Um die Sicherheit der Benutzerdaten zu gewährleisten, erfolgt die Erkennung lokal.

Hilfe verwenden

Installation und Einsatz

- Docker-Bereitstellung::

- Starten Sie den API-Server:

bash

docker run -d -p 3333:3333 --name nsfw-detector vxlink/nsfw_detector:latest

- Wenn Sie Dateien mit lokalen Pfaden zum Server erkennen müssen, können Sie die Pfade in den Container einhängen:

bash

docker run -d -p 3333:3333 -v /path/to/files:/path/to/files --name nsfw-detector vxlink/nsfw_detector:latest

- Starten Sie den API-Server:

Verwendung von APIs für die Überprüfung von Inhalten

- Erkennung von Bilddateien::

curl -X POST -F "file=@/path/to/image.jpg" http://localhost:3333/check

- Erkennung lokaler Dateipfade::

curl -X POST -F "path=/path/to/image.jpg" http://localhost:3333/check

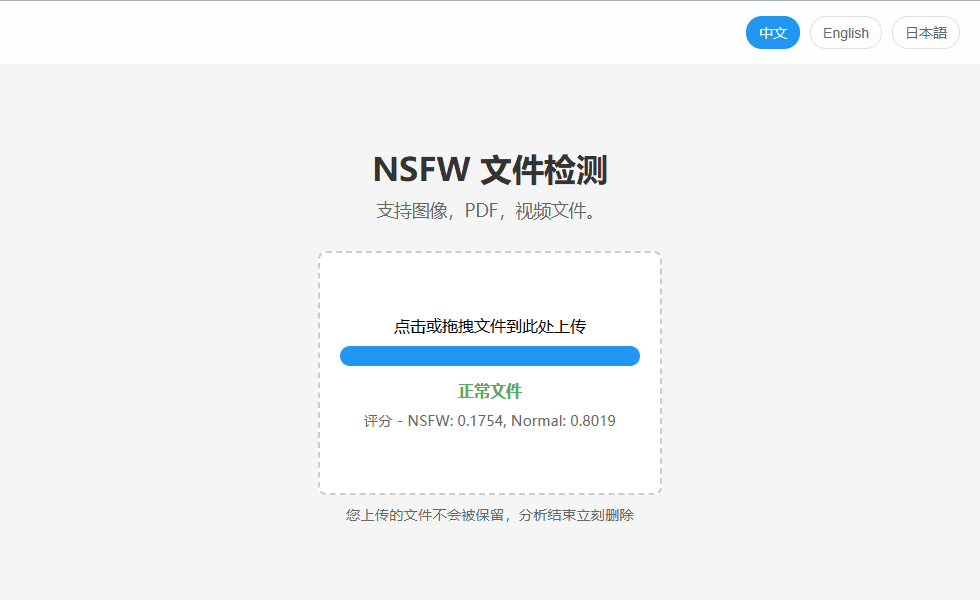

Testen über die integrierte Webschnittstelle

- Besuchen Sie die folgende Adresse:

http://localhost:3333

Konfigurationsdatei

- Konfigurationsdatei bearbeiten::

- existieren

/tmpVerzeichnis, um eine Datei namensconfigDatei und konfigurieren Sie das Verhalten des Detektors nach Bedarf. - Beispiel für eine Konfiguration:

bash

nsfw_threshold=0.5

ffmpeg_max_frames=100

ffmpeg_max_timeout=30

- existieren

Leistungsanforderungen

- Für den Betrieb des Modells sind bis zu 2 GB RAM erforderlich.

- Bei der gleichzeitigen Bearbeitung einer großen Anzahl von Anfragen kann mehr Speicherplatz erforderlich sein.

- Unterstützte Architekturen: x86_64, ARM64.

Unterstützte Dateitypen

- Bilder (Unterstützung)

- Video (Unterstützung)

- PDF-Dateien (Unterstützung)

- Dateien im Zip-Paket (Unterstützung)

Öffentliche API

Wenn Sie es nicht selbst bereitstellen möchten, können Sie den öffentlichen API-Dienst von vx.link nutzen:

curl -X POST -F "file=@/path/to/image.jpg" https://vx.link/public/nsfw

Beachten Sie, dass die öffentliche API ein Limit von 30 Anfragen pro Minute hat.