Allgemeine Einführung

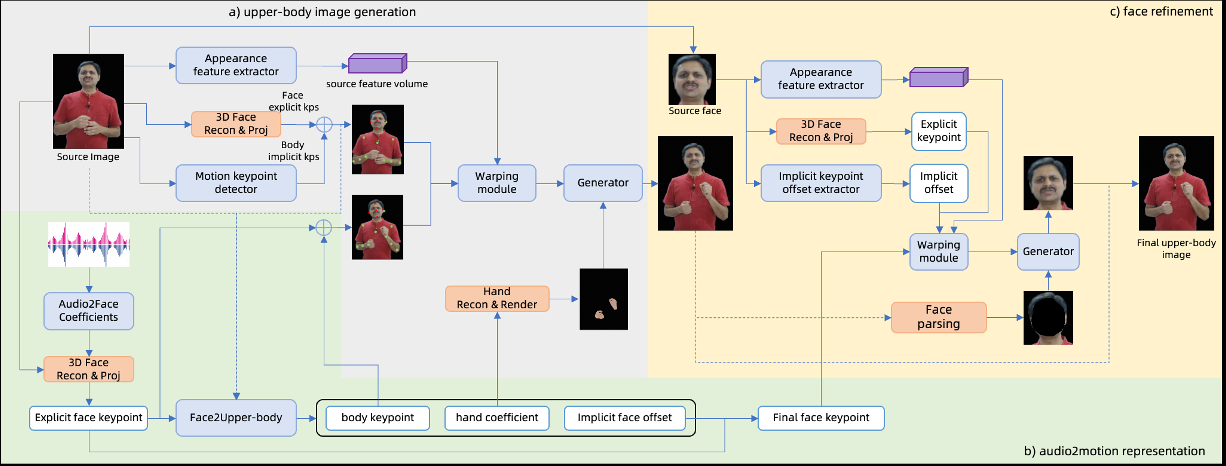

ChatAnyone ist ein innovatives Projekt, das von dem HumanAIGC-Team entwickelt wurde. Es nutzt die Technologie der künstlichen Intelligenz, um aus einem einzigen Foto und einer Audioeingabe ein digitales menschliches Porträtvideo mit Oberkörperbewegungen zu erzeugen. Auf der Grundlage eines hierarchischen Bewegungsdiffusionsmodells erzeugt das Projekt Kopfbewegungen, Gesten und Ausdrücke, die für die Präsentation von Avataren oder die Animation digitaler Personen geeignet sind. ChatAnyone zeichnet sich durch eine effiziente Erzeugung aus und unterstützt eine Auflösung von 512×768 und eine Videoausgabe mit 30 Bildern pro Sekunde. Das Projekt befindet sich derzeit auf GitHub und zeigt technische Details, ist aber noch nicht vollständig quelloffen, was die Aufmerksamkeit vieler Nutzer auf sich zieht, die an der Technologie zur Erzeugung digitaler Menschen interessiert sind.

Funktionsliste

- Fotoerzeugung VideoGenerierung digitaler menschlicher Videos mit Oberkörperbewegungen aus einem einzigen Foto und einer Audioeingabe.

- BewegungssteuerungUnterstützung bei der Erzeugung natürlicher Kopfbewegungen, Gesten und Mimik.

- AudiosynchronisationLippenbewegungen werden an den Ton angepasst, um den Realismus zu erhöhen.

- Hohe LeistungUnterstützt eine Auflösung von 512×768 bei 30 Bildern pro Sekunde auf dem 4090-GPU.

- Technologie-SchaufensterTeilen Sie die Ergebnisse über eine GitHub-Seite, damit die Benutzer lernen und erforschen können.

Hilfe verwenden

ChatAnyone ist derzeit ein Technologie-Demonstrationsprojekt und ist nicht vollständig quelloffen, so dass es nicht direkt heruntergeladen oder installiert werden kann. Der folgende Inhalt basiert auf offiziellen Informationen und beschreibt detailliert die Funktionalität und Betriebslogik, um Nutzern zu helfen, das Projekt zu verstehen und sich auf eine mögliche offene Nutzung in der Zukunft zu freuen.

Hauptfunktionen

1. die Erstellung von Videos aus Fotos

- BetriebslogikDer Benutzer stellt ein Porträtfoto und ein Audiomaterial (z. B. eine Sprach- oder Gesangsaufnahme) zur Verfügung, und das System erzeugt ein Video der digitalen Person mit Oberkörperbewegungen. Das Video enthält Bewegungen wie Kopfdrehungen und Gesten.

- WirkungAusgabe einer Videoauflösung von bis zu 512 x 768 mit einer Bildrate von 30 Bildern pro Sekunde. Digitale menschliche Bewegungen werden an das Audiotempo angepasst, was für die Darstellung virtueller Bilder geeignet ist.

- VerwendungDie Funktionalität ist derzeit durch offizielle Demonstrationsvideos oder Dokumentationen bekannt, und eine Betaversion kann in Zukunft geöffnet werden.

2. die Kontrolle der Bewegung

- BetriebslogikDas System erzeugt natürliche Oberkörperbewegungen auf der Grundlage von Audiodaten, einschließlich Kopf- und Handdynamik. Die Benutzer können anhand von Beispielen den Bewegungsumfang kennenlernen.

- WirkungDie generierte digitale Person kann verschiedene Bewegungsstile, wie Nicken und Gestenwechsel, darstellen, um die Ausdruckskraft zu erhöhen.

- VerwendungDiese Funktion befindet sich in der Demonstrationsphase, und die Benutzer können sich auf der GitHub-Seite ansehen, wie sie funktioniert.

3. die Audio-Synchronisation

- BetriebslogikNach der Eingabe eines klaren Tons erzeugt das System Lippenbewegungen, die dem Rhythmus des Tons entsprechen.

- WirkungLippen sind hochsynchronisiert mit Audio für virtuelle Moderatoren oder animierte Präsentationen.

- VerwendungDerzeit durch ein offizielles Beispielvideo erlebbar, Benutzertests können in Zukunft unterstützt werden.

Wie Sie weitere Informationen erhalten

- Besuchen Sie die offizielle Seite: Weiter zu

https://github.com/HumanAIGC/chat-anyonesehen Sie sich die Projektbeschreibung und das Präsentationsvideo an. - Updates verfolgenDas Projekt ist noch nicht quelloffen, aber das Team könnte in Zukunft Code oder Tools veröffentlichen. Es wird empfohlen, das GitHub-Repository regelmäßig zu überprüfen.

- Kontakt mit dem TeamFür weitere Informationen hinterlassen Sie bitte eine Nachricht auf GitHub oder finden Sie offizielle Kontaktinformationen.

caveat

- ChatAnyone ist derzeit ein Technologie-Demonstrationsprojekt und kann nicht direkt genutzt werden.

- Generation erfordert Hochleistungshardware (z. B. 4090 GPUs), die für den Durchschnittsnutzer vor Ort nur schwer zu erleben ist.

- Das Projekt wird möglicherweise in Zukunft als Open-Source-Projekt veröffentlicht, und zu diesem Zeitpunkt wird ein ausführlicherer Leitfaden verfügbar sein.

Anwendungsszenario

- Virtuelle Bildpräsentation

Die Nutzer können Videos von digitalen Personen mit Fotos erstellen, um personalisierte virtuelle Bilder zu zeigen. - Produktion von Animationsinhalten

Creators können das generierte Video einer halbwegs digitalen Person nutzen, um Kurzfilme oder Präsentationsinhalte zu erstellen. - Technische Studien

Forscher können im Rahmen des Projekts mehr über audiogestützte Techniken zur Erzeugung digitaler Menschen erfahren.

QA

- Kann ChatAnyone in Echtzeit chatten?

Derzeit nicht. Es konzentriert sich auf die Erstellung von Videos aus Fotos und Audio, nicht auf ein Live-Chat-Tool. - Welche Arten von Fotos werden unterstützt?

Die offizielle Präsentation erfolgt auf der Grundlage von Porträtfotografien, und die spezifischen Anforderungen sind in den künftigen Dokumenten zu finden. - Ist das Video im Handel erhältlich?

Derzeit gibt es keine explizite Lizenz, man muss auf Open Source warten, um die Vereinbarung zu sehen.